前言

lr_scheduler_type 是 Huggingface transformers Trainer 的 TrainingArguments 之一。注意,如果使用 Deepspeed 启动训练,DeepSpeed 配置文件中的 optim 和 lr schedule 会覆盖传参的值。本文介绍 --lr_scheduler_type 的取值与含义(源码在 transformers/trainer_utils.py)。

学习率调度器与优化器

学习率调度器(Learning Rate Scheduler) 和 优化器(Optimizer) 是 LLM 训练过程中的两个关键组件,它们各自扮演不同的角色,但又相互关联。优化器的主要职责是:

- 根据损失函数的梯度来更新模型参数。

- 通过调整模型参数来最小化损失函数。

常见的优化器包括 SGD、Adam、RMSprop 等。优化器的行为通常由一组超参数控制,最重要的超参数之一就是学习率。本文的主角——学习率调度器(Learning Rate Scheduler)的主要职责是动态调整学习率,以便在训练过程中优化模型的性能和收敛速度。学习率调度器会根据预设的策略在训练的不同阶段调整学习率。

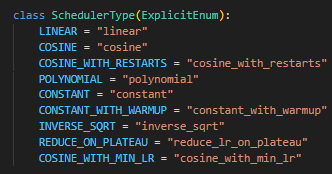

学习率优化器参数取值

--lr_scheduler_type

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

518

518

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?