粒子群算法(Particle Swarm Optimization,PSO)是20世纪90年代兴起的一门学科,因其概念简明、实现方便、收敛速度快而为人所知。粒子群算法的基本思想是模拟鸟群随机搜寻食物的捕食行为,鸟群通过自身经验和种群之间的交流调整自己的搜寻路径,从而找到食物最多的地点。其中每只鸟的位置/路径则为自变量组合,每次到达的地点的食物密度即函数值。每次搜寻都会根据自身经验(自身历史搜寻的最优地点)和种群交流(种群历史搜寻的最优地点)调整自身搜寻方向和速度,这个称为跟踪极值,从而找到最优解。

粒子群算法是一门新兴算法,此算法与遗传算法有很多相似之处,其收敛于全局最优解的概率很大。

①相较于传统算法计算速度非常快,全局搜索能力也很强;

②PSO对于种群大小不十分敏感,所以初始种群设为500-1000,速度影响也不大;

③粒子群算法适用于连续函数极值问题,对于非线性、多峰问题均有较强的全局搜索能力。

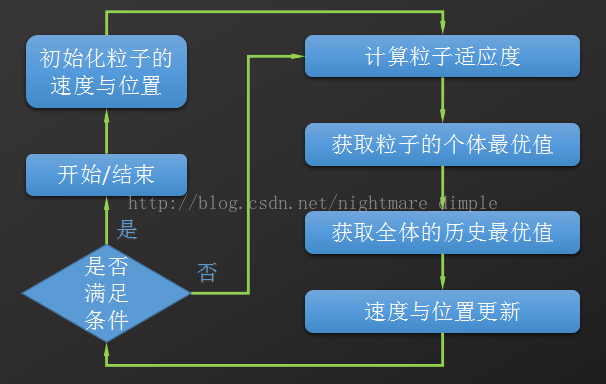

其流程图如下:

Step1:确定一个粒子的运动状态是利用位置和速度两个参数描述的,因此初始化的也是这两个参数;

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1932

1932

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?