开源大模型Llama 3王者归来!最大底牌4000亿参数,性能直逼GPT-4

扎克伯格:「有了 Llama 3,全世界就能拥有最智能的 AI。」

ChatGPT 拉开了大模型竞赛的序幕,Meta 似乎要后来居上了。

扎克伯格在 Facebook 上发帖:Big AI news today.

借助先进的 Llama 3 模型,Meta 的 AI 助手已全面升级,现已无缝集成于 Instagram、WhatsApp 和 Facebook 等 Meta 全系应用中。此外,Meta 推出了一个突破性的图像生成器,可将自然语言提示词转化为令人惊叹的图像。

Meta AI 网址:https://www.meta.ai/

扎克伯格表示,Meta 提供的生成式 AI 能力在免费产品中性能是最强大的。

通过 Meta AI,用户现可在 Facebook、Instagram、WhatsApp 和 Messenger 上搜索信息,无需在应用之间切换。这项创新功能简化了信息获取,让您在熟悉的平台上即可轻松获取所需内容。

当你浏览信息流的时候,还可以直接从帖子中向 Meta AI 询问更多信息:

现在,你可以通过 WhatsApp 使用 Imagine 功能,利用文本实时生成图像。该功能现已在美国的 WhatsApp 和 Meta AI 网络体验版上推出测试。

开始打字时,你会看到一个图像出现,每多输入几个字母,图像都会发生变化:

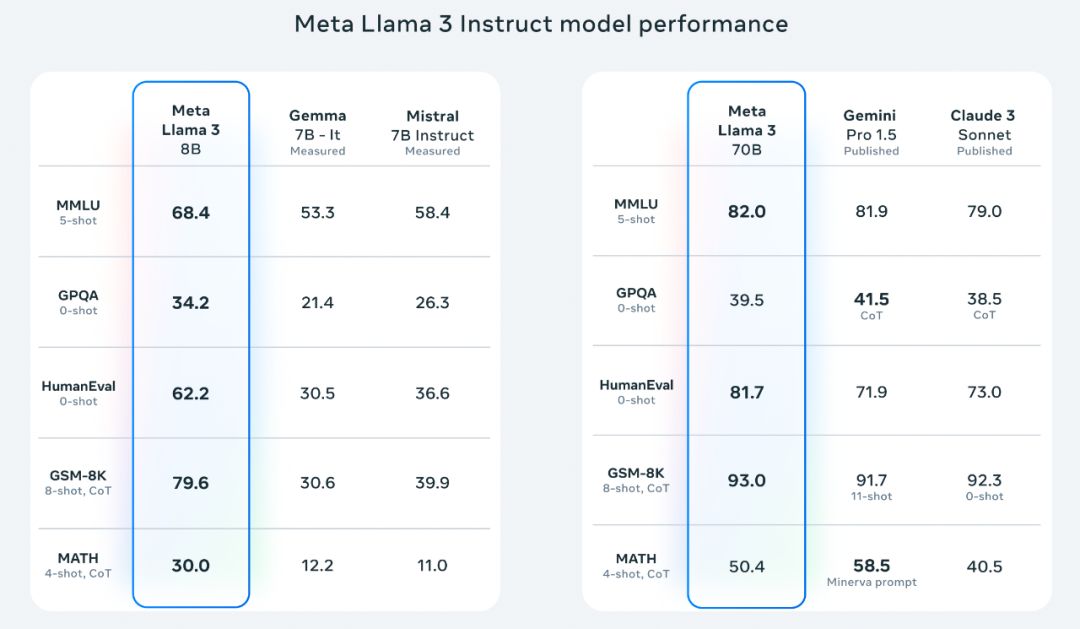

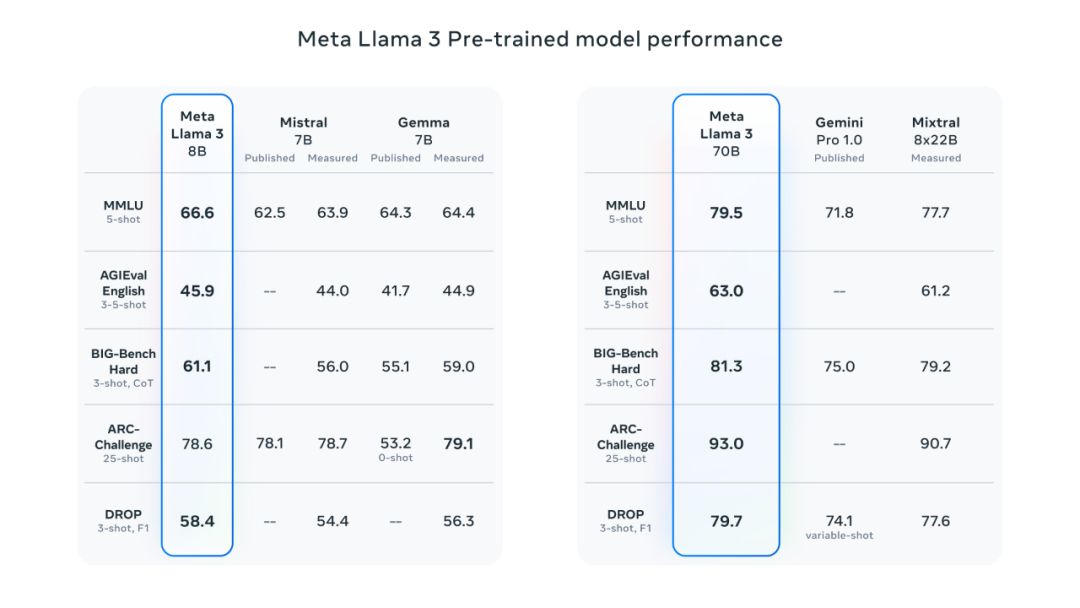

Meta 的 Lambda 3 模型在关键基准测试中超越对手,在代码生成等任务上占据主导地位。其强大的推理能力、精准指令遵循以及可视化思维,使之能够解决复杂难题,为人工智能的研究和应用开辟新的可能性。

简而言之,Llama 3 的主要亮点包括:

- 凭借超过 15T 的庞大训练数据集,这款 AI 模型蕴藏着非凡的潜力,相当于热门的 Llama 2 数据集的 7 倍以上。

- 在大量重要基准中均具有最先进性能;

- 新能力范畴,包括增强的推理和代码能力;

- 训练效率比 Llama 2 高 3 倍;

- 增强网络安全防护,提升业务信心。

新升级的Trust & Safety套件,融合了Llama Guard 2、Code Shield和CyberSec Eval 2,为您的系统提供多重保护,抵御网络威胁,确保业务安全无忧。

Meta AI 助手现已集成先进的 8B 和 70B Llama 3 模型,并已开源分享给开发者。这些预训练和微调模型赋能开发者构建更智能的 AI 应用程序。

体验LLaMA语言模型的强大功能,立即下载:https://llama.meta.com/llama-downloads/

Github:https://github.com/meta-llama/

Meta 研究科学家 Aston Zhang 揭开大型语言模型 Llama 3 的研发历程:

面对预训练、人类数据、扩展性、长上下文、后训练和评估的重重挑战,研究团队经历了一段考验与兴奋交织的旅程,成就了 Llama 3 的诞生。

解锁 Llama 3 的秘密:

Meta 的研究团队将通过深入的视频系列,揭示 Llama 3 背后的尖端技术。此外,有关 Llama 3 的研究论文即将发布,提供深入的技术见解。

Llama 3,性能重回王座

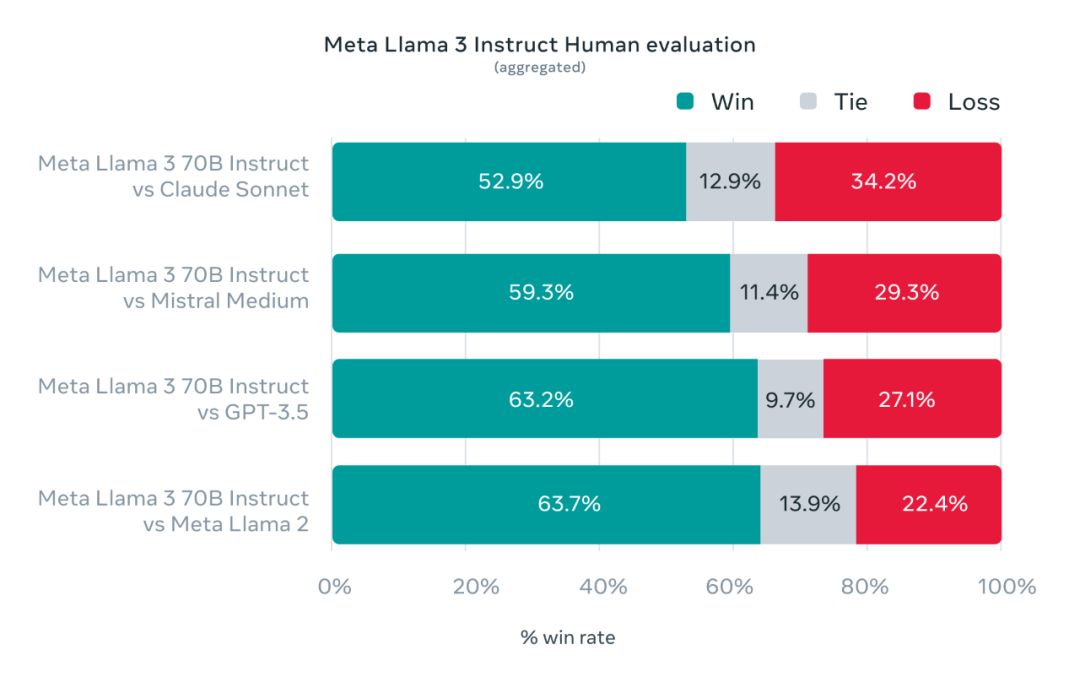

此外,Meta 还开发了一套新的高质量人类评估数据集。该评估集包含 1800 个提示,涵盖 12 个关键用例:寻求建议、头脑风暴、分类、封闭式问答、编码、创意写作、提取、塑造角色、开放式问答、推理、重写和总结。为了防止 Llama 3 在此评估集上出现过度拟合,Meta 表示他们自己的团队也无法访问该数据集。下图显示了针对 Claude Sonnet、Mistral Medium 和 GPT-3.5 对这些类别和提示进行人工评估的汇总结果。

模型架构

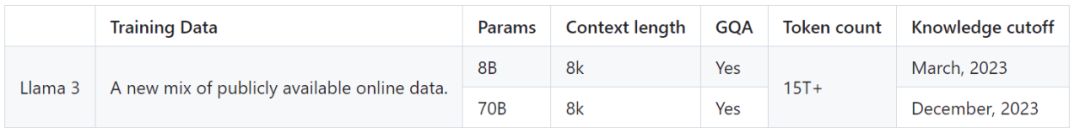

训练数据

为了训练最好的语言模型,管理大型、高质量的训练数据集至关重要。Meta 在预训练数据上投入了大量成本。Llama 3 使用超过 15T 的 token 进行了预训练,这些 token 都是从公开来源收集的。

总体上讲,Llama 3 的训练数据集是 Llama 2 使用的数据集的七倍多,并且包含四倍多的代码。为了为即将到来的多语言用例做好准备,超过 5% 的 Llama 3 预训练数据集由涵盖 30 多种语言的高质量非英语数据组成。但是,Llama 3 在这些语言上的性能水平预计不会与英语相同。

扩展预训练

大型语言模型的性能与训练数据和参数数量呈对数线性增长。8B 和 70B 模型尽管训练计算量较少,仍可匹配较小模型的性能。然而,较小模型推理效率更高,通常为首选。

融合 Meta 定制训练集、超级集群和生产集群,驱动 Llama3 语言模型的预训练。第三方云计算平台则用于微调、注释和评估,确保模型的高效性。

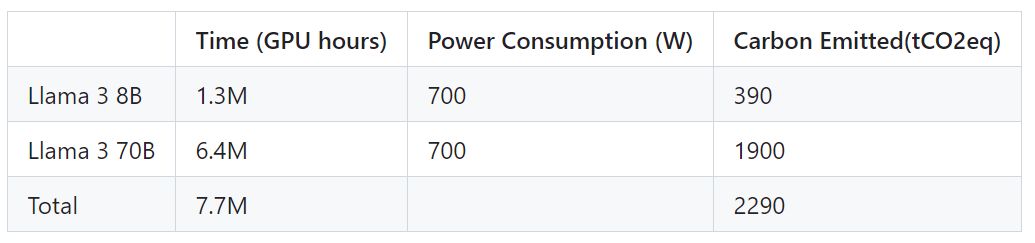

凭借 H100-80GB 硬件的强劲算力,在消耗 700W TDP 的前提下,投入 770 万个 GPU 小时,完成了预训练任务。

Meta 采用三种并行化手法训练出性能强大的 Llama 3 模型,包括:数据并行化,模型并行化,管道并行化。

Meta 利用先进的训练堆栈提升了 AI 模型训练效率。在 16K GPU 上训练时,每个 GPU 的计算利用率最高可达 400 TFLOPS。Llama3 接受了两个定制 24K GPU 集群的训练,实现高正常运行时间。Meta 设计了错误检测和维护自动化流程,并增强了硬件可靠性和静默数据损坏检测。此外,可扩展存储系统减少了检查点和回滚时的开销,提升了训练速度和可靠性。

这些改进使总体有效训练时间超过 95%。

指令微调

Meta采用先进的指令微调技术,优化其预训练模型Llama 3在聊天场景中的性能。该方法结合了监督微调、拒绝采样、近端策略优化和直接策略优化。其中,高品质提示和偏好排序至关重要,确保模型与人类交流保持一致。

借助 PPO 和 DPO 从偏好排序中学习,Llama 3 在推理和编码任务中取得显著提升。即使面对模型难以回答的问题,它也能做出合理的推理推论。这归因于偏好排序训练,它教会模型正确选择答案,即使此前无法识别正确选项。

使用 Llama 3

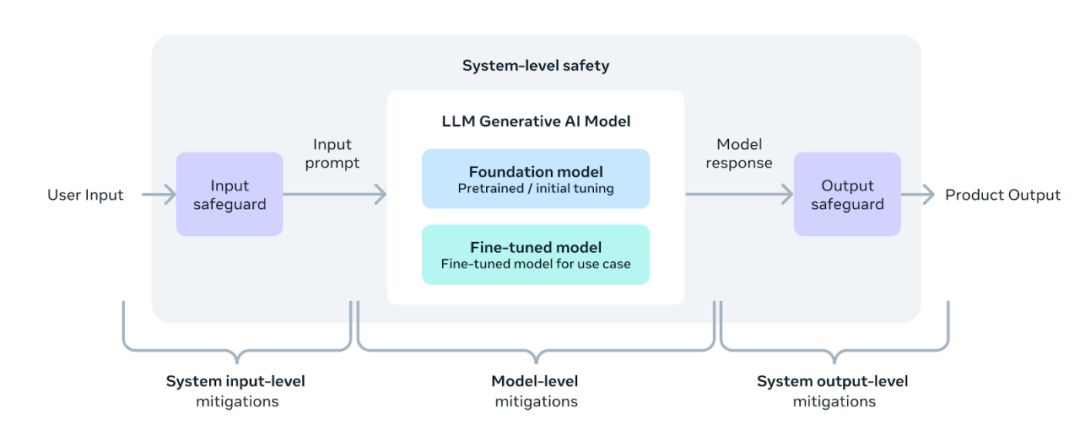

Meta 发布了新的信任与安全工具,提升平台安全。Llama Guard 2 和 Cybersec Eval 2 的增强组件加强了恶意内容检测。此外,Code Shield 作为一道防护,有效过滤有害代码。这些工具共同保护用户免受网络威胁。

借助 torchtune,Meta 开发了 Llama 3,一个强大的语言模型。torchtune 是一个开创性的 PyTorch 原生库,旨在简化 LLM 的创作、微调和实验,让开发人员能够轻松利用 LLM 的强大功能。

使用 torchtune,轻松提升您的 PyTorch 训练!

这款内存高效的训练库采用全 PyTorch 架构,无缝集成于流行平台(如 Hugging Face、Weights & Biases 和 EleutherAI)。此外,Executorch 支持在移动和边缘设备上实现高效推理,释放训练潜力,提升您的 AI 应用。

利用 Meta 的指南,轻松掌握大规模 AI 部署。从快速工程到将 Llama 3 与 LangChain 结合使用,我们提供步骤,帮助您高效地扩展 AI 解决方案。

安全改进

Meta 以系统级方法负责任地部署 Llama,赋能开发者主导开放式语言模型的开发。Llama 作为系统基础,可根据开发者目标定制设计。

指令微调为模型安全性提供了强大保障。Meta 与内部和外部团队合作,对指令微调模型进行了严格的红队评估,确保了它们的安全性。

通过使用 "红队" 方法,我们运用专家知识和自动化技术生成对抗性提示,测试 AI 模型的滥用风险。我们进行广泛的测试,涵盖化学、生物、网络安全等领域。该过程是持续的,确保模型发布后得到安全完善。

Llama Guard 模型旨在为及时响应安全奠定基础,并可根据应用需求轻松微调以创建新的分类标准。作为起点,新版 Llama Guard 2 采用了最近公布的 MLCommons 分类标准。此外,CyberSecEval 2 在其前身的基础上进行了扩展,增加了对 LLM 允许滥用其代码解释器的倾向、攻击性网络安全能力以及对提示注入攻击的易感性的测量。最后,Meta 将推出代码盾(Code Shield),它增加了对 LLM 生成的不安全代码进行推理时过滤的支持。这可以降低不安全代码建议、代码解释器滥用预防和安全命令执行方面的风险。

为了负责任地使用 LLM,Meta 更新了《负责任使用指南》,提供全面的指导。指南要求根据适当的内容指南审查输入输出。此外,云服务提供商提供内容审核 API 和工具,鼓励开发人员使用这些工具进行负责任的部署。

大规模部署 Llama 3

Llama 3 即将在所有主要平台上推出,包括云提供商、模型 API 提供商等。

Tokenizer 提速 15%,提升 token 化效率,同时 GQA 已加入 Llama 3 8B,增强了大型语言模型的能力。

尽管模型参数增加了1B个,但优化后的tokenizer和GQA上的改进协同作用,使该模型的推理效率与Llama 2 7B保持同等水平。

探索 Llama Recipes 开源知识宝库,了解利用 Meta Llama 功能的专家指南。从微调到部署再到模型评估,我们的示例涵盖所有方面,助您释放 AI 的潜力。

下一步是什么?

Llama 3 系列强势开启,引领大型语言模型新时代!首发 8B 和 70B 震撼登场,敬请期待更多惊喜。

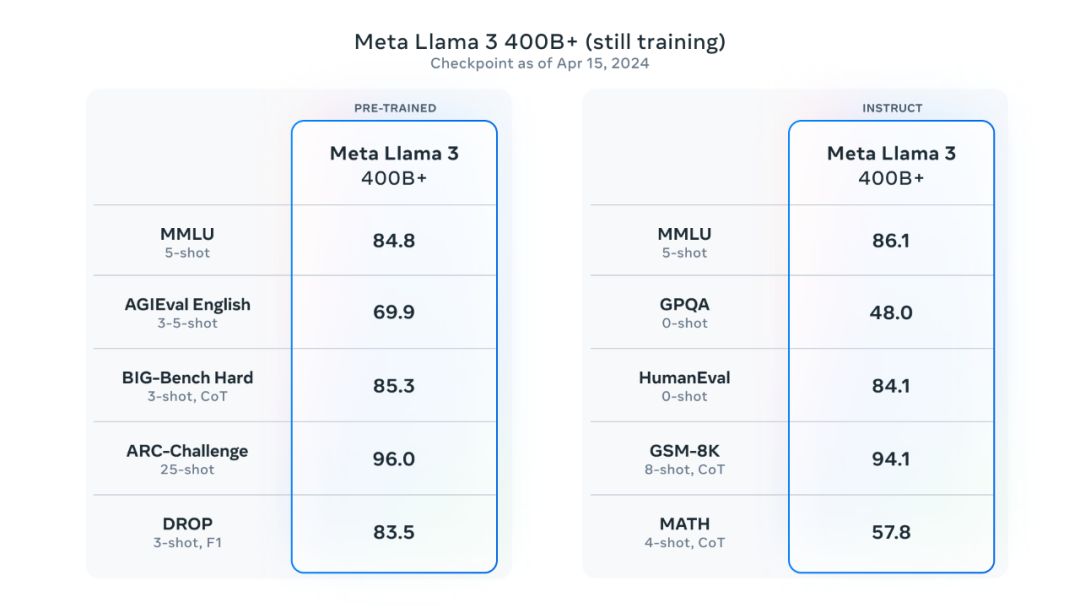

Meta 推出「最大的 Llama 3」语言模型,参数量激增至 400B+。该模型具备多模态和多语言对话能力,上下文窗口更广,整体性能更为强大。随着模型训练的持续推进,Meta 将在未来几个月内陆续发布新功能,提升 AI 语言处理的能力。

一旦完成 Llama 3 的训练,Meta 还将发表一篇详细的研究论文。

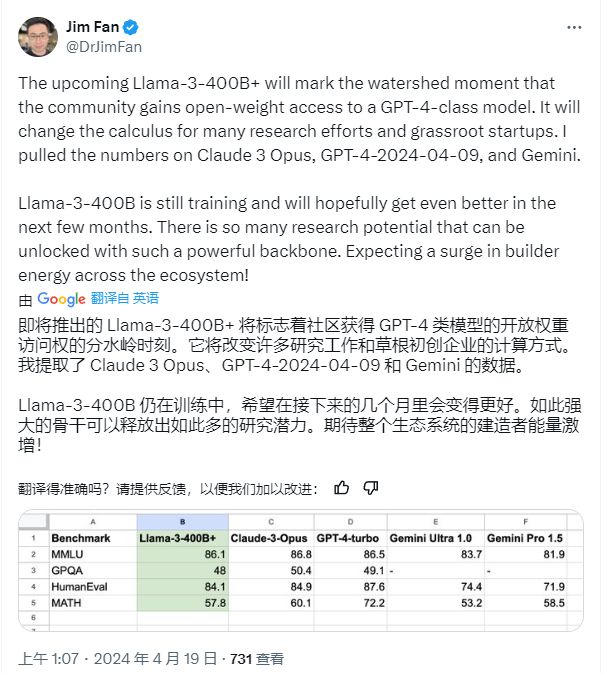

Llama 3 即将发布的 400B+ 版本将带来突破性的增强。它预计将匹敌 GPT-4 的功能,为开源社区提供一个同类领先的大语言模型。

Jim Fan 整理的 Llama3 400B 与 GPT-4 等模型的比分。

也许只有 OpenAI 的 GPT-5 才能压下开源模型了。

-对此,您有什么看法见解?-

-欢迎在评论区留言探讨和分享。-

Meta的Llama3模型,参数量达到400亿,超越GPT-4,凭借强大的性能和多模态能力,集成于Instagram、WhatsApp等应用,并开源供开发者使用。模型的安全性和负责任使用得到强化,MetaAI展示了其在AI领域的领导地位。

Meta的Llama3模型,参数量达到400亿,超越GPT-4,凭借强大的性能和多模态能力,集成于Instagram、WhatsApp等应用,并开源供开发者使用。模型的安全性和负责任使用得到强化,MetaAI展示了其在AI领域的领导地位。

891

891

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?