很早以前就使用crf做过命名实体识别,前一阵子又使用lstm+crf做了命名实体识别这个任务。现在有时间补一个笔记,记一下使用中的一些感受和想法。

1)crf这个算法用来做命名实体识别比较容易达到不错的效果。使用2/3的人民日报的数据(免费的那两个月的数据),不加任何特征,只使用字的信息,F1也可以跑到0.85左右。结果见下图(使用CRF++5.4版本 ,结果在测试集上计算)。

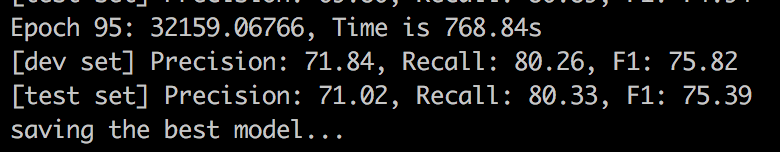

2)lsmt+crf这种方法中,我认为起主要作用的还是crf,lsmt起的作用就是计算crf中的发射矩阵,矩阵中的每个值表示了当前字符有多大的概率是哪个字符,但显然直接依靠这个信息判断会丢失标签的前后文信息,因些还是要加上crf的状态转移层。下图是与上图使用相同数据跑的一个结果,跑了100个epoch,在第95个epoch上取到了最优结果。

3)从以上两个结果可以看出,此对比实验下,lstm+crf没单独使用crf效果好。但此实验显然对lstm+crf不公平,有以下两点原因:

- 使用的数据集偏小,即使我以前只使用crf做命名实体时也不会使用这么小的数据集,因些对于需要大量样本的深度学习而言,样本略少。

- crf的模板是我用了一段时间细心编写的,加入了我好多的人为经验,而lstm我只是跑了这个算法,参数调优都没有去做(crf我也用的默认的)。

4)从实验结果我们看出lstm对于特征抽取还是有一定的效果,在不使用模板的情况下,lstm+crf也能完成命名实体的抽取。这个工作的主要意义在于:有些工作我们是很难发现或总结先验知识的,也就是很难通过人工来编写模板,这时,lstm可以帮助我们自动的抽取特征

5)其实单纯使用crf做中文命名实体识别,多做做特征,F1也能达到0.93,这一值与英文的sota结果差不多,完全能满足大多数的应用要求。所以,如果没有大量资源,不必要追求必须使用深度学习来做ner。

6)对于精益求精的同学,可以试试加入elmo、bert词向量的方式,我使用elmo的词向量跑了一版英文的,F1可以轻易达到0.9。

1707

1707

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?