前言

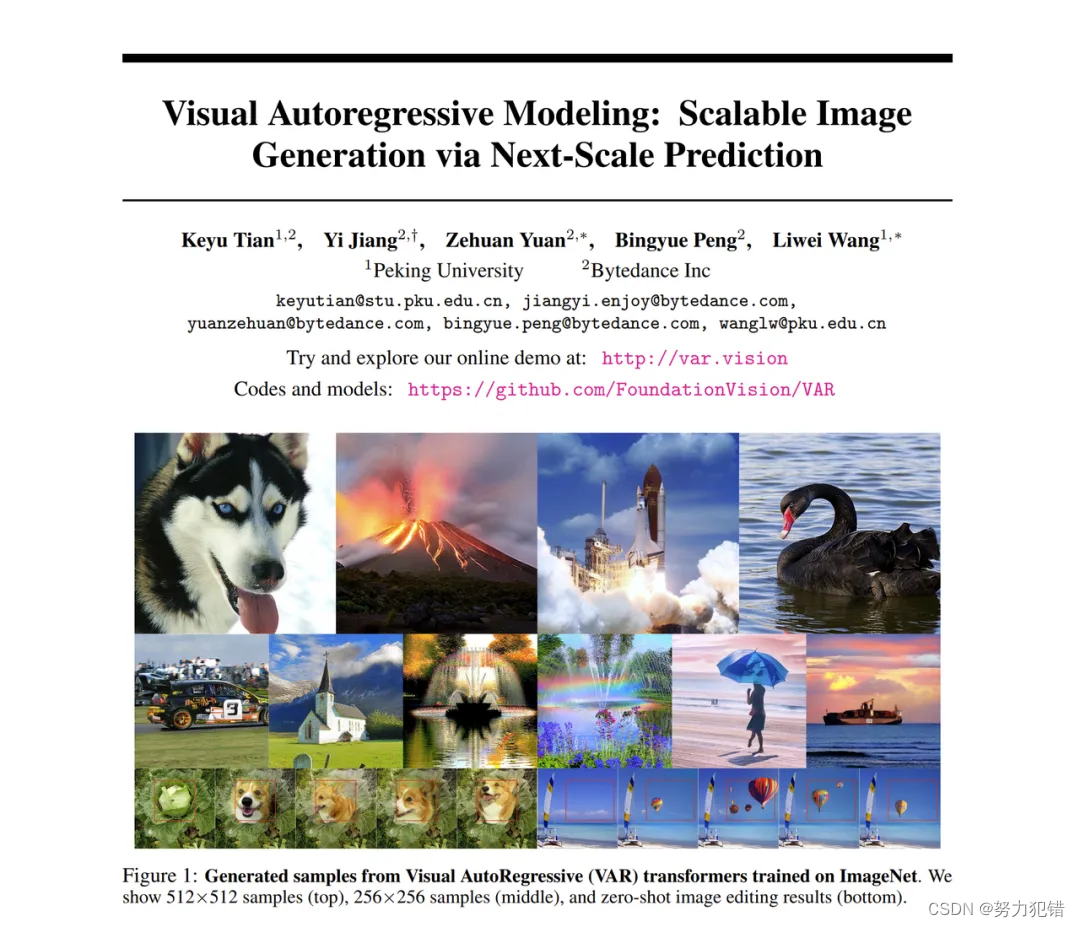

来自北京大学和字节跳动的研究团队,提出了一种名为"Visual AutoRegressive (VAR) Modeling"的全新视觉生成范式。VAR 重新定义了图像的自回归学习过程,从而使得GPT风格的自回归模型首次超越扩散模型,在图像生成质量、速度和可扩展性等多方面都取得了突破性进展。

-

Huggingface模型下载:https://huggingface.co/FoundationVision/var

-

AI快站模型免费加速下载:https://aifasthub.com/models/FoundationVision

VAR核心思想:模仿人类视觉认知

VAR的核心思想源于人类感知和创造图像的逻辑顺序。相比计算机常用的自上而下、逐行扫描的方式,人类更倾向于先把握全局结构,然后逐步深入细节。

VAR正是借鉴了这种由粗到细的多尺度思路,定义图像的自回归顺序为"下一个更高分辨率的token图谱预测",而非传统的"下一个token预测"。具体来说,VAR首先使用多尺度量化自编码器(VQVAE)将图像编码为不同分辨率的离散token图谱,然后训练一个自回归Transformer,从最低分辨率的1x1图谱开始,逐步预测出更高分辨率的token图谱。

这种设计不仅更符合人类直觉,而且在计算效率上也有很大优势:在每个尺度内,to

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?