- 论文链接:Training Diffusion Models with Reinforcement Learning

- 项目地址:Training Diffusion Models with Reinforcement Learning

- 官方代码:https://github.com/kvablack/ddpo-pytorch/tree/main

- trl实现:https://huggingface.co/docs/trl/ddpo_trainer

- 🤗关注公众号 funNLPer 分享有用的算法知识🤗

文章目录

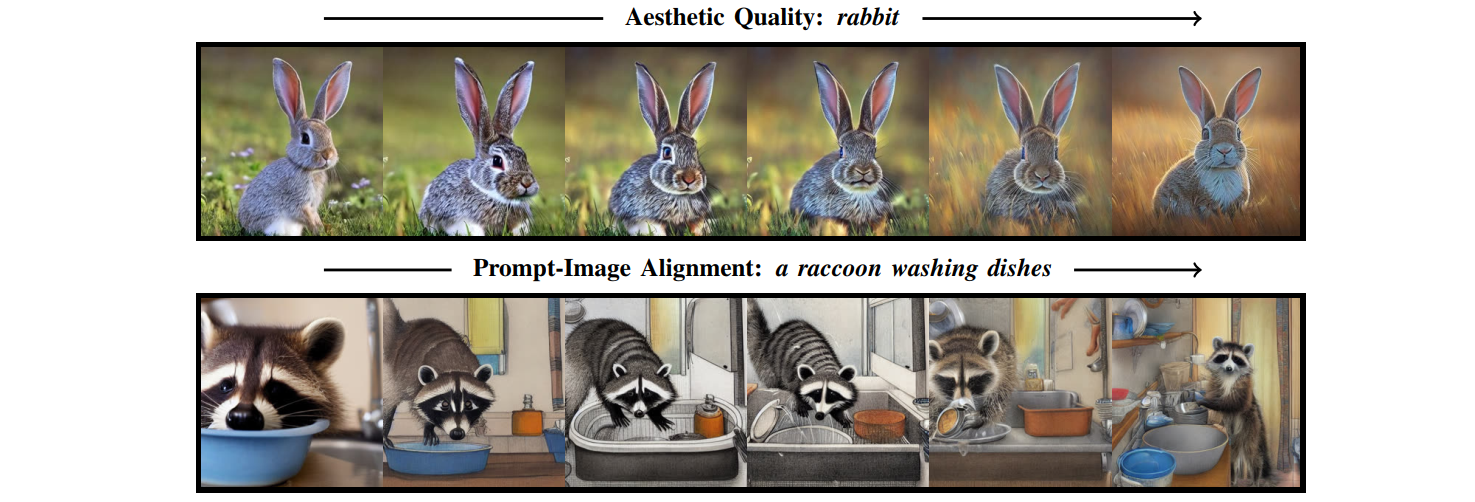

在 InstructGPT 一文中我们介绍了chatGPT的训练过程是先进行大规模数据预训练,然后在到高质量数据上进行微调,最后通过强化学习来进行人类偏好对齐,从结果看来通过RLHF微调后效果提升非常明显。那么同样是生成式模型的文生图模型能否通过RLHF来提高最后的生成质量呢?今天分享这篇论文就是通过强化学习来提升生成图片质量。

1. 概述

扩散模型被广泛的应用在文生图模型中,其训练目标是近似的对数似然目标,然而在很

订阅专栏 解锁全文

订阅专栏 解锁全文

429

429

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?