一、

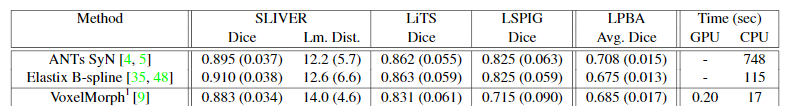

做了实验,发现自己单用decoder(配准)来训练配准参数。效果也不是很提升明显。

lspig

Summary

Dice score: 0.6597795844078064 (0.09940144419670105)

Jacc score: 0.3953123986721039 (0.09658797830343246)

Jacobian determinant: 0.004486850928515196 (0.0003765725123230368)

sliver

Summary

Dice score: 0.7850454139709473 (0.0498911589384079)

Jacc score: 0.60904461145401 (0.06397645175457001)

Jacobian determinant: 0.004748058505356312 (0.0002212399267591536)

lits

Summary

Dice score: 0.7852566909790039 (0.06931383907794952)

Jacc score: 0.5611608028411865 (0.08233566582202911)

Jacobian determinant: 0.0018031677464023232 (0.00016753203817643225)

brain LPBA 只有这一个在数据集能保证单个voxelmorph好。

Summary

Dice score: 0.7241296768188477 (0.06647055596113205)

Jacc score: 0.5717523694038391 (0.08066275715827942)

Jacobian determinant: 0.0016592961037531495 (5.349344064597972e-05)

上次说的用NCC和MSE来作为损失函数。首先NCC是直接训练过程,直接loss直接Nan,这个只能是调参。MSE训练太慢了,跑了四天还没跑完。我要把代码改成多GPU的。

上次借何柱君的账号想用新GPU系统,看能不能把实验速度加快点。发现新系统没用。后面实验可以把正则化损失和相似性损失前的参数系数调整来做实验。

516

516

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?