参考

https://www.youtube.com/watch?v=qO_NLVjD6zE&list=PLZbbT5o_s2xq7LwI2y8_QtvuXZedL6tQU&index=30

notes

包含3个内容:

什么是梯度消失,以及他会导致什么?

梯度消失 会导致 网络 无法更新,因为 梯度太小了,权重每次 变的 很小,几乎等于没变。

梯度消失如何发生的?

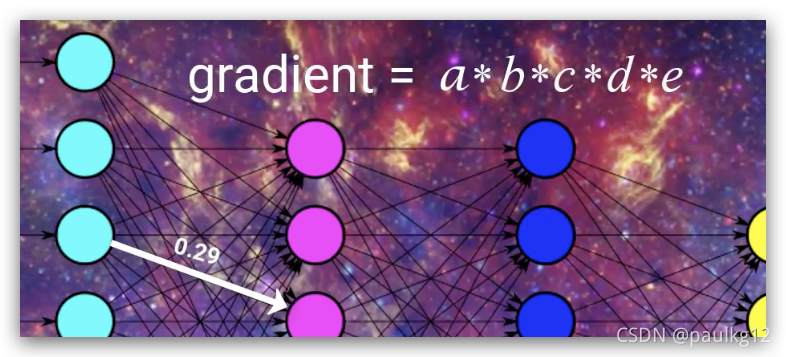

(但凡 a b c d e 里面 ,有 一个 很小, 就会 导致 整个 gradient 很小)

小于 1 的数, 乘起来,只会越来越小。

然后 进行 权重 更新 的时候,

w

e

i

g

h

t

=

w

e

i

g

h

t

+

w

e

i

g

h

t

∗

a

l

p

h

a

∗

g

r

a

d

i

e

n

t

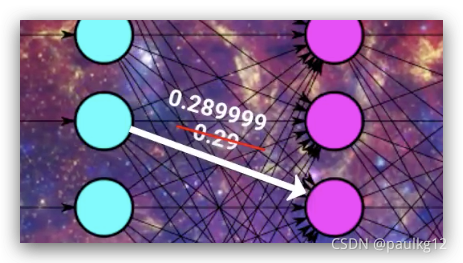

weight = weight + weight * alpha * gradient

weight=weight+weight∗alpha∗gradient

其中

a

l

p

h

a

alpha

alpha 是学习率; 其中

g

r

a

d

i

e

n

t

gradient

gradient 很小 ,就会 导致 weight + 近似 0 的数,以至于 weight 几乎 不变。

weight 就会 困在原地

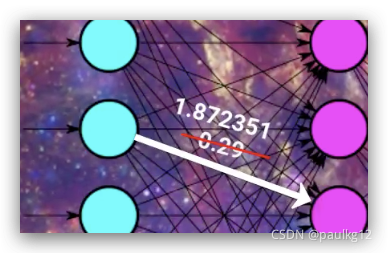

梯度爆炸

如果 乘 了很多 大于一 的数字,就爆炸

4345

4345

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?