这一节,十分建议去看一下老师的讲解,老师从图像处理的角度来引入,层层点透了卷积神经网络中每个部分的原因以及要干的事情。

视频连接:https://www.bilibili.com/video/BV1V54y1B7K3?p=9&spm_id_from=pageDriver p7,p8

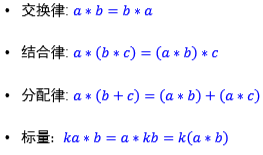

图像处理的基本操作-卷积

老师介绍了图像噪声,以及传统的降噪方式。进行去噪的过程都是卷积,图像处理中的卷积和我们深度学习中常用的卷积不是一个定义,自己需要区别去认识,不要混淆和纠结卷积神经网络中要不要将卷积核翻转。

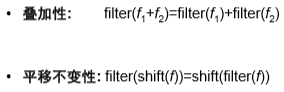

卷积的性质

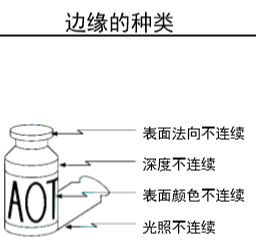

卷积操作产生了边界填充的问题

当我们对原图进行卷积的时候,是对原图进行尺寸减小的过程,所以为了保持原图尺寸(为了后边方便计算处理)所以就产生了边界填充,我们常用的是常数(0)填充。也可以采用拉伸和镜像的方式。

引入高斯卷积

由于平均卷积核会产生振铃的现象所以引入了高斯卷积,就是中心点向外扩散成正态分布,且权值加和为1。

通过该性质的总结,我们可以看出在卷积神经网络中的用叠层的小卷积核换大卷积核或者深度可分离卷积这些Block产生的原因。能够有效的减少卷积的计算量。

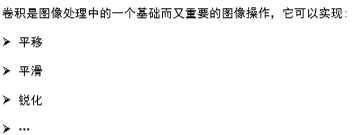

图像去噪

卷积和边缘提取

这里自己没有特别理解,只考虑产生亮度突变的地方就是一种边缘。

边缘检测

通过亮暗变化的地方是灰度函数一阶导发生突变的地方就是边缘,提出了简单的求导方式(因为数值型的求导十分繁琐,就是求导公式)

引入了高斯一阶偏导卷积核

通过设置不同方差的大小,我们可以得出,方差越大,获得边缘就越粗略。

引入了Canny边缘检测

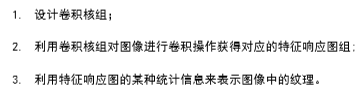

纹理表示—十分贴合卷积神经网络的设计

卷积神经网络

指出全连接的瓶颈,如果使用全连接,那么隐藏层的神经元个数随着图像的尺寸而变大,使得我们的存储变得有压力。

根据上面提到的纹理表示,我们可以利用卷积核将图像表示成相对图像尺寸更小的维度再进行全连接进行下一步的分类。也就是我们图像分类常用的模型结构。

卷积神经网络结构

- 卷积层

- 激活层

- 池化层

卷积层就是为了来提取图像的特征映射。也就是纹理表示的第一步。找到特征基元。

特征响应图尺寸的计算

激活层的作用就是为了增加非线性的计算。

池化层的作用:

1、为了降低特征响应图的尺寸,减少卷积计算量

2、增大感受野。特征响应图变小后,我们的卷积核能观察的东西更广了,也就是之前高斯卷积核中的方差越大,我们就能够提取到更加粗粒度的信息。

3、为了保留主要特性。这个操作和我们Canny边缘检测中的非极大值抑制是一个原理,就是同样的位置,不需要用很多的点去表示,只要主要的就够了。反映在纹理表示中,我们去判断这个一个图像的表示也是根据响应值最大的那个点。

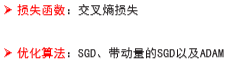

损失函数和优化算法

和全连接神经网络中采用的方法是一样的。

训练过程

数据增强:为原图像增加不同方向,位置,尺寸的不同图像表示,来增加学习的样本数量。

5589

5589

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?