ElasticSearch 中文分词

1. 原生ElasticSearch不支持中文分词

POST _analyze

{

"text": ["南京市长江大桥"]

}

eg: “南京市长江大桥” 直接被分割成 单独的字

2. 使用中文分词器 IK 让ES理解中文

2.1 IK分词器分词机制

2.1.1 去除html标签、特殊字符等

2.1.2 将原始句子分词

2.2.3 转小写、删除语气词、近义词、同义词

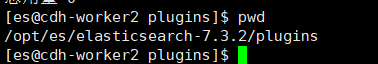

2.3 安装IK到ES === 解压到该目录

2.3.1 测试IK分词器

2.3.1.2 粗粒度分词(简易分词) ik_smart

POST _analyze

{

"text": ["中华人民共和国人民大会堂"],

"analyzer": "ik_smart"

}

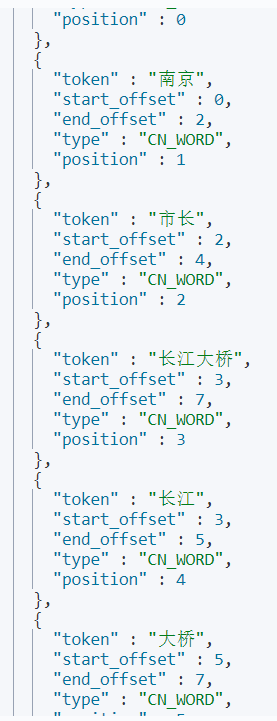

2.3.1.2 细粒度分词(最大化分词) ik_max_word

POST _analyze

{

"text": [

"南京市长江大桥"

],

"analyzer": "ik_max_word"

}

1683

1683

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?