毕业设计:2023-2024年计算机专业毕业设计选题汇总(建议收藏)

毕业设计:2023-2024年最新最全计算机专业毕设选题推荐汇总

🍅感兴趣的可以先收藏起来,点赞、关注不迷路,大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助同学们顺利毕业 。🍅

1、项目介绍

技术栈:

python水文数据分析可视化系统 爬虫+水质水资源实时监测系统 水质监测 预测算法 机器学习 毕业设计

Python语言、Flask框架、MySQL数据库、多元线性回归预测算法、requests爬虫、Echarts可视化、Layui框架、长江水文网

水文数据获取技术与应用分析系统是水文学研究和水资源管理的重要工具和手段,为我们提供了更加便捷、高效和精确的数据处理和分析方式。随着信息技术的不断发展,该系统还有着广泛的应用前景和发展空间,将为水文学研究和水资源管理带来更多的创新和变革。

关键词:水文数据,Flask,Scikit-learn,mysql数据库,可视化

2、项目界面

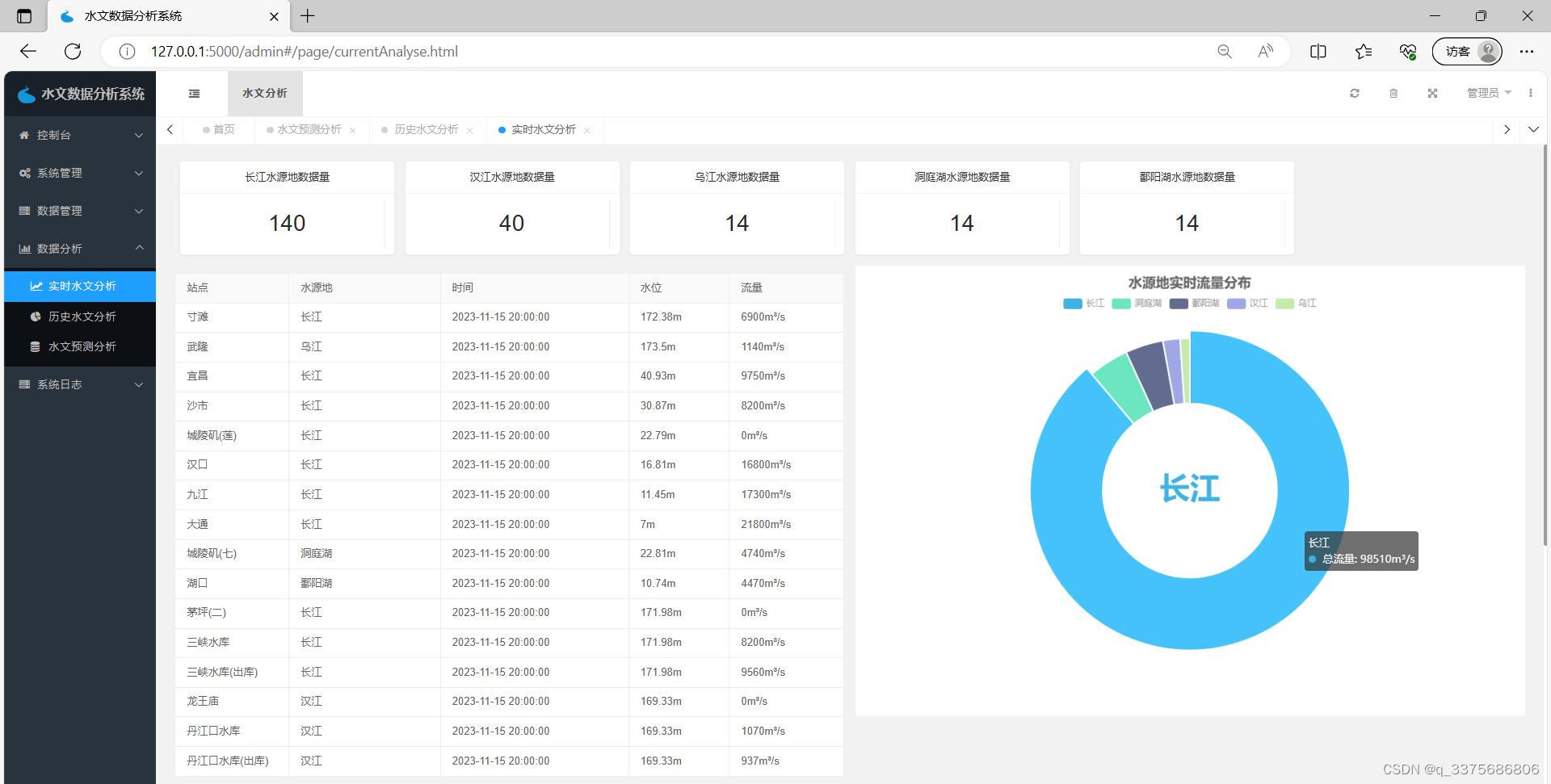

(1)数据概况

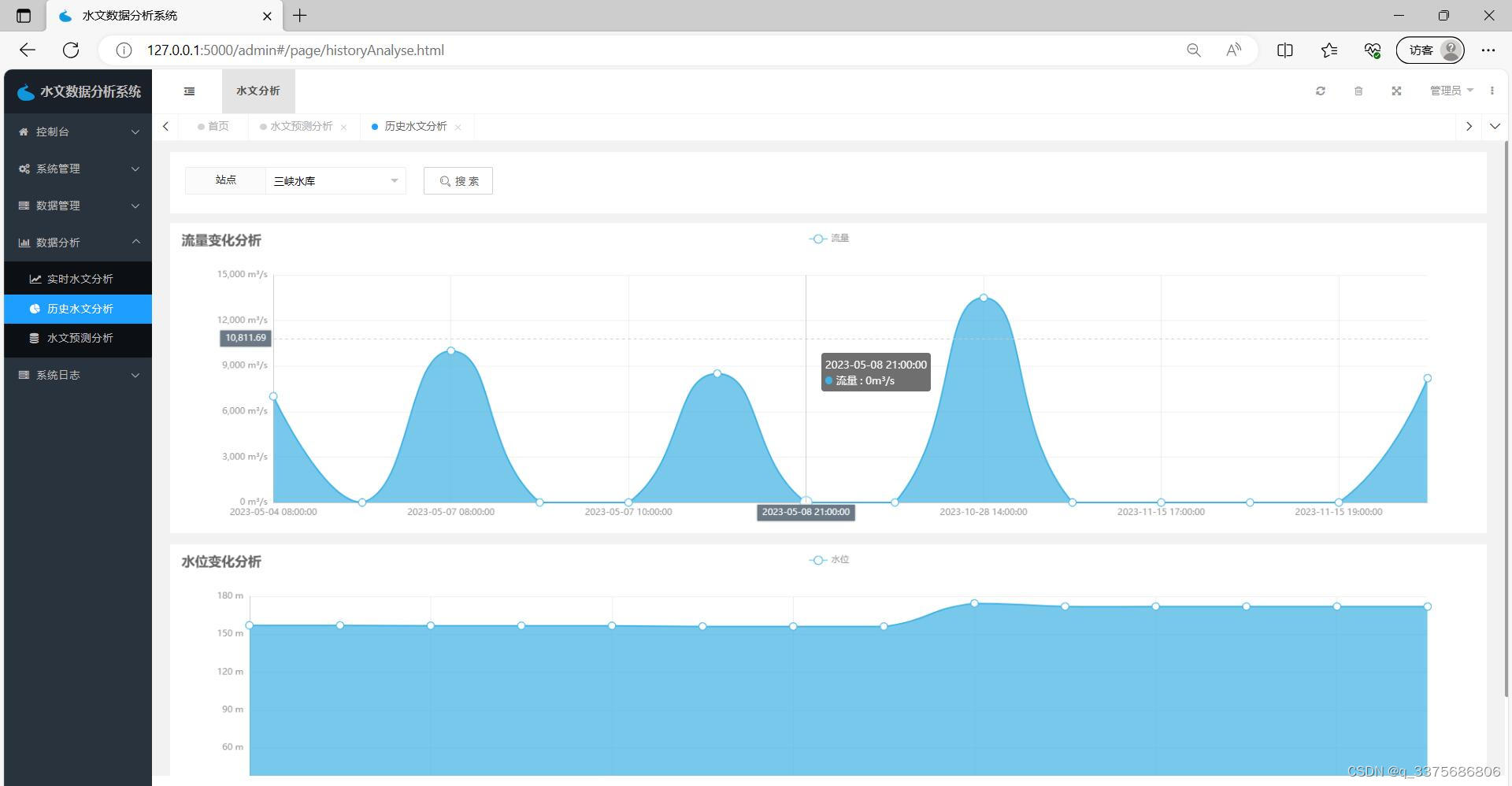

(2)历史水文分析

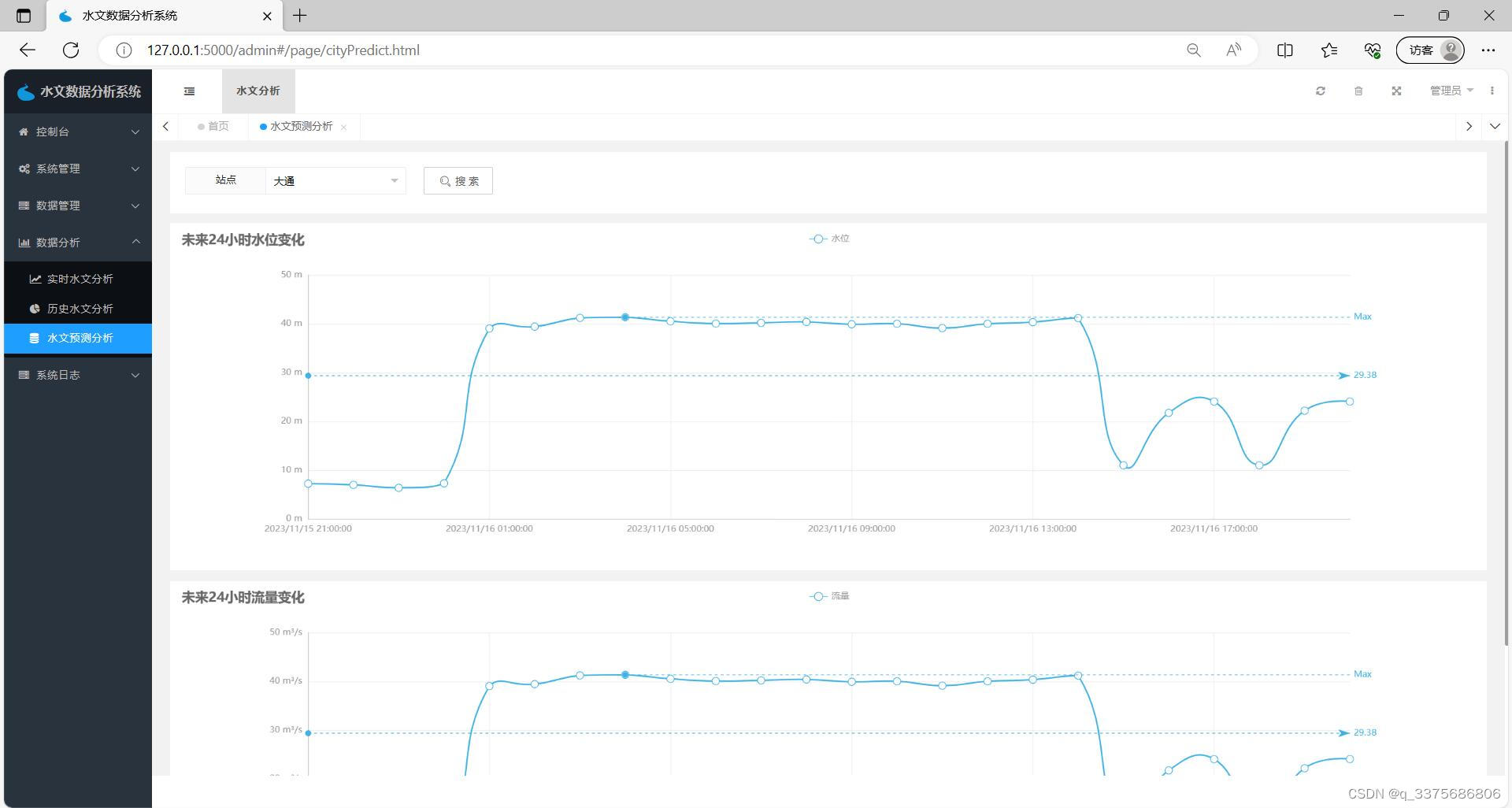

(3)水文预测分析

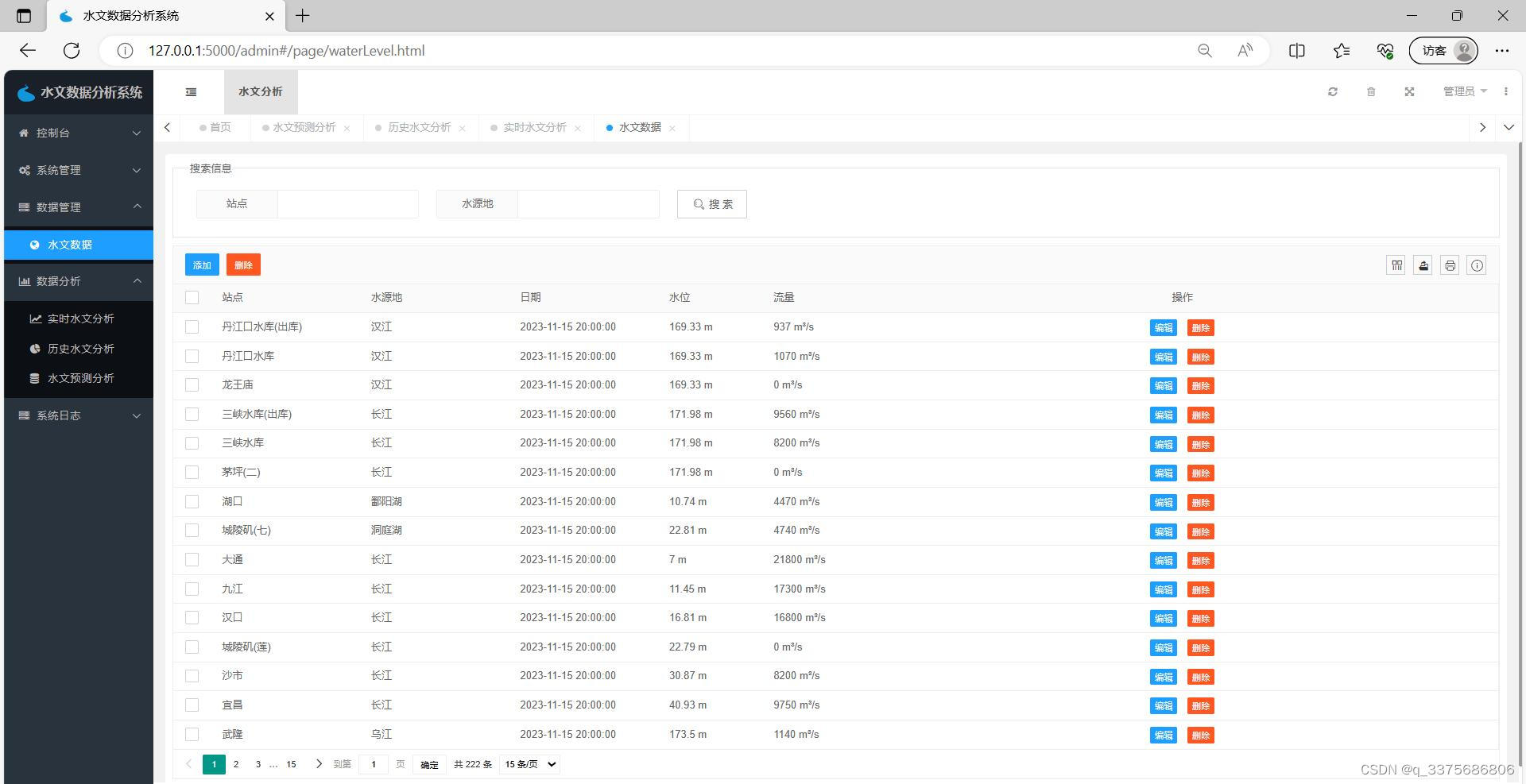

(4)水文数据

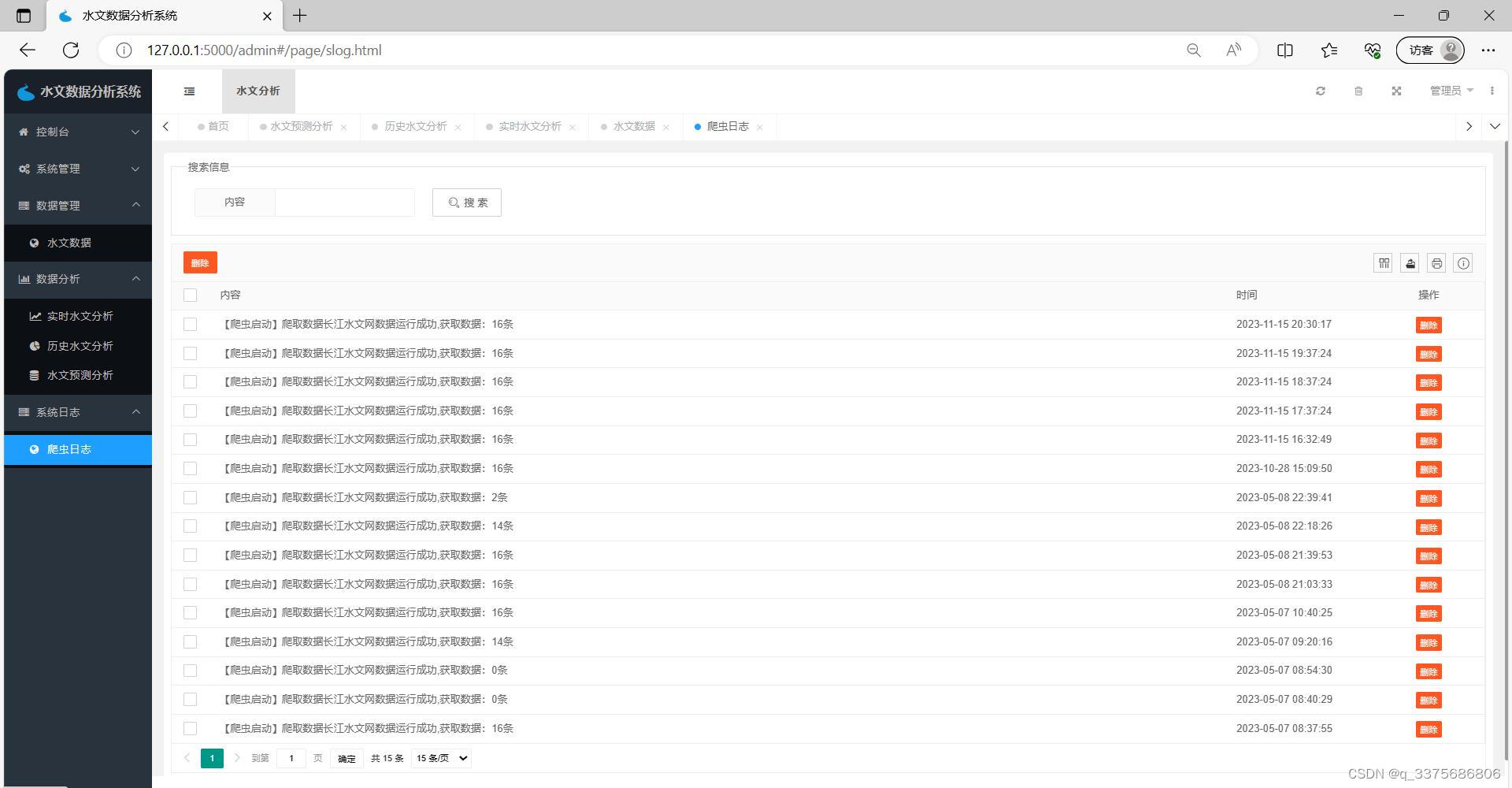

(5)爬虫日志

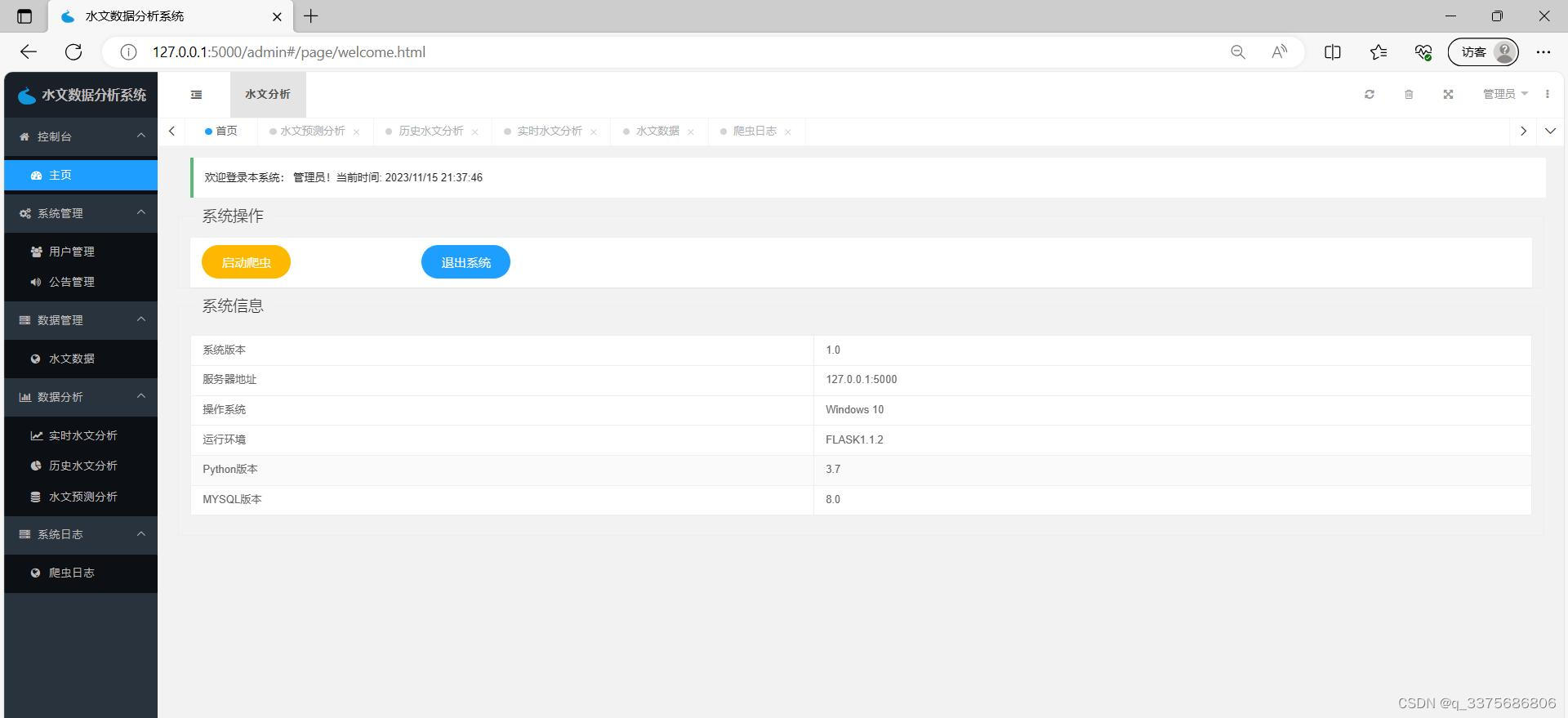

(6)主页

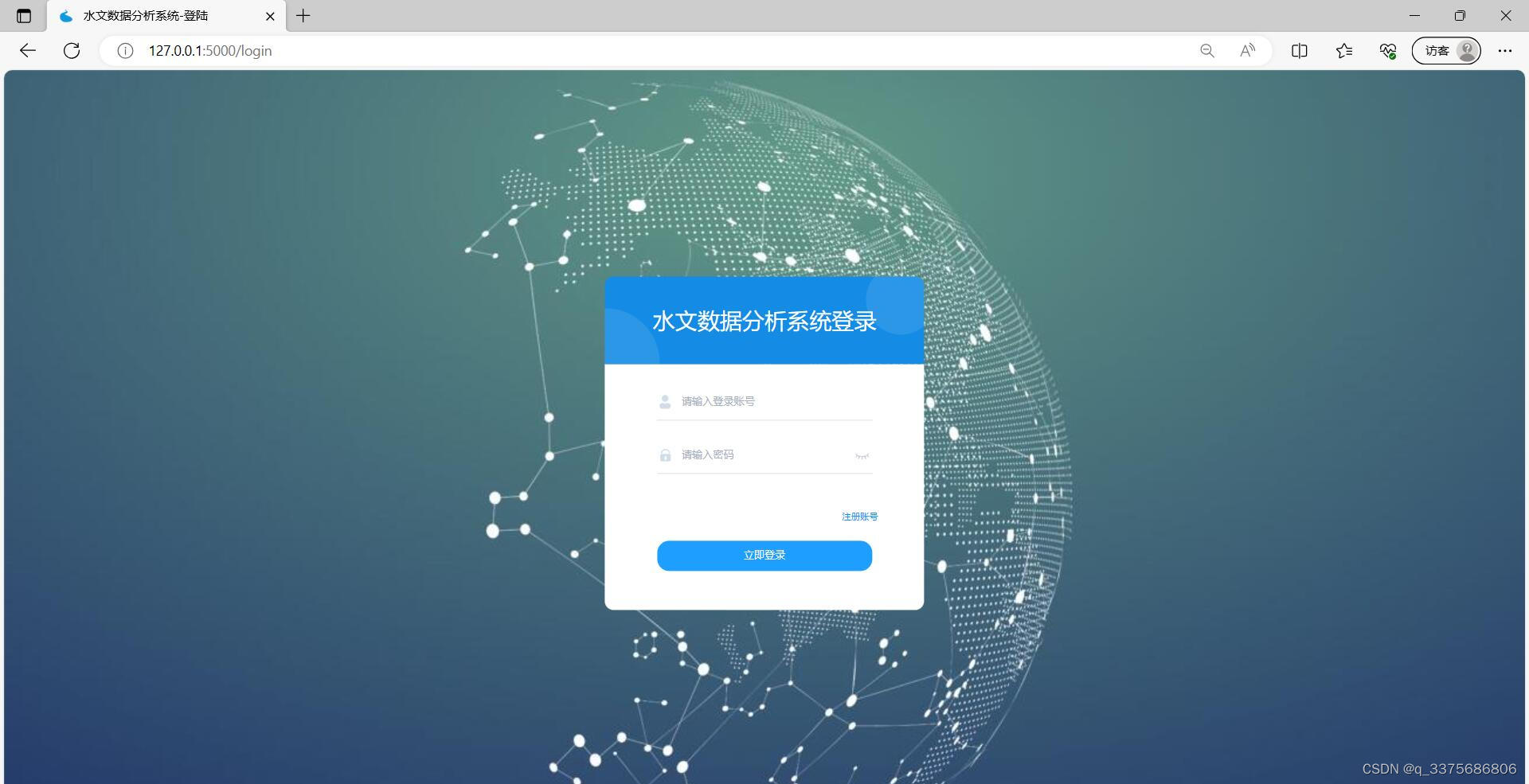

(7)注册登录界面

3、项目说明

随着信息技术的不断发展,水文数据获取和分析成为了现代水文学研究的重要内容。多数据源水文数据获取技术与应用分析系统为我们提供了一种新的水文数据处理和分析方式。该系统利用爬虫技术获取长江水文网的数据,采用 Python 编程语言和 MySQL数据库进行数据处理和管理,同时使用 Echarts 和 Scikit-learn 库进行数据可视化和机器学习预测分析,最终通过 Flask 构建的数据接口服务层将数据和分析结果提供给其他应用程序调用和使用。

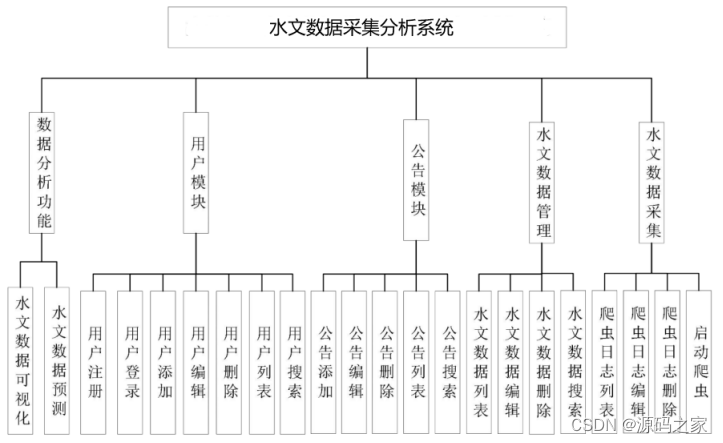

该系统的主要模块包括用户登陆注册模块、水文数据管理模块、水文数据可视化模块、水文数据预测模块以及公告模块。这些模块可以为用户提供完整的水文数据管理和使用服务,包括数据的查询、添加、修改和删除等操作,数据的可视化和分析,以及基于历史数据建立预测模型,预测未来水文情况等。

该系统的实现为水文学研究和水资源管理提供了新的途径和思路。通过该系统,可以更加方便地获取和分析水文数据,为水文学研究和水资源管理提供更加精确的数据支持和决策依据。同时,该系统的可扩展性和可维护性也为未来的需求和变化提供了更好的适应性。

总之,多数据源水文数据获取技术与应用分析系统是水文学研究和水资源管理的重要工具和手段,为我们提供了更加便捷、高效和精确的数据处理和分析方式。随着信息技术的不断发展,该系统还有着广泛的应用前景和发展空间,将为水文学研究和水资源管理带来更多的创新和变革。

关键词:水文数据,Flask,Scikit-learn,mysql数据库,可视化

4、核心代码

from flask import Flask as _Flask, redirect

from flask import request, session

from flask import render_template

from flask.json import JSONEncoder as _JSONEncoder

import decimal

import os

from flask_apscheduler import APScheduler

from service import user_service, spider_service, notice_service, slog_service, data_service, \

predict_service, water_level_service

from utils.JsonUtils import read_json

import datetime

from utils.Result import Result

base = os.path.dirname(__file__)

directory_path = os.path.dirname(__file__)

json_path = directory_path + '/static/api/'

class JSONEncoder(_JSONEncoder):

def default(self, o):

if isinstance(o, decimal.Decimal):

return float(o)

if isinstance(o, datetime.datetime):

return o.strftime("%Y-%m-%d %H:%M:%S")

if isinstance(o, datetime.date):

return o.strftime("%Y-%m-%d")

super(_JSONEncoder, self).default(o)

class Flask(_Flask):

json_encoder = JSONEncoder

import os

app = Flask(__name__)

app.config['SESSION_TYPE'] = 'filesystem'

app.config['SECRET_KEY'] = os.urandom(24)

app.config['PERMANENT_SESSION_LIFETIME'] = datetime.timedelta(days=1)

# 批量删除水文接口

@app.route('/del/water/level', methods=['post'])

def del_water_level_list():

ids = request.args.get('ids')

result = water_level_service.del_water_level_list(ids)

return result.get()

# 水文数据分页

@app.route('/list/water/level', methods=['get'])

def water_level_list():

page = request.args.get('page')

limit = request.args.get('limit')

where = request.args.get('searchParams')

result = water_level_service.select_water_level_list(page, limit, where)

return result.get()

# ----------------------------------------------水文相关模块结束----------------------------------------------

# ----------------------------------------------用户相关模块开始----------------------------------------------

# 用户数据分页

@app.route('/page/user/add', methods=['get'])

def page_user_add():

return render_template("page/user/add.html")

@app.route('/add/user', methods=['post'])

def add_user():

form = request.form.to_dict()

result = user_service.insert_user(form)

return result.get()

# 用户修改密码

@app.route('/user/reset/password', methods=['post'])

def reset_password_user():

form = request.form.to_dict() # 获取值

result = user_service.reset_password(form['old_password'], form['new_password'], form['again_password'])

return result.get()

# 用户编辑页面

@app.route('/page/user/edit', methods=['get'])

def page_user_edit():

id = request.args.get('id')

user = user_service.get_user(id)

return render_template("page/user/edit.html", user=user)

# 编辑用户接口

@app.route('/edit/user', methods=['post'])

def edit_user():

form = request.form.to_dict()

result = user_service.edit_user(form)

return result.get()

# 历史水文数据分析

@app.route('/data/history/water', methods=['post', 'get'])

def data_history():

site = request.args.get('site')

flow_data = data_service.flow_data(site)

level_data = data_service.level_data(site)

return {"flow_data": flow_data, "level_data": level_data}

# 实时数据分析

@app.route('/data/current/water', methods=['post', 'get'])

def data_current_water():

return data_service.top_page_data()

# 水文数据预测

@app.route('/data/water/predict', methods=['post', 'get'])

def data_predict():

site = request.args.get('site')

return predict_service.predict(site)

# ----------------------------------------------分析相关模块结束----------------------------------------------

# ----------------------------------------------爬虫相关模块开始----------------------------------------------

from concurrent.futures import ThreadPoolExecutor

# 爬虫自动运行

def job_function():

print("爬虫任务执行开始!")

executor = ThreadPoolExecutor(2)

executor.submit(spider_service.main_spider())

def task():

scheduler = APScheduler()

scheduler.init_app(app)

# 定时任务,每隔600s执行1次

scheduler.add_job(func=job_function, trigger='interval', seconds=3600, id='my_cloud_spider_id')

scheduler.start()

# 后台调用爬虫

@app.route('/spider/start', methods=["POST"])

def run_spider():

executor = ThreadPoolExecutor(2)

executor.submit(spider_service.main_spider())

return Result(True, '指令已发送,静默爬取中,请稍后查看爬虫日志,查看运行情况').get()

# 写在main里面,IIS不会运行

task()

# run_spider()#启动项目就运行一次爬虫

# ----------------------------------------------爬虫相关模块结束----------------------------------------------

if __name__ == '__main__':

# 端口号设置

app.run(host="127.0.0.1", port=5000)

5、源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,查看我的【用户名】、【专栏名称】、【顶部选题链接】就可以找到我啦🍅

感兴趣的可以先收藏起来,点赞、关注不迷路,下方查看👇🏻获取联系方式👇🏻

4892

4892

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?