深度学习week4

HybridSN 高光谱分类

根据论文给出的结构使用pytorch构建神经网络。

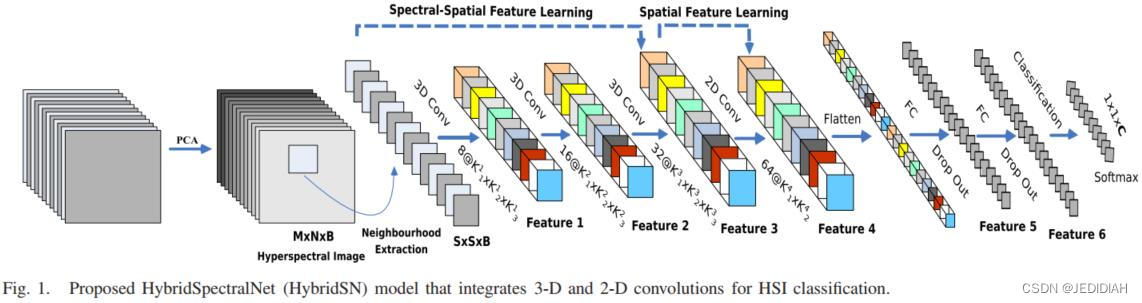

其网络结构如下:

- 三维卷积部分:

conv1:(1, 30, 25, 25), 8个 7x3x3 的卷积核 =>(8, 24, 23, 23)

conv2:(8, 24, 23, 23), 16个 5x3x3 的卷积核 =>(16, 20, 21, 21)

conv3:(16, 20, 21, 21),32个 3x3x3 的卷积核 =>(32, 18, 19, 19) - 二维卷积

把前面的 32*18 reshape 一下,得到 (576, 19, 19)

二维卷积:(576, 19, 19) 64个 3x3 的卷积核,得到 (64, 17, 17) - 全连接层

flatten 操作,变为 18496 维的向量

全连接层依次为256,128节点,都使用比例为0.4的 Dropout - 最后一个全连接层进行输出,输出为 16 个节点,是最终的分类类别数

class_num = 16

# rate = 16

class HybridSN(nn.Module):

def __init__(self):

super(HybridSN, self).__init__()

# 三个3d卷积层

self.conv1 = nn.Conv3d(in_channels=1, out_channels=8, kernel_size=(7, 3, 3))

self.conv2 = nn.Conv3d(in_channels=8, out_channels=16, kernel_size=(5, 3, 3))

self.conv3 = nn.Conv3d(in_channels=16, out_channels=32, kernel_size=(3, 3, 3))

# 一个2d卷积层

self.conv4 = nn.Conv2d(576, 64, kernel_size=(3, 3))

# 三个全连接层

self.fc1 = nn.Linear(18496, 256)

self.fc2 = nn.Linear(256, 128)

self.fc3 = nn.Linear(128, class_num)

# dropout,比例为0.4

self.drop = nn.Dropout(p = 0.4, training = self.training)

def forward(self, x):

x = F.relu(self.conv1(x))

x = F.relu(self.conv2(x))

x = F.relu(self.conv3(x))

x = x.view(-1, 576, 19, 19)

x = F.relu(self.conv4(x))

x = x.view(x.size(0), -1)

x = F.relu(self.fc1(x))

x = self.drop(x)

x = F.relu(self.fc2(x))

x = self.drop(x)

x = self.fc3(x)

return x

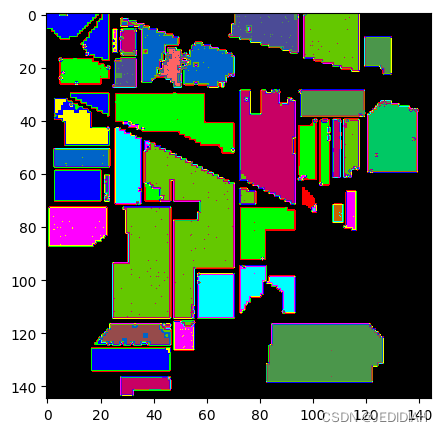

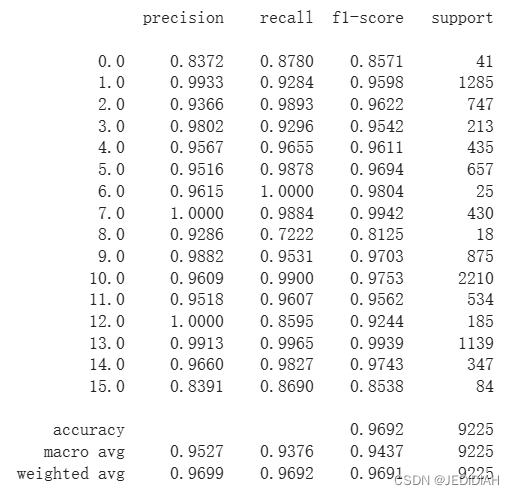

训练后,模型预测结果如下图所示。

问题思考

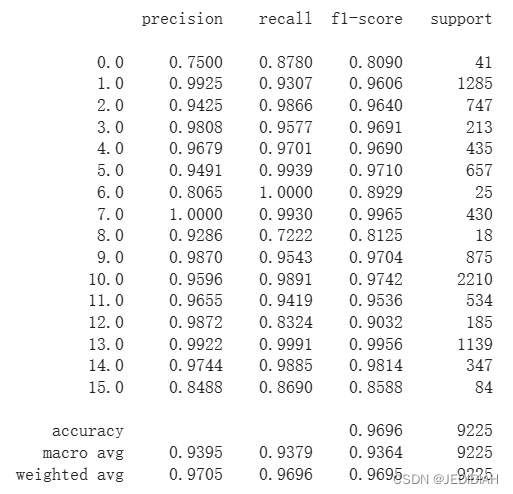

- 训练HybridSN,然后多测试几次,会发现每次分类的结果都不一样,请思考为什么?

每次预测的结果会有不同,如下图所示。

dropout会导致每次运行的时候全连接层激活的神经元不同,导致结果有区别。

正确的写法为:

x = F.dropout(x, p = 0.4, training = self.training)

这样只会在训练的时候开启dropout。

-

如果想要进一步提升高光谱图像的分类性能,可以如何改进?

进行数据增强,构造更深的网络,使用残差网络。 -

depth-wise conv 和 分组卷积有什么区别与联系?

分组卷积是将输入层的不同特征图进行分组,然后采用不同的卷积核再对各个组进行卷积,这样会降低卷积的计算量。

当分组卷积的分组数量等于输入map数量,输出map数量也等于输入map数量时就成了Depth-wise Convolution。 -

SENet 的注意力是不是可以加在空间位置上?

空间注意力机制一般采用将不同通道的注意力相加的策略。 -

在 ShuffleNet 中,通道的 shuffle 如何用代码实现?

shuffle操作即将通道的顺序打乱,使用transpose可以实现。

# 以下操作为将torch的第a个通道和第b个通道交换

x = torch.transpose(x, a, b)

9124

9124

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?