欢迎大家点赞、收藏、关注、评论啦 ,由于篇幅有限,只展示了部分核心代码。

一项目简介

一、项目背景与目标

随着人工智能技术的快速发展,手写数字识别技术已经广泛应用于各个领域,如金融、教育、医疗等。为了提高手写数字识别的准确性和效率,本项目采用深度学习技术,特别是Pytorch深度学习框架,结合PyQt5构建图形用户界面(GUI),并使用VGG(Visual Geometry Group)神经网络模型,实现一个高效、准确的手写数字识别系统。

二、系统组成

Pytorch深度学习框架:Pytorch是一个开源的深度学习框架,具有简单易用、灵活高效的特点。本项目使用Pytorch来构建和训练VGG神经网络模型,以实现手写数字识别功能。

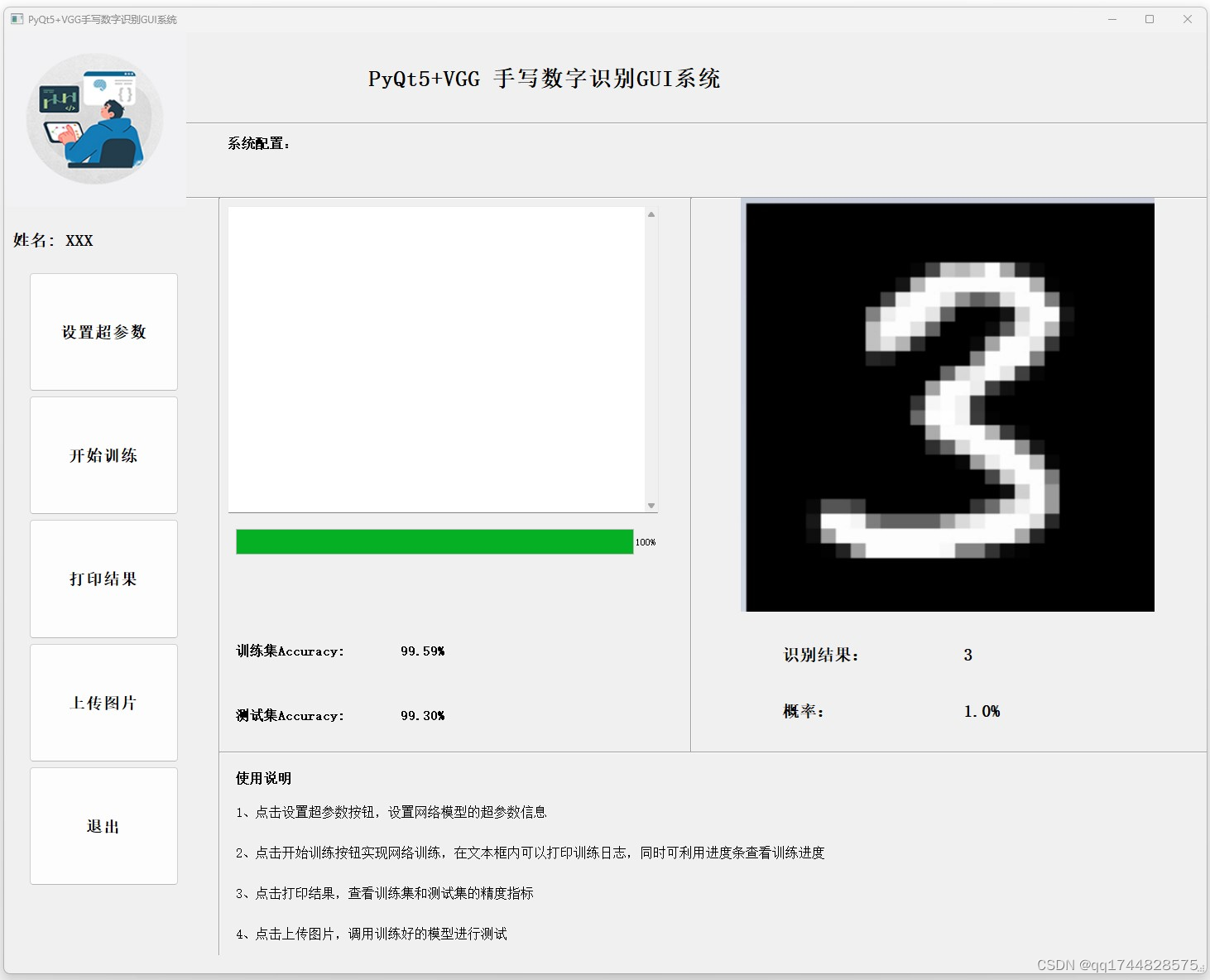

PyQt5 GUI框架:PyQt5是一个跨平台的GUI框架,用于开发具有图形用户界面的应用程序。本项目使用PyQt5构建手写数字识别系统的用户界面,提供用户输入和结果显示的功能。

VGG神经网络模型:VGG是一种深度卷积神经网络模型,具有强大的特征提取和分类能力。本项目使用VGG模型作为基础架构,通过训练和优化,使其能够准确识别手写数字。

三、技术实现

数据集准备:本项目采用MNIST手写数字数据集作为训练数据。MNIST数据集包含大量的手写数字图像和对应的标签,适用于手写数字识别任务。

模型训练:使用Pytorch框架加载MNIST数据集,并构建VGG神经网络模型。通过多次迭代训练,调整模型参数,使模型能够准确识别手写数字。

GUI开发:使用PyQt5框架开发图形用户界面,包括输入区、显示区和按钮等控件。用户可以通过输入区上传手写数字图像,系统将通过VGG模型进行识别,并将结果显示在显示区。

四、项目特点

高效性:VGG神经网络模型具有强大的特征提取和分类能力,能够在短时间内完成手写数字识别任务。

准确性:通过大量数据的训练和优化,模型能够准确识别手写数字,并具有较高的识别准确率。

用户友好性:使用PyQt5框架开发的图形用户界面,操作简单直观,方便用户上传图像和查看结果。

二、功能

深度学习之基于Pytorch+PyQt5+VGG手写数字识别系统

三、系统

四. 总结

本项目的手写数字识别系统可以应用于各种需要手写数字识别的场景,如银行自动柜员机、教育考试系统、医疗诊断系统等。通过该系统,可以大大提高手写数字识别的准确性和效率,为各个领域的工作带来便利。

本项目通过结合Pytorch深度学习框架、PyQt5 GUI框架和VGG神经网络模型,成功构建了一个高效、准确的手写数字识别系统。该系统不仅具有较高的识别准确率,而且操作简单直观,易于用户使用。未来,我们将继续优化和改进该系统,探索更多的应用场景和技术创新点,为手写数字识别技术的发展做出更大的贡献。

699

699

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?