spark是一种计算框架,如果只是想学习,完全可以脱离hadoop而独立运行,当然这样就没法使用hdfs进行数据存储。

windows环境下,使用java语言添加spark依赖包就可以直接使用spark了。

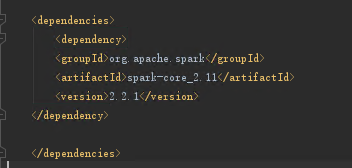

一、maven添加spark依赖:

这个jar包还是挺大的,下载需要点时间。

二、随便写个map操作

import org.apache.commons.lang3.StringUtils;

import org.apache.spark.SparkConf;

import org.apache.spark.api.java.JavaRDD;

import org.apache.spark.api.java.JavaSparkContext;

import java.util.Arrays;

public class TestMainQF {

public static void main(String [] args){

System.out.println("hello word");

TestMainQF test = new TestMainQF();

test.test();

}

private void test() {

SparkConf conf = new SparkConf().setMaster("local").setAppName("TestQF");

JavaSparkContext sc = new JavaSparkContext(conf);

JavaRDD&

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

364

364

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?