偶尔看到了这篇文章,感觉作者写的很容易理解,对于初步认识CNN有很大的帮助,若想查看原文,请点击此处。

关于神经网络的学习方法,总结起来的要点有以下几点:

- BP算法

- 激励函数

- 正则化与交叉验证等其他防止过拟合的方法

BP神经网络在之前的工作中取到了不错的效果,但是在Micheal Nilson的数的第五章,描述了之前的神经网络在增加多个隐含层之后训练效果会大大下降,也就是说,对于层数过多的网络训练效果不理想,如何训练深层的神经网络成了一个问题,这就是深度学习的由来。

深度学习近些年来很火,尤其是在自然语言处理领域,其取得的成就也是巨大的。之前我对深度学习是有畏惧心理的,因为我觉得挺难的,后来慢慢接触,发现这个也是一个循序渐进的过程,还是要有信心。

深度学习一个最广泛的应用就是卷积神经网络(deep convolutional neural networks),也就是CNN。这篇文章就简要说一下CNN模型的基本模型。

1. Introduction of Convolutional Networks

还是以之前的手写数字识别为基本,阐述CNN。

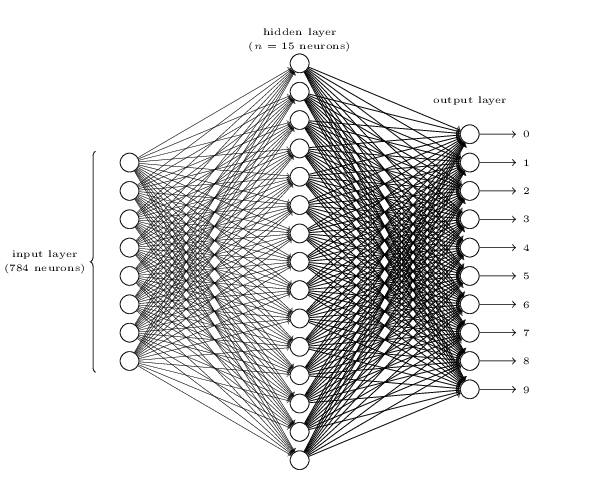

首先从之前的BP神经网络慢慢过渡到CNN,回顾之前的手写识别问题,我们识别一副28*28的手写图片,我们将图片转换成像素,然后手写黑色点得像素点标注为1,其他空白的像素标注为0,因此形成了28*28个BP神经网络输入层,然后我们设计了一个30个神经元的中间层,以及最后的10个神经元的输入层,其典型结构如下:

但是当我们想在这个模型上加了隐藏层层数的时候,其训练结果就出现了很大的不稳定,在加入多个隐藏层之后需要学习的参数变得很多,这一方面增加了训练的难度,也增加了训练的不稳定性,在传统的神经网络模型中,难以对深层的网络进行训练,这就形成了一个瓶颈。因此需要一些新的模型,CNN就是这样的新的模型。卷积神经网络的基本思想有以下三点:

- Local Receptive Fields (局部视野)

- Shared Weights(权值共享)

- Pooling Layer(池化层)

2. Local Receptive Fields

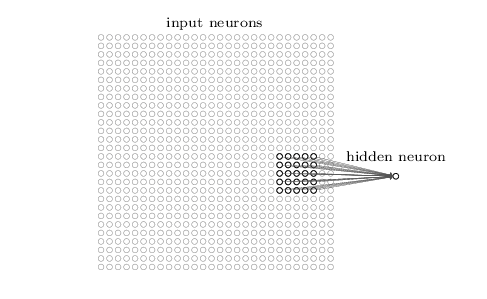

在之前介绍的神经网络中,每个层的神经元总是与前面一层的所有神经元相连,也就是全相连,回想之前的BP神经网络,在隐藏层的神经元每个都和输入层的28*28个直接相连,也就是说每个盛景园需要训练 28*28+1个参数,但是在CNN中,隐藏层的神经元并不一定会和之前的所有神经元相连,以手写数字识别为例,每个隐藏层的神经元都会和输入层的部分神经元相连,如下图:

已上图为例,隐藏层的神经元与输入层的5*5个神经元相连,而这个5*5的区域就称之为Local Receptive Fields,在上图的隐藏层神经元中,需要训练5*5+1个参数,也就是5*5个与上面映射区域的权重因子和一个偏移量bias。然后我们将上图的5*5大小的窗口从上图的左上角,按照从左到右,从上到下的规则逐渐移动到右下角,每次移动一个像素点(这个是举例,实际上可以改变这个值),因此我们可以得到如下的图:

如上图所示的移动方法,我们可以很顺利的推出,隐藏层的结果是24*24个神经元(按照窗口移动法则)

明白了这点,我们就可以来了解shared weights and biases概念了。

3. Shared Weights and Biases

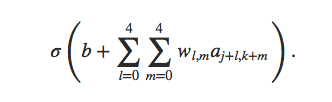

前面说到过,在隐藏层的每个神经元都是有5*5+1个参数,也就是25个权重w和一个偏移量b,但是之前没有提到的是,在这个隐藏层中,所有的神经元的参数的值都是一样的,也就是说,对于隐藏层的所有神经元,其输出都是满足下面的条件:

只不过,每个神经元对应的映射区域不一样,也就是说上式的a值不同而已。注意上面式子的大括号左边表示的是激励函数,比如我们前面用到过的sigmoid函数。

为什么这样设计是有意义的,可以用一个简单的比喻说明:一个猫的图片的其中一个部分和其他的部分都是猫的一部分,也就是说都是猫的特征,因此这两个部分的特征值(w,b)设置成一样的。也是这样,有时候,我们将从输入层到隐藏层的映射称之为 feature map(特征映射)。shared weights 和bias经常被说成是 内核(kernel)或者过滤器(filter)。

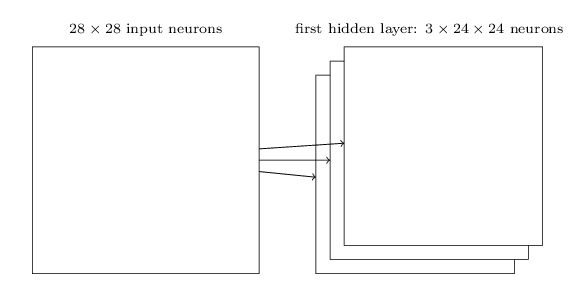

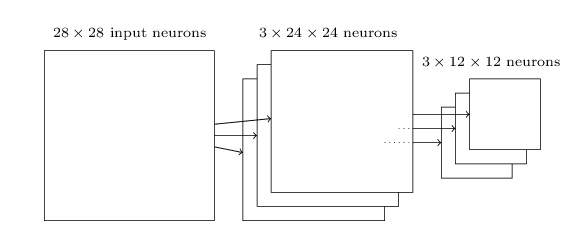

实际应用中,我们可能会不只一个feature map,可能会有多个,如下图所示:

上图就展示了从输入层到隐藏层的三个feature map,每个map都有5*5+1个的训练特征,注意每一个map上的神经元的w和b是一样的,但是不同的map之间则不一定(一般不一样)。

4. Pooling Layer

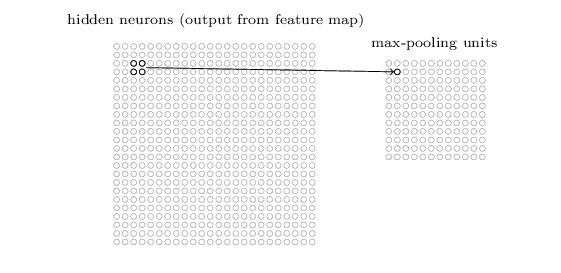

Pooling Layer一般在卷基层后面(卷基层对应上面的隐藏层),该层的目的是为了简化卷基层的训练输出数据。形象的说,pooling layer就是将卷基层进行压缩一下,举个例子,pooling layer的一个神经元可以对应卷积层的2*2区域的概括,具体的说,以最常用max pooling为例,在max pooling中,pooling层的每一个神经元的值对应卷积层的2*2的区域的最大输出值,如下图所示:

在24*24的卷积层压缩之后,在pooling就只有12*12大小了。上文说过,卷积层的个数可能不止一个,因此一般会有下面的结构:

当然不止是max pooling一种技术用在了pooling layer,比如还有一种叫 L2 pooling的技术:其方法是取卷积层2*2区域输出值的和值的开根号值,诸如此类。需要说明的是一直说的2*2区域只是为了描述随便选的,并不是一定是2*2区域。

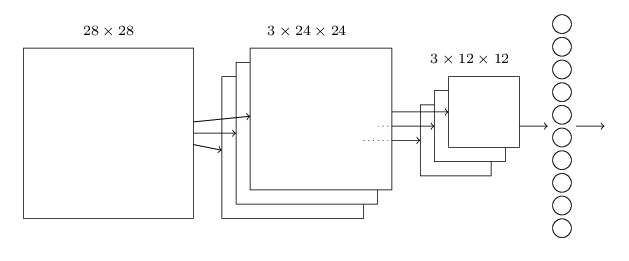

好了,现在可以将上面的所有元素组成一个整体了.我们可以使用下面的CNN网络模型:

得到了模型,我们还是可以按照之前的梯度下降方法来求参数值,会在后面的学习中跟进这个部分。

上图的最后一层是输出层,也就是手写识别的10个数字,需要说明的是这个输出层和pooling层是全连接的,也就是说,输出层的每个神经元都是和pooling层的所有神经元相连的。可以在中间多加几个卷积层和pooling层。

这些是CNN的基本模型,而且也只是以单个卷积层和pooling层为例,实际中可能会有多个卷积层,而且对应的全连接情况也是变化很多,比如我们我可在输出层之前再加一个全连接层。变化很多,因此这里只是简单的描述一下概念,后面会对CNN有更加深入的探讨。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?