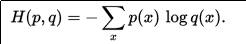

先上公式,交叉熵定义

p(x) 是真正的概率分布, q(x) 是估计的概率分布. 这个评价准则是用来测量 q(x) 与 p(x)的相似程度. 在信息论里证明, 当q(x)=p(x)时, H(p,q) 达到最小值.

在 Tensorflow 中, 对于某一特定图像, p(x) 是 one-hot vector ([0 0 0 1 0 0 0]), q(x) 是 softmax 层的输出. 值得注意的是在 Tensorflow 里的函数

tf.nn.softmax_cross_entropy_with_logits(_sentinel=none, labels=none, logits=none, dim=-1, name=none)

labels: [batch_size, num_classes], the batch of one-hot vectors

logits: 估计的概率分布, 但在这里是 softmax 层的输入,即没有进行加和归一的原始数据

dim: class 所在的维度,默认值是最后一维

输出是 batch_size 大小的向量, 所以我们要用 tf.reduce_sum 来计算平均值.

或者我们可以用下面的方法求交叉熵

logits=.....

logits_softmax=tf.nn.softmax(logits)

OneHot=.....

CrossEntropy=tf.reduce_sum(-OneHot*tf.log(logits_softmax))

更多细节?参考下面文章

http://blog.csdn.net/rtygbwwwerr/article/details/50778098

811

811

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?