真皮沙发这次又来了!在上次的两个爬虫中,笔者探讨了python爬虫的入门以及re模块的运用。而上两次的爬取内容都是笔者闲的蛋疼入门爬虫所选择的连个爬取页面。

今天笔者要来搞事了,这次是搞正事。是的,搞正事。相信很多的同学都有在各大招聘网站上浏览过,各种层出不起的信息,着实让人厌烦。很多人也在着急寻找实习单位为以后找工作打好基础,笔者本着服务于人的态度爬取了一个实习生招聘网站-实习僧,因为笔者在武汉就读,就爬取了100页武汉本地的实习单位信息。通过所得到的数据分析了一下实习生的工资待遇,就笔者目前所得到的结果来看,整体就一个惨字啊!

哇,一个偌大的武汉对待实习生也太差了吧,真的是让人心寒。这里笔者先买个关子,等会和大家一起看分析结果。那么现在我们进入正题,首先我们要将信息爬取下来,这需要一个爬虫框架,这里便不多累述,前两篇都有。而后我们将爬取得到的数据存入数据库,这里用到的是MongoDB,不得不说这个C++开发的数据库效率还是很高的,数据的存储方式与知名的关系数据库大相径庭,但却显得十分有个性。接下来我们便要用到赞誉极高的jupyter notebook来进行数据分许了,对于数据的可视化笔者用的是charts这个第三方库,当然你也可以用matplotlib这个神奇的库。

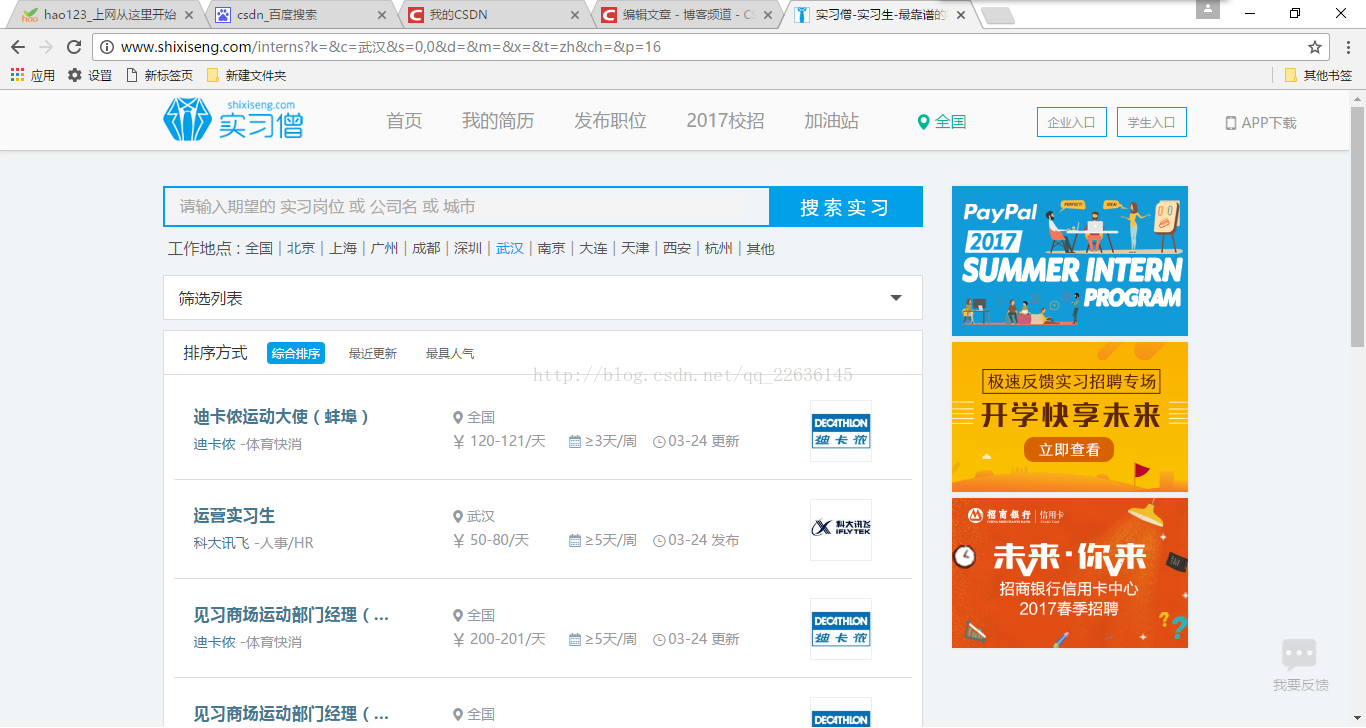

我们先来看一看本次爬取的页面:

说个实话笔者觉得这个实习僧网面简直不要太友好,

本文利用Python爬虫抓取实习僧网站100页的武汉本地实习信息,存储到MongoDB数据库,并使用jupyter notebook进行数据分析和charts库进行可视化。结果显示武汉实习生的待遇普遍偏低。爬虫实现包括获取每页数据、处理薪资信息等步骤,通过strip()和split()方法处理字符串。最后,数据以直观的方式展示,为学习Python爬虫和数据分析的读者提供参考。

本文利用Python爬虫抓取实习僧网站100页的武汉本地实习信息,存储到MongoDB数据库,并使用jupyter notebook进行数据分析和charts库进行可视化。结果显示武汉实习生的待遇普遍偏低。爬虫实现包括获取每页数据、处理薪资信息等步骤,通过strip()和split()方法处理字符串。最后,数据以直观的方式展示,为学习Python爬虫和数据分析的读者提供参考。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1088

1088

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?