作者: 周婷

方向: 情感分析

学校: 中山大学

论文:Relation-Aware Collaborative Learning for Unified Aspect-Based Sentiment Analysis

录取:ACL2020

单位:武汉大学

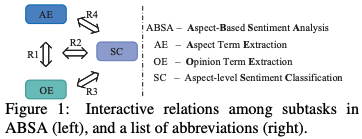

任务定义

给定句子,定义三个AE、OE、SC的序列标注问题:

AE 目的是预测一个tag序列 (和原始句子等长),其中 分别表示 begining of, inside of, outside of 一个aspect term。

OE 目的是预测一个tag序列(和原始句子等长),其中分别表示 begining of, inside of, outside of 一个opinion term。

SC 目的是预测一个tag序列(和原始句子等长),其中分别表示每个单词的极性。

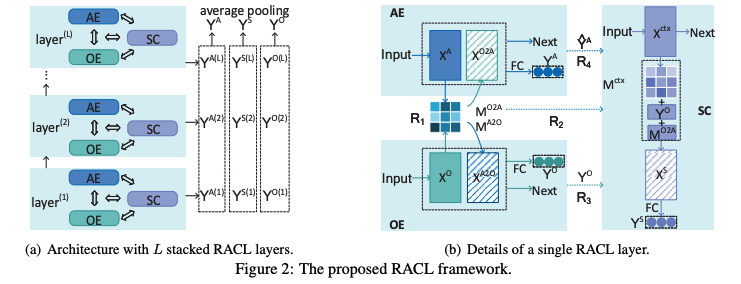

结构解析

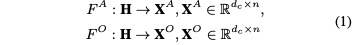

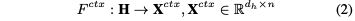

1.输入部分是词嵌入经过一个全连接层得到

2.首先进行子任务私有特征的编码,得到面向三个子任务的特征、、

利用卷积得到AE-oriented features 和OE-oriented features ,考虑到的是这两个任务与词的临近词相关性很大。

为了得到SC-oriented features

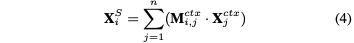

首先从中利用CNN编码上下文特征,然后将共享向量视为query方面,并用注意力机制计算query和上下文特征之间的语义关系,得到(利用的是实现的表达)

3.Propagating Relations for Collaborative Learning

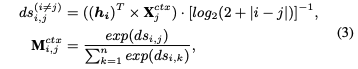

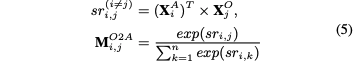

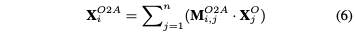

是AE和OE之间的双向关系,是OE向AE传递的部分,计算方法是和交互,利用表达。然后将交互部分同原来的面向AE的特征拼接在一起,经过一个线性层和softmax就可以得到任务AE的分类结果。同理得到任务OE的分类结果。

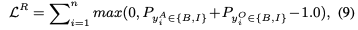

此外,一个单词不可以既是方面词又是情感词,因此加入了合页损失作为正则项来约束和

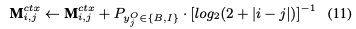

R2是SC和之间的三元关系。注意直接使用注意力权重来相加的,而不是在最后阶段。

R3是SC和OE之间的双向关系,这表明,在对情感极性进行预测时,需要对抽取出的观点术语多加关注。为了建模R3,采用和R2同样的方式,也就是对SC中的利用生成的 tag序列进行更新,如下:

这样的话情感词在注意力机制中可以得到更大的权重,从而有利于情感分类。

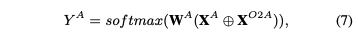

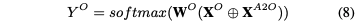

得到上述方式完成交互后的后,我们可以按照式子4重新计算面向SC任务的特征,然后我们将和拼接在一起作为最后的SC的特征,并将它们经过一个全连接层后去预测方面极性。

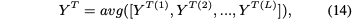

4.Stacking RACL to Multiple Layers以上是一个RACL模块的输出,本实验堆叠了多个模块。具体来说,我们首先编码第一层特征,,,在第二层将这些特征输入到SC,AE和OE去生成,,。以此类推可以将RACL堆叠到L层。最后将各层的最终预测结果进行平均池化的操作

这种shortcut-like的架构可以促进低层中的功能具有意义和信息量,反过来这也有助于高层做出更好的预测。

损失函数

最终RACL总的损失的 L 是所有子任务的损失之和加上正则项的损失,也就是,其中是系数,.

方法比较和Case分析

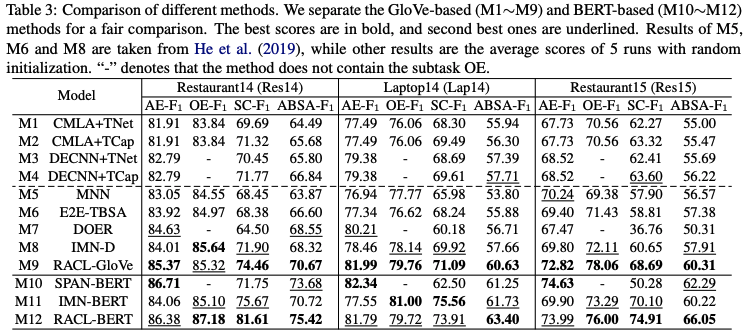

和不同的历史方法作比较:

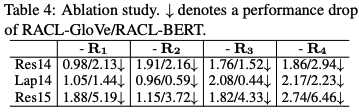

关于本文提出的方法的简单变种的消融实验:

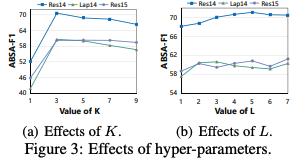

超参和的影响:

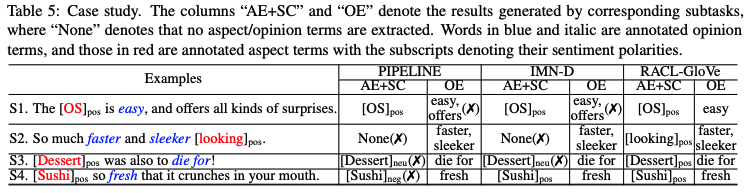

Case分析:

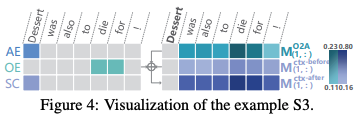

关于上面的可视化分析:

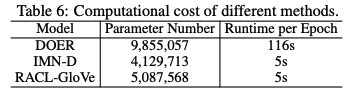

最后就是不同方法的计算量分析:

📝论文解读投稿,让你的文章被更多不同背景、不同方向的人看到,不被石沉大海,或许还能增加不少引用的呦~ 投稿加下面微信备注“投稿”即可。

最近文章

DiffCSE: 将Equivariant Contrastive Learning应用于句子特征学习

苏州大学NLP团队文本生成&预训练方向招收研究生/博士生(含直博生)

NIPS'22 | 重新审视区域视觉特征在基于知识的视觉问答中的作用

投稿或交流学习,备注:昵称-学校(公司)-方向,进入DL&NLP交流群。

方向有很多:机器学习、深度学习,python,情感分析、意见挖掘、句法分析、机器翻译、人机对话、知识图谱、语音识别等。

记得备注~

3432

3432

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?