为什么需要让LLM学会“呼叫外援”?

大语言模型(如ChatGPT)虽然强大,但推理速度慢、算力消耗高。尤其是数学题、编程题等需要多步推理的任务,生成几千个token是家常便饭。这就像让一个博士生做小学数学题——虽然能做对,但时间和电费都让人心疼。

传统解决方案有两种:

全用小模型:速度快,但容易出错。

全用大模型:准确率高,但慢如蜗牛。

更尴尬的是,推理过程中并非每一步都难。比如解方程时,写“设未知数为x”很简单,但后续的复杂计算可能需要更高智商。于是论文提出:能不能让小模型处理简单步骤,遇到难题时自动呼叫大模型?

论文:SplitReason: Learning To Offload Reasoning

链接:https://arxiv.org/pdf/2504.16379

SplitReason如何实现“合作推理”?

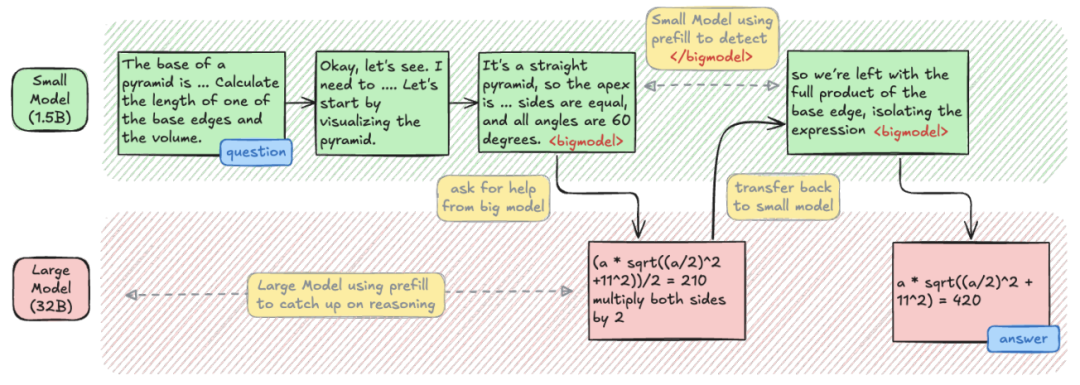

SplitReason的核心理念是动态分工:

小模型(1.5B参数):负责80-95%的推理步骤,像实习生一样处理常规任务。

大模型(32B参数):作为“外援专家”,仅在关键难点介入。

关键机制:

小模型生成过程中,如果遇到困难,会主动发出信号 <bigmodel> ,相当于喊“这道题我不会了,大佬快来!”

大模型立刻接手,生成难点部分的答案,完成后用 </bigmodel> 交回控制权。

两者的KV缓存(记忆模块)实时同步,实现无缝切换。

如何训练小模型学会“求助”?

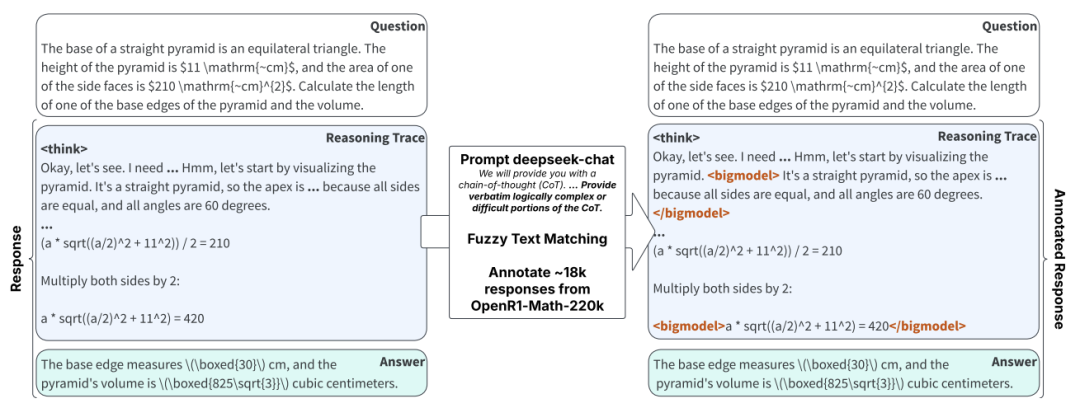

第一步:标注“困难段落”

用超大模型(DeepSeek-R1 671B)自动分析18万条数学题的推理过程,标注出20%最难的步骤,并打上 <bigmodel> 标签。

相当于让学霸给练习题划重点:“这里容易卡壳,需要开挂。”

第二步:分阶段训练

模仿学习(SFT):让小模型学习标注数据,模仿何时该“求助”。

强化学习(GRPO):进一步优化,奖励小模型“精准求助”——既不能乱喊救命,也不能硬撑到底。

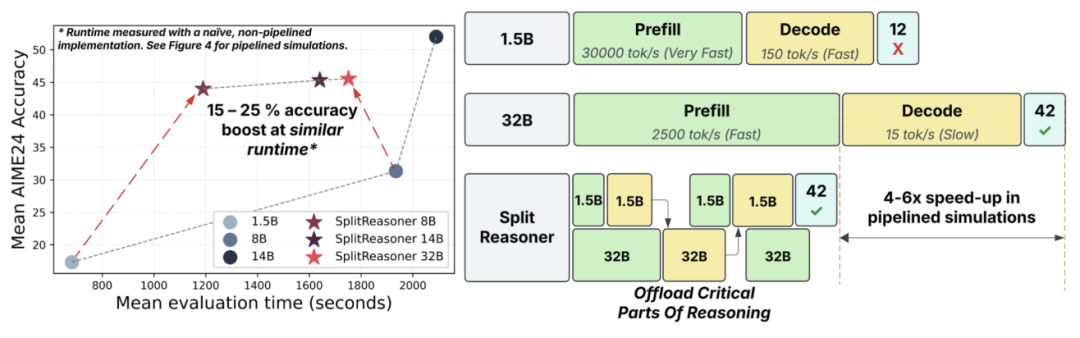

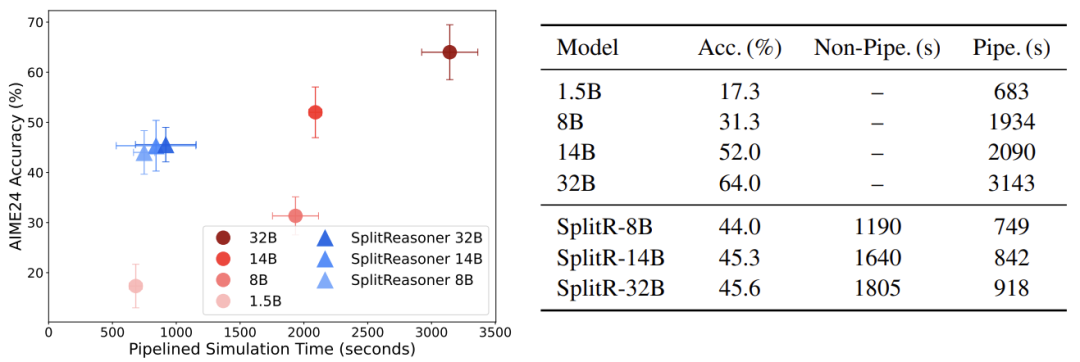

实验结果:又快又准

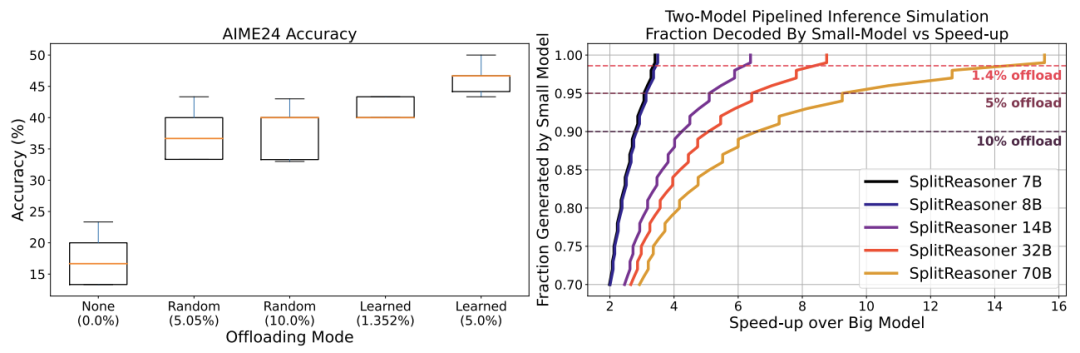

准确率:相比纯小模型,AIME24数学题准确率提升28.3%。

速度:通过卸载5%的任务给大模型,整体推理速度比纯用大模型快5-8倍。

效率:大模型仅处理5%的token,却贡献了关键解题步骤。

更惊人的是,即使随机让大模型处理5%的步骤,准确率也能提升20% 。而智能卸载(SplitReason)进一步优化了这一过程,实现“四两拨千斤”。

意义与未来

硬件友好:未来AI不仅要比谁更聪明,还要比谁更“省电”。

开源价值:论文公开了模型、数据集和代码,开发者可以直接复现或改进。

新范式:用强化学习让AI主动优化效率(RLAE),而不仅是模仿人类。

备注:昵称-学校/公司-方向/会议(eg.ACL),进入技术/投稿群

id:DLNLPer,记得备注呦

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?