Abstract

为了使所有参与教育环境的人都能利用 AI 工具进行强大的学习,本文描述了一个框架和策略,供教育领导者为其特定受众(例如学习者、教师或其他人)设计和实施安全有效的 AI 素养方法。本文的第一部分描述了一个框架,该框架确定了 AI 素养的基本组成部分,并将它们与学区几十年来一直在实施的现有举措联系起来。本文的第二部分确定了策略和说明性示例,作为教育领导者将 AI 素养整合到 PK-12 教育中并适应其独特环境的指导。

Introduction

生成式AI(GenAI)系统和工具正在快速进入课堂。考虑到人工智能工具延续和复制系统性偏见(Benjamin,2019;布鲁萨尔,2023; Buolamwini,2023; Noble,2018; O 'Neil,2016)和侵犯数据隐私(Ingram,2023;联邦贸易委员会,2024)的证据确凿的例子,关注和怀疑是有根据的。为了安全有效地使用人工智能,教育工作者和学习者需要了解什么并能够做什么?

Digital Promise认为,安全有效地使用人工智能需要知情的用户,因此呼吁学校领导和政策制定者支持所有学习者、教育工作者和社区成员的人工智能素养,以负责任地使用新兴技术。我们对AI素养的定义如下:人工智能素养包括使人们能够批判性地理解,评估和使用人工智能系统和工具,以安全有效地参与日益数字化的世界的知识和技能。

对于教育工作者来说,人工智能素养的发展是利用新兴技术进行强大教学和学习的必要先决条件。对于学习者来说,人工智能素养可以使他们具备基本的技能,以便在他们的一生和劳动力中负责任地使用新兴技术来造福社会(世界经济论坛,2024)。利用人工智能素养的概念,学习者、领导者、教育工作者和护理人员可以协同工作,就是否以及如何采用新兴技术来促进在我们的生活中安全有效地使用人工智能工具做出更明智的决定。

为了使所有参与教育环境的人都能利用人工智能工具进行强大的学习,本文描述了一个框架和策略,供教育领导者为他们的特定受众(例如学习者、教师或其他人)设计和实施一种明确的人工智能扫盲方法。本文的第一部分描述了一个框架,该框架确定了人工智能素养的基本组成部分,并将其与现有计划联系起来。本文的第二部分确定了策略和说明性示例,作为教育领导者将AI素养融入K-12教育并适应其独特环境的指导。

AI Literacy Framework

为了给教育领导者提供一个简洁而全面的人工智能素养框架,Digital Promise考虑了几个方面。我们从基于研究的框架(如Almatrafi等人)中整合了关于人工智能素养的见解,2024,Druga等人,2021,Ng等人,2021年和Lee和Long(出版中)。从道德决策的角度来看,我们考虑了安全基准框架(EdSAFE AI联盟,2024)。最后,从人类正义的角度来看,我们引入了大量关于算法和技术偏见的研究和新闻(例如,本杰明,2019年;布鲁萨尔,2023年; Buolamwini,2023;诺布尔,2018年; O 'Neil,2016年),并在教育领域从事负责任的人工智能和技术司法工作(白色&斯科特,2024年)。我们还考虑了相关媒体和计算素养的长期历史和研究基础,以及它们在学校环境中的现有和历史应用。基于这一系列的工作和倾听从业者的意见,我们认识到理解、评估和使用是与人工智能互动的相互关联的方式。建立和促进人工智能素养需要这三个方面。此外,理解和评估人工智能对于在不同环境中是否以及如何使用人工智能做出明智的决定至关重要。强调我们的框架是人类的判断和正义,这是在适当的背景下应用AI和减轻算法有害影响的核心价值。

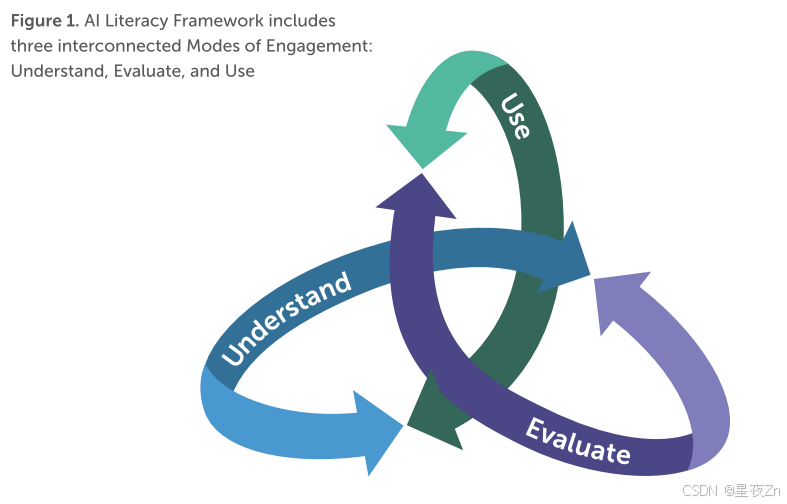

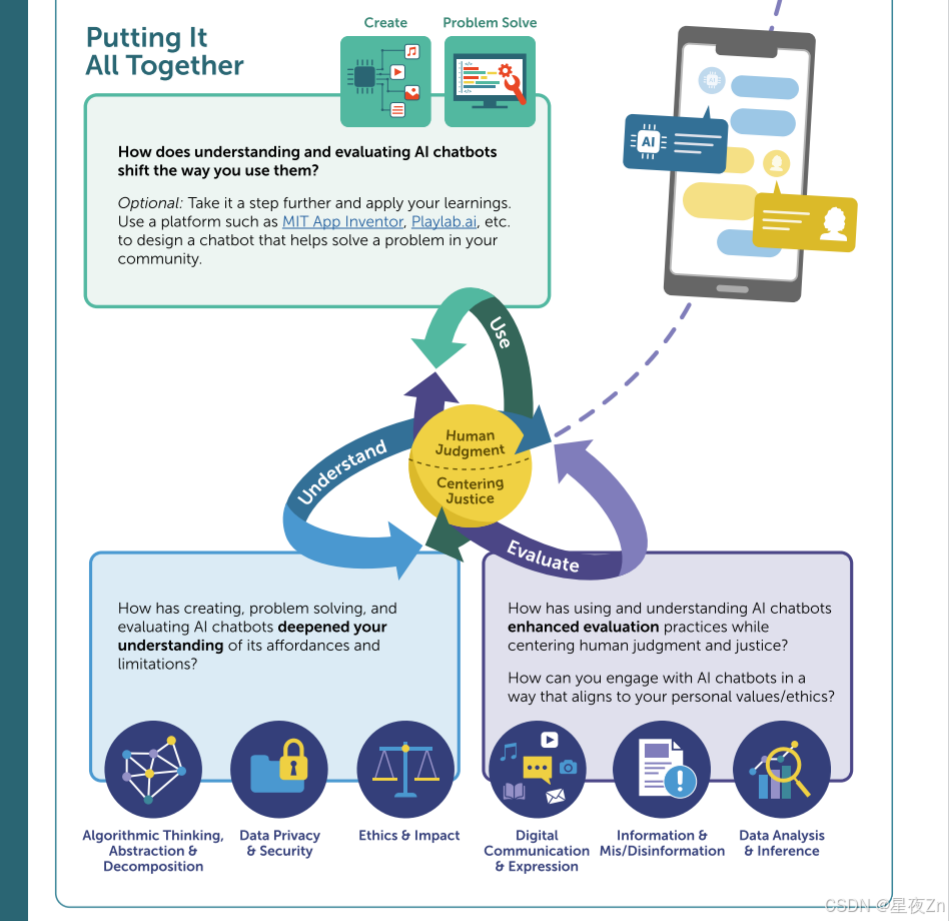

该框架,如下图所示,包括三种参与模式:理解,评估和使用。该框架的相互关联性表明,理解、评估和使用同时发生,并共同支持人工智能素养的强大参与。

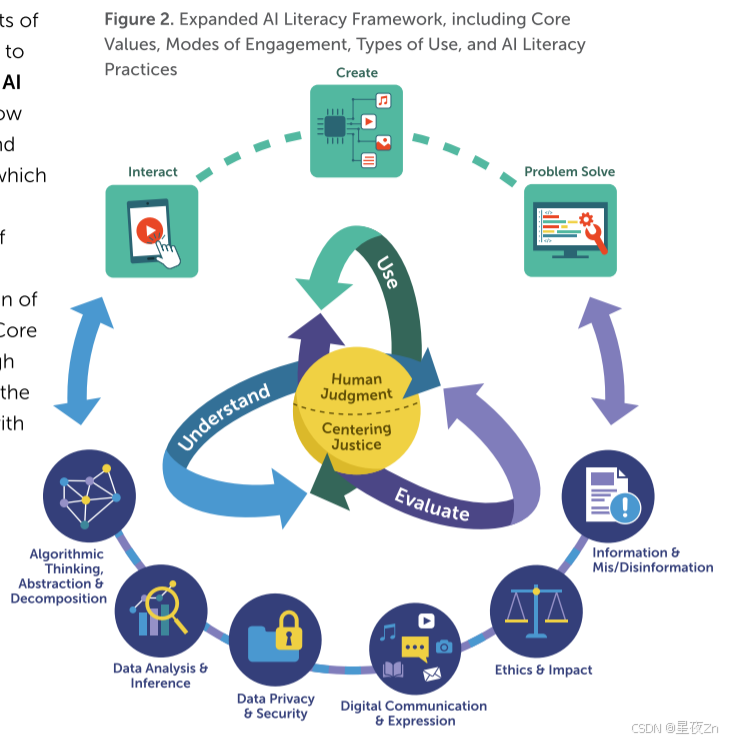

我们描述了教育领导者适应其环境的人工智能素养的基本组成部分,包括人工智能素养实践,以阐明用户如何参与理解和评估人工智能系统和工具,这些系统和工具以核心价值观为基础,强调在任何人工智能应用中以人类判断为中心和以正义为中心的重要性。人工智能素养实践和核心价值观通过三种使用类型实现。右图详细说明了我们的框架和每个组件。

本文件以下各节将详细阐述这一框架的每个组成部分。我们开始描述人工智能素养实践,并将它们与现有的计划联系起来。

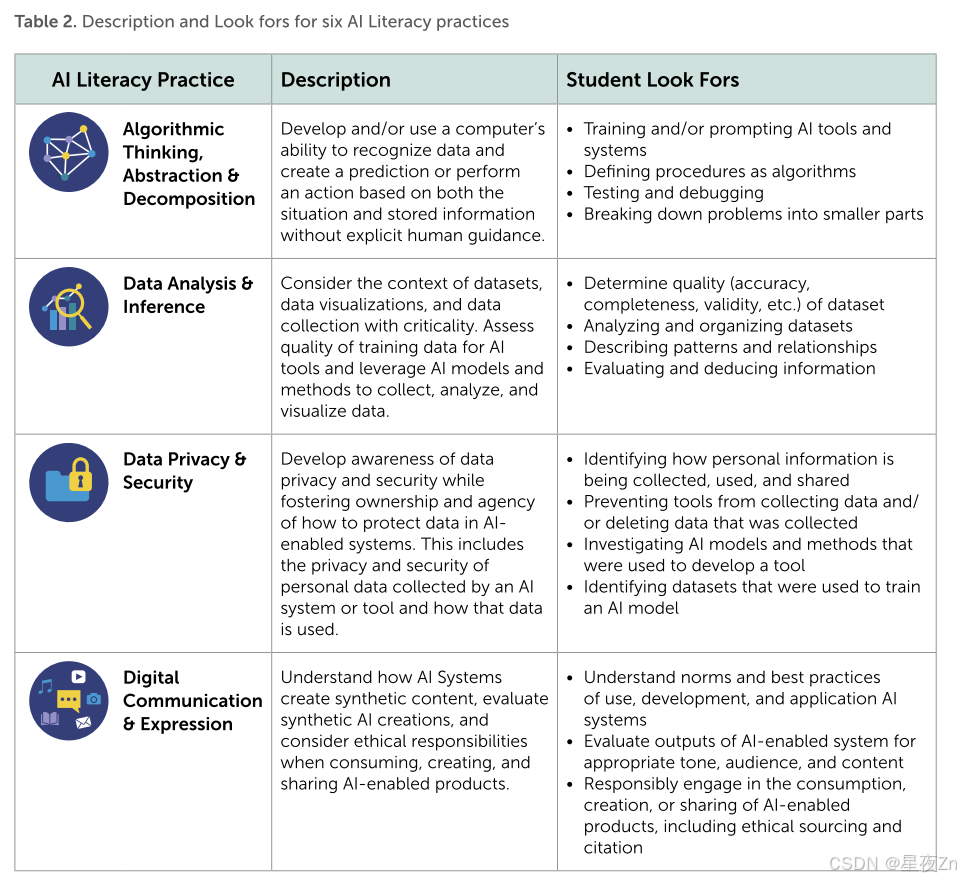

AI Literacy Practices

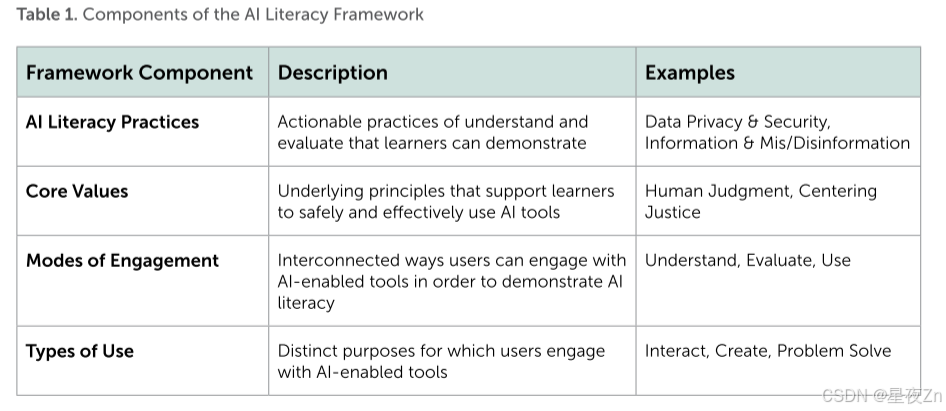

人工智能识字实践是学习者可以展示的可操作的技能。这些实践定义了用户如何理解和评估支持人工智能的工具,以及教育工作者如何支持人工智能素养发展。将人工智能识字等复杂主题分解为实践可以支持领导人在其背景下定义和实施人工智能识字计划。例如,人工智能扫盲做法可用于开发综合学习机会或工具,如为教练/管理人员提供的演练文件和为教师提供的形成性评估(Mills等人,2020年)。在下表中,我们提供了每种人工智能扫盲实践的描述和示例。

这些AI素养实践支持学习者理解和评估AI系统和工具。重要的是要注意,这些实践中的每一个都可以在不使用AI工具的情况下学习和/或教授。事实上,我们建议学习者在没有人工智能工具的情况下,特别是在低年级,应该明确地参与人工智能素养技能的发展(例如分析和组织数据集)。现有的举措,如媒体素养、数字公民、计算思维和数据素养,为领导者了解如何建立人工智能素养能力提供了有用的指导和资源。我们将在下一节详细阐述与现有倡议和人工智能扫盲实践的联系。

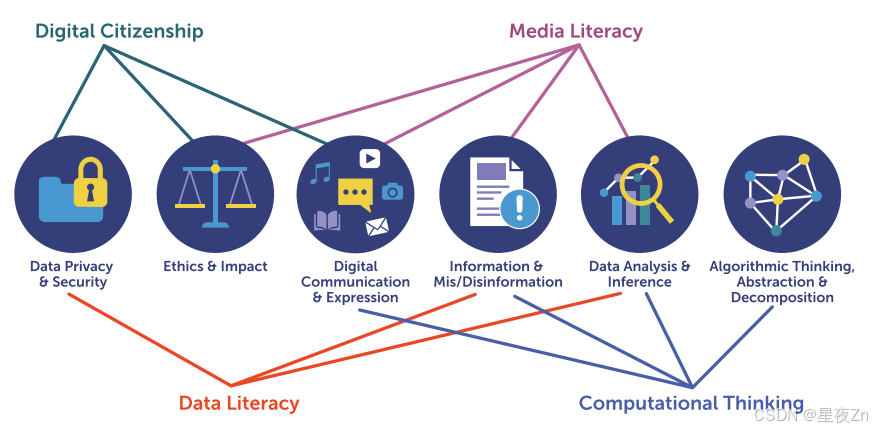

将AI素养与现有计划联系起来

人工智能素养技能与教育工作者几十年来一直在讨论和实施的应对新兴技术的举措有关。这些包括但不限于计算思维、数据素养、数字公民和媒体素养。这些深度的联系可以让学校领导者扩展现有的计划和学习途径,以包括人工智能素养,或者在人工智能素养计划的同时引入其他相关的学习目标。下面,我们将解释人工智能素养实践如何与现有计划相关联,如图3所示。

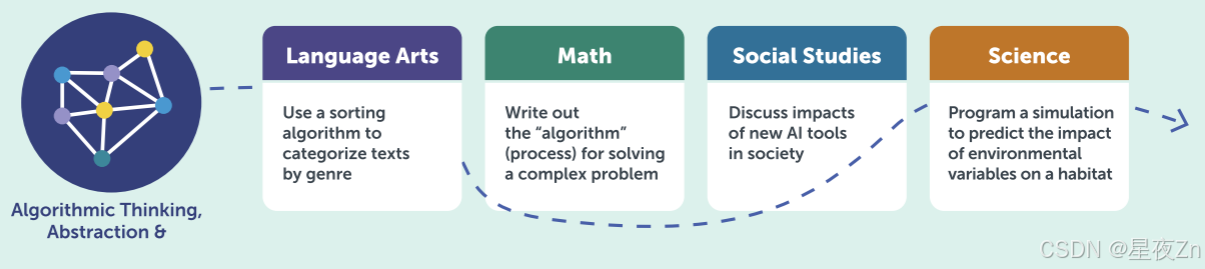

计算思维,定义为系统地解决问题,以便计算机能够支持过程或产品开发(米尔斯等人,2021年)的报告。计算思维包括自动化、数据实践和建模等实践,并与算法思维、抽象和分解、信息和错误/假信息、数据分析和推理、通信和表达等AI素养实践相关。

数字公民,定义为负责任地使用技术进行学习、创造和参与(James等人,2021年)的报告。数字公民包括媒体平衡和福祉、隐私和安全、数字足迹和身份、人际关系和沟通、网络欺凌、数字戏剧和仇恨言论以及新闻和媒体素养(Common Sense Media,2024 a)。它涉及人工智能素养实践,如道德与影响、数据隐私与安全以及沟通与表达。

数据素养,定义为与具有关键性、不确定性和阴谋的数据进行交互(例如,收集、分析、可视化、解释),包括上下文、聚合、可变性、可视化和推理等组件(Rubin等人,2020年)的报告。它与人工智能素养实践相关联,如数据隐私和安全、信息和错误/虚假信息以及数据分析和推理。

媒体素养,定义为使用各种形式的沟通进行访问、分析、评估、创造和行动的能力,包括批判性分析、推理、创造性表达、偏见、个人意识、准则、惯例和结构、有意识的媒体习惯和个人媒体管理(美国媒体素养教育协会,2024年)。它连接到人工智能素养实践,如道德和影响,信息和Mis/假信息,数据分析和推理和沟通和表达。

图3.人工智能素养实践与数字公民、媒体素养、计算思维和数据素养之间的联系

这些现有的举措为领导者提供了了解如何建立人工智能素养教学能力的起点。学习者将更好地准备将这些实践应用于人工智能工具,如果他们有机会尽早开发它们,并且经常跨年级和学科领域学习。

随着时间的推移,我们预计人工智能工具的日益突出和持续发展将改变这些基础知识中的优先技能。例如,编程一直被视为创建自动化的优先技能,这是计算思维的关键实践,但人工智能系统现在有能力在人类监督下自行自动化,这种监督的技能可能会超过编程,成为理解和创建自动化系统的关键技能。为了了解这些实践如何特别适用于人工智能系统,以及这些技能将如何随着新兴技术的创新而继续转变,教育工作者应该对人工智能及其工作原理有一个基本的了解。在下面的部分中,我们概述了人工智能,旨在帮助领导者适应其环境和受众。

Understanding AI

当用户在努力理解AI时,他们应该问“它是如何工作的?”以及“我们怎样才能让它变得更好”(Druga等人,2021年)的报告。理解人工智能是人工智能素养的一个重要组成部分,因为为了在使用和评估人工智能方面做出明智的决定,用户应该对人工智能的功能和工作原理有一个基本的了解。在本节中,我们提供了领导者应根据其独特环境进行调整的一般信息范围,包括对人工智能历史、工作原理以及使用方式的简要概述。

A Brief History of AI

许多人将人工智能与未来的技术愿景或科幻电影联系在一起,但人工智能已经存在了几十年。它在20世纪50年代被确立为一个研究领域。在它的起源,它被认为是数学和计算机科学的子集。技术的进步使计算设备能够越来越多地集成到生活和工作的各个领域。计算机现在可以收集和存储几乎任何东西的数据,并具有快速分析数据的处理速度。这些进步使人工智能从一个研究领域转变为一个更具跨学科性和相关性的工具。

How Does Artificial Intelligence Work?

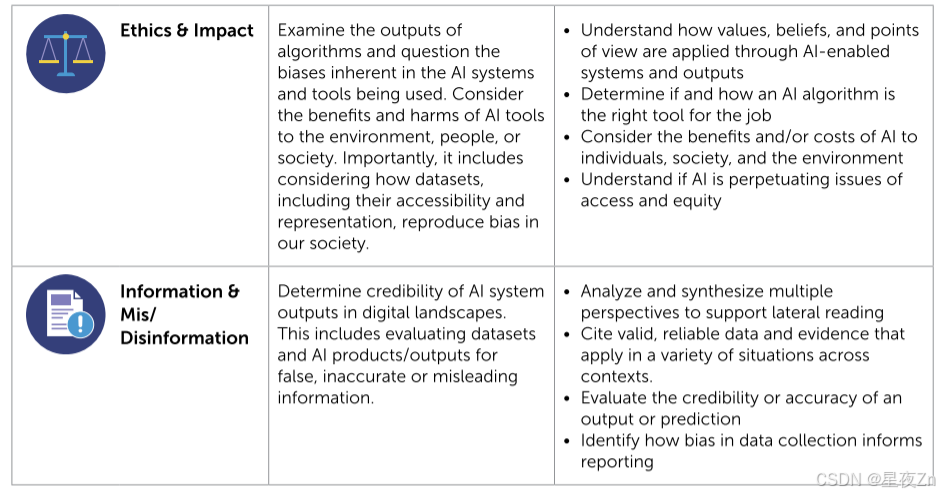

我们强烈建议您向您的观众解释什么是AI以及它是如何工作的。我们建议不要用“类人”这样的比喻或人工智能能力的例子来表达这一点,而应该是一个机械的讨论。它应该涵盖的关键点包括人工智能如何使用数据;模型依赖于统计数据,并基于识别和分析数据的关键特征;以及它通过使用统计模型和预测输出(如下一个单词或像素)来合成新内容。当然,你自己的解释可能会在许多细节层面上做到这一点,这取决于你的听众。在这里,我们提供了一个来自麻省理工学院媒体实验室个人机器人小组和麻省理工学院STEP实验室(2024)的例子。如下图4所示,人工智能系统的开发通常分为三个步骤:

- 获取和管理数据。机器学习系统需要数字数据,现代生活中充斥着数字数据。这些数据包括图片,短信,所有社交媒体帖子,图像和视频,以及互联网上以数字形式存在的一切。编程和开发人工智能工具的人选择使用什么数据来训练人工智能系统,并确定如何对数据进行聚合、分类和优先级排序。

- Train a model. 模型是对现实的有效简化。图片、文本、帖子和视频(上面讨论过)是为模型提供信息的数据;模型简化了实际数据,只保留了一组小得多(但仍然非常大)的关于单词之间关系的统计数据,用于语言模型,或像素,用于图片和图像模型。例如,创建文本的GenAI系统具有关于单词之间的关系以及它们在语言中如何使用的统计数据。

- **Using the model to receive an output.**对于生成文本的GenAI系统,一个人可以以提示的形式提问。然后,该提示作为统计模型的输入。统计模型将这种提示转化为数字。然后,它在该模型中运行计算,以基于统计关联预测输出。例如,文本GenAI系统生成单词来回答问题。

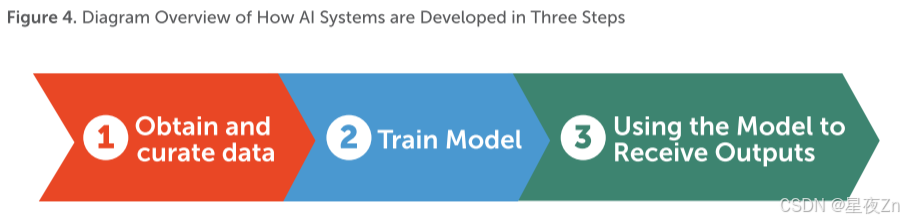

如果我们想做一个生成预测作为输出的GenAI系统呢?我们可以考虑一个简单的人工智能模型的例子,它可以根据两种类型的数据预测一个人什么时候可能饿了:(1)一天中的什么时候,(2)这个人最后一次吃东西是什么时候。人工智能系统的开发人员可能会制作一个模型,建议人们在一天中的某个时间可能会感到饥饿,但如果人们最近吃过东西,则会将时间推迟。我们可以使用这个模型,输入一个特定的人一天中的时间,以及他们最后一次吃饭的时间,并预测他们有多饿。

更高级的模型可以包括其他相关数据,例如个性化的生物特征数据,活动水平以及他们吃的其他类型的食物。人工智能系统将确定所有这些数据点之间的统计关联,以便做出预测作为其输出。人工智能系统将这种自动化应用于各种可能被感知和预测的事物,通过在数十亿个数据点之间建立关联来进行预测。下面,图5说明了一种称为人工神经网络的特定类型的AI模型的内部工作原理。它被安排在代表数据的“节点”层中,从输入层开始,隐藏层作为黑盒,然后是输出层。节点由表示加权关联的线连接,加权关联指示每个连接的数学强度。在这种类型的模型中,存在执行统计功能的隐藏层,由于连接和参数的数量太多,这些功能很难处理。因为我们无法理解这些模型,就好像它们在一个黑盒子里。鉴于人工智能系统和工具依赖于黑盒,不允许人类理解输出是如何决定的,因此这些人工智能系统和工具不应用于高风险应用。

总之,人工智能系统是用大量数据训练的。计算机通过自动统计分析来分析数据的模式,以生成预测或合成内容。为了训练人工智能系统,人类必须决定使用什么数据,以及如何聚合、分类和优先处理每一条数据。重要的是要注意,使用GenAI,每个数据点(例如,字、像素等)只是输出的一部分。因为输出有多个部分,所以模型必须运行很多次才能生成包含多个部分的输出,例如,包含段落的文章。接下来,我们提供了一些如何使用人工智能的例子,以便用户了解和熟悉人工智能的常见应用程序,以及它可以做的事情类型。

How Is Artificial Intelligence Being Applied?

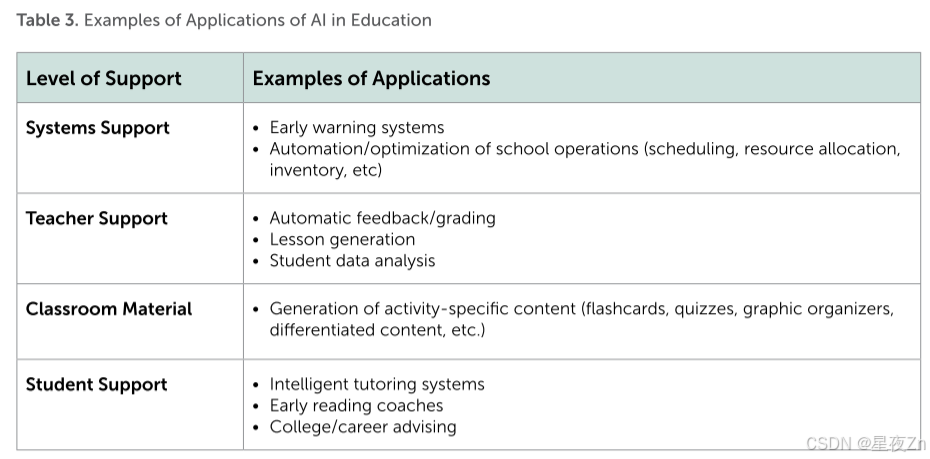

人工智能在我们日常生活中以我们可能认识到或可能不认识到的方式跨工具和部门进行了非常多的整合。例如,人工智能系统用于面部识别、文档翻译和个性化推荐。在教育领域,人工智能被应用于教学、学习、评估和管理任务。下表中列出了人工智能目前如何用于教育的一些熟悉的例子。更详细的应用可以在最近发布的世界经济论坛(2024)报告《塑造学习的未来:人工智能在教育4.0中的作用》中找到。

人工智能将继续以现有和新颖的方式融入教育环境。教育领导者应该支持所有人工智能用户理解和评估人工智能系统,以确保安全、有效和道德地使用人工智能。因此,评估AI是我们AI素养框架的主要组成部分,并在下一节中进行更多讨论。

Evaluating AI

评估人工智能是人工智能素养的重要组成部分。领导者必须支持人工智能用户成为关键消费者,因为我们知道人工智能会使偏见和错误信息永久化(布鲁萨尔,2023; Buolamwini,2023; Noble,2018; O 'Neil,2016; Webb,2024)。如果不加以控制,人工智能有可能对个人和社区造成伤害。我们必须不断地考虑人工智能对个人、社会和环境的好处和/或代价。人类的判断最终负责决定是否以及如何在我们的生活中整合人工智能的输出或预测。下一节详细阐述的核心价值观提供了如何以及为什么要评估人工智能系统和工具的额外背景和解释。

Core Values

核心价值观是支持学习者安全有效地评估人工智能工具的首要实践。在这一节中,我们提出了两种核心价值观,即以人为本和以正义为中心。为了支持人工智能素养的发展,领导者有责任将这些核心价值观与其独特背景下的人工智能系统和工具的具体应用联系起来。

Centering Human Judgment

开发人员设计的AI系统使用硬件、算法和数据来做决策、发现模式和执行操作。虽然人工智能似乎模仿人类智能,但它并不相同。人类和计算机擅长不同的事情。计算机非常擅长快速进行数学计算,并遵循一套精确的指令。计算机可以分析大量数据以进行预测,但这些预测的适用性仅限于收集的数据范围。计算机无法考虑它们无法访问的信息,例如上下文和情感。例如,人工智能无法检测人与人之间的讽刺,也无法理解不同的上下文或情况。人工智能也没有意识;它不能反思或评估其行为(Huckins,2023)。正因为如此,我们警告不要将AI人格化。我们提醒用户,人工智能工具应该被称为“它”而不是代词,并避免将GenAI错误称为“幻觉”,以避免忽视心理健康问题(Ruiz & Glazer,2024)。

我们的世界正日益成为一个计算机和人类一起工作来解决问题的世界(Roschelle等人,2021年;罗谢尔,2020年)。人类有责任将其独特的技能组合应用于人工智能系统和工具的应用,包括理解复杂性、处理模糊或模棱两可的情况、理解上下文、移情和道德决策(Heintz,2022)。以人类判断为中心,包括确定计算机支持的适当任务,以及确定在我们的生活中整合输出或预测是否合适以及如何合适。此外,它还考虑了价值观、信念和观点是如何通过人工智能系统/输出来应用的。例如,如果我们继续通过化石燃料为地球提供动力,大型人工智能系统可能会通过不受限制的能源消耗危害我们的环境(达尔,2020; Keller等人,2024年)的报告。人类的判断必须权衡实施人工智能系统的好处和相关成本。为了确保人工智能系统和工具的道德应用,至关重要的是,人类仍然是我们是否以及如何将人工智能集成到任何环境中的中心。

Centering Justice

人工智能系统正在影响现代社会中几乎每个人的生活,但其结果并不能平等地代表所有人的利益。它们能够而且已经加剧了社会中现有的压迫和偏见。Druga等人(2021)提供了儿童在人工智能系统中识别的偏见的例子,包括种族和民族偏见(面部识别系统识别白色面孔的准确性高于其他种族的面孔),年龄偏见(人工智能系统不承认年轻人的声音)和性别偏见(人工智能语音助理使用女性声音执行性别规范)。这种偏见的一个原因是用于训练AI系统和工具中的算法的数据。这些数据往往低估了历史上被排斥的社区(Benjamin,2019; Buolamwini,2023)。然而,解决这一差距并不像收集更多数据那么容易。过去这样做的努力对社区造成了更多的伤害(霍利斯特,2019),并且围绕边缘化社区的数字监控存在重要的伦理问题,特别是在未经适当同意的情况下收集图像和音频以纳入大规模数据集(Buolamwini,2023)。个人必须意识到AI可以不道德地收集和使用数据。例如,训练数据集有时来自互联网上的公共论坛。大型语言模型(LLM),如ChatGPT,在未经认证或同意的情况下使用大量网络上可用的书面材料,导致有偏见和错误的输出。

人工智能系统中产生偏差的另一个原因涉及算法中包含的变量或信息。例如,基于历史数据评估风险的模型可能不使用种族,宗教,性别或年龄变量,但使用的代理变量如邮政编码和教育水平可能具有歧视性(O 'Neil,2016)。设计人工智能系统的个人,以及担任领导职务以决定是否以及如何使用它们的个人,不成比例地是白色和男性(美国劳工统计局,2024; Wachter-Boettcher,2017)。因此,目前设计和实施的算法严重缺乏边缘化社区的代表性,包括有色人种和残疾人社区(Noble,2018)。算法偏见及其可能造成的危害在很多方面影响了社区。在人工智能应用的每一个背景下,都存在基于人工智能系统大规模实施自动化决策的风险,这会造成永久性的伤害。用户在理解、评估和使用人工智能时必须以正义为中心,以确保所有人,特别是那些在历史上和系统性地被排除在外的人,不会因使用人工智能而受到伤害(白色和斯科特,2024)。这在教育系统中尤其重要,因为年轻人被要求参与人工智能系统,而不能选择他们可以使用什么工具。在学习环境中,教师和领导者必须明智地理解他们选择的工具,以及他们的学习者在所有的变化中将如何受到影响。

用户在使用或应用人工智能系统和工具时必须始终以这些核心价值为中心。当然,根据人工智能的使用和/或背景,也存在独特的风险。下一节将在我们框架的最后一个维度–使用人工智能–中详细阐述这些具体风险。它区分了三种不同的用途:与人工智能交互,与人工智能创造,与人工智能解决问题。对于每种类型的使用,它描述了人工智能素养的实践,并指定了评估的考虑因素。

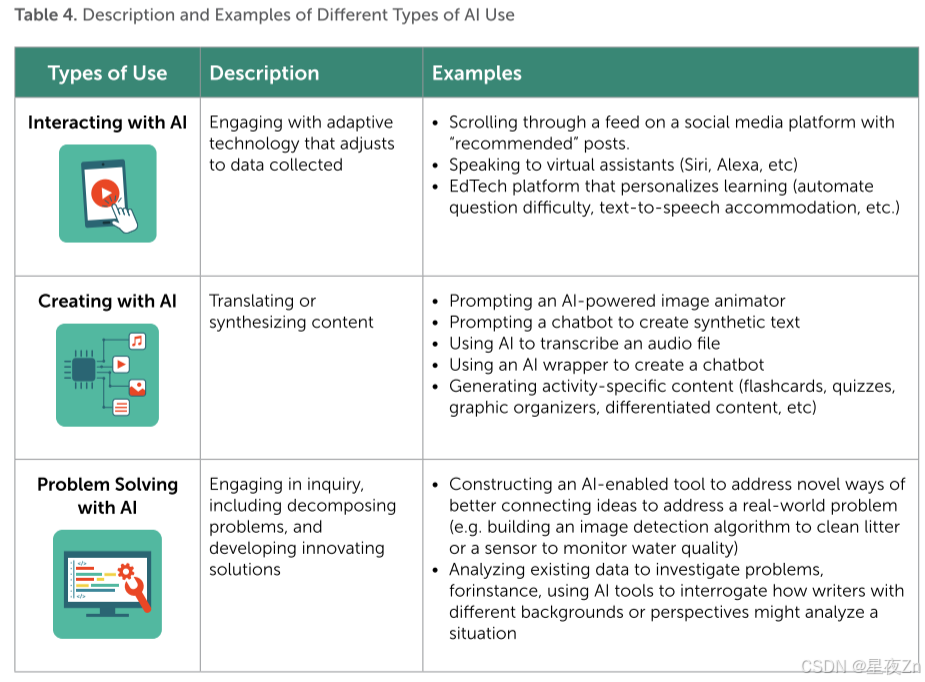

Using AI

教育参与者将AI用于不同的目的。在本节中,我们将介绍三种用途:与AI交互、与AI创建和与AI解决问题。与人工智能系统的交互是以多种形式与自适应技术进行互动,这些技术可以根据收集的数据进行调整,例如当学习者在数学或阅读中使用自适应导师来接收他们理解水平的内容时。使用AI创建可以翻译或合成自动化内容,例如使用使用LLM生成文本的工具。问题解决与人工智能是利用人工智能工具进行调查,如分解问题和创新的自动化解决方案。在所有这些情况下,我们都需要运用特定的技能,以批判性地了解他们在做什么时收集、使用和分享的信息。下表提供了每种使用类型的示例。

人工智能素养需要了解每种类型使用所固有的风险。在下面的章节中,我们将解释人工智能素养实践如何独特地应用于每种使用类型,以有效地理解和评估支持人工智能的系统和工具。

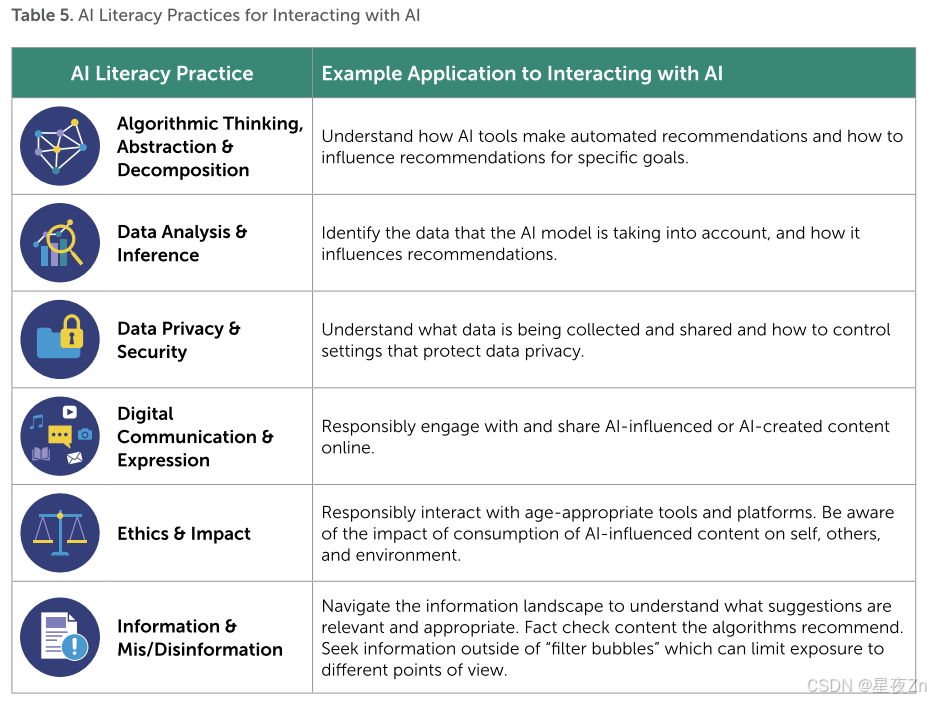

Interacting with AI

与人工智能的互动涉及以多种方式参与自适应技术,以适应收集的数据。使用这些工具可以使某些任务或决策更容易。例如,建议歌曲以制作完美策划的公路旅行播放列表需要访问有关歌曲的数据(例如流派,艺术家,克里思)以及您喜欢听的歌曲的功能。与人工智能交互通常需要使人工智能工具能够访问个人数据,以便使其自动化流程或进行预测。关于与人工智能的交互,存在未经同意收集或共享个人数据的风险。人们经常被动地使用人工智能,而不考虑这样做的隐私,安全或社会影响。要真正了解人工智能,用户必须采取更积极的方法,对算法使用的数据以及如何应用和共享数据有严格的认识。在下表中,我们将每个AI素养实践联系起来,因为它与用户与AI交互有关。

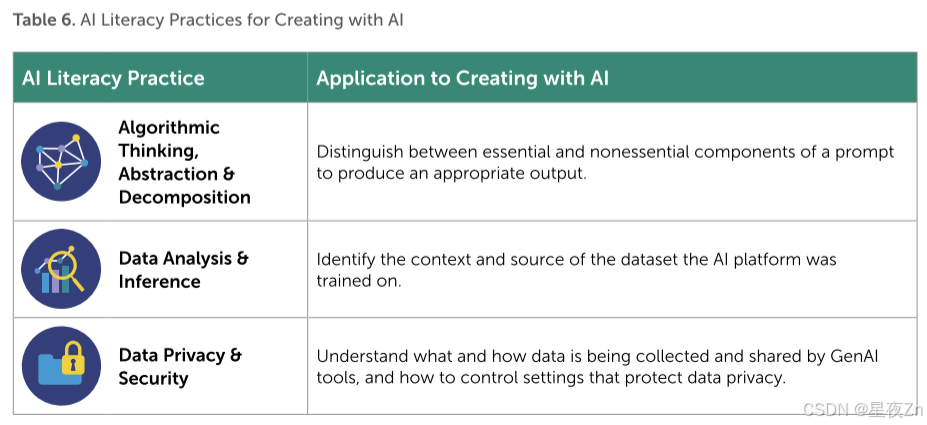

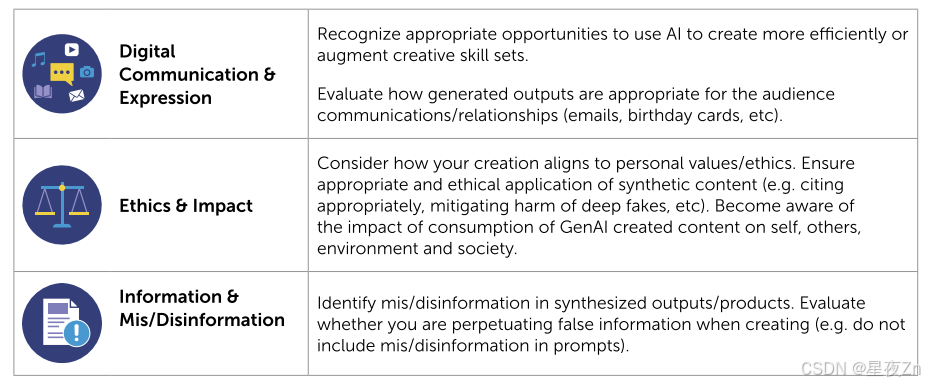

Creating with AI

ChatGPT、Claude、Gemini和其他LLM等生成式AI平台可以生成对提示的文本响应,DALL-E等平台可以生成图像。输出是基于数十亿数据点之间的关联的合成内容。要创建输出,使用GenAI的人必须输入提示。GenAI提示的技巧包括创建好的问题或命令,让系统产生人类认为是高质量的输出。虽然提示本身是一种技能,但它需要了解所需的输出以及如何验证和确认这些输出的准确性。有效地促进GenAI系统或工具需要时间,通常需要明确的沟通,具体性,实验和耐心。

与AI一起创建也有风险。由于用于预测的数据是历史数据,它们可能包含我们不想永久化的偏见和假设。例如,如果要求生成医生的图像,GenAI模型可能更有可能生成一个白色男性。还有一个风险是,GenAI可能会产生完全错误的东西。LLM倾向于包含微妙错误或有害错误的信息(Webb,2024)。出于这个原因,GenAI系统不应用于学习有关该主题的新信息。LLM也能够很容易地被用来产生邪恶的输出,如深度伪造(费拉拉,2024)。技术护栏往往出现得很慢,或者很容易绕过。人类需要对LLM生产的内容进行重要监督,特别是针对儿童等弱势群体。我们提醒用户在鼓励学习者直接使用GenAI平台之前,请检查可接受的使用政策,因为许多平台适用于13岁及以上的用户。在确保GenAI的道德使用并验证合成产品准确可靠后,用户应在分享其输出时引用并确认GenAI工具的使用。

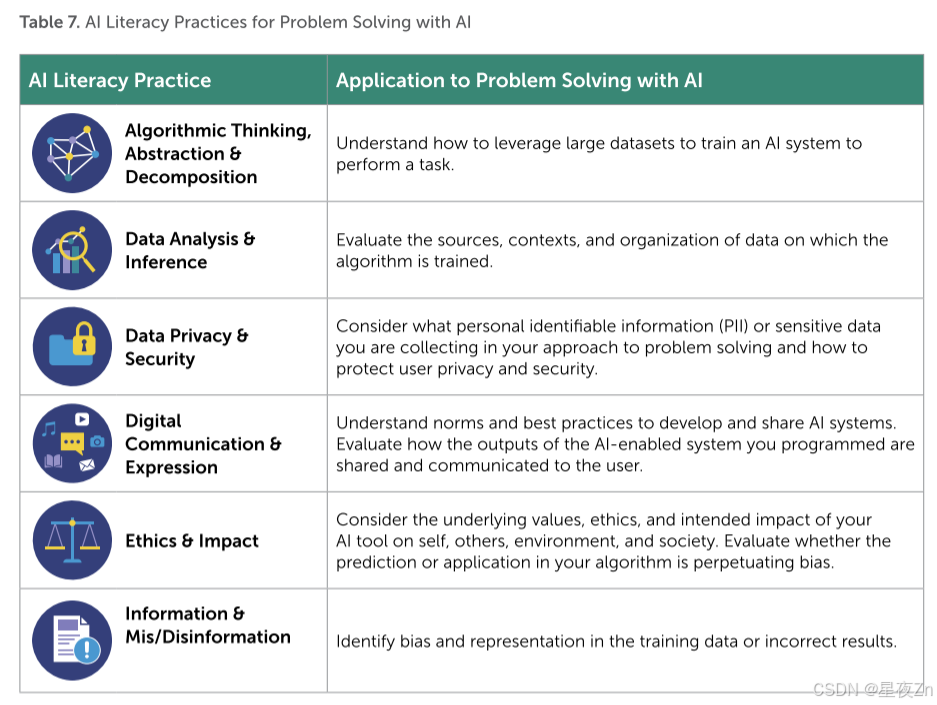

Problem Solving with AI

使用AI解决问题是使用支持AI的系统和工具进行查询,例如分解问题或开发创新解决方案。一个例子是训练图像检测算法,例如区分海洋动物和垃圾,作为清理水生生态系统的自动化系统的一部分(Code.org,2024)。更进一步,另一个例子是印度德里的学习者,他们应用计算机科学知识建造了一艘人工智能传感器船,为当地村民监测水质并保护水生动物(Kumar,2023)。

同样,使用AI解决问题也存在风险。开发人员需要意识到,算法会产生数据中已经存在的偏见,而所有数据都包含人类偏见。因此,评估训练数据的来源、背景和组织至关重要。人工智能系统可用的大部分训练数据来自互联网上的公共界面,其中白色和男性的比例过高(Buolamwini,2023; Noble,2018)。此外,用于训练这些模型的数据经常在未经作者或艺术家同意的情况下使用,这在诉讼中产生了法律的问题和挑战(Ingram,2023)。此外,开发人员必须确保人工智能系统的预测或产品的道德应用。这一点特别重要,因为对于人工智能系统,人类可能无法理解算法创建和使用的规则来做出决策。因此,在应用人工智能工具的预测来做出决策时,考虑价值观、信念和观点是很重要的。我们对我们使用的人工智能系统中的数据和算法了解得越多,我们就越能更好地决定是否以及如何使用它们。

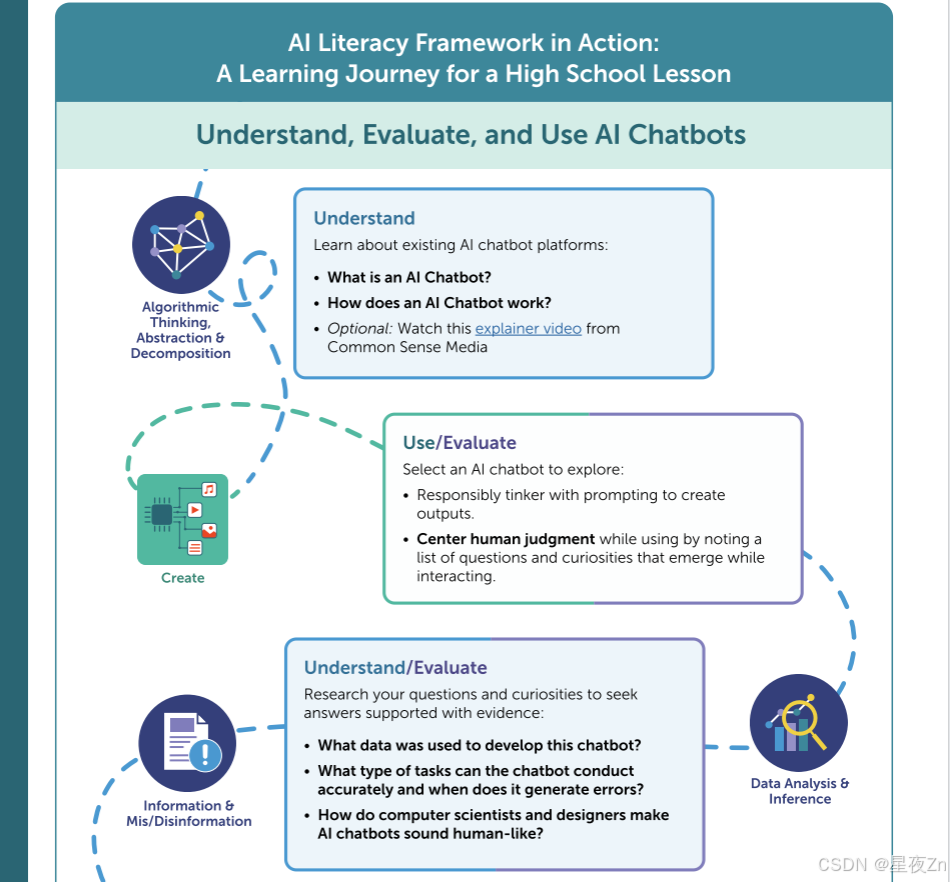

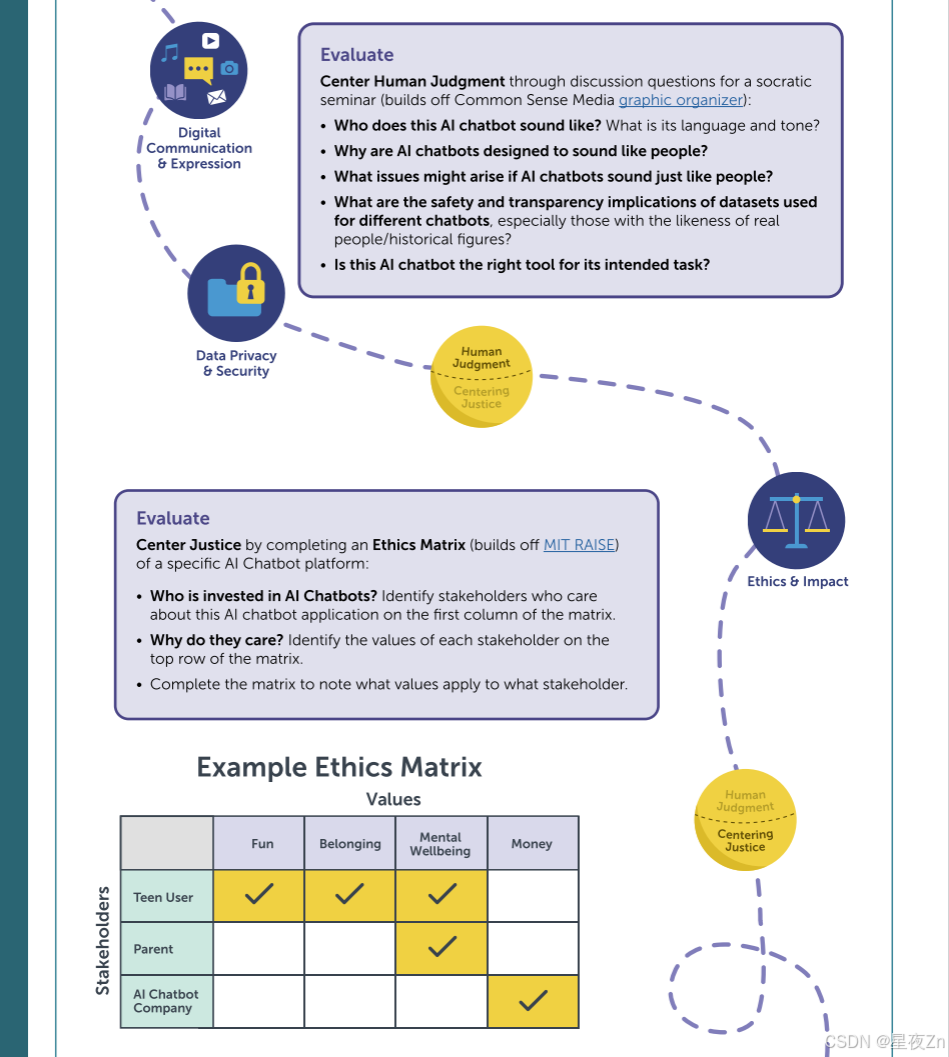

Putting It All Together

我们正在应用这个框架来支持教育工作者和领导者为特定受众设计人工智能素养学习体验。下图举例说明了一个高中生的行动框架,遵循三种参与模式的曲折路径。它展示了人工智能素养的参与是如何非线性和相互交织的,每种参与模式都是相互建立和加强的,以促进整体的人工智能素养。该课程示例基于常识媒体的6-12年级人工智能素养课程,具体来说,第3课:“人工智能聊天机器人:谁在屏幕后面?”(Common Sense Media,2024 b)。

虽然这个例子有助于我们理解高中的人工智能素养学习体验是什么样的,但有系统级的政策和结构可以使这些学习体验发生。在本文的第二部分,我们确定了系统领导者在K-12教育中促进AI素养的五种策略:为采用和评估提供指导,跨年级和学科领域学习整合AI素养,促进专业学习,设计强大的学习体验,以及促进意识和代理。

在K-12教育中促进AI素养的策略

人工智能素养已经成为每个人安全和道德地参与日益数字化的世界的一种技能。公立学校在将人工智能素养融入整个K-12教育中发挥着关键作用,以便我们当前和未来的社区能够意识到并能够批判性地评估人工智能系统。我们的人工智能素养框架提供了关于领导者如何设计人工智能素养计划的指导,以便用户可以在其环境中安全有效地使用,理解和评估人工智能工具。本节确定了在K-12教育中促进人工智能素养的五种策略,并为实施每种策略提供了示例和指导。

策略1:为评估和采用提供指导

Systems Leaders and Policymakers

政策制定者和学校领导需要与教育工作者、学生和家庭合作,制定在K-12教育中采用和评估人工智能工具的指南。教育工作者和家庭迫切需要这种指导,因为许多人工智能工具都有目的地试图直接向教师推销,而不是绕过他们的管理员(奥克斯,2021)。在选择采用或使用人工智能系统或工具时,需要考虑几个因素,包括可访问性和公平性、数据所有权和隐私、透明度和影响。Digital Promise在美国国家科学基金会的资助下沿着与教育领导人、技术专家、教师、学生和家庭共同设计了一个PK-12教育新兴技术采用框架,为知情评估和采购决策提供指导,包括工具的初始评估,以及采用和使用工具时应考虑的因素(Ruiz等人,2022年)的报告。

在制定可接受的使用政策以供采用和评估时,领导者应考虑以下几点:

- 包容性。提高边缘化社区在制定政策和指导方面的需求、兴趣和发言权,以确保所有学生都能使用人工智能工具,而不会使有害的偏见永久化。通过影响可及性、可负担性和采用率的举措,支持促进数字公平和可及性的政策和计划(Weaver,2022)。

- 适应性。每天都有新的人工智能系统和工具平台出现。指南应具有适应性,以便在新应用程序出现风险时对其作出反应。此外,人工智能系统和工具正在跨环境使用。虽然学校系统可以控制他们提供的技术,但他们对学生带到学校、在校外使用或在家里使用的技术的控制要小得多。负责任使用的指导方针和政策应促进在校内和校外的各种情况下负责任地使用。

- 影响力。了解在学习环境中集成人工智能系统和工具的影响,包括不同背景、能力和人口统计的学生之间的安全和公平。采取谨慎的方法,以您可以确保技术采用不会损害您负责的学生或他们的社区的速度进行。

- 意识、能动性和透明度。学区应要求可用的平台和功能,以促进个人对数据所有权和隐私的意识,以及机构选择退出。首席信息和技术官在管理数据隐私和安全风险方面取得了进展,随着新技术和平台的不断涌现,这些政策应保持灵活性。

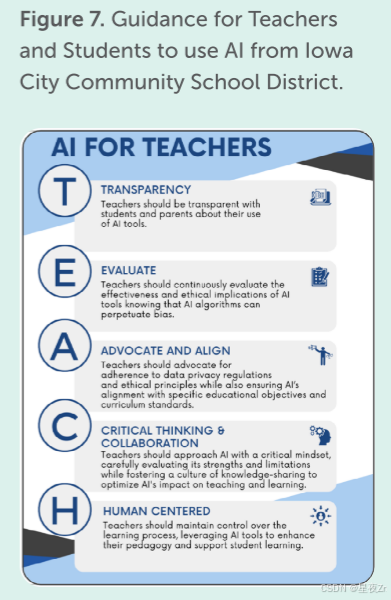

爱荷华州市社区学区为教师和学生提供指导

爱荷华州市社区学区正在为教师和学生制定人工智能负责任的使用指南。他们目前有几个GenAI工具可供教师使用,还有一个GenAI工具子集可供高中生使用。

为了为他们的地区制定负责任的使用指南,他们成立了一个由地区领导、学校领导和教师组成的工作组。邀请教育工作者加入委员会是他们响应性方法的核心,植根于教师的需要。该小组探索了工具,围绕安全,道德和负责任的使用进行了讨论,并为教师和学生提供了多份负责任使用指南草案的反馈。最终草案包括定义,允许使用人工智能,禁止使用人工智能,学生和工作人员的责任,对违规行为的回应,以及透明度和沟通等特殊考虑。

除了《负责任使用指南》,人工智能工作组还起草了教师和学生指南,如下图所示。这些文件旨在张贴在教室中,以便快速理解并提醒负责任的使用。他们总结了学生在使用人工智能进行学习时需要注意的问题,以及教师在利用人工智能进行教学设计时需要考虑的问题。

未来,爱荷华州市计划在全区范围内分享负责任的使用指南,并使其与学术行为准则和董事会政策保持一致。他们还计划为教师提供基础学习,建立一个范围和顺序,为学生提供使用人工智能工具时保持安全的知识,并从每栋建筑中确定一名教师来支持这项工作,为同事提供即时学习,并在课程规划,差异化和反馈/评估中共同设计生成人工智能的例子。

策略2:跨年级整合AI素养和学科领域学习

System and School Administrators

教育工作者必须将人工智能素养融入到他们已经教授的主题中,如数学和ELA。虽然图书馆媒体和计算机科学课程当然是可以培养AI素养基础技能和技术知识的课程,但将AI素养与学科领域学习相结合,可以让学生体验AI工具的跨学科应用。将人工智能素养跨学科整合是有利的,原因有几个。一个是图书馆媒体和计算机科学课程通常是选修课,不是所有学生都必须上的。计算机科学课程也不成比例地招收白色男性(Code.org等人,2023年)的报告。为了促进所有学生,特别是女性和有色人种学生的AI素养,将AI素养实践整合到数学和ELA等核心学科领域至关重要。将人工智能素养整合到各个学科的另一个原因是,要认识到它在引入新颖的教学策略和增强学习方面的潜力。例如,学生可以通过使用和评估文本到语音的系统来学习英语语言艺术中的同音异义词。如果找到了互补的整合点,人工智能素养就可以成为学科学习的增值,而不是已经排得很长的上学时间的附加值。最后,人工智能素养的跨学科整合使学生能够与人工智能的跨部门应用建立联系,这与他们的职业和劳动力意识和准备有关。

我们还建议,人工智能素养技能应该在整个K-12年级累积整合。在低年级,学生应该建立基本技能,而不必自己使用人工智能工具。例如,学生可以学习数学中的概率,描述数据中的模式和关系。他们可以在Scratch中开发一个程序(算法思维、抽象和分解),并确定在Scratch社区中共享他们的程序的含义(数据隐私和安全;数字通信和表达)。他们还可以在科学或社会研究课程中收集数据,并讨论样本包括和不包括的内容(数据分析和推断)。事实上,由于人工智能素养非常依赖于前面所述的现有计划,许多学校可能已经在致力于媒体素养、数字公民和计算思维的计划中开设了一些此类课程。培养这些基本技能对于准备学生在适合发展的情况下批判性地使用人工智能工具至关重要。我们可以从支持我们对这些基本技能的学习进展的理解的完善的工作体系中构建(Rich等人,2017年,Rich等人,2018年,Rich等人,2019)和跨学科和内容领域整合它们的策略(米尔斯等人,2024年)的报告。

对于什么年龄或年级最适合集成人工智能系统或工具,目前还没有直接的答案。联邦法律规定,学生可以创建自己的数字帐户的最低年龄为13岁,但这取决于系统,并非所有工具都需要创建帐户,或者有些工具可以由学生在教师或监护人的帐户下使用。我们建议教育工作者根据学生的发展里程碑、认知准备、上下文和使用目的,采取细致入微的方法将人工智能工具整合到学习环境中。此外,教育工作者应确保学生的个人数据受到保护,就如何严格意识到其使用和影响提供指导和监督,并就他们如何使用这些工具与家长和照顾者进行沟通。

塔拉德加县公立学校为AI扫盲设计K-12学习途径

塔拉德加县公立学校设计和实施了K-12累积,一致和基于能力的综合学习经验的计算思维。他们的CT途径是由每个年级的教师根据亚拉巴马数字素养和计算机科学标准开发的。塔拉德加继续扩大他们的CT途径,现在正在让教师设计专门整合人工智能素养的学习体验。

Learn more about:

- Designing K–12 Learning Pathways

- Talladega County’s Computational Thinking pathway, 计算思维

图8.整合算法思维的学习路径示例,中学跨学科领域的AI素养实践

策略3:促进持续、及时的专业学习

Instructional Leaders

将人工智能工具安全有效地整合到教育中取决于具备人工智能知识的教师。但是,假设教师将独自学习如何使用、理解和评估AI工具是不合理的。旨在提高AI素养的专业学习可以帮助教师了解如何促进AI素养技能发展。教师的人工智能素养是双重的。教师需要通晓如何使用AI工具进行教学。在教学方面,他们可能会专注于课程规划、智能内容创建或评分。对学习的关注包括促进强大的学习体验,促进学生发展AI素养技能,以及搭建和支持学生利用AI工具进行学习。只有教师具备使用人工智能的素养,人工智能才能在教与学中得到合乎道德和有效的使用。

为整合GenAI等新兴技术提供专业学习所面临的一个挑战是,沿着教师的支持需求,新的工具和平台在不断发展。在与全国各地的地区合作中,Digital Promise发现,这些地区正在设计专业的学习结构,以满足这些需求,并超越传统的研讨会。这些专业学习生态系统利用现有的系统和结构,是可持续的,提供点人员,并包括环绕式支持(Coenraad等人,2024年)的报告。我们将在下文详细介绍具体地区正在使用的示例和策略。

地区支持教师整合AI素养

布劳沃德县公立学校已经将人工智能扫盲讲习班整合到教师现有的专业学习机会中。在这些讲习班中,教师们学习什么是人工智能,讨论道德规范,探索可以在不同学科领域和年级进行的课程。他们参与实践学习机会,以发展人工智能素养技能(无论是插电还是不插电)。教师们合作起草AI权利法案(例如EngageAI权利法案工作组,2024),以指导AI在教学和学习中的最佳实践。最后,他们合作设计课程,将人工智能工具整合到课堂中,并得到专家辅导员的及时支持。

为了对新兴的人工智能平台以及每个平台的可提供性和风险保持快速响应,布劳沃德和其他学区正在扩展专业学习系统,超越传统的基于研讨会的方法(Coenraad等人,2024年)的报告。下面,我们列举了几个教师支持的例子,这些例子是对传统研讨会的补充,是长期持续的,并为教师提供及时的支持。

- 精选教学资源。在布劳沃德县公立学校,STEM+CS项目提供了一套精心策划的资源,这些资源已经过地区工作人员的审查,并定期更新,供教师和学校领导使用,消除了寻找材料以整合人工智能素养的障碍。

- School-Based Champion。塔拉德加County Schools和爱荷华州City Community School District都在每所学校内配备了一名支持者,作为倡导和领导学校建筑内AI扫盲工作的关键人物。

- 内容和等级相同的合作者。北塞勒姆中央学区正在利用他们作为一个小区的背景,以支持跨年级和内容领域的全区专业学习,使教师可以转向对方作为合作伙伴和协作者。

策略4:设计强大的学习体验

Teachers and Instructional Leaders

学习技术是通过教学透镜制定的(米什拉和科勒,2006),人工智能也不例外。也就是说,技术可以用于促进批判性思维,探索和创造性表达的方式。在人工智能的情况下,这可能包括利用ChatGPT等LLM来集思广益。相反,人工智能还可以用于技能和训练练习或标准化评估。例如,算法通常用于在计算机上个性化推荐标准化学习内容。我们支持国家教育技术计划的建议,以促进批判性思维、协作、创造力和沟通的方式整合人工智能等技术,以缩小数字使用鸿沟(美国教育部,2024年)。

如果以这种方式使用,人工智能工具有可能促进强大的学习体验(Digital Promise,2024)。强大的学习体验包括:

强大的学习体验将人工智能工具整合在一起,以促进学习者代理、开放式问题解决和人际联系(Resnick,2024)。学习科学研究提供了一个有价值的透镜,通过它来理解人工智能工具如何能够促进强大的学习,同时考虑到学习的社会性、协作性观点,而这些观点并不总是通过典型的测试来衡量的(Fusco等人,2020年)的报告。学习科学可以帮助我们理解人工智能工具应该如何支撑或增强学习者的批判性思维、创造力、协作和创造力的能力,而不是取代或阻碍它。

教育工作者应该帮助学生理解和批判性地评估AI工具,每次他们被整合到学习环境中。例如,一堂课可能需要学生从个人经验或情商中提取信息来编辑来自GenAI系统的响应,这必然要求学生评估输出。Druga等人(2021)发现,儿童对AI的批判性意识的一种方式是试图“欺骗AI”。例如,他们画一些无意义的图像来“欺骗”图像识别系统,戴上面具来“欺骗”面部识别系统。欺骗系统揭示了设计者的缺陷和偏见。用户可以评估设计师重视什么,忽略什么。以这种方式设计课程也消除了人们对人工智能工具不当行为的担忧,例如剽窃或不恰当地使用技术来学习新想法,这可能充满了错误信息。我们在下面的课堂实践中详细阐述了一个更具体的例子。

然而,由于教室内和教室之间的环境和学生需求的差异,这些设计和实现中的每一个都会略有不同。考虑到这种差异,重要的是政策要定位教师,谁是环境专家,在某种程度上,让他们安全地为他们的特定学生设计。应利用教师的专业知识来微调用于教学和学习的人工智能工具的更广泛实施,地区政策和程序应促进这一点。

特殊教育课程利用AI工具来支撑写作

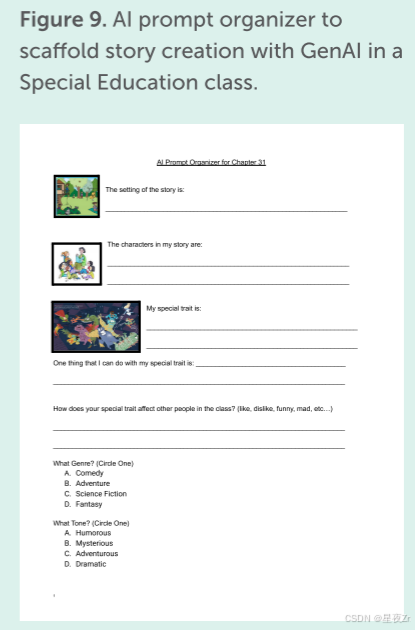

Matthew Jones先生是Suffern Central School District的一名中学教师,他在自己的Foundation教室里使用了ChatGPT,这是一个特别关注学生核心学术技能的计划,这些学生的个性化教育计划(IEP)明显低于年级水平。该课程的目的是通过内化故事的关键要素(例如,人物、背景、情节、体裁、语气等)来支持阅读和写作技能。在此活动之前,学生通过识别短篇小说中的关键元素来练习这项技能。下一步是让学生通过生成自己的故事元素来应用他们的学习。

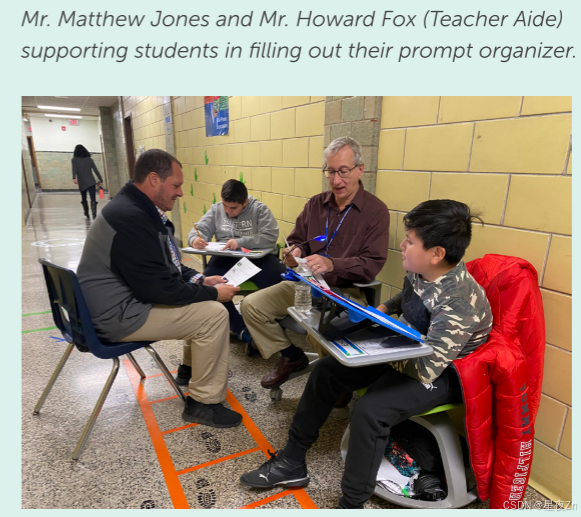

受到课堂上阅读的短篇小说的启发,学生们被要求创作自己的故事,并添加他们选择的超能力。他们使用了一个“人工智能提示组织者”,教师将其输入ChatGPT,同时删除任何个人身份数据,要求它使用学生头脑风暴的细节生成一个故事。然后学生们练习阅读的流畅性,兴奋地背诵一个关于他们自己想法的故事,并分析输出以进行编辑。为了进一步巩固这一课,明年的学生将绘制他们的故事的图片,并使用AI图像动画制作它。

这个用例为写作教学提供了支架式的支持,特别是考虑到这门课的学生经常为构建段落的耐力而奋斗。琼斯先生解释说:“由于12:1:1课程的学生的性质,能够为自己写完整的故事是一个目标,这将需要许多,许多周或数月的写作和修改。这是一项将消耗整个季度或更多时间的任务。通过使用ChatGPT作为辅助技术,学生们能够学习并使用故事元素来写一个他们可以为之自豪的故事,这个故事是动态的,个人的,独特的。

本课强调了为学习而设计,因为人工智能工具为创造性表达创造了机会,鼓励学生看到自己想法的巨大潜力。在这种情况下,ChatGPT的产出为有不同需求的学生扩大了学习机会。教师确保故事以学生的声音为中心,提示组织者搭建了提示生成的脚手架。值得注意的是,Jones先生控制了输入ChatGPT的信息,以保护学生隐私并遵守平台的年龄限制。这是一个团队的努力,使之成为可能的教学团队,包括:霍华德福克斯(教师助理),简托兰斯(视觉教师),JD Wissner(教师助理),和Vicky马查多(ENL教师)。

策略5:提高认识和促进机构

Leaders, Teachers, Learners, Caregivers, and Community Members

由于人工智能素养是每个人的技能,学校和地区不仅可以支持他们的学生,还可以支持家庭和护理人员及其更广泛的社区了解人工智能工具的使用方式,并了解他们在决定是否以及如何使用它们来影响他们的生活和社会时所拥有的机构。这包括提高对人工智能工具如何延续和加剧我们社会中现有不平等的批判意识,提高对算法偏见的认识,并倡导改变我们社会中围绕算法和自动化的政策。

我们为学生、教师和护理人员确定了以下策略,以在使用人工智能工具时提高认识和代理:

- 学习.信息就是力量,随着对人工智能工作原理的了解不断增加,人们对人工智能工具的认识和了解也在不断增强。应以无障碍的方式和语言为学生、教师和护理人员提供了解人工智能及其在教育中应用的机会。

- Communicate.学区有责任向家长和照顾者透明,说明AI技术在学校的使用情况,包括数据隐私和所有权以及算法的决策权。父母和看护者应该有机会了解这些人工智能工具,然后有机会选择使用或不使用。

- 提问。新兴技术有许多未知数,大多数人可能不知道应该问什么问题,以促进人工智能工具的安全和道德应用。学校和学区应该开发资源,帮助学生、教师和护理人员了解应该问什么问题,以及到哪里去获取更多信息。

- 倡导。新兴技术的发展伴随着未知的风险。我们都有责任了解我们在数据隐私和所有权方面的权利,以及人工智能工具的决策权。我们知道,在某些情况下,政策和指导将对违规行为作出反应,我们应该积极创造空间,在这一不断发展的技术格局中倡导我们自己的权利和保护。

Students Teach Parents at Ballard High School MisinfoNight

MisinfoDay是由华盛顿大学信息学院主办的年度媒体素养教育活动,旨在教高中学生,教师和图书馆员评估在线信息。此后,它扩大了其资源库,以支持教育工作者在校园内举办自己的MisinfoDay活动。在西雅图巴拉德高中的MisinfoNight期间,社区参与取得了成功,教师们计划并举办了一场活动,邀请家长、护理人员和社区中的其他成年人向300名9年级世界历史学生学习,主题包括确认偏差、算法的影响、人工智能生成的深度假图像以及评估信息可靠性的方法。该活动设置了互动显示器和由学生提出的站。

在晚上结束时,学生们甚至要求家庭成员和与会者拿出他们的手机,在网上的帖子样本上练习他们的新知识。

Learn more about:

- MisinfoDay Resource Library

- NPR Article about MisinfoDay: AI images and conspiracy theories are driving a push for media literacy education •

- MisinfoNight at Ballard High School

Conclusion

我们的AI素养框架旨在为不同背景的教育领导者提供信息,以决定如何设计学习机会来促进AI素养。为了更好地了解如何促进人工智能素养,我们从媒体素养,数据素养,数字公民身份和计算思维的基础工作开始。我们强调,理解、评估和使用人工智能是相互支持的参与模式。此外,理解和评估人工智能,同时以人类的判断和正义为中心,对于在不同的背景下是否以及如何使用人工智能做出明智的决定至关重要。

我们为领导者、教育工作者、学习者和家庭提出了五项策略,以促进所有人的人工智能素养。这些策略包括为采用和评估提供指导,跨年级和学科领域学习整合人工智能素养,促进专业学习,设计强大的学习体验,以及促进意识和机构。人工智能素养为我们提供了一套技能,以促进个人机构和意识,以便就如何利用人工智能工具为个人和社会利益做出明智的决定。

展望未来,我们呼吁并寻求支持为教育工作者、学习者和家庭开发更多的资源和指导,帮助他们做出明智的决定,决定是否以及何时在各种情况下整合支持人工智能的系统和工具,以及如何在学习者这样做时为他们提供适当的支架。

以上内容全部使用机器翻译,如果存在错误,请在评论区留言。欢迎一起学习交流!

如有侵权,请联系我删除。xingyezn@163.com

1137

1137

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?