Deep Active Learning for Efficient Training of a LiDAR 3D Object Detector

文章目录

简介

论文标题

- Deep Active Learning for Efficient Training of a LiDAR 3D Object Detector

- 深度主动学习对LiDAR三维目标探测器的有效训练

- 2019 IEEE Intelligent Vehicles Symposium

贡献

- 我们提出了一种深度主动学习方法,大大减少了使用LiDAR点训练3D对象检测器的标注工作量。据我们所知,我们首次尝试将深度主动学习引入到自主驾驶的3D环境感知中

- 该方法充分利用了RGB图像中的二维目标方案,减小了感兴趣目标的搜索空间,加快了学习过程

- 比较了几种量化神经网络中不确定性的方法,并研究了它们对查询信息丰富的无标记数据的效率

目标检测模型是2阶段的,有softmax,利用softmax算不确定性

计算不确定性的方法有利用模型集成和drop out着两种,实验证明比直接用softmax好

根据图片的不确定性去找3d点云的数据,预测模型是自己的搭建的

摘要

训练用于自动驾驶的深层目标检测器需要大量的标记数据。虽然通过车载传感器(如相机或LiDAR)记录数据相对容易,但注释数据非常繁琐和耗时,尤其是在处理3D LiDAR点或雷达数据时。主动学习有可能最大限度地减少人工注释工作,同时最大化对象检测器的性能。在这项工作中,我们提出了一种主动学习方法来训练LiDAR 3D目标检测器,所需的标签训练数据最少。该检测器利用从RGB图像生成的2D区域建议来减小目标的搜索空间,并加快学习过程。实验表明,该方法适用于不同的不确定性估计和查询函数,在达到相同的网络性能的情况下,可以节省高达60%的标注工作量。

初步

近年来,深度学习已经为许多开放数据集(如Kitti[1],Cityscapes[2])上的目标检测任务设定了基准,并已成为自动驾驶中事实上的感知方法。尽管性能很高,但训练深层目标检测器通常需要大量的标记样本。注释过程是乏味和耗时的工作,特别是对于3D LiDAR点(如[3]中所讨论的),因此有必要开发减少标记工作量的方法。此外,优化深层目标检测器的一种常见方法是将所有训练样本以随机洗牌的方式馈送到网络中。然而,每个训练样本的信息量是不同的,即一些训练样本的信息量更多,对性能增益的贡献更大,而另一些训练样本的信息量较少。一种更有效的训练策略是只使用信息量最大的样本来优化网络。当使对象检测器适应与先前训练集不同的新驾驶场景时,例如从高速公路到城市场景,这特别有帮助。

主动学习是一种训练策略,旨在减少人工注释工作,同时最大化机器学习模型的性能(通常以监督学习方式)[4]。在主动学习中,模型迭代地评估未标记数据的信息量,选择要由人工注释员标注的信息量最大的样本,并用新标注的数据更新训练集。主动学习长期以来被应用于支持向量机(SVM)或高斯过程(GP)[5]-[7],直到最近才被用于深度学习,用于遥感中的医学图像[8]或高光谱图像的分类[9]、2D图像检测[10]、[11]、道路场景图像分割[12]和自然语言处理[13]。

在这项工作中,我们提出了一种主动学习方法来有效地训练用于自动驾驶的LiDAR 3D对象检测器,如图1所示。我们假设存在大量未标记的LiDAR点云数据池,因为使用测试车辆收集和准备LiDAR数据相对容易。我们利用网络的预测不确定性来量化未标记数据池中每个样本的信息量,并假设网络可以迭代地向人类注释器查询对象的类别标签和三维几何信息。此外,由于使用2D RGB图像进行人工标注要比使用3D点云容易得多,并且存在许多具有高召回率的预先训练的图像检测器(例如Detectron[14]),因此我们建议利用图像检测器 image detector来提供2D对象建议,作为定位对象的种子,这样人类注释者只需要标记圆锥体内的LiDAR点(见图1)。通过这种方式,可以进一步减少3D标记的工作量,并且可以提高学习过程的速度。在实验中,我们通过假设一个能够提供准确目标建议的“完美”图像检测器或者通过现成的预先训练好的图像检测器来评估我们的方法。结果表明,在两种实验设置下,我们的方法都优于基线方法。

图片来自相机: 对图片进行检测,然后由图片到点云的锥形区域作为要标记的区域,然后进行标记

图1:我们提出的有效训练LiDAR 3D对象检测器的主动学习方法。该探测器基于来自图像的2D方案,作为种子,在LiDAR 3D空间中定位对象作为锥体(frustums)。我们假设存在一个大型的未标记的LiDAR点云数据池。对象检测器迭代地使用预测不确定性来量化未标记数据池中每个样本的信息量,向人类注释器查询对象的类别标签和3D几何信息,并用新标记的数据更新训练集。我们通过人工标注人员提供的“完美”图像建议,以及具有高召回率的现成预先训练的图像检测器来验证我们的方法。

相关工作

在这一部分中,我们简要地总结了基于LiDAR点的自动驾驶深度目标检测以及深度主动学习方面的现有工作。

基于激光雷达测点的自动驾驶目标检测

大多数无人驾驶汽车都配备了多个传感器,如摄像头和激光雷达。因此,已经提出了许多方法来利用摄像机图像[15]-[17]、激光雷达点云[18]-[22]或者两者的融合来利用它们的互补特性[23]-[26]进行目标检测。

最先进的深层目标检测网络采用两级检测(两阶段检测)和一级目标检测(一阶段检测)两条流水线。在前一种流水线中,从场景中提取多个被称为感兴趣区域(ROI)或区域建议(RP)的候选对象。然后,根据分类分数和位置对这些候选对象进行验证和细化。例如,Asvadiet al.[27]使用DBSCAN对地面障碍物的LiDAR点进行聚类。然后,这些簇被馈送到ConvNet中用于2D检测。Chenet等人[23]提出通过区域建议网络(RPN)从鸟瞰LiDAR特征地图生成3D感兴趣区,并将来自前视图LiDAR特征地图的区域特征与RGB相机图像相结合用于3D车辆检测。在后一条流水线中,使用单级统一的CNN模型直接将输入特征映射到检测输出。Liet al.[19]和Y Anget al.[28]利用LiDAR点云上的全卷积网络(FCN)生成了一个目标图和几个包围盒图。Caltagironeet al.[29]使用FCN进行道路检测。在这项工作中,我们遵循两阶段目标检测流水线**:2D区域建议由摄像机图像提供,网络使用对应的平截体(图1)中的LiDAR点来检测目标,类似于[26]。

深度主动学习

主动学习在机器学习界有很长的历史(由[4]提供了一项全面的调查),并于2015年被引入深度神经网络[8]。虽然在图像分类[8]、[9]、[30]和分割问题[12]、[31]、[32]方面有很多工作,但对二维图像检测[10]、[11]的研究还很少。与这些工作相比,本文首次尝试在三维目标检测问题中进行主动学习。

有许多方法可以查询未标记的数据,例如减少方差、按委员会查询和预期的模型更改[4]。其中,基于不确定性的方法建议用预测不确定性来表示数据的信息量,并对不确定性最高的样本进行查询。这一策略的有效性自然取决于获得可靠的不确定性估计。最近的许多方法都聚焦于在深度神经网络中以一种有效的方式获得这样的估计。例如,Lakshminarayananet等人[33]提议使用网络集合来预测不确定性。Kendallet等[34]在贝叶斯神经网络中将预测不确定性分解为模型依赖(认知)和数据依赖(任意)不确定性。前者是通过蒙特卡罗丢包抽样[35]获得的,而后者是通过预测输入数据中的噪声来获得的。Guoet等人[36]使用一种简单的校准技术来提高网络的概率输出。这些不确定性的应用也出现在最近的许多著作中。例如,Milleret等人[37]在开放场景中使用认知不确定性进行目标检测。Fenget等人[38]评估了LiDAR 3D目标检测网络中的不确定性估计,并利用任意不确定性显著提高了网络对噪声数据的稳健性[22]。Ilget al.[39]比较了光流(optical flow)中几种不确定度估计方法。在这项工作中,我们使用Monte-Carlo Dropout[35]和Deep集成Deep Ensembles[33]来估计不确定性,并比较它们在查询函数中的效率。

37 Dropout sampling for robust object detection in open-set conditions

38 Towards safe autonomous driving: Capture uncertainty in the deep neural network for lidar 3d

vehicle detection

方法论

在这项工作中,我们提出了一种主动学习方法,在给定大量的未标记数据池的情况下,使用最少的已标记训练样本来迭代训练3D LiDAR检测器。

表示由Nui.d个数据样本Du={Xun}Nun=1和已标记的训练数据集Dl组成的大的未标记数据池ASDU,其中Nl个样本(Nu?Nl)及其标签Dl={Xln,yln}Nl=1。还将人类注释器表示为A和目标检测模型ASm。我们的方法在ALG中进行了总结。1.该方法的关键是神经网络中的不确定性估计和数据查询功能。

表示由

N

u

N^{u}

Nu个iid的数据样本

D

u

\mathcal{D}^{u}

Du,

D

u

=

{

x

n

u

}

n

=

1

N

u

\mathcal{D}^{u}=\left\{\mathbf{x}_{n}^{u}\right\}_{n=1}^{N^{u}}

Du={xnu}n=1Nu,

N

l

N^{l}

Nl个已标记的训练数据集

D

l

\mathcal{D}^{l}

Dl , $ left(N^{u} \gg N^{l}\right)$

及其标签

D

l

=

{

x

n

l

,

y

n

l

}

n

=

1

N

l

\mathcal{D}^{l}=\left\{\mathbf{x}_{n}^{l}, \mathbf{y}_{n}^{l}\right\}_{n=1}^{N^{l}}

Dl={xnl,ynl}n=1Nl .

还将人类注释器表示为$ A$ 目标检测模型$ M $. 我们的方法在 Alg. 1中进行了总结. 该方法的关键是神经网络中的不确定性估计和数据查询功能

重点看怎么估计不确定性的

Process

为了开始主动学习过程,用一个小的标记数据集Dl在循环中训练来初始化网络。在每次训练之后,检测器通过预测不确定性来评估未标记数据集中每个样本的信息量(ALG中的步骤2)。1),通过查询功能选择信息量最大的样本(步骤3),并向人工注释员询问它们的类别标签和对象位置(步骤4)。然后,这些样本被添加到标记的数据集,并且检测器被重新训练。该过程反复进行,直到满足停止条件,例如,网络的性能在几次迭代中收敛,或者达到期望的性能。

3D物体探测器

投入和产出:如导言中所述(参见。I),我们的检测器利用RGB图像中的2D区域建议,在3D空间中构建圆锥体。我们将这些圆锥体中的LiDAR点投影到前视相机平面上,并构建稀疏的LiDAR深度和强度图(intensity maps)。由于这些地图带来了互补的LiDAR信息(见图2),我们将它们连接起来以构建网络输入。注意,我们不执行内插 interpolation (例如,Delaunay三角剖分[27]和双边滤波[40])以避免内插伪影interpolation artifacts。网络输出Softmax分类分数和对象位置t。我们将对象的3D位置编码为边界框的相对宽度ˆw=w/wmax,长度ˆl=l /lmax,高度ˆh=h/hmax,以及我们的自主车辆和物体质心之间的欧几里得距离ˆd=d/dmax,即T={ˆw,ˆl,ˆh,ˆd}。我们基于数据集中的启发式算法选择wmax、lmax、hmax、dmax。

网络体系结构:我们的对象检测器建立在图2所示的ConvNet上,它由四个卷积层(每个有32 3×3个内核并激活REU)、一个池层、三个完全连通层(每个有256个隐藏单元)和三个丢失层组成。丢弃层用于训练过程中的随机正则化和测试过程中的不确定性估计。

网络架构。检测器将LiDAR深度和强度贴图作为输入,并输出客观性分数和对象位置信息(宽度、长度、高度和深度)。

不确定度估计和查询功能

不确定度估计 在这项工作中,我们使用分类中的预测概率p(y|x)来估计目标检测网络中的不确定性。为简化起见,我们将其表示为数据点和分类标签。获得预测概率的直接方法是通过Softmax输出,即P(y|x)=sofTmax(X)。然而,正如在一些工作(例如,[35],[30])中所讨论的,Softmax输出可能会将高概率分配给之前没看见unseen data的数据,从而导致过度自信的预测。因此,我们还使用了两种最新的方法来获得不确定性估计,即蒙特卡罗辍学(MC-Dropout[35])和深度系综法(Deep Ensembles[33])。

35 Uncertainty in deep learning

30 The power of ensembles for active learning in image classification

33 Simple and scalable predictive uncertainty estimation using deep ensembles

MC-Dropout[35]将丢弃正则化视为贝叶斯神经网络框架中的近似变分推理,并通过在测试期间执行多个丢弃激活的前馈通道来提取预测不确定性。更具体地说,在给定测试点x的情况下,网络以与训练相同的丢失率执行T次inference,并对输出进行平均以近似预测概率:

p

(

y

∣

x

)

≈

1

T

∑

t

=

1

T

p

(

y

∣

x

,

W

t

)

=

1

T

∑

t

=

1

T

softmax

(

W

t

)

(

x

)

p(\mathbf{y} \mid \mathbf{x}) \approx \frac{1}{T} \sum_{t=1}^{T} p\left(\mathbf{y} \mid \mathbf{x}, \mathbf{W}_{t}\right)=\frac{1}{T} \sum_{t=1}^{T} \operatorname{softmax}_{\left(\mathbf{W}_{t}\right)}(\mathbf{x})

p(y∣x)≈T1t=1∑Tp(y∣x,Wt)=T1t=1∑Tsoftmax(Wt)(x)

wt是第t次神经网络推断的权重

利用droup out 算不确定性.

与MC-dropout相比,深度集成[33]以非贝叶斯的方式估计了预测的不确定性。它建议对多个具有相同体系结构但随机初始化的网络进行训练,并在测试过程中对网络的输出进行平均。假设E为集合的数量,表示Me集合中的单个网络,类似于公式。1.我们有:

p

(

y

∣

x

)

≈

1

E

∑

e

=

1

E

p

(

y

∣

x

,

M

e

)

=

1

E

∑

e

=

1

E

softmax

(

M

e

)

(

x

)

p(\mathbf{y} \mid \mathbf{x}) \approx \frac{1}{E} \sum_{e=1}^{E} p\left(\mathbf{y} \mid \mathbf{x}, \mathbf{M}_{e}\right)=\frac{1}{E} \sum_{e=1}^{E} \operatorname{softmax}_{\left(\mathbf{M}_{e}\right)}(\mathbf{x})

p(y∣x)≈E1e=1∑Ep(y∣x,Me)=E1e=1∑Esoftmax(Me)(x)

利用多个模型算不确定性.类似差分

查询函数:基于上述获得预测概率的方法,我们可以计算未标记数据池中每个样本的信息量(或不确定性),并使用获取函数来查询最不确定的样本。常用的方法是用以下方法测量香农熵(SE)[41]:

H

[

y

∣

x

]

=

−

∑

c

=

1

C

p

(

y

=

c

∣

x

)

log

p

(

y

=

c

∣

x

)

\mathcal{H}[\mathbf{y} \mid \mathbf{x}]=-\sum_{c=1}^{C} p(y=c \mid \mathbf{x}) \log p(y=c \mid \mathbf{x})

H[y∣x]=−c=1∑Cp(y=c∣x)logp(y=c∣x)

就是熵的函数

此外,由于MC-Dropout和Deep集成都提供了来自预测概率分布

p

(

y

∣

x

,

W

t

)

or

p

(

y

∣

x

,

M

e

)

p\left(\mathbf{y} \mid \mathbf{x}, \mathbf{W}_{t}\right) \text { or } p\left(\mathbf{y} \mid \mathbf{x}, \mathbf{M}_{e}\right)

p(y∣x,Wt) or p(y∣x,Me)的样本,因此我们可以使用它们来测量模型权重和类别标签之间的互信息(MI)[8],并查询具有最高MI的未标记数据。使用MC-Dropout的互信息通过以下方式计算:

I

[

y

;

W

]

=

H

[

y

∣

x

]

−

E

p

(

W

∣

D

′

)

H

[

y

∣

x

,

W

]

≈

H

[

y

∣

x

]

+

1

T

∑

t

=

1

T

∑

c

=

1

C

p

(

y

=

c

∣

x

,

W

t

)

log

p

(

y

=

c

∣

x

,

W

t

)

\mathcal{I}[\mathbf{y} ; \mathbf{W}]=\mathcal{H}[\mathbf{y} \mid \mathbf{x}]-\mathbb{E}_{p\left(\mathbf{W} \mid \mathcal{D}^{\prime}\right)} \mathcal{H}[\mathbf{y} \mid \mathbf{x}, \mathbf{W}] \\ \approx \mathcal{H}[\mathbf{y} \mid \mathbf{x}]+\frac{1}{T} \sum_{t=1}^{T} \sum_{c=1}^{C} p\left(y=c \mid \mathbf{x}, \mathbf{W}_{t}\right) \log p\left(y=c \mid \mathbf{x}, \mathbf{W}_{t}\right)

I[y;W]=H[y∣x]−Ep(W∣D′)H[y∣x,W]≈H[y∣x]+T1t=1∑Tc=1∑Cp(y=c∣x,Wt)logp(y=c∣x,Wt)

指的是原始模型的熵减去drop或多个模型的熵的差值?

I(y,w)=H(y)-H(y|w),就是不知道w的时候的熵减掉知道w的时候的熵

知道w就是值要么是drop out 得到的,要么是Deep Ensembles 得到的

其中, p ( W ∣ D ′ ) {p\left(\mathbf{W} \mid \mathcal{D}^{\prime}\right)} p(W∣D′)表示给定训练数据集Dl的网络权重W的后验分布。对于Deep Ensembles,我们只需要用M替换W。正如我们之前的工作[38]中所讨论的,SE和MI捕获了不确定性的不同方面:SE衡量的是输出不确定性(预测不确定性),而MI衡量的是模型对数据的信心(认知不确定性)。

Towards safe autonomous driving: Capture uncertainty in the deep neural network for lidar 3d vehicle detection

实验结果

实验设计

我们基于两个实验设置对我们提出的方法进行了评估。在第一个实验中,我们研究了不同不确定性估计方法和查询函数下的主动学习性能。为了避免RGB图像检测器的影响,我们假设一个“完美的”图像检测器,它只提供准确的目标建议。这是通过使用其地面实况标签提取对象来实现的。因此,我们将这种设置中的目标检测问题简化为分类和位置回归问题。在第二个实验中,我们使用预先训练的图像检测器来预测包含目标或背景图像的区域建议。

这两个实验都是在Kitti数据集[1]上进行的。LiDAR深度和强度贴图是通过将LiDAR点投影到图像平面上生成的,然后扭曲到100x100像素,并额外填充5个像素以包括上下文信息,类似于[42]。为了开始主动学习过程,用从训练数据中随机选择的一些样本来训练网络,并在所有类(每个类200个样本)上进行平衡。网络使用ADAM优化器进行训练,并结合丢弃和L2正则化来防止过拟合。我们设置丢失率为0.5时,权值衰减为10−4。在每个查询步骤中,从剩余的“未标记”训练数据集中选择2 0 0个样本,然后从零开始重新训练网络。在每个查询步骤中,我们计算测试数据集的分类准确率和均方误差(MSE),以分别跟踪分类和定位性能。为了对不同的不确定度估计方法进行公平的比较,对MC-Dropout方法进行了评估,对测试数据集进行了无丢弃的单次前向传递。我们也只使用集合中一个网络的预测进行评估。对于MCDropout,在推理过程中使用了20个前向传递,而集成由5个分类器组成。我们将查询步骤数固定为60步,每个实验重复3次。此外,我们还报告了一个经过全面训练的网络的性能。

“完美”RGB图像探测器的评价

**设置:**我们将物体分为五类,即“小型车辆”(包括Kitti中的“汽车”和“面包车”类别)、“人”(包括“行人”、“坐着的人”和“骑自行车的人”)、“卡车”、“有轨电车”和“杂物”。我们将数据集随机分为31500个样本的训练集、6000个样本的测试集和3000个样本的VAL集。

我们将主动学习策略与基线方法进行了比较,基线方法按照均匀分布随机查询未标记的数据点。我们还使用五种不同的查询函数研究了主动学习的行为。“Softmax+Entropy”、“MC-Dropout+Entropy”和“Enexble+Entropy”使用相同的查询函数来最大化Shannon熵。“MC-丢弃+MI”和“集成+MI”通过最大化互信息来查询数据。

主动学习成绩:结果如图3所示。我们有三个观察结果:(1)所有主动学习方法在分类和本地化任务上的表现都显著优于基线方法。在训练数据数量与基线方法相同的情况下,它们可以获得更高的识别精度或更低的均方误差。(2)在数据量相对较少(例如,<7000个样本)的情况下,基于MI的查询函数(“MC-Dropout+MI”和“Enemble+MI”)在定位任务(图3(B))中的表现始终好于它们的熵对应函数(“MC-Dropout+Entropy”和“Intemble+Entropy”),而基于熵的方法更适合于分类任务(图3(A))。(3)与使用单一Softmax输出(参见“Softmax+Entropy”、“MC-Dropout+Entropy”和“Enexble+Entropy”)相比,使用MC-Dropout和Deep集成来估计不确定性会产生略好的主动学习结果(参见“Softmax+Entropy”、“MC-Dropout+Entropy”和“Enexble+Entropy”)。

理解主动学习是如何工作的:

我们提出的方法是建立在良好的不确定性估计的基础上的。更好的不确定性分数可以更好地代表数据的信息性,从而导致更好的主动学习表现。在这一点上,我们使用校准曲线图和误差曲线来评估预测不确定度的质量,类似于[30]和[39]。此外,我们还研究了查询样本的类分布。

校准图:校准图是模型的预测概率和观测到的正确预测频率之间的分位数-分位数图(QQ图)。校准好的不确定度估计应该与正确预测的频率相匹配,以对角线表示。例如,当经过良好校准的网络用概率输出p(y=c|x)=60%来预测它们时,60%的样本应该被正确地分类为类别c。我们在测试数据集上比较了单一Softmax(“Softmax+Entropy”)、MC-Dropout(“MC-Dropout+Entropy”)和深度集成(“Ensemble+Entropy”)的不确定性估计。查询步骤5、15、30、55的校准曲线图如图4左四图所示,右图为校准误差随查询步骤的演变情况。校准误差以频率与对角线之间的平均绝对偏差计算。图中显示,在最初的几个查询步骤中,所有方法都对预测“信心不足”,因为它们的校准曲线图都在对角线之上。这表明网络的拟合不足,只有少量的训练样本。随着查询步长的增加,MC-Dropout和Deep系综的预测不确定性会得到很好的校准。然而,使用单一Softmax的网络被证明与数据过度拟合,并产生过度自信的预测,导致在对角线下出现校准图。实验表明,与单一的Softmax集成相比,MC-Dropout和Deep集成能够产生更可靠的不确定性估计,并能更好地改善学习性能。

误差曲线:评估预测不确定度质量的另一种方法是通过误差曲线(或[39]中提出的“稀疏化图”)。它假设一个估计良好的预测不确定度应该与真实误差相关,通过逐步去除高不确定性的预测,其余预测的平均误差将会降低。在我们的问题中,我们使用交叉熵损失来表示误差。图6(A)示出了在特定查询步骤处的“集合+熵”的示例性误差曲线。该基准是通过根据预测的交叉熵损失(真实误差)对预测进行阈值来获得的。请注意,对于每种不确定性估计方法,我们都会获得不同的基准。因此,我们计算误差曲线与其基准之间的平均绝对偏差,记为“误差和”,以便对不确定度估计的质量进行公平的比较。图6(B)说明了单个Softmax、MC-Dropout和Deep合奏在查询步骤中的“误差和”的演变。MC-Dropout和Deep集成都以较小的误差和一致地优于单一Softmax方法。

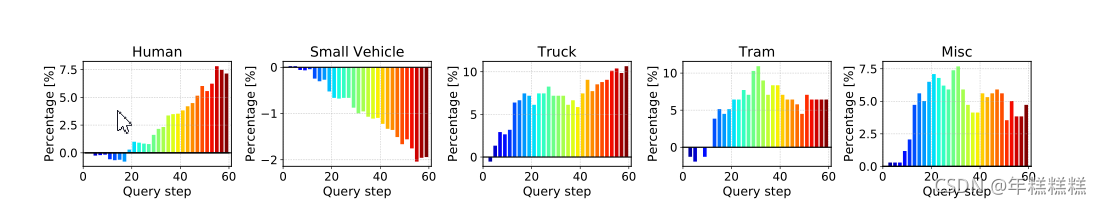

样本对象的分布为了进一步了解主动学习如何优于基线方法,我们比较了“集成+熵”和基线方法下查询样本的类别分布。这是通过在每个步骤中取两者之间的差值来计算的,该差值由来自未标记数据池中相应类别的样本总数来归一化。结果如图5所示,未标记的数据具有高度的等级不均衡性,“小车”=78%,“人”=15.6%,“卡车”=2.7%,“有轨电车”=1.3%,“杂项”=2.4%。然而,我们的方法通过从“小车辆”中查询更少的样本,而从其他类中查询更多的样本,自然地缓解了这一问题。请注意,这种在类上平衡样本的效果是因为在查询函数中使用了不确定性估计,而不是显式过多/过低样本的特殊解决方案。

利用预先训练的RGB图像探测器进行评估

背景:在本实验中,我们评估了基于RGB图像检测器提供的区域建议的主动学习方法。为此,我们遵循[23]将Kitti数据集划分为atrain集和aval集,并使用[26]提出的RGB图像检测器。训练集用于微调已在CoCo数据集[43]上训练的图像检测器,Val集用于评估我们的方法。我们考虑用“小车”和“人”这两个类别来检测物体(与之前的实验相同)。当方案与地面真值的二维交点(IOU)大于0.5时,方案被指定为正。IOU小于0.5或来自其他对象类的建议被标记为“背景”。图像检测器的召回分数由Tab显示。二、

基于图像建议,我们建立了一个包含17221个样本的训练数据库,用来训练我们的主动学习方法。选择这些样本时,其借条大于0.5(正)或小于0.2(背景)。测试数据集包含6000个样本,其中包括IOU在0.2到0.5之间的样本。请注意,忽略具有某些IOU范围的样本是训练对象检测器时的常见程序,如[23]、[42]中所述。

讨论与总结

我们提出了一种利用主动学习来有效训练LiDAR 3D对象检测器的方法。该网络基于摄像机图像上的2D提议来预测对象分类分数和3D几何信息。我们使用一个“完美”的图像探测器进行了实验,比较了几种不确定度估计和查询函数的方法。结果表明,与单一的Softmax输出相比,MC-Dropout和Deep集成提供了更可靠的预测不确定性,并获得了更好的主动学习性能。我们还使用了预先训练的图像检测器来预测图像区域建议。在两种实验设置下,我们的主动学习方法与基线方法相比,在训练样本明显减少的情况下达到了相同的检测性能,节省了高达60%的标注工作量。

结果表明,基于分类预测不确定性的查询函数不仅能有效地提高识别精度,而且能有效降低定位任务(如Tab)的均方误差。我和图3)。这表明通过共享隐含层中的权重,目标检测网络中的分类和定位是相互关联的。将位置不确定性引入到我们的主动学习方法中是一个有趣的未来工作。此外,在这项工作中,网络在每个查询步骤后从头开始重新训练。在我们想要使对象检测器适应新的驾驶场景的应用中(如小节中所讨论的)。I),最好用新标记的数据微调网络。将我们提出的主动学习方法应用于这种“终身学习”的场景中是一项有趣的未来工作。

层中的权重,目标检测网络中的分类和定位是相互关联的。将位置不确定性引入到我们的主动学习方法中是一个有趣的未来工作。此外,在这项工作中,网络在每个查询步骤后从头开始重新训练。在我们想要使对象检测器适应新的驾驶场景的应用中(如小节中所讨论的)。I),最好用新标记的数据微调网络。将我们提出的主动学习方法应用于这种“终身学习”的场景中是一项有趣的未来工作。

我们方法的一个局限性是LiDAR检测器的性能高度依赖于图像检测的区域建议。尽管现有的图像检测器已经达到了很高的检测性能,但LiDAR检测器不能处理图像中的假阴性。为了保证高质量的区域建议,我们可以将图像检测器加入到主动学习循环中,即区域建议首先由图像检测器提供,然后由人工注释器校正。我们把这个留作有趣的未来工作。

4754

4754

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?