Deep active learning for object detection

文章目录

简介

论文标题

- Deep active learning for object detection

- 深度主动学习在目标检测中的应用

- 2018

贡献

- 我们提出了一种新的主动学习方法,该方法将目标检测中使用的分层结构作为一种按委员会查询query by committee的范例来选择要查询的图像集。

- 在我们的方法中,我们引入了一个使用勘探/开采exploration/exploitation权衡的框架。

- 我们在标准目标检测数据集上对实验结果进行了分析,结果表明,仅用1/3的训练数据,就可以获得95%以上的全监督定位准确率。此外,我们的方法比经典的基于不确定性的主动学习算法(如最大熵)具有更好的性能。

摘要

像Single Shot Multibox Detector (SSD)这样的目标检测方法提供了实时运行的高精度目标检测。然而,这些方法需要大量的带注释的训练图像。显然,并非所有这些图像对训练算法都同样有用。此外,根据每个图像的边界框获得注释既昂贵又乏味。在本文中,我们的目标是仅使用一小部分训练图像来获得高精度的目标检测器。为了做到这一点,我们采用了主动学习,它使用“循环中的人human in the loop”范例来选择一组如果加了注释将会有用的图像。为实现这一目标,我们作出了以下贡献\

有点像训练集约减,但用的数据还是没标签的

初步

在目标检测中,我们的目标是准确地获取图像中包含特定类别的对象(如自行车、人或摩托车)的边界框。深度学习领域的最新进展[7,17,22]极大地提高了目标检测的结果。这些检测器在经过完全注释的图像上进行训练,注释是图像标签和包含感兴趣对象的相应地面真实边界框。然而,这种强大的监督是相当困难的,因为它需要大量的时间和人工来注释图像中的每个对象。此外,在某些情况下(如医学图像),此手动注释过程可能会产生成本影响。此外,并不是所有的训练图像都同样有用,因为“相似”的图像可能对学习没有太大贡献。解决这个问题的一个办法是巧妙地选择训练样本,这样我们就可以在尽可能少的监督下获得最先进的性能。这种方法被称为主动学习,已被广泛用于目标分类[12,18,32]。然而,对于目标检测问题的研究还不是很多。

本文使用流行的(SSD)[17]进行目标检测。通常情况下,深度网络只有在对大量图像进行训练的情况下才能很好地泛化。但是,通过利用主动学习的力量,我们可以用一小部分训练图像获得近乎完全的监督性能。我们的方法从委员会查询的范例[19]中得到启发,并利用SSD体系结构中卷积层之间的不一致性来查询图像。实验还表明,与最大熵等黑盒方法相比,利用网络结构进行图像查询的主动学习方法具有更好的效果。

在本文中,我们做了以下贡献:

- 构造了一种新的基于委员会[19]查询范式的主动学习方法,该方法的性能大大优于普通的主动学习方法

- 在我们的方法中引入一个简单的框架来使用勘探/开采权衡

总结了黑盒的方法

提出了白盒的方法,证明比黑盒的好(感觉也没好多少)

白盒的方法利用了所有卷积层的预测框结果

以前的工作

目标分类和检测是计算机视觉中被广泛探索的课题[8,9,14,17,21]。这里我们使用SSD[17]进行目标检测,因为它具有卓越的准确性、易用性和速度。然而,所有这些方法都使用基于地面真实边界框的完全监督来进行目标检测。完全注解图像的成本很高,因此在过去几年中,由于只需要图像标签来进行训练,因此监管不力受到了关注[1]。在本文中,我们关注的是一种相关的范式,称为主动学习[23],它在最少的监督下提供最先进的性能。

主动学习已被广泛应用于对象分类[10,11,12,16,18,28,32,33],其中给定一幅图像,我们希望标记特定类别的对象的存在或不存在,以及视频注释[13,15,29,30]。[4]使用按委员会查询的方法查询图像以进行分类。通过在全网络上进行批量丢弃来形成分类器委员会,然后利用委员会成员的预测标签与多数投票获得的标签之间的差值来查询图像。但是,此方法与我们在本例中使用按委员会查询的方法有根本不同

现在我们讨论几个已经探索主动学习目标检测问题的相关工作。在[27]中,作者在亚线性时间内使用了[26]的简单边际方法和基于散列的解决方案。[34]使用人类来校正检测器针对具有最大预测注释成本的未注释图像提出的注释。与[34]不同的是,在所提出的方法中,假设每个图像的注释成本相等。主动学习不应该与像[3]这样的主动检测方法混为一谈,在这种方法中,已经训练好的基本分类器的辨别能力是在测试时使用最少的人工监督来改进的。需要注意的是,所有这些方法都使用非深度分类器。

据我们所知,这是深度学习领域中第一个针对目标检测的主动学习的工作,它考虑了一种基于委员会查询的原则性方法。我们表明,我们可以使用网络不同层的属性来评估图像中使用的建议proposals,以生成需要注释的图像集。此外,我们对SSD[17]采用了这种范例,这是目前最先进的物体检测方法。

27 Large-scale live active learning: Training object detectors with crawled data and crowds

34 Interactive object detection

Method

在本节中,我们将介绍我们提出的针对SSD的主动学习方法。首先,我们从未加注释的图像池中随机选择一组图像,让先知(比如说,人工注释员)对它们进行注释,然后对这些新注释的图像进行SSD训练,以获得初始模型。随后,我们主动选择一批固定的图像,对其进行标注,并对所有标注后的图像进行SSD训练。我们继续这一替代的主动学习/培训阶段,直到耗尽我们的预算(通常,预算是查询图像的总百分比的函数)或达到所需的准确度。

在这里,我们提出两大类主动学习方法:

黑盒方法:这些方法不关心底层网络架构,而是使用Softmax层的置信度分数来查询图像

白盒方法:这些方法了解网络体系结构,因此对于不同的体系结构可能会有所不同。

在实验部分,我们证明了白盒方法的性能明显优于黑盒方法。

在本文中,我们认为每幅图像的标注代价是相等的。但是,为了进一步降低实际标注成本,可以在主动查询的图像上使用类似[20]的方法。此外,可以使用多样性度量来使活跃查询批次中的图像更加多样化,从而添加更多信息。然而,我们在目前的论文中没有探讨这些方向,并计划在未来进行探索。

黑箱主动学习

这里,我们使用流行的主动学习方法[23],这些方法已经被提出用于在对象检测(多类、多标签场景)的上下文中进行分类。采用这些方法进行检测的一种方式是选择难以分类并因此可以从注释中受益的图像集。然而,这种方法不会考虑对象检测的性质。即使当对象分类器查看整个图像时,对象分类器可能发现图像很难分类(例如,有一头小牛的草地),对象检测算法在定位感兴趣的对象(牛可能很容易在草地上突出)方面可能没有问题。因此,我们为每幅图像考虑一组建议proposals,并获得与这些建议相对应的边界框,然后将其与传统的主动学习方法一起使用。

我们特别考虑了两种这样的基于黑盒的方法,即。最小最大熵和最大熵。在实验部分,我们使用这些方法作为比较的基线。

3.1.1 Minmax (mm)

让我们假设对于每个图像i,对应于每个类c,我们有{bic}个边界框。查询函数为:

argmin

i

max

c

max

j

∈

{

b

i

c

}

prob

(

j

)

\underset{i}{\operatorname{argmin}} \max _{c} \max _{j \in\left\{b_{i c}\right\}} \operatorname{prob}(j)

iargmincmaxj∈{bic}maxprob(j)

边界框在图像中可以获得的最大概率分数表示模型相对于该图像的置信度。因此该查询函数选择当前模型置信度最低图像

一张图,选框置信度最大的框作为数据的候选值.选候选值最小的

3.1.2 Maximum Entropy (ent)

让我们假设对于每个图像i,对应于每个类c,我们有{bic}个边界框。查询函数为:

argmax

i

max

c

∑

j

∈

{

b

i

c

}

−

prob

(

j

)

∗

log

(

prob

(

j

)

)

\underset{i}{\operatorname{argmax}} \max _{c} \sum_{j \in\left\{b_{i c}\right\}}-\operatorname{prob}(j) * \log (\operatorname{prob}(j))

iargmaxcmaxj∈{bic}∑−prob(j)∗log(prob(j))

熵是主动学习中一种常见的不确定性抽样度量[31]。该查询函数计算给定类别的边界框的熵,并随后使用它来确定整个图像的熵。选择熵最大的图像进行查询

把每个类别的框计算熵并求和,最大类别的熵作为候选值.选候选值大的

3.1.3 Sum Entropy (ent-sum)

让我们假设对于每个图像i,对应于每个类c,我们有{bic}个边界框。查询函数为:

argmax

i

∑

c

∑

j

∈

{

b

i

c

}

−

prob

(

j

)

∗

log

(

prob

(

j

)

)

\underset{i}{\operatorname{argmax}} \sum_{c} \sum_{j \in\left\{b_{i c}\right\}}-\operatorname{prob}(j) * \log (\operatorname{prob}(j))

iargmaxc∑j∈{bic}∑−prob(j)∗log(prob(j))

把每个图像的框计算熵并求和作为候选值.选候选值大的

这个版本的熵方法倾向于包含更多类的图像,因此为我们的方法提供了更积极的基线。

白盒主动学习

SSD网络由一个基本网络(比如VGG[25])和一组额外的卷积层组成,用于检测不同尺度的目标。一组默认边界框与每个特征地图单元相关联,并且每个这样的框相对于其对应单元的位置是固定的。对于每个图像,从基础网络的最后卷积层和额外卷积层获得的边界框经历非最大抑制,并且随后形成可能包含感兴趣对象的候选边界框集合。在这些层之上使用另外一组卷积层来生成每类置信度分数和相对于对应于每个特征地图单元的每个默认边界框的偏移量。

我们提出的方法的灵感来自于委员会的查询范例[19]。在本文中,我们使用SSD网络作为主动学习的基本分类器,因为它可以自然地扩展到委员会方法的查询中。然而,通过将分类和检测头附加到“重要的”卷积层,该方法可以扩展到任何网络。在SSD中,基础网络的最后一层卷积层与额外的卷积层一起组成分类器委员会,它们之间对于图像中每个候选边界框的聚合不一致被用于查询。然而,不一致度量还应该考虑到这样一个事实,即这些分类器以不同的纵横比检测对象。

然而,不一致度量还应该考虑到这样一个事实,即这些分类器以不同的纵横比检测对象。

算法1背后的直觉是,如果卷积层发现高得分边界框并且它与地面事实重叠,则其他卷积层也将倾向于在该区域具有高得分边界框。这是因为我们已经使用与地面真实边界框的空间重叠作为损失标准来训练我们的模型。我们利用这一直觉,为每个边界框b引入了‘边距margin’的概念。我们只关注那些既不虚假也不特别自信的边界框。

第6行舍弃掉了边界框

7.找到生成它的卷积层并调用它s(S for Source)

10. 从1中找出与带重叠超过j,jaccard的包围盒b,将它们添加到a中(A表示辅助包围盒);

委员会查询方法有很强的理论基础,并且已经被证明可以最大限度地减少每次查询的版本空间[24]。

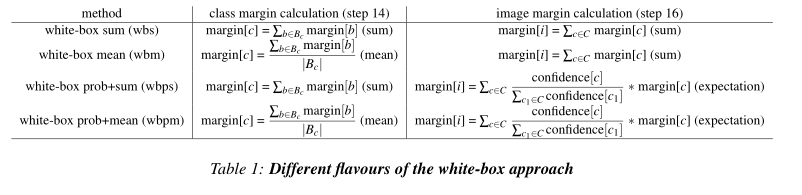

表1列出了上述算法的不同风格。它们的不同之处在于,在步骤14中如何根据边界框边界(平均值或总和)计算类别边界,以及如何在步骤16中根据类别边界(总和或期望)计算图像边界。计算类别边距的SUM方法偏爱具有同一类别的多个实例的图像。但是,它也可能查询离群值,即包含类的遮挡实例作为注释的图像。另一方面,平均法可能会削弱这些异常值的影响。同样,如果我们在计算图像边缘时包含类别概率,我们会更多地关注重要类别的分类器不一致。我们对这些变种进行了经验评估,并给出了同样的结果。

勘探/开发框架

探索/开发权衡exploration/exploitation trade-off是主动学习领域的一个重要问题[2]。探索性方法Explorative methods 探索特征空间以找到远离标记样本的未标记样本,而开发方法exploitative methods则聚焦于已经被标记样本填充的区域。探索性方法可能会选择离群值,而开发性方法可能会选择不会改善分类器的“相似”样本。例如,在算法1的情况下,选择得分最高的图像代表探索exploration ,因为卷积层对它们的分歧最大,因此它们很可能远离当前标记的图像。另一方面,选择得分最低的图像表示利用exploitation ,因为它们与当前标记的图像池“相似”。

在本文中,我们提供了以下简单而有效的框架来利用勘探/开发的力量:

n bins formulation (n-ee) 对于每批,我们将得分空间划分为n个相等大小的箱。如果批次大小为m,我们将从top (n-1)个箱中查询m/n个得分最高的图像(exploration in each bin),并从最后一个箱中查询m/n个得分最低的图像(exploitation).。因此,结果批次包含来自得分空间不同区域的图像,并且可以更好地代表底层分布。在实验中,我们使用2、5和10作为n的值。

与测试优先级不同,它是从分布中尽可能的都选,得分高的和得分低的都要

结果

我们在实验1中使用了SSD300架构和“图像扩展数据增强”技巧[17]。我们在Pascal VOC2007+12[5]和Kitti[6]数据集上对我们的方法进行了评估。通过使用平均精度(MAP)[5]对相应测试集上的模型进行评估,比较了不同的主动学习方法。我们使用0.3作为所有白盒方法的重叠阈值。

PASCAL VOC

我们将VOC2007和VOC2012Trainval集合[5]结合起来,创建一个大小为16551的未注释图像池U。初始的SSD模型是通过从U中随机选择一组10%的图像并对其进行注释来进行训练的。所有的主动学习方法都使用这个初始模型。随后,我们从U的剩余部分中主动选择了一批(占总数的5%)的图像,并对它们进行了标注。这种替代训练/主动学习将继续进行,直到我们在总大小的45%的U上对模型进行训练。该模型VOC2007测试集上进行了测试,该测试集包含4952幅图像,使用标准的平均平均精度(MAP)度量

所有主动学习方法的模型训练参数都保持不变,即初始学习率根据训练损失的不同为1e-3或1e-4,迭代次数为120000次,动量为0.9时,SGD的权值衰减为5e-4,经过80000、100000和120000次迭代后,学习率衰减10倍。

不同口味白盒的比较

我们首先比较白盒方法的不同风格。在图1(A)中,我们发现wbps和wbpm分别优于wbs和wbm。这说明了在计算图像边缘时包括类别概率的重要性。

就是算法中的公式不一样

与黑箱方法的比较

接下来,我们将wbpm和wbpm的风格与基线的主动学习方法进行比较。在图1(B)中,我们发现wbpm和wbpm优于基线方法。该方法比传统的方法性能更好,因为它偏爱包含更多类别的图像,是最具侵略性的基线方法。

勘探/开发方法比较

在图1©中,我们将wbm和wbm与它们各自的勘探/开发版本进行了比较,它们分别有2个binswb(2-ee)和wbm(2-ee)。从图中可以清楚地看出,添加利用漏洞可以提高多次迭代的结果。接下来,在图1(D)和图1(E)中,我们比较了具有2个、5个和10个bins的wbb和wbm各自的勘探/开采版本。在这两个版本中,方法2-ee和5-eee的性能都优于10-ee。在图1(E)中,我们发现我们在除最后一个桶之外的所有桶中的exploration方法和在最后一个桶(n-ee)中的exploitation 方法比在所有桶(n-e)中的 exploration结果更好。

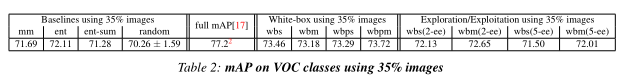

使用35%图像的不同方法的map

我们选择以35%的比例显示我们的结果,因为到那时,所有的主动学习方法都已经采样了足够的图像来进行有效的学习。因此,即使地图的细微差别也是显著的。在表2中,我们发现我们最好的方法比最激进的基线方法ent-sum多1.5个映射点,这在这个阶段是相当重要的。我们还使用随机抽样作为基线,在10%的初始图像之上随机抽样25%的图像。随机抽样过程重复6次,正如预期的那样,产生具有高方差的结果。此外,在像Pascal

VOC这样的不平衡数据集中,随机抽样方法预计会选择较大类的图像而不是较小类的图像,从而为较小类提供较差的性能。

Kitti

主动学习方法的实际应用是在冗余很常见的应用中,如监控视频和自动驾驶。为了了解我们的方法在这样的场景中是如何执行的,我们选择了Kitti数据集[6],并将训练集平均分为训练集和测试集。在这一部分中,我们使用平均精度(AP)度量在测试集上评估了白盒方法wbpm和最激进的基线方法SUM的性能,这两种方法在35%的图像上进行了训练。

对于此分析,我们不会遗漏“困难的”注释。两种主动学习方法的模型训练参数保持不变,即初始学习率为1e-4,迭代次数为120000,动量为0.9时,SGD的权值衰减为5e-4,经过80000、100000和120000次迭代后,学习率衰减为10倍。和前面一样,我们从大小为10%的初始随机抽样开始,然后以5%的批量进行主动学习。

如图2所示,wbpm方法大大优于基线方法ent-sum。

模型分析

在这一部分中,我们将简要分析白盒法和基线法。在表5中,我们给出了VOC2007+12数据集上各种主动学习方法查询到的图像中类的总数(类内容)、对象的总数(对象内容)和截断对象的总数(截断对象内容),从占训练图像的10%到占训练图像的35%。显然,与白盒方法wbpm相比,基线方法对包含多个类和对象的图像进行求和查询更多。这表明,盲目查询具有更多类和对象内容的图像并不能确保优异的性能。此外,该表还显示,wbps方法倾向于查询包含更多对象的图像,因此,与wbpm相比,拉入的截断对象要多得多。这是SUM函数的结果,该函数偏爱包含更多对象的图像。但是,有趣的是,它的性能几乎不会受到截断对象数量的急剧增加的影响。如表3所示,查询策略的性能与查询图像中的对象/类内容之间的这种差异在Kitti数据集中更加明显。

结论和下一步工作

在本文中,我们提出了一种主动学习方法,该方法仅使用一小部分训练图像就能产生最先进的目标检测结果。我们的方法在获取注释非常昂贵的场景中非常有用。我们的主动学习策略利用了卷积层之间检测的差异,因此使用了查询委员会的方法对图像进行注释。在未来,我们希望通过使我们的批处理更加多样化,并在我们的查询策略之上使用像[20]这样的方法来进一步减少注释工作。我们想要探索的另一个有趣的方向是将半监督技术与各种计算机视觉任务的主动学习方法相结合。

能产生最先进的目标检测结果。我们的方法在获取注释非常昂贵的场景中非常有用。我们的主动学习策略利用了卷积层之间检测的差异,因此使用了查询委员会的方法对图像进行注释。在未来,我们希望通过使我们的批处理更加多样化,并在我们的查询策略之上使用像[20]这样的方法来进一步减少注释工作。我们想要探索的另一个有趣的方向是将半监督技术与各种计算机视觉任务的主动学习方法相结合。

701

701

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?