深度学习笔记(一)(4)深层神经网络(Deep Neural Networks)

4.1 深层神经网络(Deep L-layer neural network)

有一些函数,只有非常深的神经网络能学会,而更浅的模型则办不到。尽管对于任何给定的问题很难去提前预测到底需要多深的神经网络,所以先去尝试逻辑回归,尝试一层然后两层隐含层,然后把隐含层的数量看做是另一个可以自由选择大小的超参数,然后再保留交叉验证数据上评估,或者用你的开发集来评估。

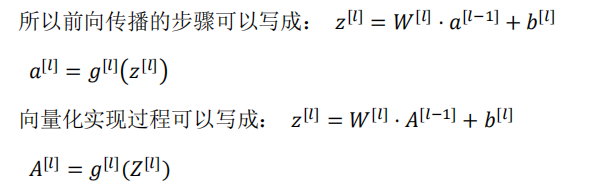

4.2 前向传播和反向传播(Forward and backward propagation)

4.4 核对矩阵的维数(Getting your matrix dimensions right)

4.5 为什么使用深层表示?(Why deep representations?)

深度神经网络的这许多隐藏层中,较早的前几层能学习一些低层次的简单特征,等到后几层,就能把简单的特征结合起来,去探测更加复杂的东西。

深层的网络隐藏单元数量相对较少,隐藏层数目较多,如果浅层的网络想要达到同样的计算结果则需要指数级增长的单元数量才能达到。

吴老师经验之谈:但是当我开始解决一个新问题时,我通常会从 logistic 回归开始,再试试一到两个隐层,把隐藏层数量当作参数、超参数一样去调试,这样去找比较合适的深度。

4.6 搭建神经网络块(Building blocks of deep neural networks)

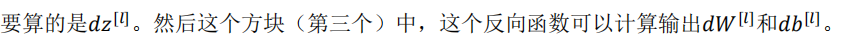

一个细节:是把反向函数计算出来的𝑧值缓存下来。还有𝑊和𝑏,从实现角度上看,我认为是一个很方便的方法,可以将参数复制到你在计算反向传播时所需要的地方。

4.7 参数 VS 超参数(Parameters vs Hyperparameters)

控制参数的参数。

控制参数的参数。

疯狂调参。。。。。

条经验规律:经常试试不同的超参数,勤于检查结果,看看有没有更好的超参数取值,你将会得到设定超参数的直觉。

3394

3394

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?