1.ssh免密钥(本机)

[root@node01 ~]# ssh-keygen -t dsa -P '' -f /root/.ssh/id_dsa

[root@node01 .ssh]# cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

2.安装JDK

[root@node01 ~]# rpm -i jdk-7u67-linux-x64.rpm

配置环境变量打开 /etc/profile文件 在末行追加

export JAVA_HOME=/usr/java/jdk1.7.0_67

export PATH=$PATH:$JAVA_HOME/bin

配置完成保存 重新加载配置文件

[root@node01 java]# source /etc/profile

输入jps 能够打印进程号 说明配置成功

3.安装hadoop

解压

[root@node01 ~]# tar -xf hadoop-2.6.5.tar.gz

在opt目录下创建hadoop的工作区间sxt

[root@node01 ~]# mkdir /opt/sxt

移动文件至hadoop 至创建的文件夹

[root@node01 ~]#mv hadoop-2.6.5 /opt/sxt/

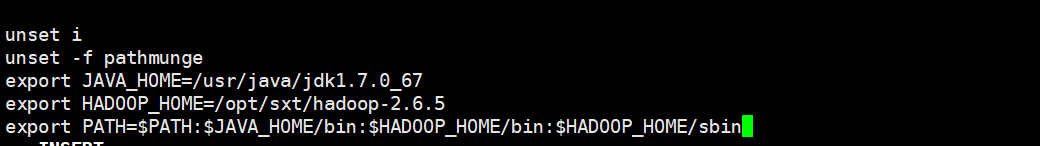

配置hadoop的环境变量

export HADOOP_HOME=/opt/sxt/hadoop-2.6.5

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

重新加载配置文件

[root@node01 java]# source /etc/profile

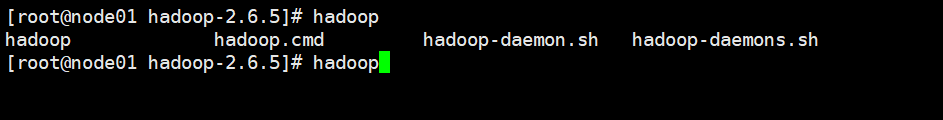

hadoop 命令生效

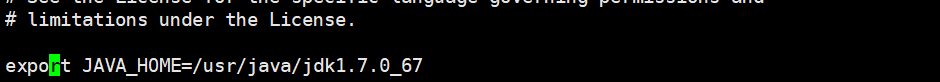

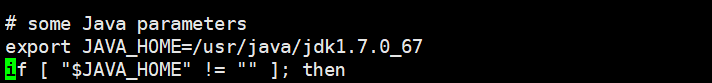

4.java的环境变量的二次配置

进入/opt/sxt/hadoop-2.6.5/etc/hadoop目录修改相关文件

修改hadoop-env.sh mapred-env.sh yarn-env.sh

配置javahome的环境变量的实际地址

5.配置core-site.xml文件 在configuration 标签内配置

/opt/sxt/hadoop-2.6.5/etc/hadoop core-site.xml

<property>

<name>fs.defaultFS</name>

<value>hdfs://node01:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/var/sxt/hadoop/local</value>

</property>

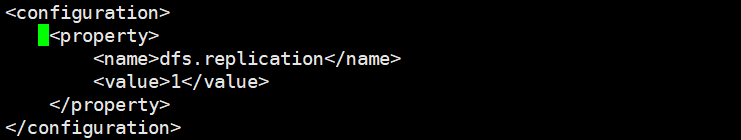

6.配置 hdfs-site.xml文件 将默认副本数改为1

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>node01:50090</value>

</property>

7.配置 /opt/sxt/hadoop-2.6.5/etc/hadoop slaves 文件中的 datanode节点 由于是伪分布式 所以只需要配置一个节点就足够,

之后进行分布式集群部署时 可以将节点增加。

8.首次启动进行格式化 以后就不用在格式化了

hdfs namenode -format

确定格式化后 successful

8.启动name node

[root@node01 hadoop]# start-dfs.sh

9.访问 http://node01:50070 查看图形化界面

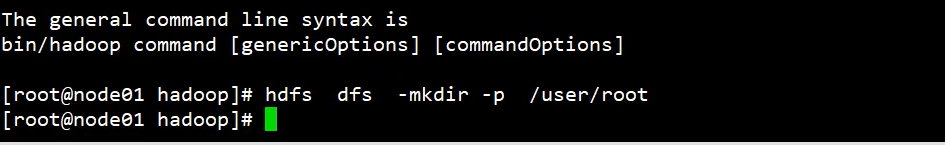

10 创建根目录

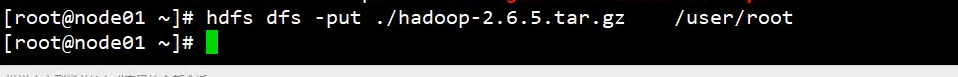

11 上传文件 到根目录

12按照指定切割大小 切割上传的文件

![]()

13查看上传的文件

605

605

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?