Scrapy基础入门篇

Scrapy 是一个基于 Twisted 实现的异步处理爬虫框架,该框架使用纯 Python 语言编写。Scrapy 框架应用广泛,常用于数据采集、网络监测,以及自动化测试等。

提示:Twisted 是一个基于事件驱动的网络引擎框架,同样采用 Python 实现。

本文主要讲述Scrapy爬虫工作流程以及创建scrapy爬虫项目。

Scrapy下载安装

Scrapy 支持常见的主流平台,比如 Linux、Mac、Windows 等,因此你可以很方便的安装它。本节以 Windows 系统为例,

python -m pip install Scrapy

**pycharme:**直接安装Scrapy。(这种安装方式有时会报错,特别是在创建虚拟环境时,有可能安装成功也找不到scrapy,这时需要将虚拟环境下创建的\venv\Scripts添加到环境变量中。可能运行会很慢)

由于 Scrapy 需要许多依赖项,因此安装时间较长,大家请耐心等待,关于其他平台的安装方法,可参考官方文档《Scrapy安装指南》。

Scrapy爬虫工作流程:

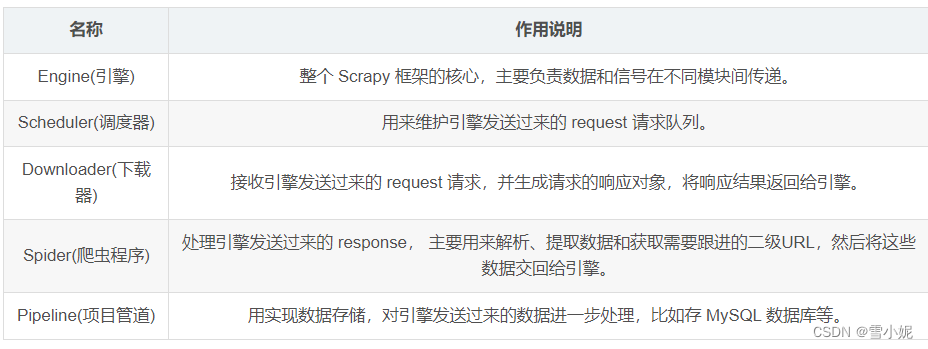

Scrapy 框架由五大组件构成

如下所示:

在整个执行过程中,还涉及到两个 middlewares 中间件,分别是下载器中间件(Downloader Middlewares)和蜘蛛中间件(Spider Middlewares),它们分别承担着不同的作用:

| 下载器中间件(Downloader Middlewares) | 位于引擎和下载器之间,主要用来包装 request 请求头,比如 UersAgent、Cookies 和代理 IP 等 |

|---|---|

| 蜘蛛中间件 (Spider Middlewares) | 位于引擎与爬虫文件之间,它主要用来修改响应对象的属性 |

Scrapy 工作流程示意图如下所示

(不包含中间件)

上述示意图描述如下,当一个爬虫项目启动后,Scrapy 框架会进行以下工作:

1.引擎找到spider,在spider中找到起始url(第一个待爬取的 URL)。

2.url被引擎包装成request对象。

3.引擎将reques对象传递给调度器。

4.调度器(Scheduler)通过引擎将response对象传递给Downloader。

5.Downloader将得到的response对象通过引擎送回给spider。

6.spider解析:解析返回的response对象,通过xpath、json、re、css等。

7.spider将数据通过引擎传递给pipeline,存储数据。若有新的url(比如下一页等):重复2-7步骤。

创建scrapy爬虫项目

Scrapy 框架提供了一些常用的命令用来创建项目、查看配置信息,以及运行爬虫程序。常用指令如下所示:

scrapy项目创建,编写步骤

步骤一: 创建项目:在对应项目目录下创建scrapy项目。使用 scrapy startproject 项目名(比如D:\python_spider_learning\spide_project\scrapy_project\learning>在这个文件夹下创建)

1.注意:直接在pycharm里安装scrapy后,scrapy startproject 项目名会报错,这是可以把对应虚拟环境的scripts添加到环境变量中,如:D:\python_spider_learning\spide_project\venv\Scripts

2.分析创建文件里的每一个文件含义:

a.图片中第一个game就是我们刚才使用命令创建项目时的项目名(scrapy startproject 项目名)。是整个项目所在文件夹,点开有两个文件,game和scrapy.cfg

b.第二个game,是项目的根目录,后面导包都是在这个里。scrapy.cfg:描述了一些设置,以及部署,这个不能删除。

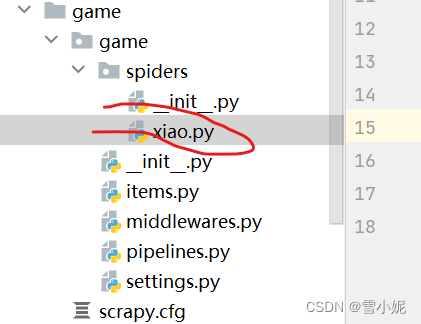

c.点开根目录game:有6个文件,分别是spiders文件夹,__init__.py,items.py,middlewares.py,pipelines.py,settings.py。

spiders文件夹:是scrapy框架模块中的spiders,爬虫,数据解析都在这里。

__init__.py:

items.py:为了scrapy去封装比较大的数据时用到。

middlewares.py:中间件,处理反爬,cookie等

pipelines.py:管道,存储数据。

settings.py:对整个scrapy或者当前项目整体的配置信息。

步骤二:进入项目:cd 项目名称。或者在pycharme中选中文件夹Terminal

步骤三:创建爬虫:命令创建爬虫:scrapy genspider 爬虫名称 域名(scrapy genspider xiao 4399.com)

(gen:生成)

步骤四:可能需要修改start_url,修改成需要抓取的页面

步骤五:对数据进行解析。在spider里面的parse(response)方法中进行解析

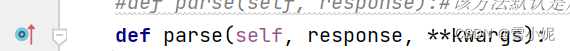

parse():该方法是XiaoSpider继承scrapy.Spider中的parse(),所以该方法不能修改名称,11行旁边的圆圈就表示该方法可以重写

def _parse(self, response, kwargs):父类中还有kwargs。但是子类最开始进来时,没有**kwargs参数,所以会显示黄色警告之后可能会报错。

def parse(self, response):修改成

def parse(self, response, **kwargs):

response.text 源代码

response.json()返回数据是json

response.xpath()

response.css()

解析数据时需要注意:默认xpath()返回的是Selector对象。

想要数据必须使用extract()提取数据。

extract()返回列表

extract_first()返回一个数据

yield 返回数据 --》把数据交给Pipeline进行持久化存储

步骤六:在Pipeline中完成数据的存储工作。

class 类名():类名可以自己取。

def process_item(self, item, spider):这个不能修改。

item:是数据

spider:是爬虫

return item #必须要return东西,否则下一个管道收不到数据。最后一个管道可以不写return

步骤七:设置settings.py文件将Pipeline进行生效设置

ITEM_PIPELINES = {

“管道路径”: 优先级,优先级数越小,越高,越先执行

}

如:ITEM_PIPELINES = { "game.pipelines.GamePipeline": 300, }

步骤八:运行项目:scrapy 命令:scrapy crawl 爬虫名( scrapy crawl xiao),运行后,会打印出日志。

如果不想看日志,打开settings.py,添加:

LOG_LEVEL="WARNING"

#设置成WARNING是指,只打印WARNING及以上级别的日志。

#日志级别:DEBUG,INFO,WARNING,ERROR,CRITICAL(等级从低到高)

scrapy案例

创建项目

scrapy startproject game

创建爬虫

进入scrapy创建项目文件夹中:

scrapy genspider 爬虫名称 域名(scrapy genspider xiao 4399.com)

可能需要修改start_url,修改成需要抓取的页面

start_urls = ["https://4399.com"]

修改成

start_urls = ["https://www.4399.com/flash/"]

数据解析

在spider里面的parse(response)方法中进行解析

scrapy中xpath和css()可以混合用

import scrapy

from game.items import GameItem

class XiaoSpider(scrapy.Spider):#scrapy.Spider是继承scrapy中的spiders模块,不要去修改

name = "xiao"#爬虫名字

allowed_domains = ["4399.com"]#被允许的域名

start_urls = ["https://www.4399.com/flash/"]#修改后的url

def parse(self, response, **kwargs):

#拿到页面源代码

#print(response.text)

#response.json()返回数据是json

#利用浏览器的xpath

txt = response.xpath('//*[@id="skinbody"]/div[8]/ul/li/a/b/text()').extract() # 用xpath进行数据解析,用extract()提取选择器里的数据

print(txt)

#自己根据html写xpath

txt1 = response.xpath("//ul[@class='n-game cf']/li/a/b/text()").extract() # 用xpath进行数据解析,用extract()提取选择器里的数据

print(txt1)

#分块提取,循环

li_list = response.xpath("//ul[@class='n-game cf']/li")

for li in li_list:

name=li.xpath('./a/b/text()').extract_first()#extract_first()提取一项内容,如果没有,返回NONE

url ='https://www.4399.com'+ li.xpath('./a/@href').extract_first() # extract_first()提取一项内容,如果没有,返回NONE

src='https:'+li.xpath('./a/img/@lz_src').extract_first()

category = li.xpath('./em/a/text()').extract_first()

date = li.xpath('./em/text()').extract_first()

'''scrapy中当数据量或者字段较多,管道较多时,直接用字典存储,可能后续会报错,有时报错也找不到具体在哪里。

因此,聪明的方法就是:利用items.py文件。

items.py修改:1.在class类中定义存储的key值。

class GameItem(scrapy.Item):

#name = scrapy.Field()这个定义后,name相当于dict中的key。

name = scrapy.Field()

url = scrapy.Field()

src = scrapy.Field()

category = scrapy.Field()

date = scrapy.Field()

2.导包:from game.items import GameItem。注意:若scrapy项目不时最开始的根目录,导包时会报错,

可以在项目的根目录game点击右键,选择Mark Directory as --》选择root '''

xiao_game=GameItem()

xiao_game['name']=name

xiao_game['url'] = url

xiao_game['src'] = src

xiao_game['category'] = category

xiao_game['date'] = date

yield xiao_game

'''别用傻方法

dic={'name':name,

'url':url,

'src':src,

'category':category,

'date':date

}

#需要用yield将数据传递给管道

#yield dic 如果返回的是数据,直接可以认为是给了管道Pipeline。实际是先给引擎,引擎再给管道Pipeline。这样能提高性能,主要体现在内存上

yield dic#yield是生成器。如果用list临时保存,会占用内存空间,生成器函数节省内存

'''

用xpath和css混合解析

import scrapy

from game.items import GameItem

class XiaoSpider(scrapy.Spider):#scrapy.Spider是继承scrapy中的spiders模块,不要去修改

name = "xiao"#爬虫名字

allowed_domains = ["4399.com"]#被允许的域名

#start_urls = ["https://4399.com"]#起始页面url,这里可以修改,我们想爬的是https://www.4399.com/flash/,所以要修改

start_urls = ["https://www.4399.com/flash/"]

def parse(self, response, **kwargs):

#分块提取,循环

li_list = response.xpath("//ul[@class='n-game cf']/li")

for li in li_list:

'''

name=li.xpath('./a/b/text()').extract_first()#extract_first()提取一项内容,如果没有,返回NONE

url ='https://www.4399.com'+ li.xpath('./a/@href').extract_first() # extract_first()提取一项内容,如果没有,返回NONE

src='https:'+li.xpath('./a/img/@lz_src').extract_first()

category = li.xpath('./em/a/text()').extract_first()

date = li.xpath('./em/text()').extract_first()

'''

name = li.css('b::text').extract_first()

url = 'https://www.4399.com' + li.css("a::attr(href)").extract_first()

src = 'https:' + li.css("a img::attr(lz_src)").extract_first()

category = li.css('em a::text').extract_first()

date = li.css('em::text').extract_first()

xiao_game = GameItem()

xiao_game['name'] = name

xiao_game['url'] = url

xiao_game['src'] = src

xiao_game['category'] = category

xiao_game['date'] = date

yield xiao_game

在Pipeline中完成数据的存储工作

# Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: https://docs.scrapy.org/en/latest/topics/item-pipeline.html

# useful for handling different item types with a single interface

from itemadapter import ItemAdapter

'''注意:管道默认是不开启的,需要去settings.py中开启,如:

ITEM_PIPELINES = {

"game.pipelines.GamePipeline": 300,

}

'''

class GamePipeline:#这个是默认创建的,可以修改,如下文17行NewPipeline

def process_item(self, item, spider):#这个是定死的,不能修改.这个里面就可以保存数据。

#item是数据,

#spider是爬虫,如xiao.py中name = "xiao"

print(item)

print(spider.name)

#这里可以开始存储数据了

return item

class NewPipeline:

def process_item(self, item, spider):

'''若要在item中在加一个字段,不能想dict一样直接赋值,必须要现在items.py中定义key,如:love = scrapy.Field()。'''

item['love']='我喜欢吃冰淇淋'

return item

设置settings.py文件将Pipeline进行生效设置

'''key是管道的路径,

value是优先级,优先级数越小,越高,越先执行'''

ITEM_PIPELINES = {

"game.pipelines.GamePipeline": 300,

#"game.pipelines.NewPipeline": 299,

}

运行项目

scrapy 命令:scrapy crawl 爬虫名( scrapy crawl xiao),运行后,会打印出日志。

如果不想看日志,打开settings.py,添加:LOG_LEVEL=“WARNING”#设置成WARNING是指,只打印WARNING及以上级别的日志。

#日志级别:DEBUG,INFO,WARNING,ERROR,CRITICAL(等级从低到高)

1108

1108

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?