papertitle

Visual Tracking via Adaptive Spatially-Regularized Correlation Filters

author

Kenan Dai1, Dong Wang1∗, Huchuan Lu1,2, Chong Sun1,3, Jianhua Li1

方法亮点

1.该自适应空间正则化方案可以学习到针对特定目标及其外观变化的有效空间权重,从而在跟踪过程中获得更可靠的滤波系数。

2.其次,基于乘子交替方向法,可以有效优化ASRCF模型,其中每个子问题都有封闭解。

3.第三,跟踪器采用两种CF模型分别估计位置和尺度。定位CF模型利用浅层和深层特征的集合来准确地确定最优位置。尺度CF模型针对多尺度的浅层特征,有效地估计出最优尺度。

主要包括两个方面:自适应空间正则化和有效的尺度估计。

研究现状

MOSSE方法是最早的基于cf的跟踪器,它只使用灰度样本来训练滤波器。

CSK跟踪器在CF公式中引入了内核技巧。利用循环位移采样,可以在频域内有效地优化滤波器系数。

基于CSK的KCF方法利用多通道HOG特征增强了特征表示能力,显著提高了跟踪性能。

DSST、SAMF和dibccf跟踪器采用多尺度搜索策略解决了尺度适应问题。

传统的CF方法依赖于对训练和检测样本的周期性假设,这会产生意想不到的边界效应,使得跟踪器被训练并应用于部分不真实的样本上。

为了解决这个问题,Danelljan等人在CF公式中引入了空间正则化项来惩罚边界区域附近的滤波系数。Galoogahi等人直接将滤波器与二进制矩阵相乘,生成用于模型训练的真实正样本和负样本。上述两种空间约束在后续的研究中得到了广泛的应用。

动机

这些空间约束对于不同的对象通常是固定的,在跟踪过程中不会改变;因此,它们不能充分利用不同帧中不同对象的多样性信息。

解决方法

在此工作中,我们提出了一种新的自适应空间正则化项,使跟踪器在跟踪过程中学习到更可靠的滤波系数。

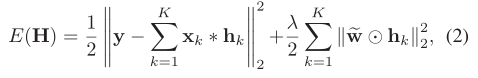

SRDCF:

SRDCF方法引入了空间正则化来惩罚滤波器系数的空间位置,并将目标函数修改为

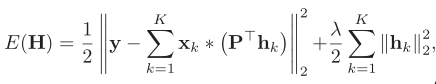

BACF:

BACF方法提出了一个后台CF,并介绍了以下目标函数:

上面两个约束在跟踪过程中是固定的,对于不同的对象是相同的,不能很好地反映特定对象的特征和外观变化(motivation)。

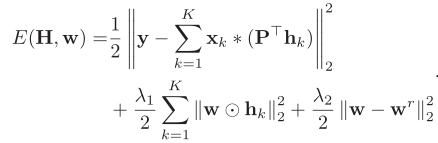

我们提出了一种新的自适应空间正则化相关滤波器(ASRCF)方法来学习有效的多通道滤波器,我们的目标函数定义如下:

- 第一项是对训练数据X = [x1,x2,…进行卷积的岭回归项

- 第二项是正则化项,在滤波器H上引入自适应空间正则化,其中空间权值w需要优化。

- 第三项试图使自适应空间权值w与参考权值wr相似。这个约束引入了关于w的先验信息,避免了模型退化1。

- λ1和λ2分别为第二项和第三项的正则化参数。

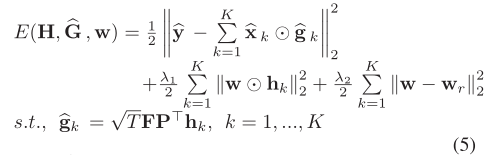

通常在频域学习相关滤波器,以有效地训练和测试。因此,我们将目标函数表示在频域(利用Parseval定理),并将其转化为等式约束的优化形式:

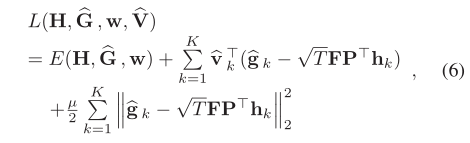

上式中的模型是双凸的,可以用交替方向乘子法最小化得到局部最优解。上式的增广拉格朗日形式可以写成:

过引入sk= 1/µ vk (k = 1,2,…, K)时,式(6)的优化等价于求解方程:

分割线-------------------------------------------------------

然后,采用ADMM算法,交替求解以下子问题:

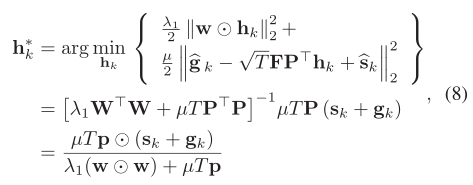

Subproblem H:

如果^G, w和^S是给定的,最优H可以得到如下

求解hk和所有的 H的计算复杂度分别为O(T logT)和O(KT logT)。

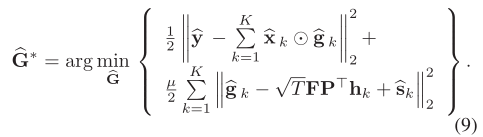

Subproblem ^G:

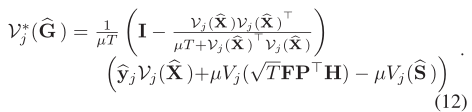

如果式中其他变量是固定的,最优的ˆG∗可以通过求解优化问题:

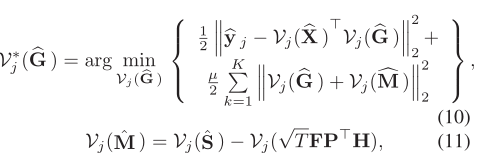

但由于计算量大,很难对其进行优化。因此,我们考虑对每个像素的所有通道进行处理,将优化问题(9)重新表述为

上式的解为:

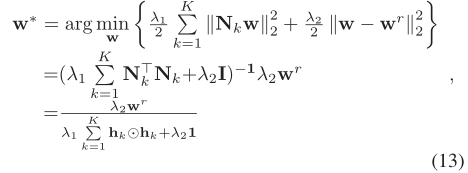

如果式中其他变量是固定的,w的求解:

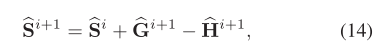

拉格朗日乘数^S更新:我们更新拉格朗日乘数为

因此,可以通过迭代应用上述四个步骤进行优化过程,包括:(1)求解H,(2)求解G,(3)求解w,(4)更新拉格朗日乘子^S。收敛后,可以得到最优的滤波参数H∗(及其傅里叶变换G∗)和空间正则化权值w∗。

分割线-------------------------------------------------------

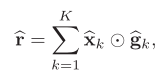

对于跟踪,被跟踪对象的位置可以在傅里叶域中确定为

我们采用深度和浅层特征的集合进行目标定位(具体实现见第5节),得到响应图后,根据最大响应得到最优位置。

模型更新:

η是在线学习速率,^X*是当前观测值。

同时,我们将引用权重更新为wr←w∗。

尺度估计:

以往的做法是对搜索区域的多个分辨率使用学习滤波器,这样做1)耗时.2)池化丢失信息,尺度估计不准确

在本研究中,我们尝试学习两个CF模型(一个位置CF用于目标定位,另一个尺度CF用于尺度估计)。

基于深度和浅层特征的集合训练目标定位的位置CF模型。虽然该CF模型的提取过程比较耗时,但在跟踪过程中只需要在一个尺度搜索区域内进行提取。

在每一帧中,首先使用具有复杂特征的定位CF模型估计位置,然后使用尺度 CF模型基于5个尺度 HOG特征图调整scale。

实验

- 基于MatConvNet工具箱的MA TLAB2017a平台实现。

- 在对象表示方面,我们利用了深度特征(来自VGG-M的Norm1,来自VGG-16的Conv4-3)和手工特征(HOG)的集成。

- 我们仅使用五个尺度的HOG特征进行尺度估计。 根据经验选取λ1= 0.2, λ2= 0.001的正则化参数。

- 我们将ASRCF模型的学习率设置为η =0.0186,并使用三步迭代进行ADMM优化过程。

- ADMM的惩罚因子μ初始设置为1,然后由μ(i+1)= m in (μmax,β μ(i))更新,其中β = 10, μmax= 10^4

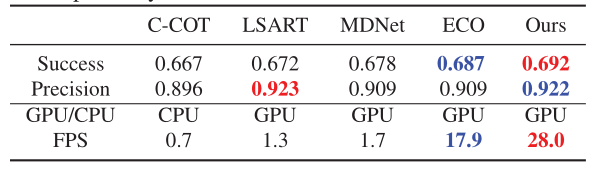

OTB2015

LaSOT

定性评价我们的跟踪器和相关算法on: Bird1, Biker, Freeman4, Human3和Singer2序列:

VOT:

Ablation analysis on OTB2015:

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?