LinearRegression(线性回归)

回归是一种解题的方法,或者说是“学习的方法”,也是机器学习中比较重要的概念。 回归一词的英文是Regression,单词原型regress大概的意思是“回退,倒退,退化”。 其实Regression回归分析的意思借用了这么一层含义,是由果索因的过程,是一种归 纳的思想。当看到大量的事实所呈现的状态,推断出原因是如何的;当看到大量的数 字的时候,推断出他们之间的关系是什么样的。

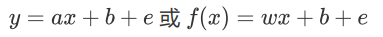

线性回归是利用数理统计中回归分析来确定两种或两种以上变量间相互依赖的定量关系的一种统计分析方法。公式为:

e为误差服从均值为0 的高斯分布。

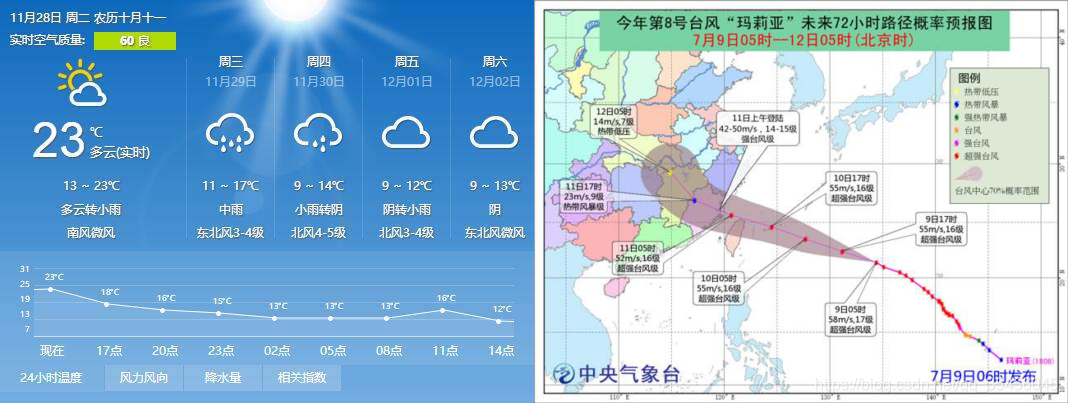

现实生活中有很多的东西和线性回归有着密切的关系,在气温预测,台风行径预测,风速预测,贷款金额预测等等。

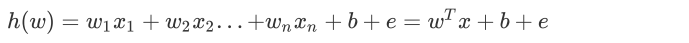

我们经常使用的回归叫做多元一次回归方程:

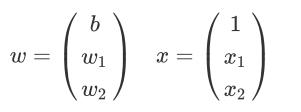

其中w,x是一个矩阵:

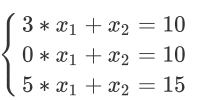

用函数分段的方式表示:

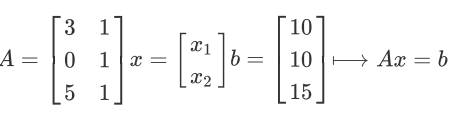

矩阵的表示方式

回归

人类的生长是一个回归的过程,比如,七坐八趴。

狗,狗到几岁的时候就Over了。

回归分析:Y是因变量,X是解释型的变量

- 线性回归中,Y是一组连续的数字

- 预测2020年上海3号线大柏树房价为多少。

- 信用卡,你的额度是多少。

- 演员的电影,分析演员具有哪些特质会收到大众的喜爱(比如公益:喜欢指数是多少)。

- 零一回归中,Y是"是"或"不是"

- 能不能办理信用卡

- 定序回归中,Y是"图书"或者"游戏"或者"运动"或者是…

- 计数回归中,Y是数字,计算你有多少个包,是一个整数

- 生存回归中,Y是一个范围(70+)

普通线性回归

import numpy as np

以一个具体的例子来看。假设一帮孩子和家长出去旅游,去程坐的是bus,小孩票价为3元,家长票价为3.2元,总价是118.4元;回程坐的是Train,小孩票价为3.5元,家长票价为3.6元,总价是135.2元。问题是分别求小孩和家长的人数。我们就可以用下列矩阵求之。

普通的:

3 x 1 + 3.2 x 2 = 118.4 3x_1 + 3.2x_2 = 118.4 3x1+3.2x2=118

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

466

466

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?