Coursera吴恩达机器学习week4笔记

最新推荐文章于 2022-10-02 19:59:14 发布

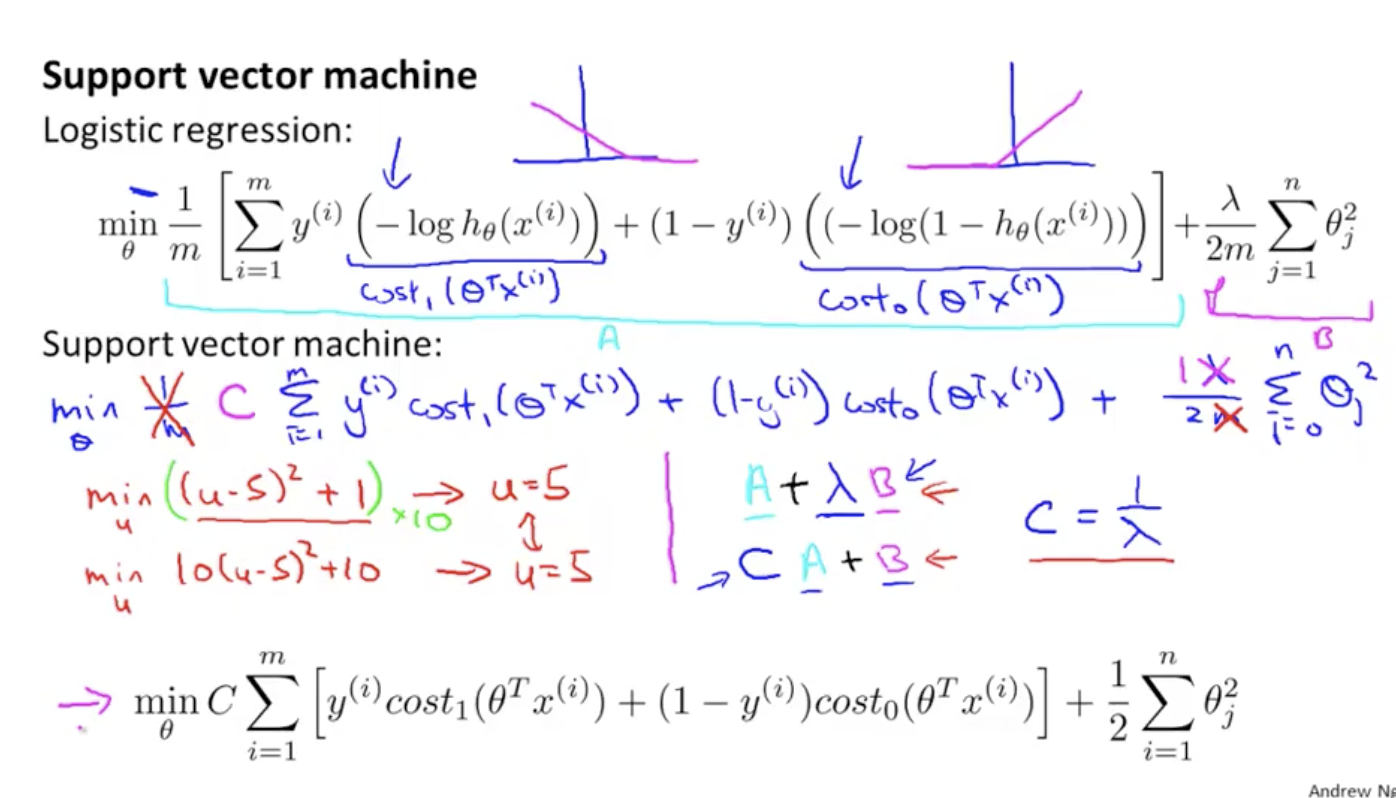

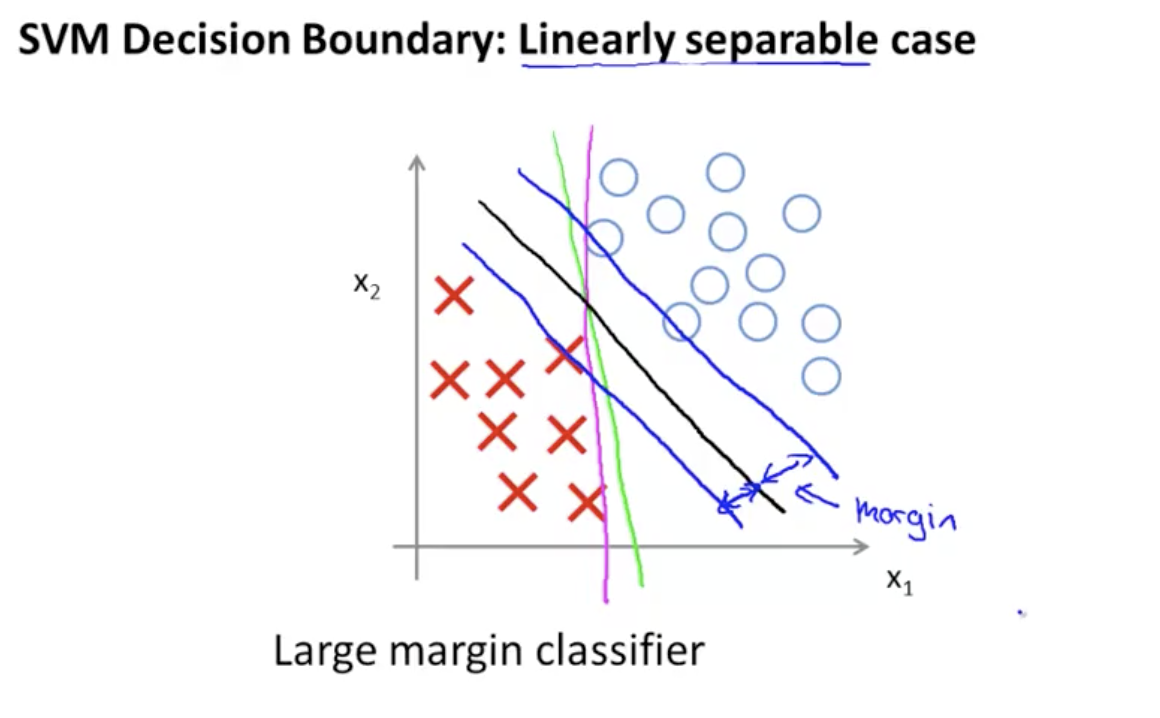

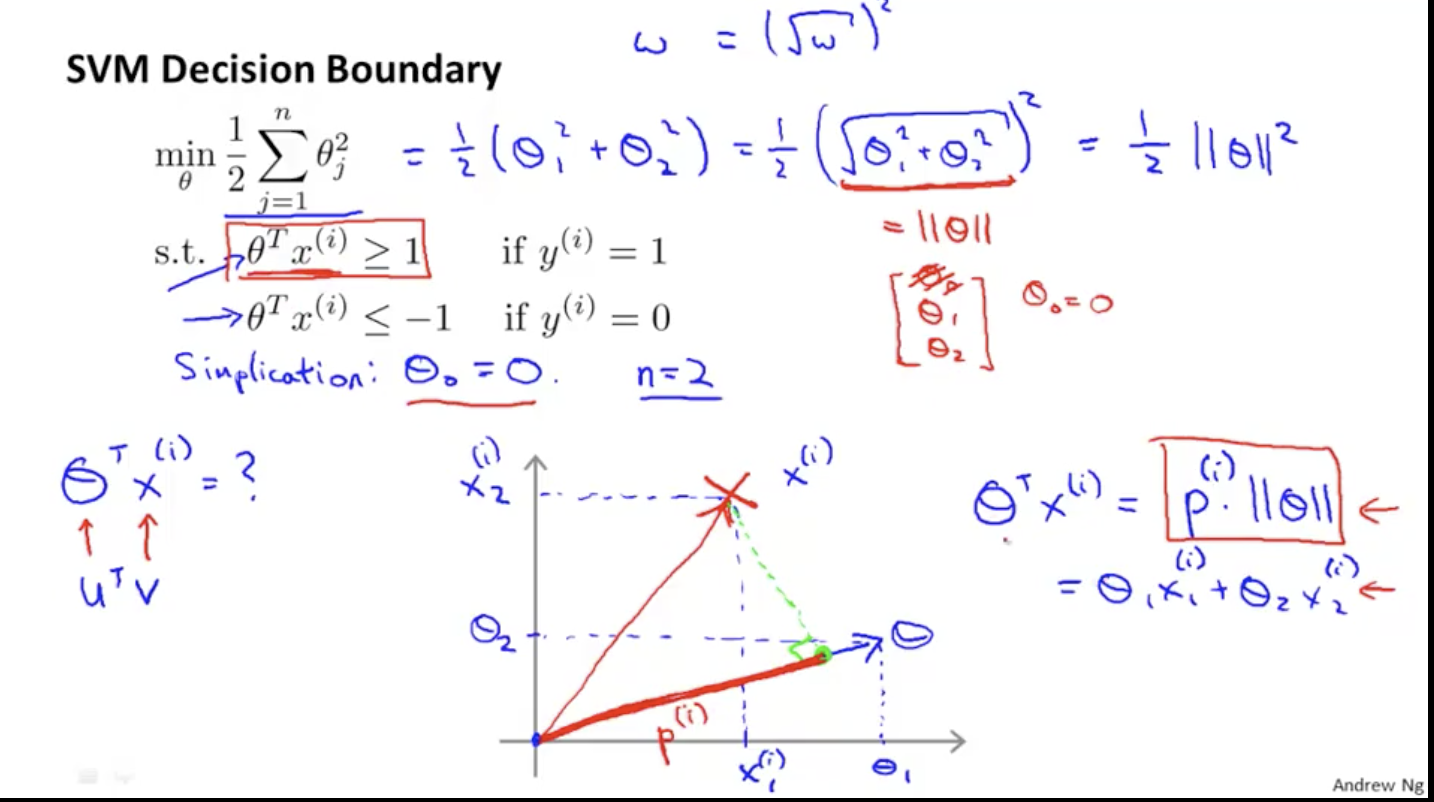

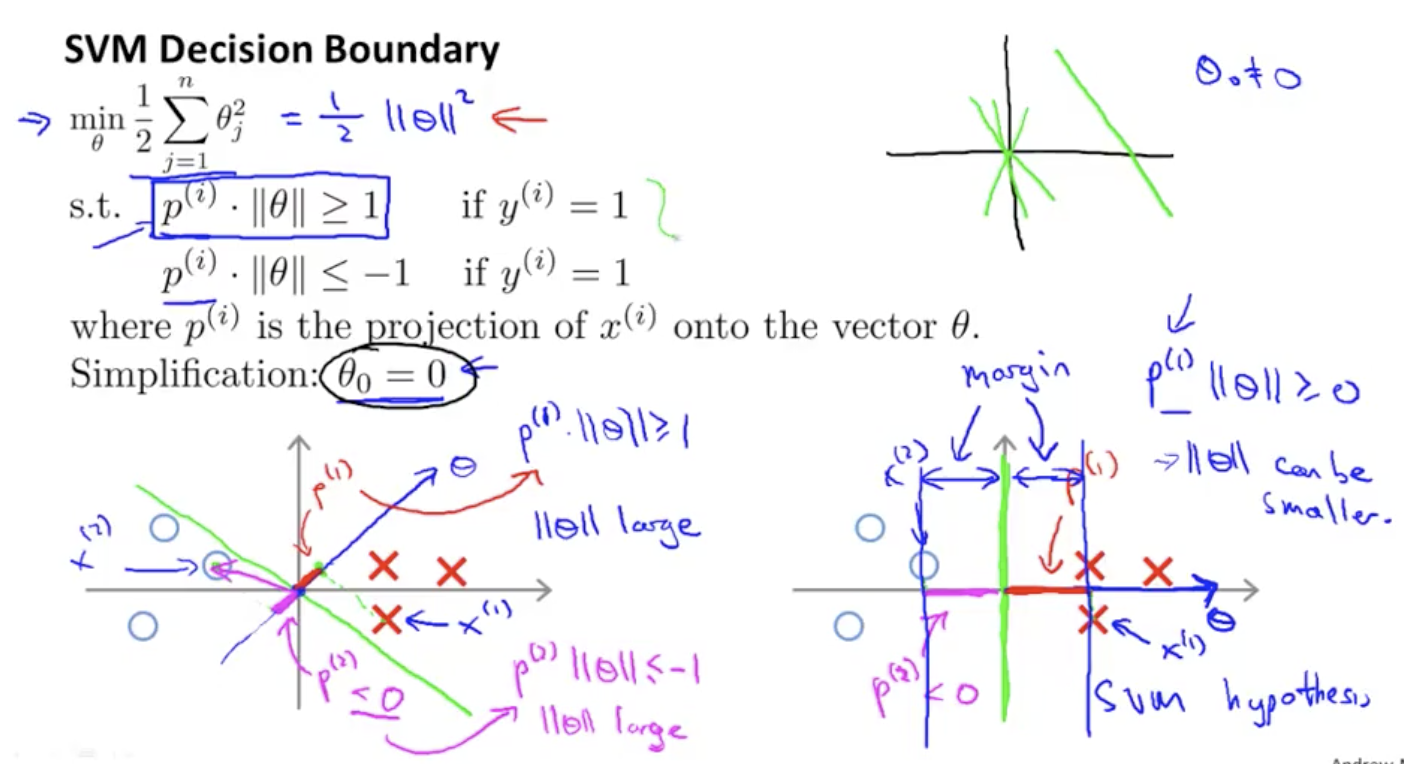

本文深入探讨了支持向量机(SVM)的数学原理,包括大边距分类的直观理解,以及如何通过核函数(Kernels)将非线性可分问题转化为线性可分问题。文中详细解释了高斯核函数的应用,并提及其他不常用的核函数如多项式核、字符串核、卡方核和直方图交叉核。此外,还讨论了在实现SVM时如何选择和处理核函数,以及如何利用标记点(landmark)进行预测。

本文深入探讨了支持向量机(SVM)的数学原理,包括大边距分类的直观理解,以及如何通过核函数(Kernels)将非线性可分问题转化为线性可分问题。文中详细解释了高斯核函数的应用,并提及其他不常用的核函数如多项式核、字符串核、卡方核和直方图交叉核。此外,还讨论了在实现SVM时如何选择和处理核函数,以及如何利用标记点(landmark)进行预测。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

970

970

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?