AGI 时代,AI 无处不在,形成新的社会分层:

- AI 使用者,使用别人开发的 AI 产品

- AI 产品开发者,设计和开发 AI 产品

- 基础模型相关,训练基础大模型,或为大模型提供基础设施

越向下层,重要性越高,从业人数越少。

AI 产品开发者的核心能力模型

三懂:

- 懂业务,就是懂用户、懂客户、懂需求、懂市场、懂运营、懂商业模式

- 懂 AI,就是懂 AI 能做什么,不能做什么;怎样才能做得更好,更快,更便宜

- 懂编程,就是懂如何编程实现一个符合业务需求的产品

建议:

-

编程向的,要尽可能靠近业务,争取全栈,否则走不远

-

业务向的,试试学编程,自主性更强。AI 编程,门槛已经低多了(但绝不是没门槛)

-

原理:不懂原理就不会举一反三,走不了太远。

-

实践:不懂实践就只能纸上谈兵,做事不落地。

-

认知:认知不高就无法做对决策,天花板太低。

大模型 AI 能干什么?

大模型,全称「大语言模型」,英文「Large Language Model」,缩写「LLM」。

| 国家 | 公司 | 对话产品 | 大模型 | 网址 |

|---|---|---|---|---|

| 美国 | OpenAI | ChatGPT | GPT-3.5、GPT-4 | https://chat.openai.com/ |

| 美国 | Microsoft | Copilot | GPT-4 和未知 | https://copilot.microsoft.com/ |

| 美国 | Gemini | Gemini | https://bard.google.com/ | |

| 美国 | Anthropic | Claude | Claude | https://claude.ai/ |

| 中国 | 百度 | 文心一言 | 文心 4.0 | https://yiyan.baidu.com/ |

| 中国 | 阿里 | 通义千问 | 通义千问 | https://tongyi.aliyun.com/qianwen |

| 中国 | 智谱 AI | 智谱清言 | GLM-4 | https://chatglm.cn/ |

| 中国 | 月之暗面 | Kimi Chat | Moonshot | https://kimi.moonshot.cn/ |

| 中国 | MiniMax | 星野 | abab6 | https://www.xingyeai.com/ |

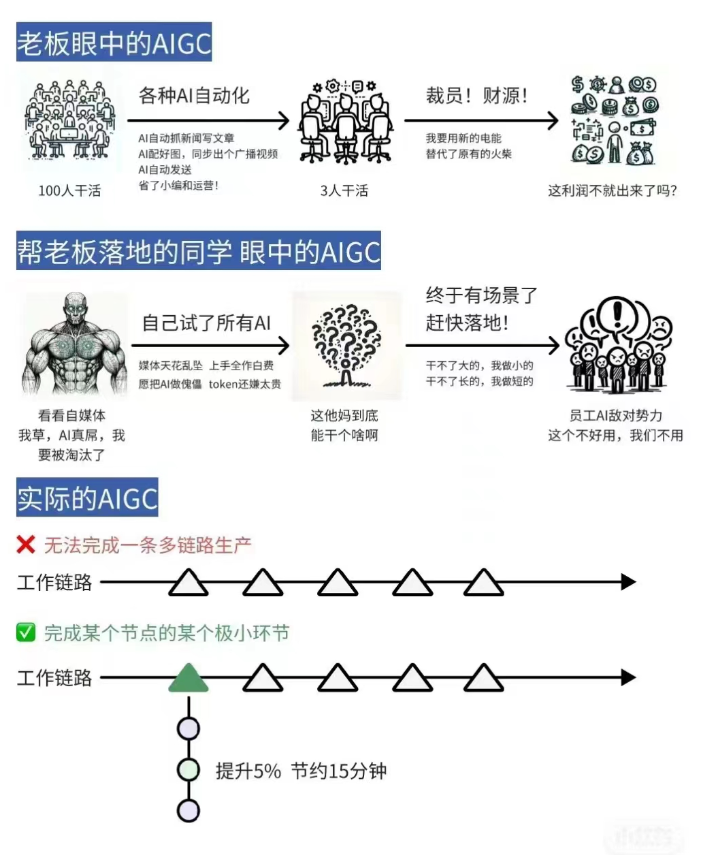

当下,如何发挥大模型的现有能力呢?最大障碍是没有形成认知对齐。

- 业务人员的积极

- 对 AI 能力的认知

- 业务团队自带编程能力

- 小处着手

- 老板的耐心

找落地场景的思路:

- 从最熟悉的领域入手

- 找「文本进、文本出」的场景

- 别求大而全。将任务拆解,先解决小任务、小场景

- 让 AI 学最厉害员工的能力,再让 ta 辅助其他员工,实现降本增效

大模型是怎么生成结果的?

通俗原理

其实,它只是根据上文,猜下一个词(的概率)……

OpenAI 的接口名就叫「completion」,也证明了其只会「生成」的本质。

下面用程序演示「生成下一个字」。你可以自己修改 prompt 试试。还可以使用相同的 prompt 运行多次。

略深一点的通俗原理

训练和推理是大模型工作的两个核心过程。

用人类比,训练就是学,推理就是用。学以致用,如是也。

用不严密但通俗的语言描述训练和推理的原理:

训练:

- 大模型阅读了人类说过的所有的话。这就是「机器学习」

- 训练过程会把不同 token 同时出现的概率存入「神经网络」文件。保存的数据就是「参数」,也叫「权重」

推理:

- 我们给推理程序若干 token,程序会加载大模型权重,算出概率最高的下一个 token 是什么

- 用生成的 token,再加上上文,就能继续生成下一个 token。以此类推,生成更多文字

Token 是什么?

- 可能是一个英文单词,也可能是半个,三分之一个

- 可能是一个中文词,或者一个汉字,也可能是半个汉字,甚至三分之一个汉字

- 大模型在开训前,需要先训练一个 tokenizer 模型。它能把所有的文本,切成 token

再深一点点

这套生成机制的内核叫「Transformer 架构」。Transformer 仍是主流,但其实已经不是最先进的了。

| 架构 | 设计者 | 特点 | 链接 |

|---|---|---|---|

| Transformer | 最流行,几乎所有大模型都用它 | OpenAI 的代码 | |

| RWKV | PENG Bo | 可并行训练,推理性能极佳,适合在端侧使用 | 官网、RWKV 5 训练代码 |

| Mamba | CMU & Princeton University | 性能更佳,尤其适合长文本生成 | GitHub |

目前只有 transformer 被证明了符合 scaling-law。(缩放定律) 算力越大效果越好

用好 AI 的核心心法

OpenAI 首席科学家 Ilya Sutskever 说过:

数字神经网络和人脑的生物神经网络,在数学原理上是一样的。

所以,我们要:

把 AI 当人看

- 用「当人看」来理解 AI

- 用「当人看」来控制 AI

- 用「当人看」来说服别人正确看待 AI 的不足

当什么人呢?

- 学习时当老师

- 工作时当助手

- 休闲时当朋友

这是贯彻整门课的心法,乃至我们与 AI 相伴的人生的心法。

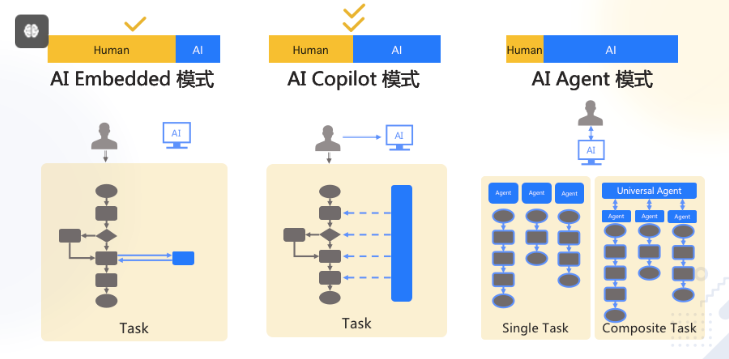

大模型应用业务架构

Agent 还太超前,Copilot 值得追求。

理清业务,拆出 SOP,非常关键。

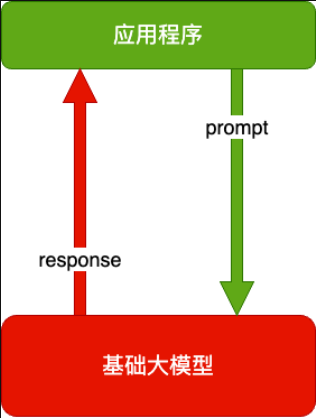

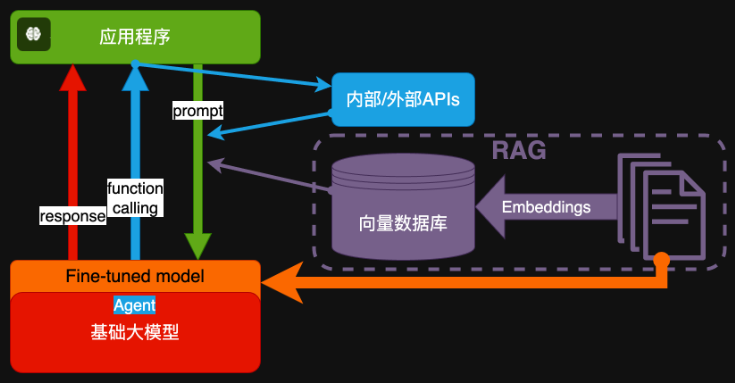

大模型应用技术架构

大模型应用技术特点:门槛低,天花板高。

纯 Prompt

当人看:你说一句,ta 回一句,你再说一句,ta 再回一句……

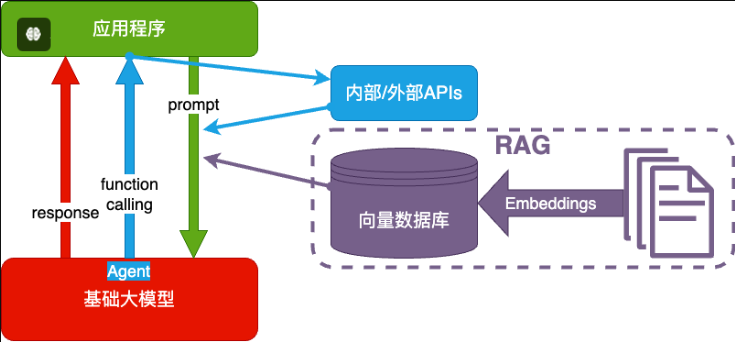

Agent + Function Calling

- Agent:AI 主动提要求

- Function Calling:AI 要求执行某个函数

- 当人看:你问 ta 过年去哪玩,ta 先问你有多少预算

### RAG(Retrieval-Augmented Generation)检索增强生成

### RAG(Retrieval-Augmented Generation)检索增强生成

- Embeddings:把文字转换为更易于相似度计算的编码。这种编码叫向量

- 向量数据库:把向量存起来,方便查找

- 向量搜索:根据输入向量,找到最相似的向量

- 当人看:考试答题时,到书上找相关内容,再结合题目组成答案,然后,就都忘了

百分之80的行业大模型都是用Rag做的,都没有做训练,因为用不上,解决效果足够好,成本还低,实时性好,我个人理解像动态库

Fine-tuning(精调/微调)

当人看:努力学习考试内容,长期记住,活学活用。

得到专有的垂直领域大模型

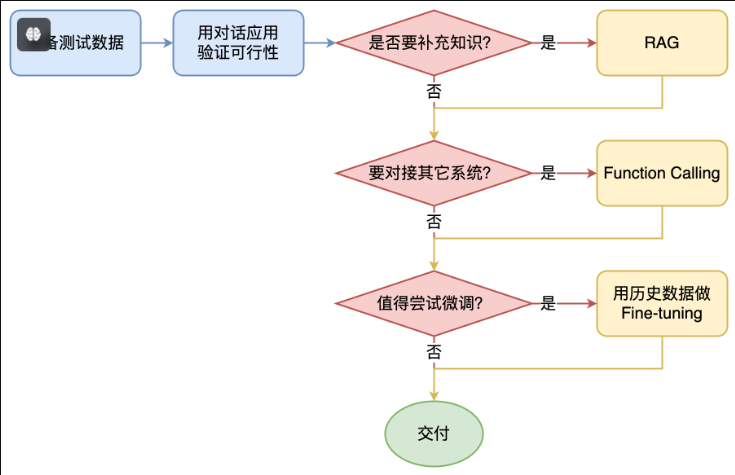

如何选择技术路线

面对一个需求,如何开始,如何选择技术方案?下面是个不严谨但常用思路。

其中最容易被忽略的,是准备测试数据

值得尝试 Fine-tuning 的情况:

- 提高模型输出的稳定性

- 用户量大,降低推理成本的意义很大

- 提高大模型的生成速度

- 需要私有部署

如何选择基础模型

基础模型选型,也是个重要因素。合规和安全是首要考量因素。

**划重点:**没有最好的大模型,只有最适合的大模型

| 需求 | 国外闭源大模型 | 国产闭源大模型 | 开源大模型 |

|---|---|---|---|

| 国内 2C | 🛑 | ✅ | ✅ |

| 国内 2G | 🛑 | ✅ | ✅ |

| 国内 2B | ✅ | ✅ | ✅ |

| 出海 | ✅ | ✅ | ✅ |

| 数据安全特别重要 | 🛑 | 🛑 | ✅ |

然后用测试数据,在可以选择的模型里,做测试,找出最合适的。

推荐:

- 用 ChatALL 做测试,比较高效

- 唯一值得相信的榜单:LMSYS Chatbot Arena Leaderboard

文章探讨了AGI(人工智能通用)时代中AI的广泛应用,强调了AI产品开发者的重要性,以及他们所需的三懂能力(懂业务、懂AI和懂编程)。文章还分析了如何利用大模型如GPT系列,提出成功落地大模型的关键要素,包括认知对齐、业务人员的认知、编程能力等,并讨论了技术架构和应用策略。

文章探讨了AGI(人工智能通用)时代中AI的广泛应用,强调了AI产品开发者的重要性,以及他们所需的三懂能力(懂业务、懂AI和懂编程)。文章还分析了如何利用大模型如GPT系列,提出成功落地大模型的关键要素,包括认知对齐、业务人员的认知、编程能力等,并讨论了技术架构和应用策略。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?