PCA主成分分析

1.概念

PCA通过线性变换将原始数据变换为一组各维度线性无关的表示,可用于提取数据的主要特征分量,常用于高维数据的降维。

很多机器学习算法的复杂度和数据的维数有着密切关系,甚至与维数呈指数级关联。当然,这里区区五维的数据,也许还无所谓,但是实际机器学习中处理成千上万甚至几十万维的情况也并不罕见,在这种情况下,机器学习的资源消耗是不可接受的,因此我们必须对数据进行降维。

鉴于实际数据本身常常存在的相关性,我们可以想办法在降维的同时将信息的损失尽量降低。

举个例子,淘宝店铺的数据,从经验我们可以知道,“浏览量”和“访客数”往往具有较强的相关关系,而“下单数”和“成交数”也具有较强的相关关系。这里我们非正式的使用“相关关系”这个词,可以直观理解为“当某一天这个店铺的浏览量较高(或较低)时,我们应该很大程度上认为这天的访客数也较高(或较低)”。后面的章节中我们会给出相关性的严格数学定义。这种情况表明,如果我们删除浏览量或访客数其中一个指标,我们应该期待并不会丢失太多信息。因此我们可以删除一个,以降低机器学习算法的复杂度。

2.原理

(1)坐标变换:

用(3,2)与第一个基做内积运算,作为第一个新的坐标分量,然后用(3,2)与第二个基做内积运算,作为第二个新坐标的分量。实际上,我们可以用矩阵相乘的形式简洁的表示这个变换:

(1/2–√−1/2–√1/2–√1/2–√)(32)=(5/2–√−1/2–√)

(

1

/

2

1

/

2

−

1

/

2

1

/

2

)

(

3

2

)

=

(

5

/

2

−

1

/

2

)

例如(1,1),(2,2),(3,3),想变换到刚才那组基上,则可以这样表示:

(1/2–√−1/2–√1/2–√1/2–√)(112233)=(2/2–√04/2–√06/2–√0)

(

1

/

2

1

/

2

−

1

/

2

1

/

2

)

(

1

2

3

1

2

3

)

=

(

2

/

2

4

/

2

6

/

2

0

0

0

)

一般的,如果我们有M个N维向量,想将其变换为由R个N维向量表示的新空间中,那么首先将R个基按行组成矩阵A,然后将向量按列组成矩阵B,那么两矩阵的乘积AB就是变换结果,其中AB的第m列为A中第m列变换后的结果。

数学表示为:

⎛⎝⎜⎜⎜⎜p1p2⋮pR⎞⎠⎟⎟⎟⎟(a1a2⋯aM)=⎛⎝⎜⎜⎜⎜⎜p1a1p2a1⋮pRa1p1a2p2a2⋮pRa2⋯⋯⋱⋯p1aMp2aM⋮pRaM⎞⎠⎟⎟⎟⎟⎟

(

p

1

p

2

⋮

p

R

)

(

a

1

a

2

⋯

a

M

)

=

(

p

1

a

1

p

1

a

2

⋯

p

1

a

M

p

2

a

1

p

2

a

2

⋯

p

2

a

M

⋮

⋮

⋱

⋮

p

R

a

1

p

R

a

2

⋯

p

R

a

M

)

抽象的说,一个矩阵可以表示一种线性变换。

(2)协方差矩阵及优化目标

如果基的数量少于向量本身的维数,则可以达到降维的效果。但是我们还没有回答一个最最关键的问题:如何选择基才是最优的。或者说,如果我们有一组N维向量,现在要将其降到K维(K小于N),那么我们应该如何选择K个基才能最大程度保留原有的信息

数据由五条记录组成,将它们表示成矩阵形式:

(1113234424)

(

1

1

2

4

2

1

3

3

4

4

)

其中每一列为一条数据记录,而一行为一个字段。为了后续处理方便,我们首先将每个字段内所有值都减去字段均值,其结果是将每个字段都变为均值为0(这样做的道理和好处后面会看到)。

我们看上面的数据,第一个字段均值为2,第二个字段均值为3,所以变换后:

(−1−2−10002101)

(

−

1

−

1

0

2

0

−

2

0

0

1

1

)

如何选择这个方向(或者说基)才能尽量保留最多的原始信息呢?一种直观的看法是:希望投影后的投影值尽可能分散。

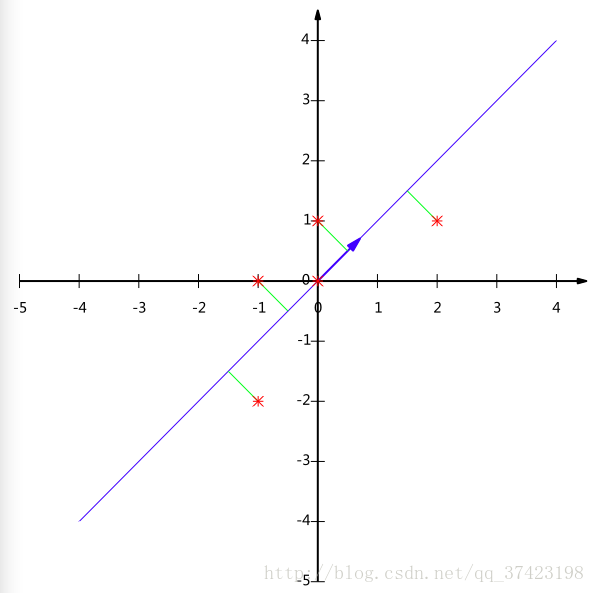

上图如果将二维转为一维,x轴投影y轴投影都不能很好的把数据点分开,所以 y=x y = x 直线非常适合投影,如果向x轴投影,那么最左边的两个点会重叠在一起,中间的两个点也会重叠在一起,于是本身四个各不相同的二维点投影后只剩下两个不同的值了,这是一种严重的信息丢失,同理,如果向y轴投影最上面的两个点和分布在x轴上的两个点也会重叠。所以看来x和y轴都不是最好的投影选择。

方差:

上文说到,我们希望投影后投影值尽可能分散,而这种分散程度,可以用数学上的方差来表述。此处,一个字段的方差可以看做是每个元素与字段均值的差的平方和的均值,即:

Var(a)=1m∑i=1m(ai−μ)2

V

a

r

(

a

)

=

1

m

∑

i

=

1

m

(

a

i

−

μ

)

2

由于上面我们已经将每个字段的均值都化为0了,因此方差可以直接用每个元素的平方和除以元素个数表示:

Var(a)=1m∑i=1ma2i

V

a

r

(

a

)

=

1

m

∑

i

=

1

m

a

i

2

于是上面的问题被形式化表述为:寻找一个一维基,使得所有数据变换为这个基上的坐标表示后,方差值最大。

协方差

考虑三维降到二维问题。与之前相同,首先我们希望找到一个方向使得投影后方差最大,这样就完成了第一个方向的选择,继而我们选择第二个投影方向。

如果我们还是单纯只选择方差最大的方向,很明显,这个方向与第一个方向应该是“几乎重合在一起”,显然这样的维度是没有用的,因此,应该有其他约束条件。从直观上说,让两个字段尽可能表示更多的原始信息,我们是不希望它们之间存在(线性)相关性的,因为相关性意味着两个字段不是完全独立,必然存在重复表示的信息。

数学上可以用两个字段的协方差表示其相关性,由于已经让每个字段均值为0,则:

Cov(a,b)=1m∑i=1maibi

C

o

v

(

a

,

b

)

=

1

m

∑

i

=

1

m

a

i

b

i

原则:

将一组N维向量降为K维(K大于0,小于N),其目标是选择K个单位(模为1)正交基,使得原始数据变换到这组基上后,各字段两两间协方差为0,而字段的方差则尽可能大

协方差矩阵

最终要达到的目的与字段内方差及字段间协方差有密切关系。因此我们希望能将两者统一表示

假设我们只有a和b两个字段,那么我们将它们按行组成矩阵X:

X=(a1b1a2b2⋯⋯ambm)

X

=

(

a

1

a

2

⋯

a

m

b

1

b

2

⋯

b

m

)

然后我们用X乘以X的转置,并乘上系数1/m:

1mXXT=(1m∑mi=1a2i1m∑mi=1aibi1m∑mi=1aibi1m∑mi=1b2i)

1

m

X

X

T

=

(

1

m

∑

i

=

1

m

a

i

2

1

m

∑

i

=

1

m

a

i

b

i

1

m

∑

i

=

1

m

a

i

b

i

1

m

∑

i

=

1

m

b

i

2

)

这个矩阵对角线上的两个元素分别是两个字段的方差,而其它元素是a和b的协方差。两者被统一到了一个矩阵的。

协方差矩阵对角化:

我们发现要达到优化目前,等价于将协方差矩阵对角化:即除对角线外的其它元素化为0,并且在对角线上将元素按大小从上到下排列,这样我们就达到了优化目的。这样说可能还不是很明晰,我们进一步看下原矩阵与基变换后矩阵协方差矩阵的关系:

设原始数据矩阵X对应的协方差矩阵为C,而P是一组基按行组成的矩阵,设Y=PX,则Y为X对P做基变换后的数据。设Y的协方差矩阵为D,我们推导一下D与C的关系:

D=====1mYYT1m(PX)(PX)T1mPXXTPTP(1mXXT)PTPCPT

D

=

1

m

Y

Y

T

=

1

m

(

P

X

)

(

P

X

)

T

=

1

m

P

X

X

T

P

T

=

P

(

1

m

X

X

T

)

P

T

=

P

C

P

T

我们要找的P是能让原始协方差矩阵对角化的P。换句话说,优化目标变成了寻找一个矩阵P,满足 PCPT P C P T 是一个对角矩阵,并且对角元素按从大到小依次排列,那么P的前K行就是要寻找的基,用P的前K行组成的矩阵乘以X就使得X从N维降到了K维并满足上述优化条件。

协方差矩阵C是一个是对称矩阵,在线性代数上,实对称矩阵有一系列非常好的性质:

1)实对称矩阵不同特征值对应的特征向量必然正交。

2)设特征向量 λ λ 重数为r,则必然存在r个线性无关的特征向量对应于 λ λ ,因此可以将这r个特征向量单位正交化。

由上面两条可知,一个n行n列的实对称矩阵一定可以找到n个单位正交特征向量,设这n个特征向量为 e1,e2,⋯,en, e 1 , e 2 , ⋯ , e n , 我们将其按列组成矩阵:

E=(e1e2⋯en)

E

=

(

e

1

e

2

⋯

e

n

)

则对协方差矩阵C有如下结论:

ETCE=Λ=⎛⎝⎜⎜⎜⎜⎜λ1λ2⋱λn⎞⎠⎟⎟⎟⎟⎟

E

T

C

E

=

Λ

=

(

λ

1

λ

2

⋱

λ

n

)

其中 Λ Λ 为对角矩阵,其对角元素为各特征向量对应的特征值(可能有重复)。

P=ET

P

=

E

T

P是协方差矩阵的特征向量单位化后按行排列出的矩阵,其中每一行都是C的一个特征向量。如果设P按照 Λ Λ 中特征值的从大到小,将特征向量从上到下排列,则用P的前K行组成的矩阵乘以原始数据矩阵X,就得到了我们需要的降维后的数据矩阵Y。

3.实现:

总结一下PCA的算法步骤:

设有m条n维数据。

1)将原始数据按列组成n行m列矩阵X

2)将X的每一行(代表一个属性字段)进行零均值化,即减去这一行的均值

3)求出协方差矩阵 C=1mXXT C = 1 m X X T

4)求出协方差矩阵的特征值及对应的特征向量

5)将特征向量按对应特征值大小从上到下按行排列成矩阵,取前k行组成矩阵P

6)Y=PX即为降维到k维后的数据

4.实例:

这里以上文提到的 (−1−2−10002101) ( − 1 − 1 0 2 0 − 2 0 0 1 1 ) 为例,我们用PCA方法将这组二维数据其降到一维。因为这个矩阵的每行已经是零均值,这里我们直接求协方差矩阵:

C=15(−1−2−10002101)⎛⎝⎜⎜⎜⎜⎜⎜−1−1020−20011⎞⎠⎟⎟⎟⎟⎟⎟=(65454565)

C

=

1

5

(

−

1

−

1

0

2

0

−

2

0

0

1

1

)

(

−

1

−

2

−

1

0

0

0

2

1

0

1

)

=

(

6

5

4

5

4

5

6

5

)

然后求其特征值和特征向量,具体求解方法不再详述,可以参考相关资料。求解后特征值为: λ1=2,λ2=2/5 λ 1 = 2 , λ 2 = 2 / 5

其对应的特征向量分别是: c1(11),c2(−11) c 1 ( 1 1 ) , c 2 ( − 1 1 )

其中对应的特征向量分别是一个通解,c_1和c_2可取任意实数。那么标准化后的特征向量为: (1/2–√1/2–√),(−1/2–√1/2–√) ( 1 / 2 1 / 2 ) , ( − 1 / 2 1 / 2 )

因此我们的矩阵P是:

P=(1/2–√−1/2–√1/2–√1/2–√)

P

=

(

1

/

2

1

/

2

−

1

/

2

1

/

2

)

可以验证协方差矩阵C的对角化:

PCPT=(1/2–√−1/2–√1/2–√1/2–√)(6/54/54/56/5)(1/2–√1/2–√−1/2–√1/2–√)=(2002/5)

P

C

P

T

=

(

1

/

2

1

/

2

−

1

/

2

1

/

2

)

(

6

/

5

4

/

5

4

/

5

6

/

5

)

(

1

/

2

−

1

/

2

1

/

2

1

/

2

)

=

(

2

0

0

2

/

5

)

最后我们用P的第一行乘以数据矩阵,就得到了降维后的表示:

Y=(1/2–√1/2–√)(−1−2−10002101)=(−3/2–√−1/2–√03/2–√−1/2–√)

Y

=

(

1

/

2

1

/

2

)

(

−

1

−

1

0

2

0

−

2

0

0

1

1

)

=

(

−

3

/

2

−

1

/

2

0

3

/

2

−

1

/

2

)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?