ABD-Net: Attentive but diverse Person Re-Id

针对问题

局部特征

- attentive features 多样性不足

新颖点:

- 结合通道和空间信息,避免注意力机制过度集中于前景

- 加入了多样性限制,避免过度集中于相关的、冗余细节特征

- 注意力机制中的遮罩直接是通过re-id数据集训练得到

- 将两个注意力模块融入到一个主干网络中,更加轻量级

- 提出了spectral value difference orthogonality(SVDO)

摘要:

- 在整个网络中中融入了注意力模块和多样性正则化

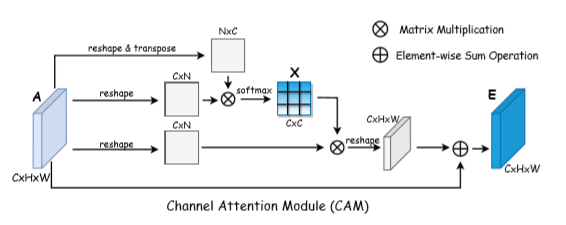

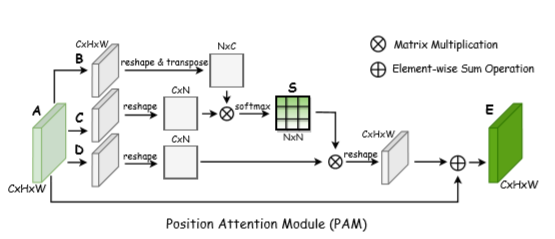

- 加入了一对互补的注意力模块,分别针对通道融合和位置感知,CAM 通道注意力模块和PAM 位置感知模块

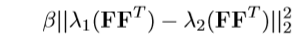

- 还加入了一个正交约束可以增强隐藏激活和权重的多样性,SVDO (spectral value difference orthogonality)直接限制weight gram matrix的条件数,可以应用在权重和激活上的,有效地减少学习到的特征相关度

注意力机制:基于通道和基于位置

假设一些通道会有相同的语义信息,在很大程度上相互关联。CAM的目的在于将这些语义上具有相同性的通道进行组合。

PAM的目的则在于捕捉和整合那些语义相关的空间像素点。

多样性:正交规范化

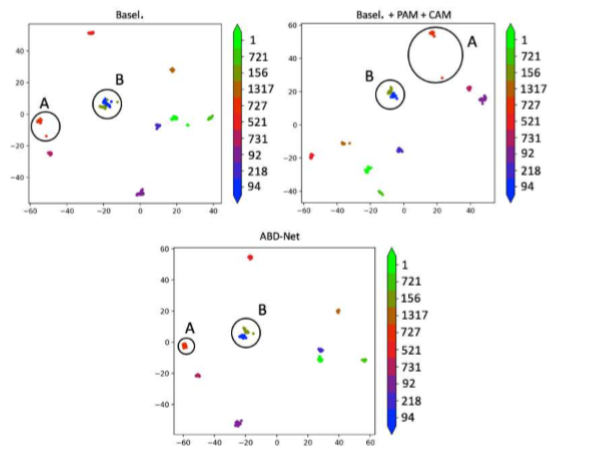

正交规范化适用于卷积层和全连接层的隐藏特征和权重。用于特征空间的正交规范化(orthogonality regularizer on feature space,O.F.)能够减少直接有助于匹配的关联特征,用于权重的正交规范化(orthogonality regularizer on weight,O.W.)能够增加过滤器的多样性,增强学习能力。

许多正交方法都是通过正交权重的硬性约束实现的,具体来说即SVD,但SVD的计算成本过高。一些现在的非硬性(soft)规范化要求格拉姆矩阵 F 等同于一个在 Frobenius范数下的矩阵,但是由于矩阵秩的不足,可能会使 F 无法满足这一相同性,从而使这些规范化函数出现偏差。

而作者提出的规范化函数则通过调整

F

F

T

FF^{T}

FFT 来增强正交性,具体式子如下:

此外作者利用自动微分来获得SVDO的梯度,但是特征值(EVD)的计算成本任然很高,为避免EVD,作者用功率迭代的方法(power iteration)来近似替代特征值。

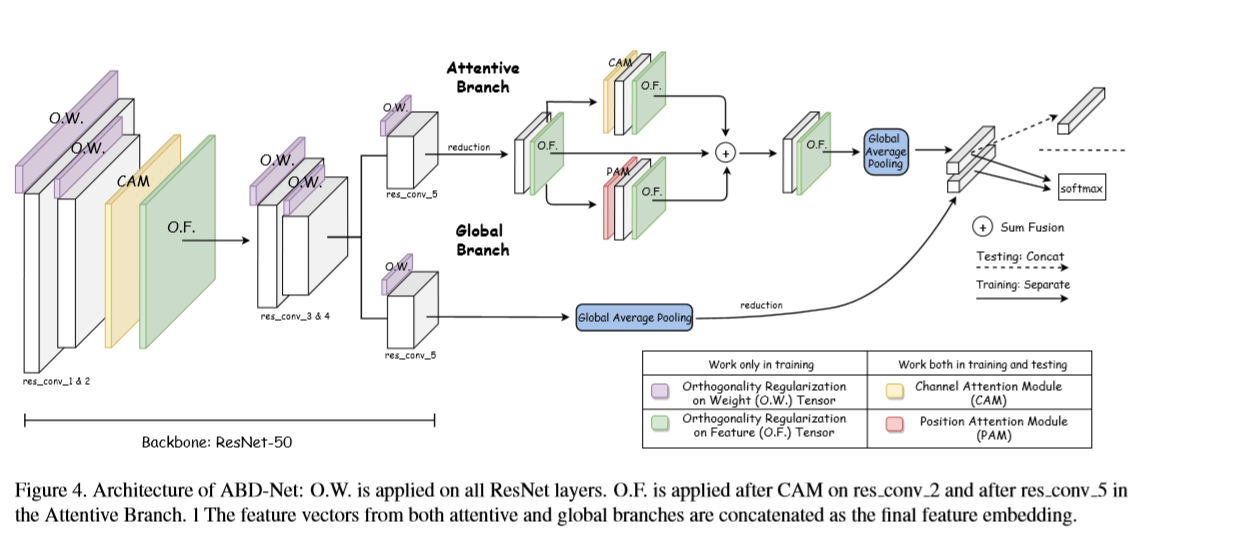

网络结构

ABD-Net和大多数的特征提取网络都是兼容的,作者选取ResNet-50作为基础版本。在res_conv_3后面加了CAM和O.F.,然后将这里的输出喂入res_conv_3。在Res_conv_4之后,网络分为了全局分支和细节分支。值得注意的是,作者在所有的卷积层中都加入了O.W. 。最后两个分支处理的结果组合在一起就是整个特征嵌入。

细节分支采用了和前面一样的res_conv_5,其输出被喂入一个带有O.F.的压缩层(reduction layer)产生一个更小的特征图 T a T_{a} Ta。然后再将 T a T_{a} Ta 分别同时喂入带有O.F.的CAM和PAM,将这两部分输出和 T a T_{a} Ta 组合在一起经过 global average pooling生成特征向量。

在全局分支中,res_conv_5的输出 T g T_{g} Tg 直接经过 global average pooling,之后再通过压缩层生成特征向量。全局分支的主要目的是作为细节分支的补充保留了全局信息。

[注] 在两个分支中为了得到更大的特征图 作者都去掉了下采样层

ABD-Net 训练采用cross entropy loss, hard mining triplet loss, O.F.和 O.W.

实验

数据集:Market-1501, DukeMTMC-Re-ID, MSMT17

输入图片:384 X 128 (including random horizontal flip, normalization, random erasing)

测试图片:384 X 128(only normalization)

输出的特征向量:2048(1024,1024)

Market-1501 top1 95.6 mAP 88.28

DukeMTMC top1 89 mAP 78.59

MSMT17 top1 82.3 mAP 60.8

问题

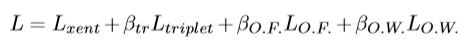

- CAM+PAM 确实会更加关注人体区域上的不同,但是也会过度注意到与人不相关的细节上去(加入正交规范化后会有所改进,即把注意力放到人的身上又消除了背景的干扰)

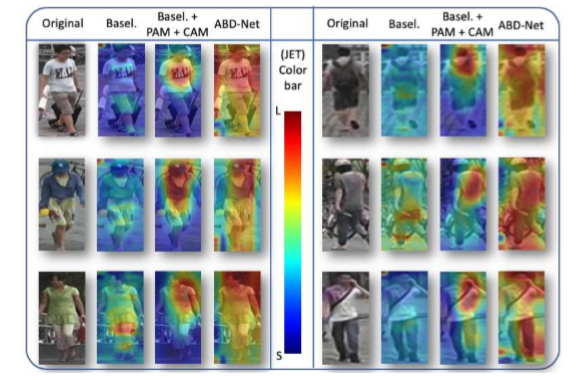

- t-SNE看来ID94和ID156并没有很好的分开,也就是说它在增大组间距离的时候并没有使组内距离增大

2185

2185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?