ValueError: Expected more than 1 value per channel when training

一、解决方案

- dataloader设置参数 drop_last=True1 丢弃掉最后单独的样本

- 在训练前用num_of_samples % batch_size 算一下会不会正好剩下一个样本2

- 如果模型只inference,无需更新参数可以设置model.eval()

- 修改源码,注释掉相关判断的源码3 (

自己心理得有数)

我遇到的问题比较奇怪,使用BatchNorm1d报错,但是BatchNorm2d就正常…

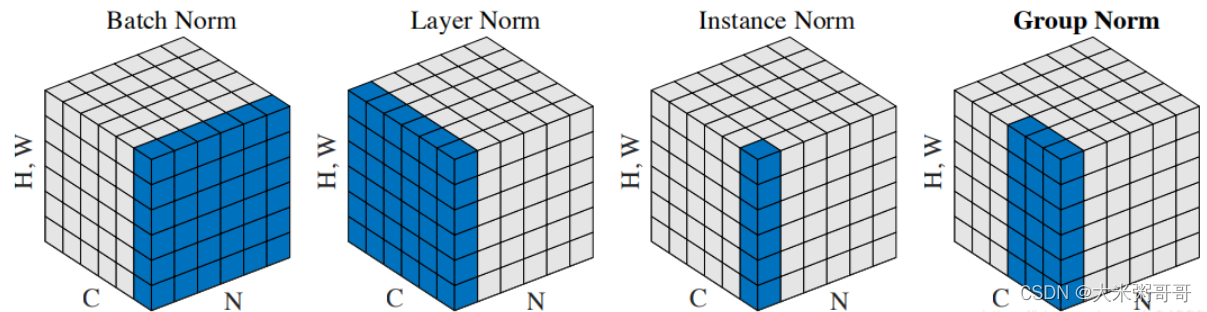

二、问题分析

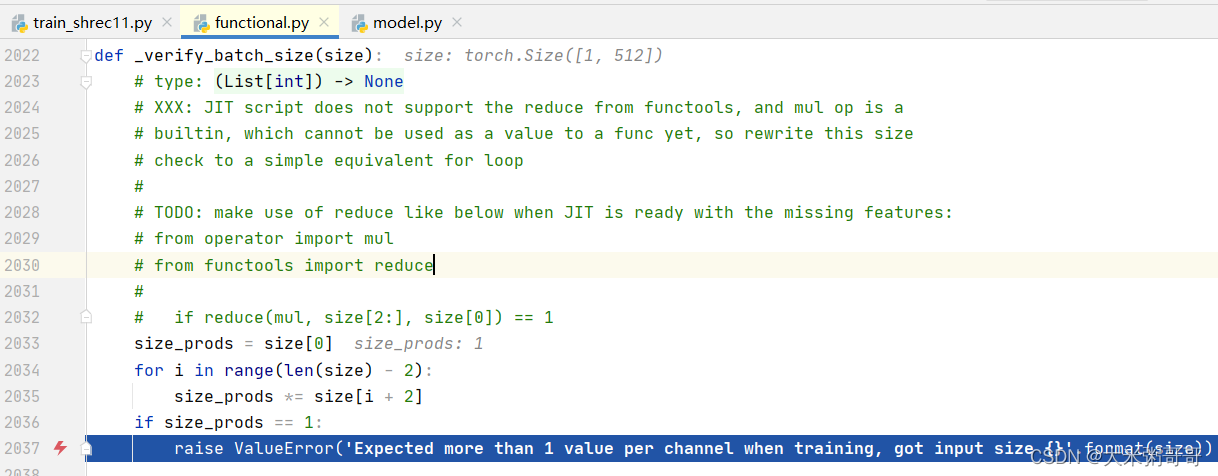

ValueError: Expected more than 1 value per channel when training, got input size torch.Size xxx

如果输入的batch size = 1就抛出ValueError,那我的BatchNorm2d是如何正常运行的?.. 继续调试:

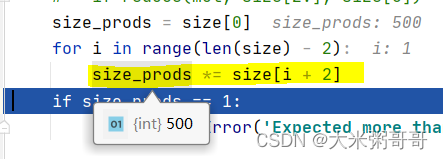

明明输入的batch_size=1,突然变成500了

擦。。输入的是:torch.Size([1, 128, 500, 1]) 经过上一行标黄处代码,size_prods变了

如果输入torch.Size([1, 512]),size_prod不会改变

为什么使用BatchNorm1d报错,但是BatchNorm2d就正常... 原来是我应用它俩的场景不一样

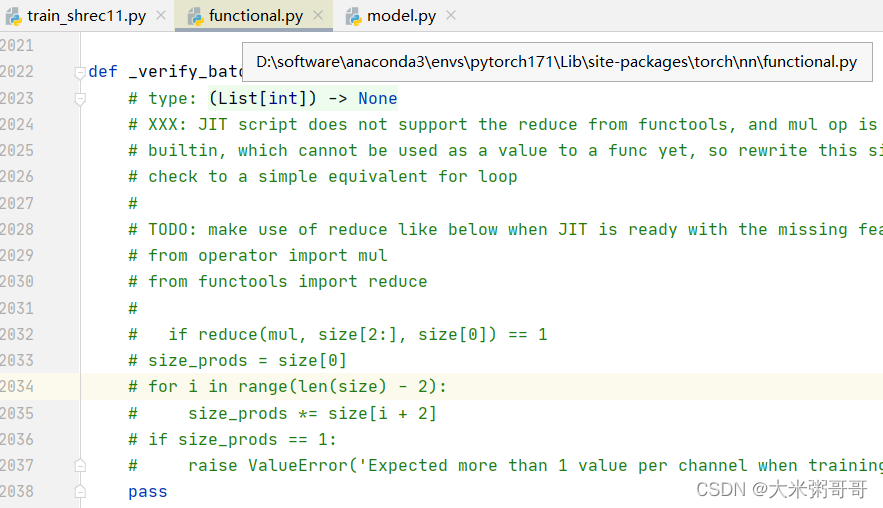

三、深入分析,修改源码

BN详解4:Batch Normalization 学习笔记

需要明确,输入的batch_size=1 或者较小的话确实会影响BN参数的更新,以至于可能影响模型最后的效果

由于个人原因,需要batch_size=1时候的实验数据,故此记录

将相关代码注释,保留源函数 加个pass空操作 - 插眼

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?