SNAL Attention for landmark Detection

基本结构简介:

模型的backbone有四个SANL attention结构,这些结构的spatial attention map自与 GCAM。模型既可以用于分类也可以用于关键点检测。总体来说是一种基于热力图的attention方法。

Attention 种类

视觉attention主要分为两类,一种是相关attention,根据feature map与关键点直接框出,比如Fashionnet。第二种是使用热力图,比如本网络。

SNAL attention结构:

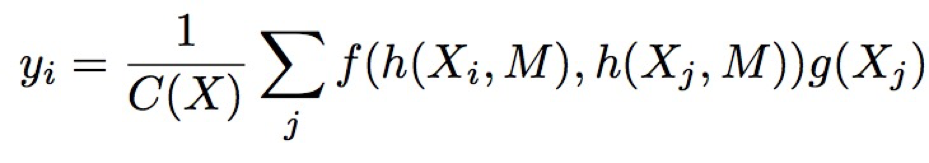

其中X是输入,M是attention map, 计算有矩阵点积和矩阵乘法,矩阵加法。

视觉attention

是一种基于像素对区域过滤的一种算法,对于feature map的激活权重一般是根据feature map的激活值加总。

残差学习机制

传统的学习机制如下

Yi= 1C(X)jf(Xi , Xj)g(Xj)

![]()

然后需要将权重与Y相乘然后再相加即可。g是计算权重函数。

然而本文中的残差学习规则更加如下

其中M是attention map, h 是使用与X 和M的转换函数。

其中M是attention map, h 是使用与X 和M的转换函数。

其中f 函数为相似度函数可以写成

![]()

landmark detect

landmark detect 的当前趋势是,从与关键点相关的热力图中进行预测,所以预测几个关键点就需要几个热力图。

Loss函数

与以往的loss使用mse或者mae不同,本文loss使用的是交叉熵

其中Cvis表示是否可见,tijc 地ij的真实landmark点,x则表示预测的点。

540

540

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?