DeepSheek

DeepSheek 是个啥我也不说了,最近好多卖课程教部署DeepSheek,感觉是个智商税,现在教大家本地简单部署下DeepSheek,很简单就两步。

第一步

打开 Ollama ,点击下载安装,默认安在C盘。

第二步 点击Models ,选择deepsheek-r1模型

安装完成后会打开一个命令行,执行命令ollama run deepseek-r1:7b 就可下载安装,选择7b 的模型就行,本地万元电脑以下也就能带动这个。

再次打开ollama

在终端cmd 中执行ollama serve。

如果报错以下端口被占用,说明你本地已经自动启动ollama服务了,如果想命令行在启动一次则可以关闭本地自动启动的ollama 程序,再执行 ollama serve

deepseek-r1 使用

- 打开cmd 执行 ollama list 查看自己本地安装的模型

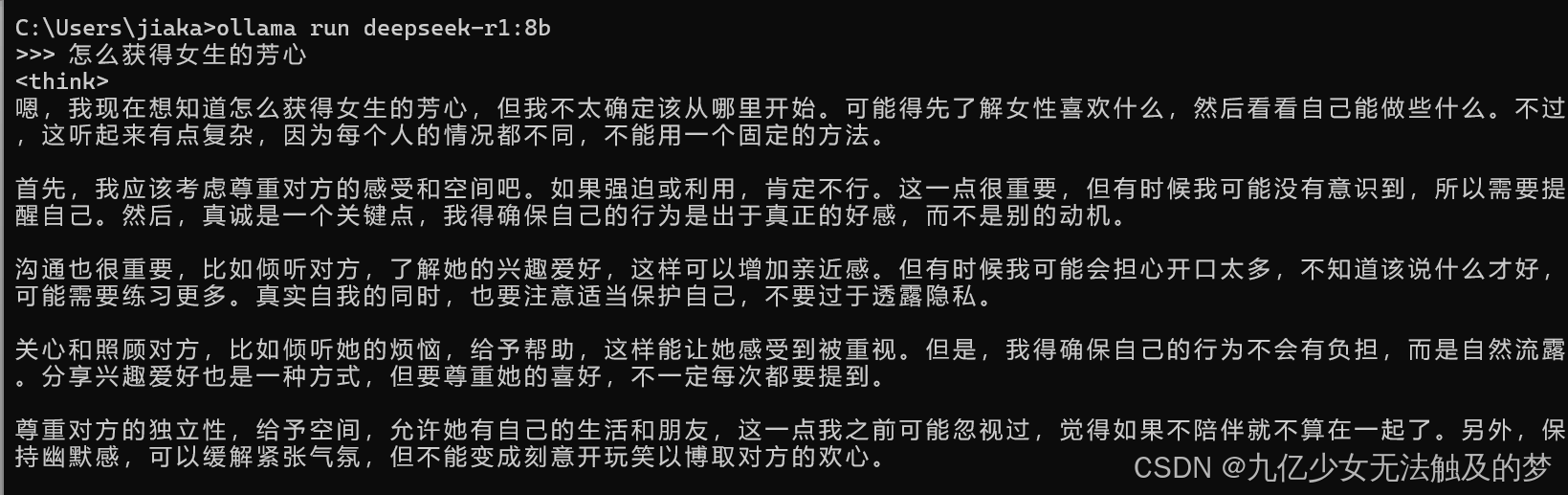

- 执行 ollama run deepseek-r1:8b 然后输入你的问题后按下回车键就可以回答你的问题了。

集成open Webui 使用

- 安装python 版本区别最好在3.11 - 3.12 之间 ,建议安装pyenv 工具管理

python 安装后使用pip 安装 open Webui

pip install open-webui

open-webui serve

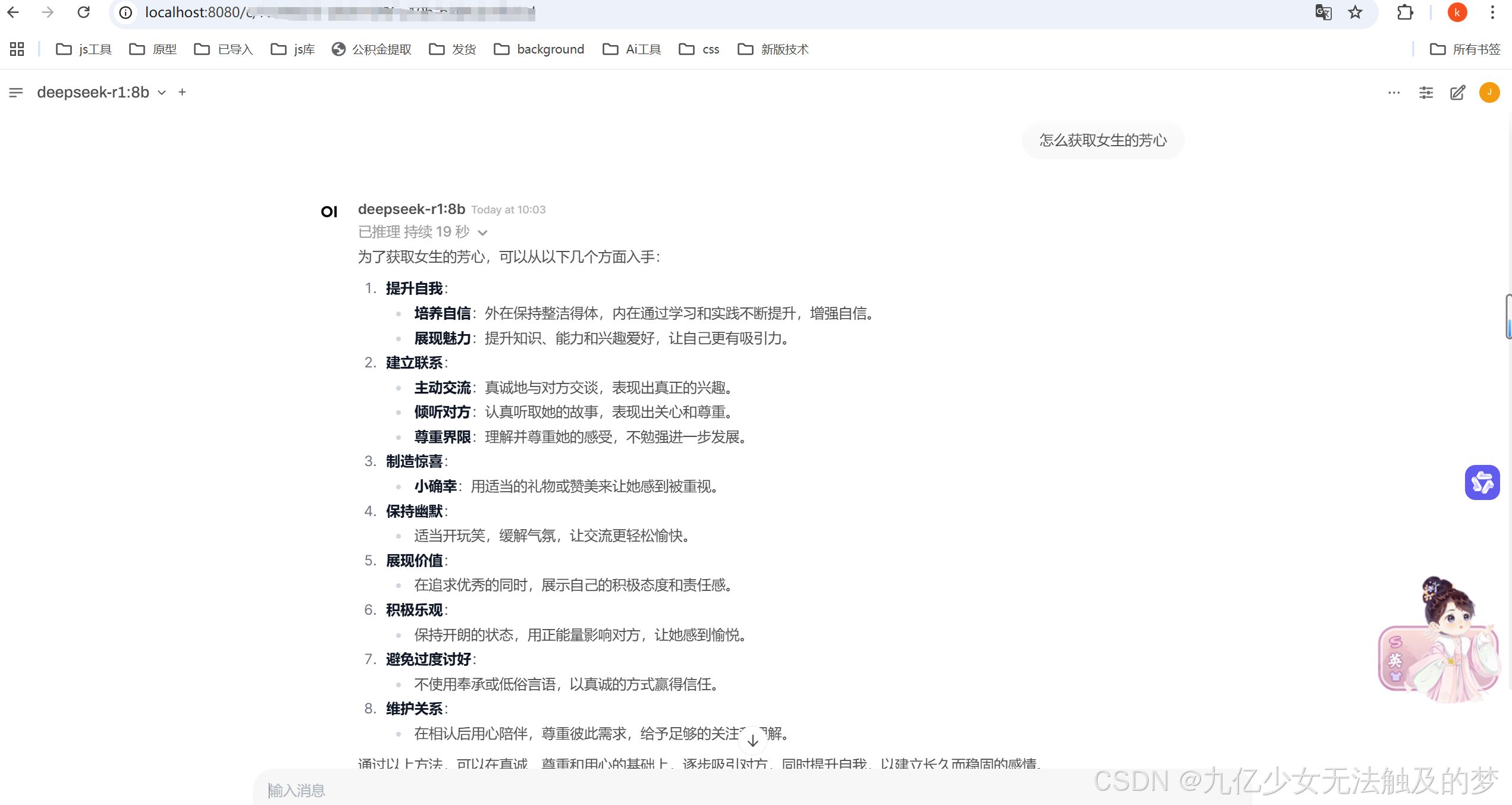

安装启动完成后浏览器打开 localhost:8080 (默认是这个,具体可以看终端日志),具体效果参考下图

1187

1187

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?