Linear Regression

目录

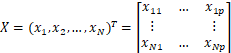

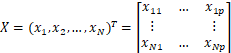

模型

![]()

![]()

![]()

![]()

推导求解

|

| 最小二乘优化 | 极大似然估计 |

| 评价函数 |

|

|

| 优化求解 |

| 假设:

|

| 最小二乘优化中隐含了一个高斯噪声?(TODO) | ||

正则化(岭回归)

在上一节中,由推导得到w的解析解

![]()

![]()

数据项 ,即有N各样本,每个样本有p维特征,当N>>p时会出现过拟合现象,即对训练集你和情况很好,但在测试集上情况不理想。

,即有N各样本,每个样本有p维特征,当N>>p时会出现过拟合现象,即对训练集你和情况很好,但在测试集上情况不理想。

解决过拟合有三种方式:

- 增加数据(数据增强)

- 特征选择/特征提取(PCA)

- 添加正则项

添加正则项后,![]()

L1正则项:![]()

L2正则项:![]()

|

| 最小二乘优化 | 极大似然估计 |

| 评价函数 |

|

|

| 优化求解 |

| 假设:

|

| 两种方法在添加正则项后依旧殊途同归 | ||

总结

最小二乘估计与极大似然估计殊途同归

线性回归解析解:![]()

添加正则项后解析解:![]()

问题

最小二乘法的几何意义?

最小二乘准则中隐含了高斯噪声的假设?

参考资料

https://www.bilibili.com/video/BV1hW41167iL(shuhuai008 bilibili)

https://github.com/ws13685555932/machine_learning_derivation(ws13685555932 github)

399

399

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?