Linear Classification

目录

线性回归与线性分类

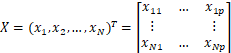

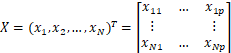

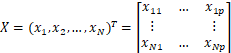

线性回归(![]() )具有线性、全局性、以及数据未加工的特点:

)具有线性、全局性、以及数据未加工的特点:

1. 线性:即变量与输出呈线性关系

特征线性:输出与输入特征x呈线性关系,打破特征线性条件即可得到多项式回归模型:![]()

系数线性:输出与学习到的系数呈线性关系,打破系数线性条件即可得到神经网络模型:![]()

输出线性:直接输出线性结果,打破系输出性条件即可得到线性分类模型,如Logistic Regression:![]()

2. 全局性:即单一映射函数作用于整个特征空间

打破全局性条件,即可得到样条回归模型、决策树模型

3. 数据未处理:即使用原始数据进行计算

打破原始数据条件即可得到PCA、流形

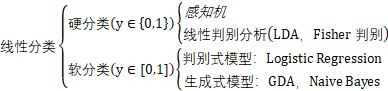

线性分类模型

感知机模型

思想:将运算结果映射到集合{0,1},从而进行二分类。

通过误分类样本更新参数,减少误分类样本数。

模型

![]()

![]()

![]()

推导求解

Loss Function:![]() ,其中

,其中 ![]()

即对分类错误的样本数进行计数,作为损失函数,然而此函数不可导,难以求解

Loss Function:![]() ,其中D为误分类样本集

,其中D为误分类样本集

PLA(感知机算法)求解

![]()

![]()

使用SGD算法迭代

若选定样本点![]() 分类错误,则更新系数

分类错误,则更新系数![]() 直至收敛

直至收敛

Pocket Algorithm

在PLA算法中,若选定样本点分类错误则更新权值,直至所有样本点均被正确分类时,迭代停止。

那么若样本点本身线性不可分,也就是始终会有样本点被错误分类,那么PLA算法将无法收敛。此时可以使用口袋算法寻找到一个误分类样本数最少的解,即![]()

算法流程如下:

1. 设当前系数为![]() ,选择样本为

,选择样本为![]()

2. 若样本被误分类,则得到系数![]()

3.若![]() 则保留原系数,重新选择样本,否则更新系数为

则保留原系数,重新选择样本,否则更新系数为![]()

4. 达到设定迭代次数停止

线性判别分析LDA

思想:选定一个最佳方向,将样本特征投影到一条直线上,使不同类数据尽可能分离。

投影后的数据需要满足两个条件:类内方差小,类间距离大

模型

![]()

![]()

![]()

![]()

![]()

![]()

![]()

推导求解

![]() 在

在![]() 方向上的投影:

方向上的投影:![]()

假设![]() ,则有

,则有![]()

类均值: ![]()

类内方差: ![]()

![]()

![]()

![]()

![]()

损失函数:![]()

![]()

优化求解:![]()

![]()

![]()

![]()

![]()

![]()

![]()

且![]()

![]() ,且

,且![]()

至此求出![]() 的解析解。

的解析解。

Logistic Regression(逻辑回归)

思想:通过sigmoid函数将输出映射到概率域,选取最大概率的结果作为分类结果。

模型

![]()

![]()

sigmoid func:![]()

![]()

![]()

![]()

求解

利用最大似然估计可得:

![]()

![]()

![]()

可以看出逻辑回归模型中,利用最大似然估计可以得到与交叉熵损失相同的结果形式

参考资料

https://www.bilibili.com/video/BV1hW41167iL(shuhuai008 bilibili)

https://github.com/ws13685555932/machine_learning_derivation(ws13685555932 github)

410

410

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?