1. 模型提示指南

1.1 Grok-1

Grok-1 是一个混合专家(MoE)大型语言模型(LLM),具有 3140 亿个参数,包括基础模型权重和网络架构的公开发布。

Grok-1 由 xAI 训练,并由 MoE 模型组成,在推理时对每个标记激活 25% 的权重。Grok-1 的预训练截止日期为 2023 年 10 月。

根据官方公告,Grok-1 是预训练阶段的原始基础模型检查点,这意味着它尚未针对特定应用(如对话代理)进行微调。

该模型已根据 Apache 2.0 许可证发布。

1.1.1 结果与能力

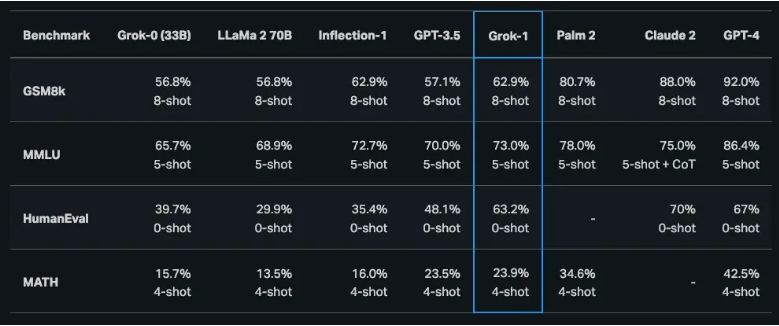

根据最初的公告,Grok-1 在推理和编码任务中表现出了强大的能力。最后一次公开可用的结果显示,Grok-1 在 HumanEval 编码任务中得分为 63.2%,在 MMLU 中得分为 73%。它通常优于 ChatGPT-3.5 和 Inflection-1,但仍落后于改进后的模型,如 GPT-4。

据报道,Grok-1在匈牙利国家高中数学期末考试中得了C&

订阅专栏 解锁全文

订阅专栏 解锁全文

5478

5478

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?