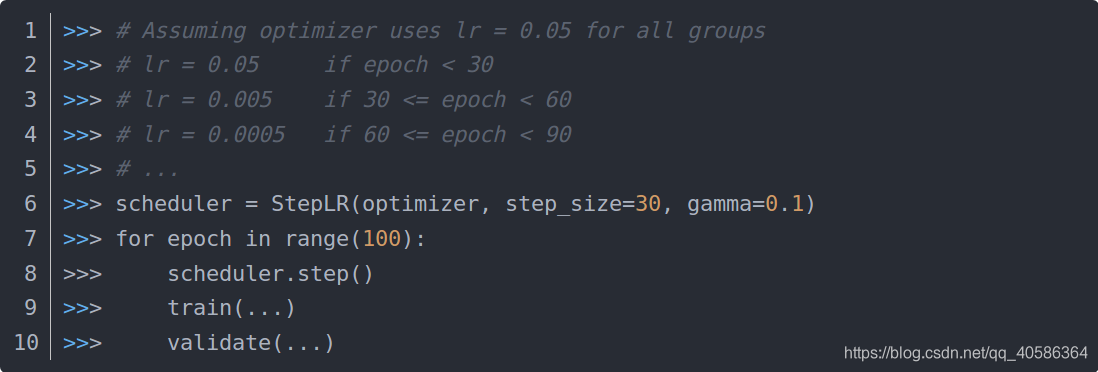

class torch.optim.lr_scheduler.StepLR(optimizer,step_size,gamma=0.1,last_epoch=-1)

设置每个参数组的学习率为lr *\lambda ^{n}, n=\frac{epoch}{step_size} ,当last_epoch=-1时,令lr=lr

参数:

optimizer(Optimizer对象)--优化器

step_size(整数类型): 调整学习率的步长,每过step_size次,更新一次学习率

gamma(float 类型):学习率下降的乘数因子

last_epoch(int类型):最后一次epoch的索引,默认为-1.

1074

1074

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?