3.1 基本形式

其中是由属性描述的示例,其中

是

在第i个属性上的取值,而

是每个属性对应的权重。其具有非常好的可解释性。

需要能够在多种模型中,辨析出线性模型。

3.2 线性回归

线性回归的目的:试图学得一个线性模型以尽可能准确地预测实际输出标记。

单个参量使用最小二乘法进行线性回归:

由此公式计算出w

再由上式得处的w计算出b

- 其中

是x的均值

3.3 对数几率回归

对数几率函数模式:

将线性回归式子带入得:

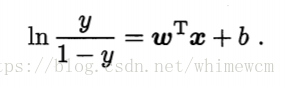

将预测值代入,可得对数几率函数:

其中y可视为样本x取得正例的可能性,1-y为取得反例的可能性,两者的比值y/(1-y)称为几率。对数几率回归也称为逻辑回归,是一种分类学习方法。

对数几率回归有以下三点优点:

- 无需事先假设数据分布

- 可得到“类别”的近似概率预测

- 可直接应用现有数值优化算法求解最优解

极大似然法:

已知某个参数能使这个样本出现的概率最大,我们当然不会再去选择其他小概率的样本,所以干脆把这个参数作为估计的真实值。

举个从袋中摸白球和黑球的例子:

一个麻袋里有白球与黑球,但是我不知道它们之间的比例,那我就有放回的抽取10次,结果我发现我抽到了8次黑球2次白球,我要求最有可能的黑白球之间的比例时,就采取最大似然估计法: 我假设我抽到黑球的概率为p,那得出8次黑球2次白球这个结果的概率为:

P(黑=8)=p^8*(1-p)^2,现在我想要得出p是多少啊,很简单,使得P(黑=8)最大的p就是我要求的结果,接下来求导的的过程就是求极值的过程啦。

在求极值之前,可以先把等式两边做ln运算,因为ln把乘法变成加法了,且不会改变极值的位置(单调性保持一致嘛)这样求导会方便很多~

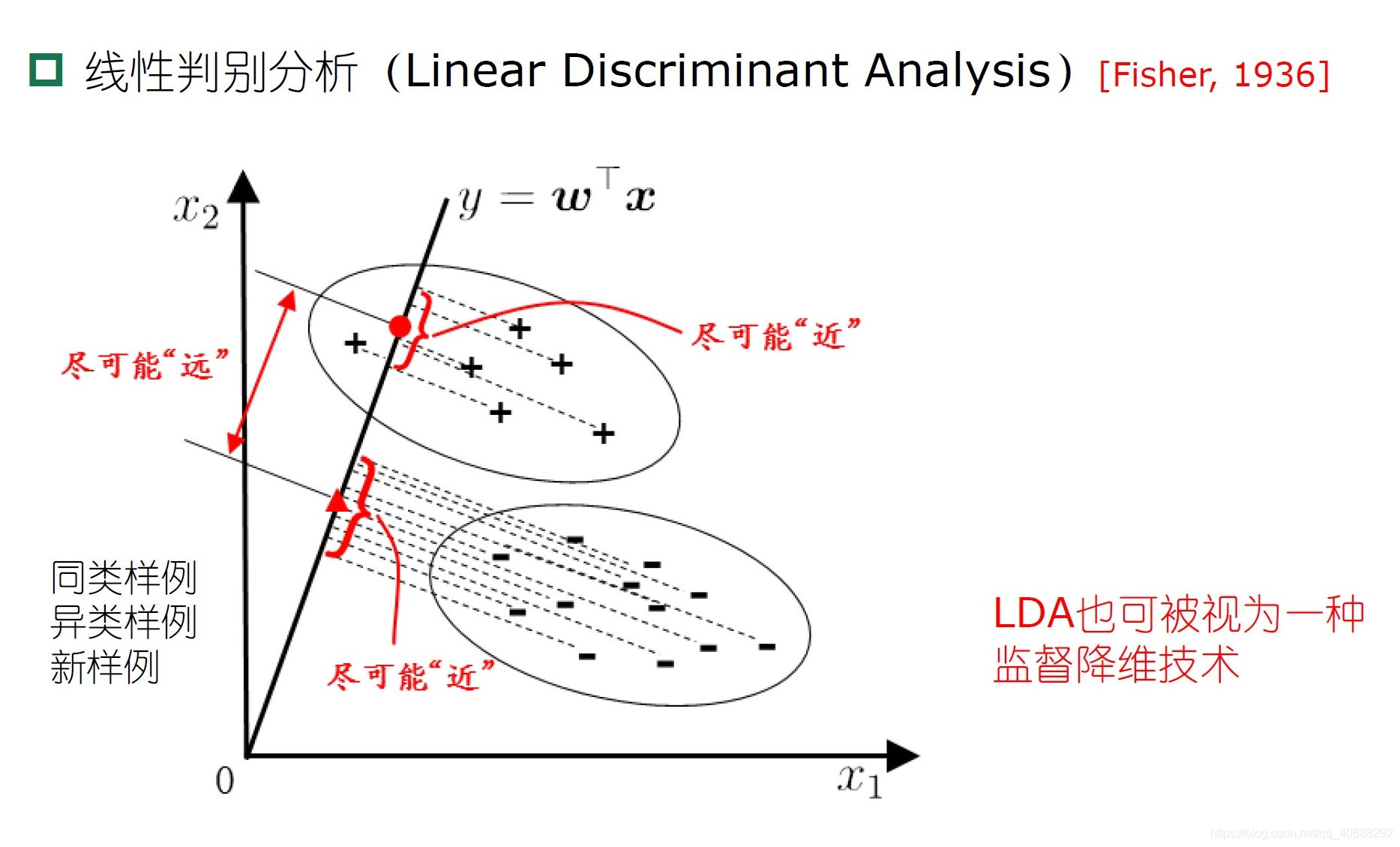

3.4 线性判别分析(LDA)

LDA的思想:

- 设法将样例投影到一条直线上

- 使得同类样例的投影点尽可能接近,可以让同类样例投影点的协方差尽可能小

- 使得异类样例的投影点尽可能远离,可以让类中心之间的距离尽可能大

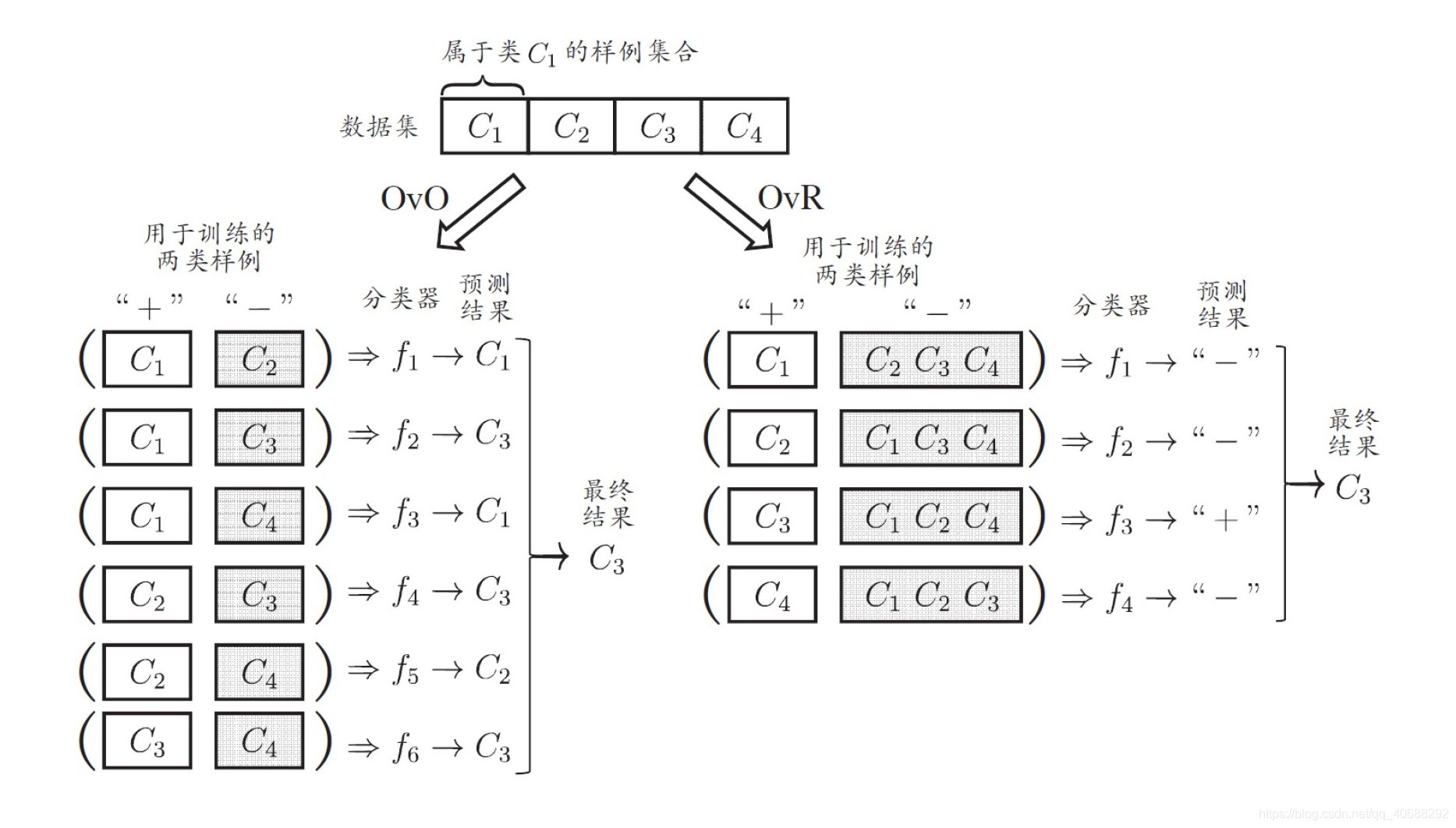

3.5 多分类学习

利用二分类学习器解决多分类问题使解决多分类学习方法中最常用的方法

- 对问题进行拆分,为拆出的每个二分类任务训练一个分类器

- 对于每个分类器的预测结果进行集成以获得最终的多分类结果

一对一(OvO拆分策略)

假设要将一个数据集分为N类,那么OvO将这N个类别两两配对。从而产生个分类器。及同样多的分类任务和分类结果。

在集成阶段通过投票产生最终分类结果(被预测最多的类别为最终类别)

一对其余(OvR拆分策略)

OvR使每次将一个类的样例作为正例、所有其他类的样例作为反例来训练N个分类器,在测试时若只有一个分类器预测为正类,则对应的类标记作为最终分类结果。若有多个被判为正类,则选择置信度最大的那类为分类结果。

OvO因需要训练更多分类器,因此OvO的存储开销和测试时间开销通常比OvR更大,但因为每个OvO分类器进用到两个类的样例,因此在类别很多时,OvO的训练时间开销更小。

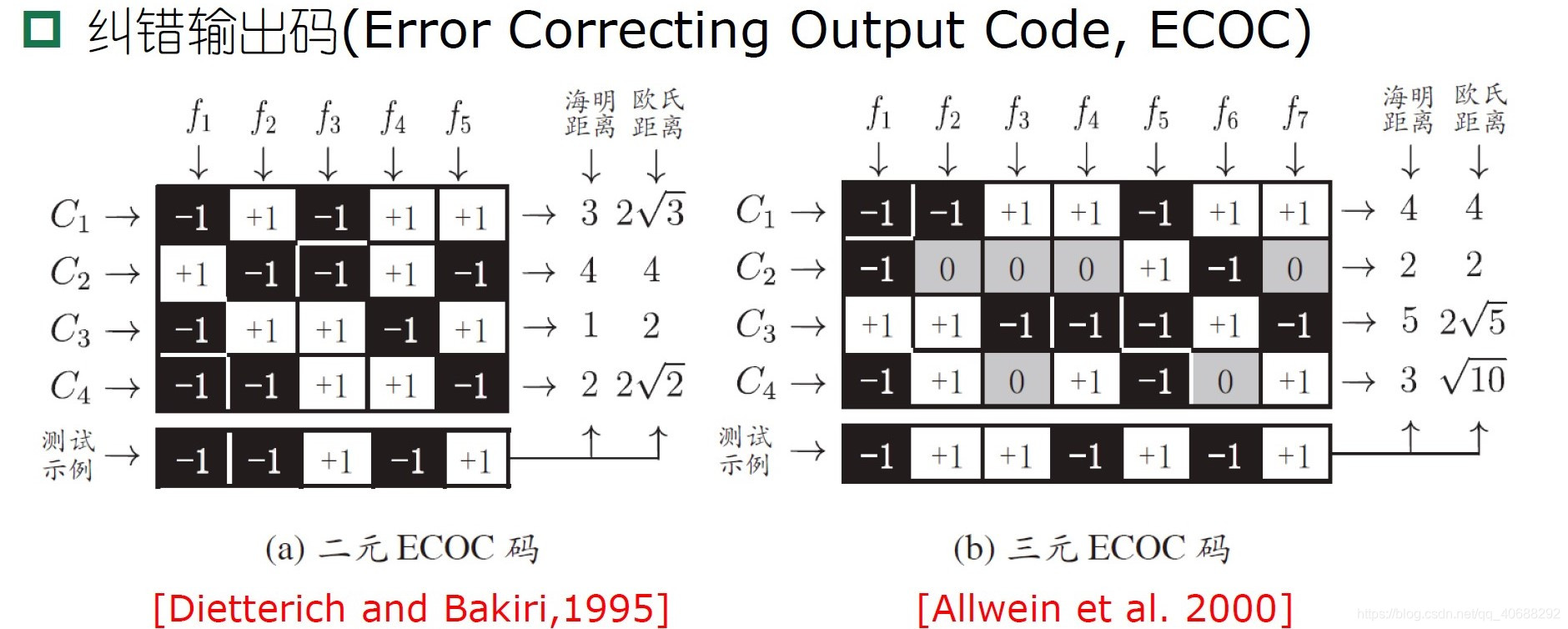

多对多(MvM策略)

若干类作为正类,若干类作为反类。

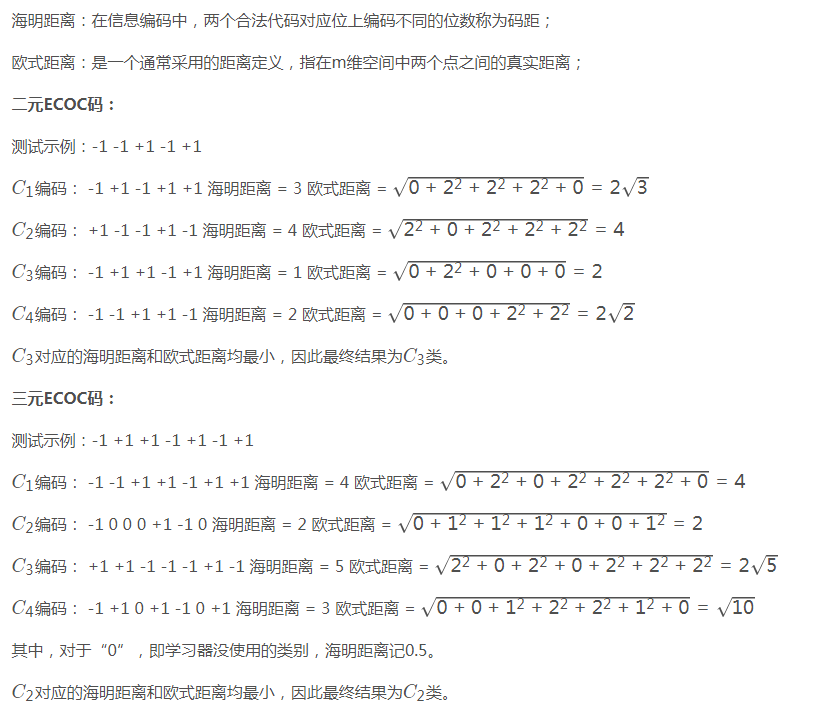

下面介绍一种常见的MvM技术:纠错输出码(Error Correcting Output Codes,ECOC)

ECOC工作过程主要分为两步:

- 编码:对N个类别做M次划分,每次划分将一部分类别划为正类,一部分划为反类,从而形成一个二分类训练集;这样一共产生M个训练集,可以训练出M个分类器。

- 解码:M个分类器分别对测试样本进行预测,这些预测标记组成一个编码,将这个预测编码与每个类别各自的编码进行比较,返回其中距离最小的类别作为最终预测结果。

ECOC编码越长,纠错能力越强,两类别之间编码距离越远,纠错能力越强

360

360

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?