预备知识

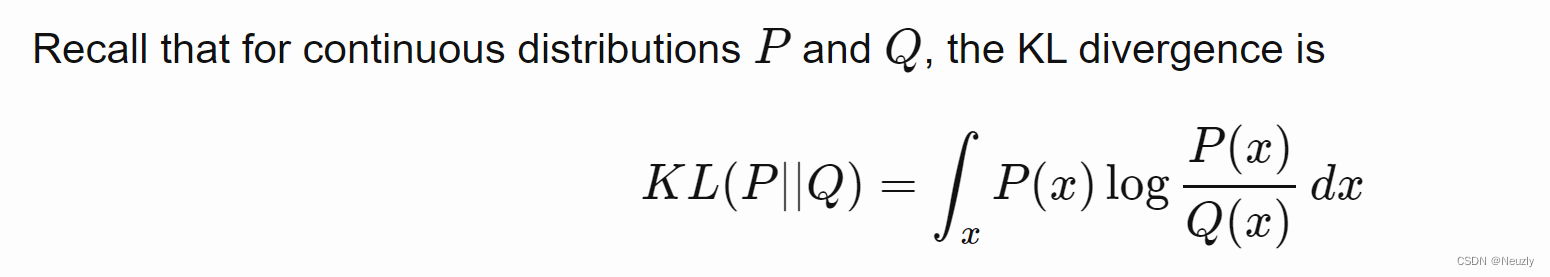

1、KL-Divergence

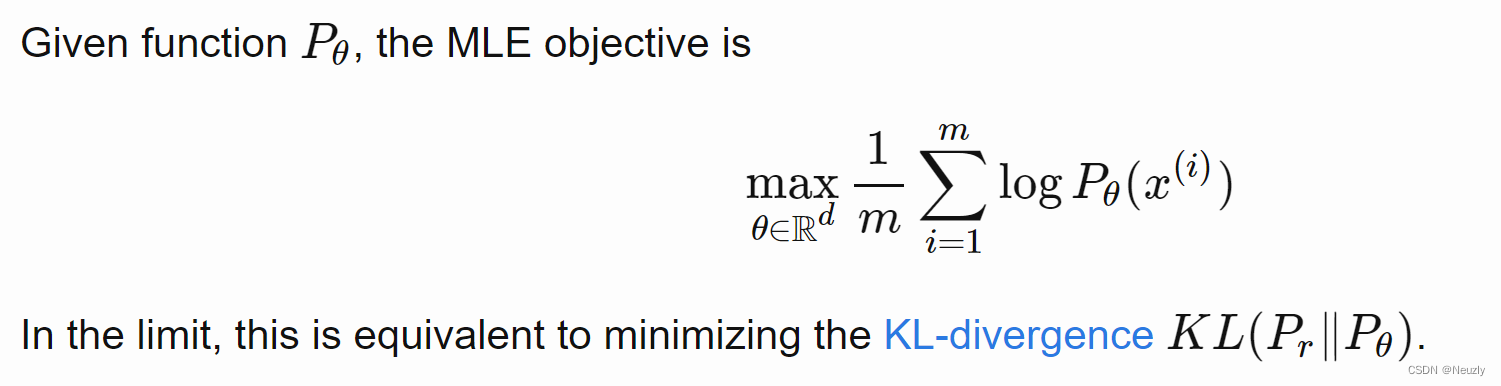

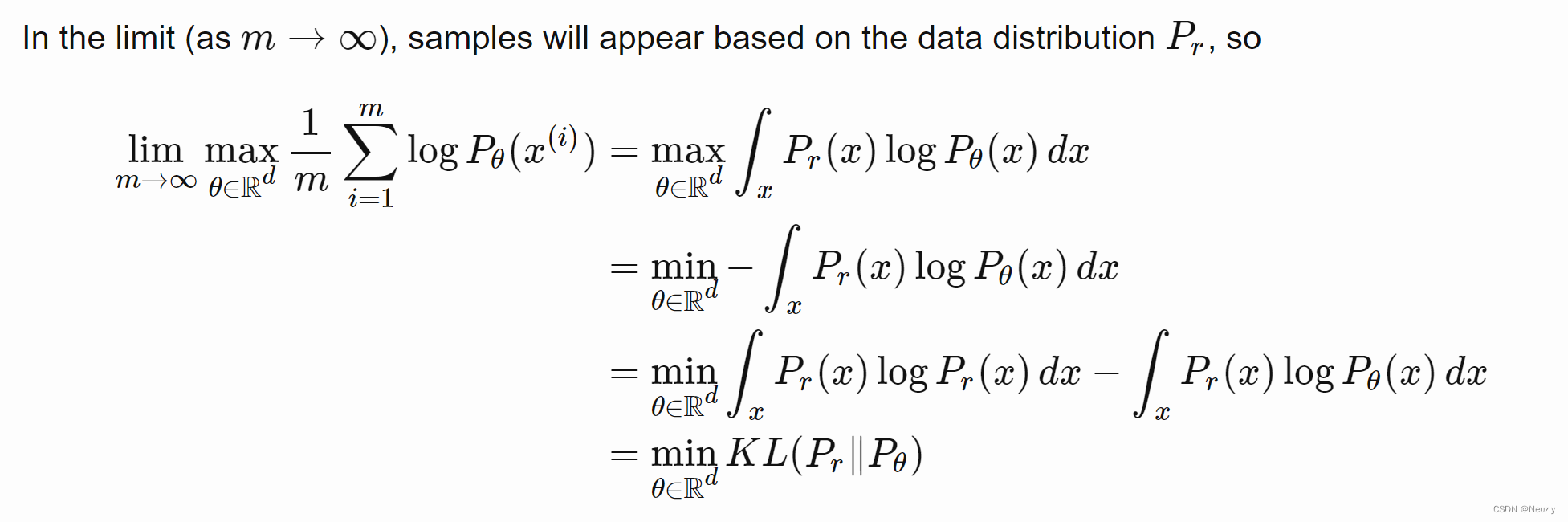

1.1 MLE(Maximum likelihood estimation)–> KL-Divergence

1.2 Why Directly learn the probability density function Pθ run into a problem.

Pθ(x)、P_r_(x)均为一个低维度流形,所以在学习Pθ(x)的过程中,Pθ(x)、P_r_(x)不可能完全重合(实际上是几乎不可能重合)。更糟糕的情况是,只要有一个real_data x0不在Pθ(x)的domian内,则此时Pθ(x)=0,从而使得KL-Divergence Explode.

推荐参考文章:

https://www.alexirpan.com/2017/02/22/wasserstein-gan.html

推荐视频:

https://www.youtube.com/watch?v=pG0QZ7OddX4&list=PLhhyoLH6IjfwIp8bZnzX8QR30TRcHO8Va&index=4

(均需要科学上网)

4471

4471

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?