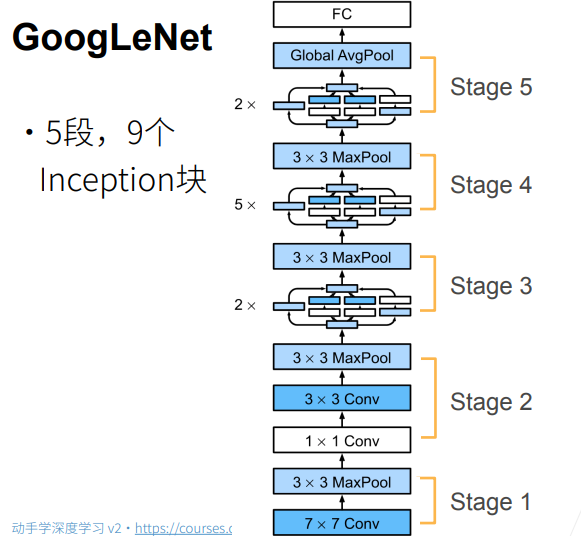

GoogleLeNet-含并行连接的网络

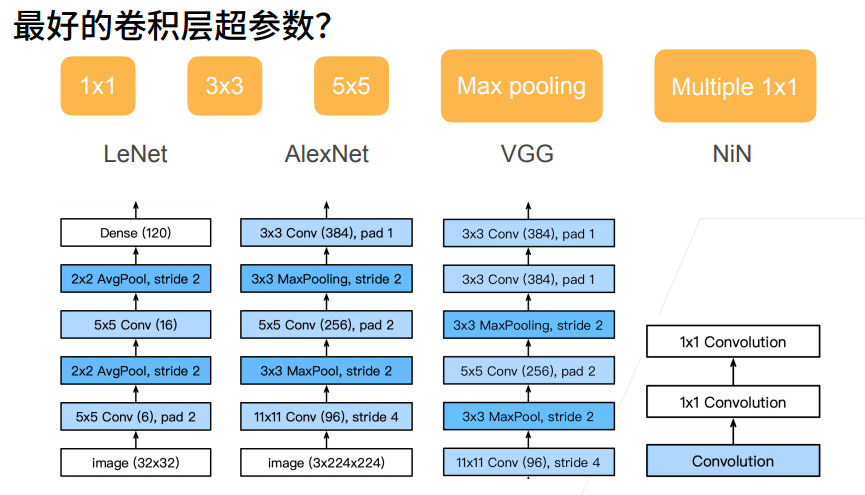

GoogleLeNet,通常简称为Inception v1,是由Google的研究者Christian Szegedy等人在2014年提出的一个深度卷积神经网络模型。Inception v1是在NiN(Network in Network)和VGGNet的基础上发展起来的,它引入了一种称为“Inception模块”的新型网络结构,通过并行地使用多种不同尺寸的卷积核和池化层来提取和组合特征。

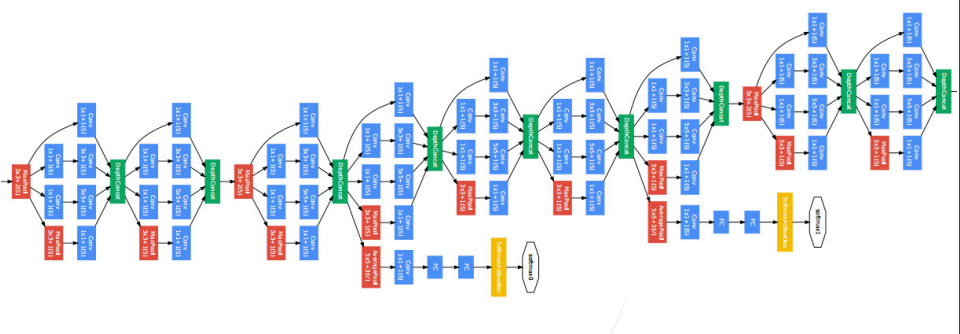

GoogleLeNet(Inception v1)的网络结构

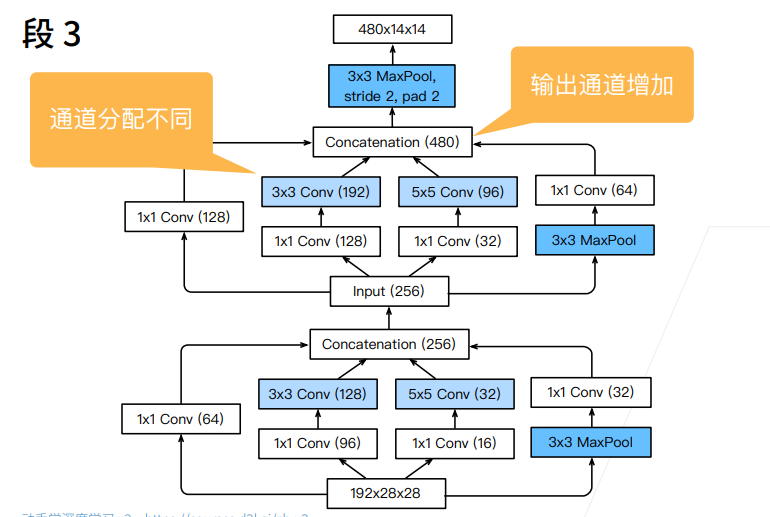

GoogleLeNet的主要创新是引入了“Inception模块”,这是一个复合结构,包括多个不同尺寸的卷积核和池化层。

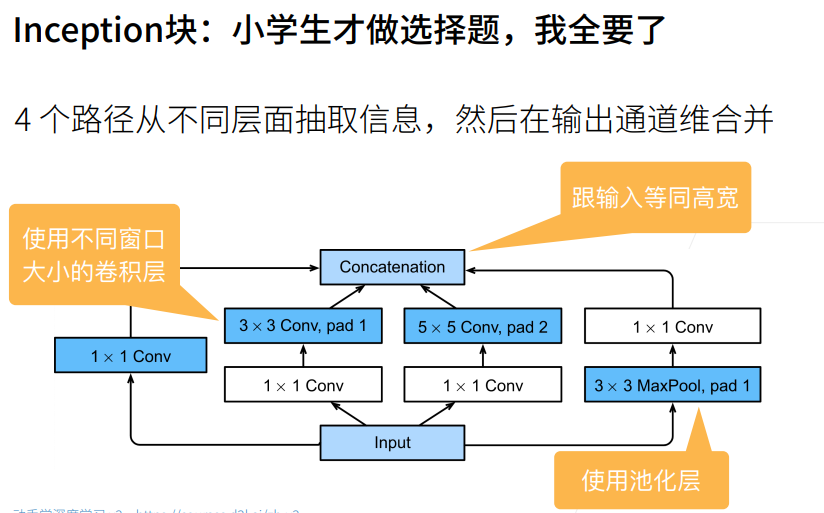

Inception 模块

一个典型的Inception模块包括:

- 1x1 卷积层:用于降低特征图的通道数,减少计算量。

- 3x3 卷积层:常规的3x3卷积核进行特征提取。

- 5x5 卷积层:用于捕捉更大范围的特征。

- 最大池化层:2x2或3x3的最大池化操作。

- 输出合并:将上述四种操作的输出在通道维度上合并。

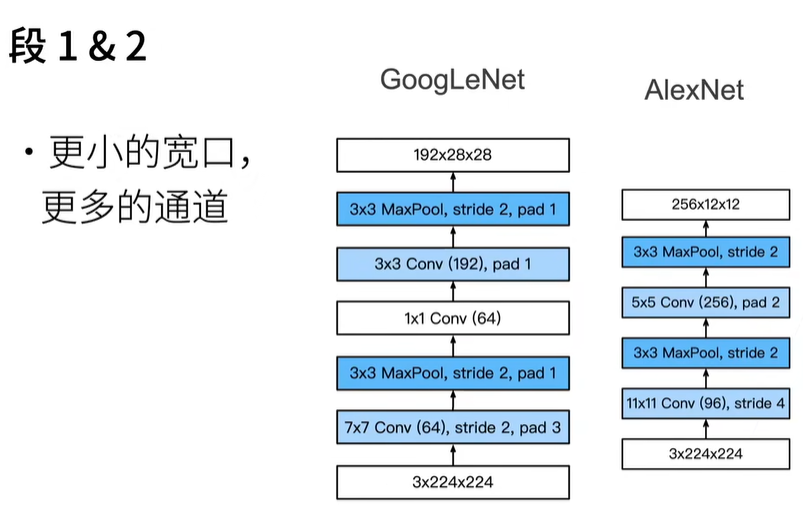

网络结构

GoogleLeNet的整体结构主要包括:

-

输入层:224x224的RGB图像

-

前几个卷积层和池化层:用于初步提取特征

-

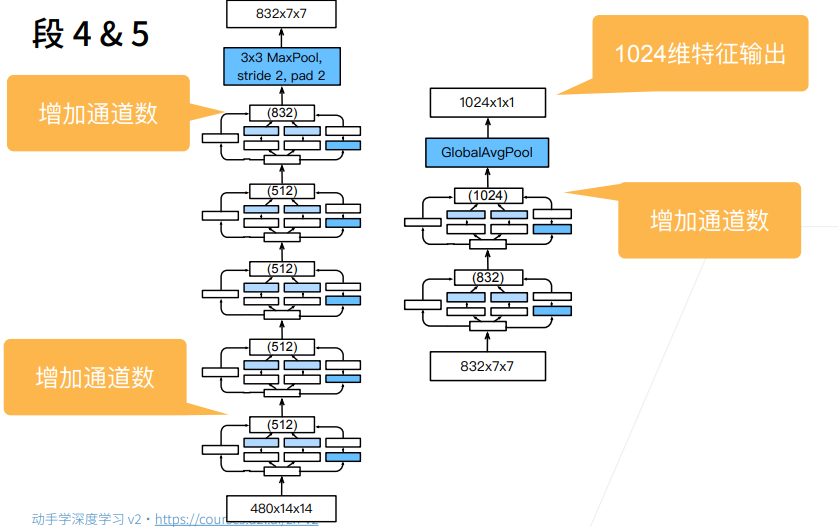

4个Inception模块:用于逐步提取更高级别的特征

-

全局平均池化层:对每个特征图进行全局平均池化,得到一个特征向量

-

全连接层:

- 使用ReLU激活函数

- Dropout正则化

-

输出层:

- 1000个神经元(对应ImageNet的1000个类别)

- 使用Softmax激活函数

GoogleLeNet的特点

-

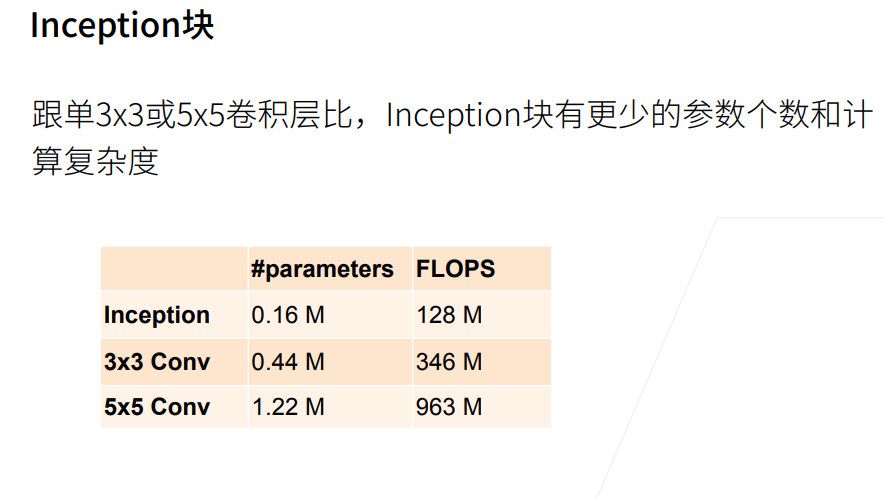

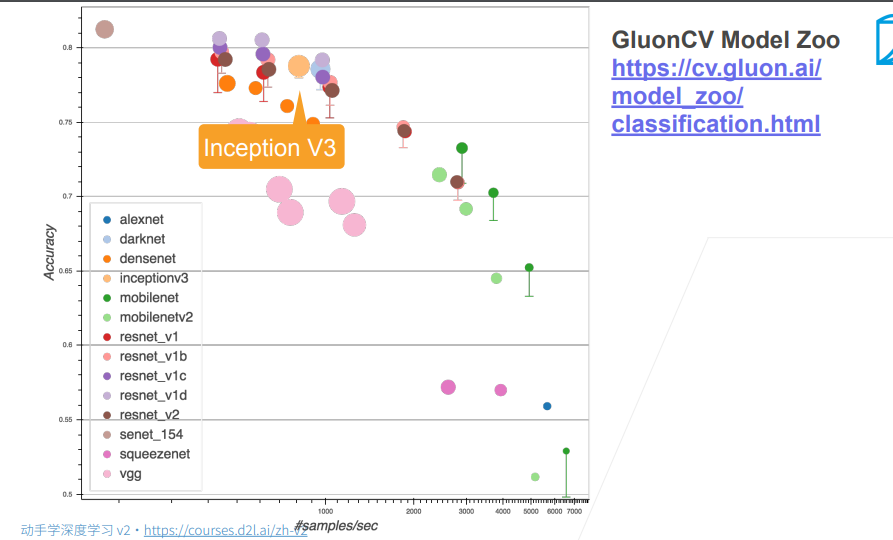

高效性:通过Inception模块的设计,GoogleLeNet在保持较高的分类准确率的同时,大大减少了模型的参数数量和计算复杂度。

-

多尺度特征提取:Inception模块并行地使用不同尺寸的卷积核和池化层,有助于提取和组合多尺度的图像特征。

-

深度和宽度的平衡:相比于VGGNet和NiN,GoogleLeNet通过Inception模块实现了网络深度和宽度的平衡,有助于避免梯度消失和梯度爆炸问题。

总结

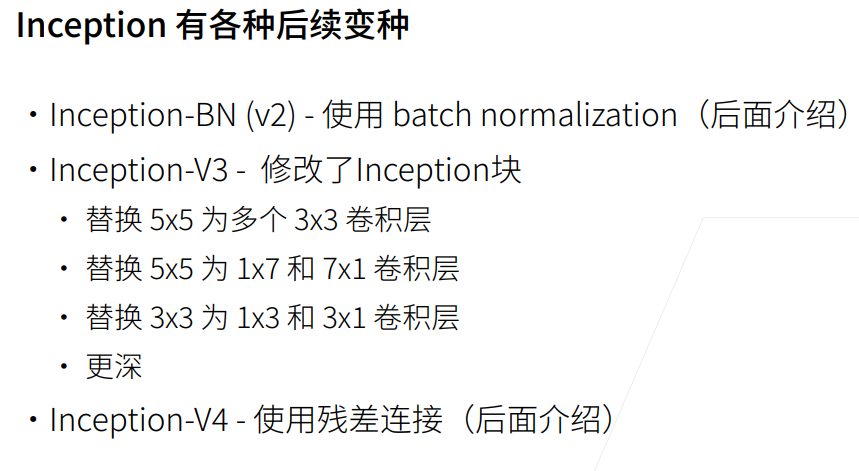

GoogleLeNet(Inception v1)是一个创新的深度卷积神经网络模型,它通过引入“Inception模块”和多尺度特征提取的策略,显著提高了模型的参数效率、计算效率和分类准确率。GoogleLeNet的成功不仅证明了深度学习在计算机视觉领域的强大潜力,而且也为后续更深、更复杂的卷积神经网络模型(如Inception v2、Inception v3、Inception v4等)的研究和应用提供了有益的启示。

GoogleLeNet(Inceptionv1)是一种高效的深度学习模型,通过Inception模块进行多尺度特征提取,减少参数和计算量,提高分类准确率。其成功对后续卷积神经网络发展有重要影响。

GoogleLeNet(Inceptionv1)是一种高效的深度学习模型,通过Inception模块进行多尺度特征提取,减少参数和计算量,提高分类准确率。其成功对后续卷积神经网络发展有重要影响。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?