1

会话执行操作:一般操作会话,定义会话,通过会话执行操作。

2

CNN(循环神经网络)

3

gradient descent optimizer(梯度下降优化器)

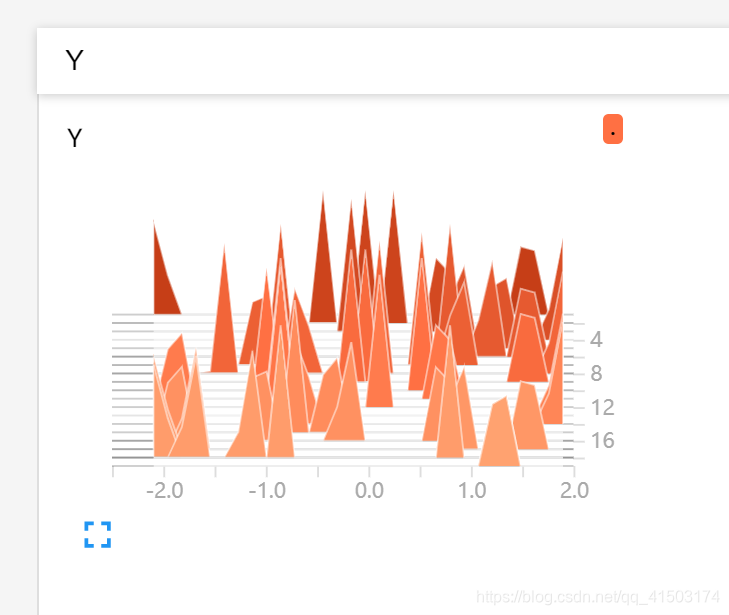

4 在tensorboard中将数据用直方图形式表现出来

这个函数有四个参数:

tf.summary.histogram(tags, values, collections=None, name=None)

一般只用到前两个,第一个标签,第二个是作图对象(就是将什么用直方图表示出来)

例如:

tf.summary.histogram('Y',Y) #在tensorboard上 将Y的值用直方图的的形式表现出来。

#只要有这句话就会画出一个图来。

5 有关变量和占位符

tensorflow中的变量是用来做参数的。(变量必须初始化!!!)

tensorflow中的占位符(占位变量)的作用是作为输入输出的。占位符也像一个未知数,当需要运行时再把数据输入进去。

6 图例

图例 是 集中于地图一角或一侧的地图上各种符号和颜色所代表内容与指标的说明, 有助于更好的认识地图。它具有双重任务,在编图时作为图解表示地图内容的准绳,用图时作为必不可少的阅读指南。

plt.legend()

7 plt.plot()

plt.plot(x,y,format_string,**kwargs)

x轴数据,y轴数据,format_string控制曲线的格式字串

format_string 由颜色字符,风格字符,和标记字符

8 画散点图(plt.scatter())

9 tf.assign(A, new_number)

这个函数的功能主要是把A的值变为new_number

10 sess.run()

他的使用一般可以是:

#运行cost这个操作,将train_X的值赋给X,将train_Y的值赋给Y

sess.run(cost, feed_dict={X: train_X, Y: train_Y})

11 .eval()

cost =tf.reduce_mean( tf.square(Y - z))

learning_rate = 0.01

#梯度下降优化器learning_rate是学习率,minimize函数处理了梯度计算和参数更新两个操作

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(cost)

cost.eval({X: train_X, Y: train_Y})

#最后一行代码,可以看出 .eval() 的使用方法:

操作名.eval() ,括号里面的参数可以有可以没有,在这个代码中X,Y是与cost操作相关的参数,

这是用一个字典给这两个变量赋值。

但是要注意的是,eval()只能用于tf.Tensor类对象,也就是有输出的Operation。对于没有输出的Operation, 可以用.run()或者Session.run()。Session.run()没有这个限制。

3593

3593

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?