K8s-----Volumes之PV静态NFS服务

1 持久卷

1.1 持久卷的介绍

(1)PersistentVolume(持久卷,简称PV)是集群内,由管理员提供的网络存储的一部分。就像集群中的节点一样,PV也是集群中的一种资源。它也像Volume一样,是一种volume插件,但是它的生命周期却是和使用它的Pod相互独立的。PV这个API对象,捕获了诸如NFS、ISCSI、或其他云存储系统的实现细节。

(2)PersistentVolumeClaim(持久卷声明,简称PVC)是用户的一种存储请求。它和Pod类似,Pod消耗Node资源,而PVC消耗PV资源。Pod能够请求特定的资源(如CPU和内存)。PVC能够请求指定的大小和访问的模式(可以被映射为一次读写或者多次只读)。

虽然PersistentVolumeClaim允许用户使用抽象存储资源,但是对于不同的问题,用户通常需要具有不同属性(比如性能)的持久卷。集群管理员需要能够提供不同于大小和访问模式的各种持久性卷,而不需要让用户了解这些卷是如何实现的。对于这些需求,有一个StorageClass资源。

(3)有两种PV提供的方式:静态和动态。

- 静态PV:集群管理员创建多个PV,它们携带着真实存储的详细信息,这些存储对于集群用户是可用的。它们存在于Kubernetes

API中,并可用于存储使用。 - 动态PV:当管理员创建的静态PV都不匹配用户的PVC时,集群可能会尝试专门地供给volume给PVC。这种供给基于StorageClass。

1.2 持久卷的相关知识

(1)使用

- Pod使用PVC就像使用volume一样。集群检查PVC,查找绑定的PV,并映射PV给Pod。对于支持多种访问模式的PV,用户可以指定想用的模式。一旦用户拥有了一个PVC,并且PVC被绑定,那么只要用户还需要,PV就一直属于这个用户。用户调度Pod,通过在Pod的volume块中包含PVC来访问PV。

(2)释放

- 当用户使用PV完毕后,他们可以通过API来删除PVC对象。当PVC被删除后,对应的PV就被认为是已经是“released”了,但还不能再给另外一个PVC使用。前一个PVC的属于还存在于该PV中,必须根据策略来处理掉

(3)回收

- PV的回收策略告诉集群,在PV被释放之后集群应该如何处理该PV。当前,PV可以被Retained(保留)、Recycled(再利用)或者Deleted(删除)。保留允许手动地再次声明资源。对于支持删除操作的PV卷,删除操作会从Kubernetes中移除PV对象,还有对应的外部存储(如AWS

EBS,GCE PD,Azure Disk,或者Cinder volume)。动态供给的卷总是会被删除。

(4)访问模式

1. ReadWriteOnce -- 该volume只能被单个节点以读写的方式映射

2. ReadOnlyMany -- 该volume可以被多个节点以只读方式映射

3. ReadWriteMany -- 该volume可以被多个节点以读写的方式映射

-

在命令行中,访问模式可以简写为:

RWO - ReadWriteOnce

ROX - ReadOnlyMany

RWX - ReadWriteMany

(5)回收策略

Retain:保留,需要手动回收

Recycle:回收,自动删除卷中数据

Delete:删除,相关联的存储资产,如AWS EBS,GCE PD,Azure Disk,or OpenStack Cinder卷都会被删除

注意:

- 目前只有NFS和HostPath支持回收利用

- AWS EBS,GCE PD,Azure Disk, OpenStackCinder卷支持删除操作

(6)状态:

Available:空闲的资源,未绑定给PVC

Bound:绑定给了某个PVC

Released:PVC已经删除了,但是PV还没有被集群回收

Failed:PV在自动回收中失败了

命令行可以显示PV绑定的PVC名称。

2 NFS持久化存储

2.1 实验环境

(1)server2、server4字节点安装配置NFS服务:

yum install -y nfs-utils

systemctl enbale --now nfs

(2)server2安装配置NFS服务:

yum install -y nfs-utils

vim /etc/exports ## /nfsdata *(rw,no_root_squash)

systemctl enable --now nfs

mkdir /nfsdata

cd /nfsdata

mkdir pv1 pv2 pv3

2.2 NFS持久化存储实验

2.2.1 创建NFS PV卷

(1)应用文件创建PV卷:kubectl apply -f nfs-pv.yml

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv1

spec:

capacity:

storage: 5Gi

volumeMode: Filesystem

accessModes:

- ReadWriteOnce

persistentVolumeReclaimPolicy: Recycle

storageClassName: nfs

nfs:

path: /nfsdata/pv1

server: 172.25.12.1

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv2

spec:

capacity:

storage: 1Gi

volumeMode: Filesystem

accessModes:

- ReadOnlyMany

persistentVolumeReclaimPolicy: Recycle

storageClassName: nfs

nfs:

path: /nfsdata/pv2

server: 172.25.12.1

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv3

spec:

capacity:

storage: 10Gi

volumeMode: Filesystem

accessModes:

- ReadWriteMany

persistentVolumeReclaimPolicy: Recycle

storageClassName: nfs

nfs:

path: /nfsdata/pv3

server: 172.25.12.1

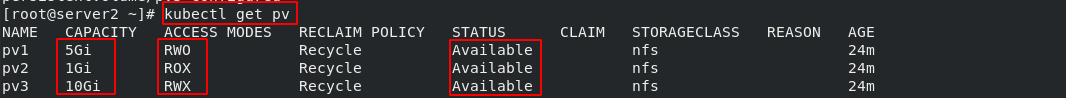

(2)查看pv的信息: kubectl get pv

2.2.2 创建PVC

(1)应用文件创建PVC:kubectl apply -f nfs-pvc.yml

---

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: pvc1

spec:

storageClassName: nfs

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 5Gi

---

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: pvc2

spec:

storageClassName: nfs

accessModes:

- ReadOnlyMany

resources:

requests:

storage: 1Gi

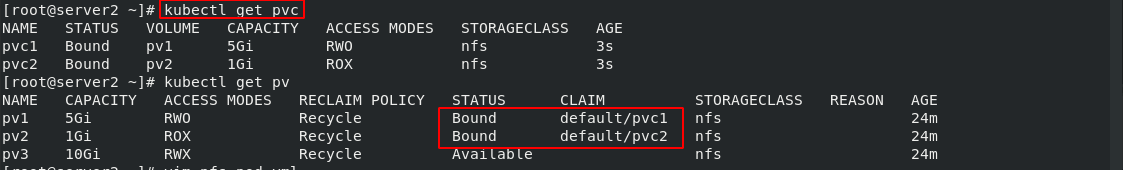

(2)查看pv和pvc的信息

kubectl get pvc

kubectl get pv

- PVC与PV的绑定是一对一的映射,没找到匹配的PV,那么PVC会无限期处于unbound未绑定状态

2.2.3 Pod挂载PV

(1)应用文件挂载pod:kubectl apply -f nfs-pod.yml

---

apiVersion: v1

kind: Pod

metadata:

name: test-pd1

spec:

containers:

- image: myapp:v1

name: myapp

volumeMounts:

- mountPath: /usr/share/nginx/html

name: pv-nfs

volumes:

- name: pv-nfs

persistentVolumeClaim:

claimName: pvc1

---

apiVersion: v1

kind: Pod

metadata:

name: test-pd2

spec:

containers:

- image: myapp:v1

name: myapp

volumeMounts:

- mountPath: /usr/share/nginx/html

name: pv-nfs

volumes:

- name: pv-nfs

persistentVolumeClaim:

claimName: pvc2

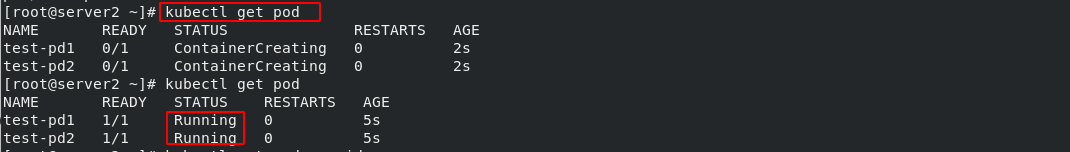

(2)查看pod的信息:kubectl get pod

2.3 测试

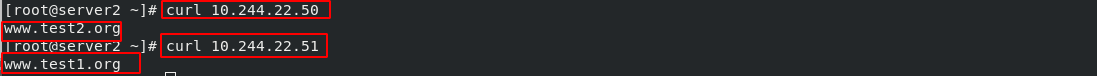

(1)查看pod的详细信息: kubectl get pod -o wide,访问服务时出错,原因是pod的挂载目录中没有nginx的默认发布页面

(2)在挂载目录下创建nginx的默认发布文件

[root@server1 nfsdata]# ll

total 4

drwxr-xr-x 2 root root 24 Feb 25 12:58 pv1

drwxr-xr-x 2 root root 6 Feb 25 12:57 pv2

drwxr-xr-x 2 root root 6 Feb 25 12:24 pv3

[root@server1 nfsdata]# echo www.test1.org > pv1/index.html

[root@server1 nfsdata]# echo www.test2.org > pv2/index.html

- 访问服务成功

3375

3375

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?