ICCV 2019

Jia-Xing Zhao, Jiang-Jiang Liu, Deng-Ping Fan, Yang Cao, Jufeng Yang, Ming-Ming Cheng

https://openaccess.thecvf.com/content_ICCV_2019/html/Zhao_EGNet_Edge_Guidance_Network_for_Salient_Object_Detection_ICCV_2019_paper.html

一、简介

FCN存在显著对象检测目标边界模糊的问题。作者发现显著边缘信息和显著对象信息之间具有互补性,可以通过融合这两种互补信息来提高定位和分割的精度。为此,作者提出了边缘引导的网络(EGNet)。

PSFEM用U-Net结构来获得丰富的上下文信息,C3-C6用来提取显著对象信息。

NLSEM用来提取显著边缘信息,将C6的高层语义信息加入其中。

O2OGM用来将显著边缘信息与显著对象信息进行融合。

二、Complementary information modeling(互补信息模型)

2.1 Backbone

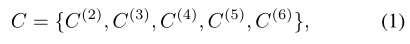

使用VGG预训练网络作为backbone,从backbone中得到输出C,如公式(1)。我们将VGG每层输出的侧路径记为S,例如Conv2-2输出的侧路径就是S2。

丢弃Conv1-2的输出,因为它离输入很近,感受野很小。Conv2-2的输出(C2)保留更好的边缘信息,使用C2来提取边缘特征,其他来提取突出物体特征。

2.2 Progressive salient object features extraction

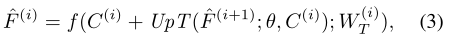

为了获得更丰富的上下文特征,使用U-Net结构来生成多分辨率特征。并在每个侧路径上添加3个卷积层(即Figure2中的左侧黄色Conv)来获得更丰富的显著物体特征。

注意:Figure2中的黄色Conv由3个卷积层组成,其结构为Table1中的T1、T2和T3。

此外,使用了一个3×3通道为1的卷积D将特征映射转换为单通道预测mask。

2.3 Non-local salient edge features extraction

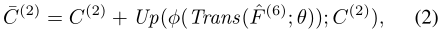

该模块旨在建模显著边缘信息并提取突出边缘特征。如上所述,Conv2-2保留了更好的边缘信息,因此,我们从Conv2-2中提取定位边缘信息。但是,为了获得显著的边缘特征,只有定位信息还不够,还需要高级语义信息或位置信息。

U-Net网络从顶层逐渐返回到底层的方式,其顶层的位置信息会逐渐减少。而且,顶层的感受野是最大的,位置是最准确的。因此,我们设计了一个自上而下的位置传播,以将顶层位置信息传播到侧路径S2,以抑制非突出边缘。

Trans()是卷积层,为了改变输入的通道数。

Up()双线性插值操作,为了使输入与C2尺寸一样。

C3、C4、C5和C6使用了自上而下的位置传播,如公式(3)。

在得到引导特征C2’后,经过一系列的卷积操作来增强其特征。

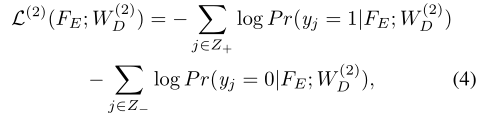

为了模拟显式突出边缘特征,我们增加了额外的突出边缘损失来监督显著边缘特征,NLSEM损失如公式(4):

Z+和Z-表示显著边缘像素集合和背景像素集合。Pr()是预测图,其中每个值表示像素的显著边缘置信度。

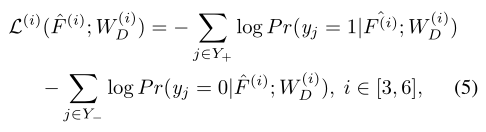

PSDEM损失如公式(5):

Y+和Y-表示显著性区域像素集合和非显著性区域像素集合。

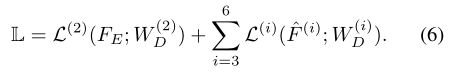

整体损失如公式(6):

2.4 One-to-one guidance module

在获得互补显著边缘特征和显著对象特征后,我们的目标是利用显著边缘特征来引导显著对象特征在分割和定位上执行得更好。因此,我们提出了一对一的指导模块。

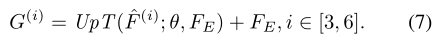

我们添加S3,S4,S5和S6的子侧路径,通过将显著边缘特征融合到增强的显著物体特征中,使高层预测的定位更准,分割细节更好。如公式(7):

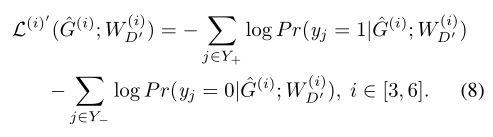

损失函数如公式(8):

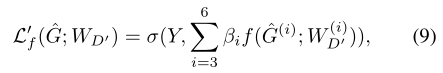

然后将3 4 5 6得结果融合在计算损失,如公式(9):

σ表示交叉熵损失。

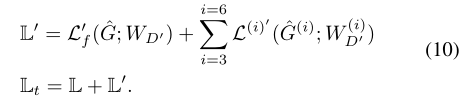

最终损失如公式(10):

三、实验

862

862

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?