arXiv 2021

Jing Zhang, Yunqiu Lv, Mochu Xiang, Aixuan Li, Yuchao Dai, Yiran Zhong

论文地址

一、简介

探索深度信息对伪装物体检测的贡献,提出了一个深度信息引导的伪装对象检测网络。

我们引入深度质量评估模块来评估伪装对象检测的深度质量,并只使用高质量的深度更新网络的模态交互部分。

在测试过程中,我们的深度质量评估模块可以自动识别深度质量。

二、方法

2.1 简介

我们首先使用现有的单目深度估计方法生成深度图,然后引入深度质量评估模块,根据RGB COD 和RGB-D COD模型的预测结果有效地识别高质量的深度图,并相应地更新网络参数。

该框架一共有三个部分:1)RGB COD model;2)RGB-D COD model;3)深度质量评估模块。

2.2 初始深度生成

使用现有最先进的单目深度估计方法(MiDaS,Monodepth2,FrozenPeople)为我们的训练和测试数据集生成深度图。其中MiDaS在不同场景中提供了可靠的结果,Monodepth2主要针对自动驾驶,FrozenPeople主要针对人类。如图Figure3所示,MiDaS的效果更好,所以在实验中采用了MiDaS来生成深度图。

2.3 RGB COD model

Encoder使用ResNet-50,生成四个featuers。Prediction旨在将较高较低的特征与较大的接受域相结合,以进行伪装对象检测。

ASPP是多孔空间金字塔池化模块,RCA是残差通道注意模块,Triple Conv是3个3×3的卷积。

2.4 RGB-D COD model

RGB-D COD model的Encoder和COD Prediction部分与RGB COD model完全相同。

Mode Exploring:

Mode Exploring 旨在有效融合RGB特征和深度特征以进行多模态学习。

首先对每个阶段的特征(一共有4个阶段)使用3×3卷积层进行通道缩减,然后对每个阶段的RGB特征和深度特征进行拼接操作,接着使用RCA进行判别特征提取,最后使用3×3的卷积获得多级融合特征。

Estimated Depth:

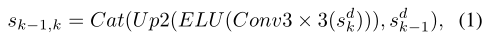

使用U-Net结构,逐渐的将高级信息与低级信息融合。具体公式如下:

Cat表示拼接操作,ELU是ELU激活函数,Up2表示上采样两倍。

参数:

RGB COD解码器与RGB-D COD解码器共享权重。

我们认为高质量和低质量的深度图都可以用来更新深度编码器和深度解码器,因为深度评估模块中的平滑度损失可以推动网络生成相对有效的深度特征。但是,“模式探索”模块对深度质量非常敏感。然后我们只用高质量的深度图更新它。

2.5 深度图质量评估

由于域间隙,从单目深度估计方法生成的深度图可能不是很准确,直接使用低质量的深度图训练可能不会提高模型的性能,因为网络会过度拟合不太准确的深度图,导致泛化能力差。对此,我们首先对其生成的深度图进行质量评估,然后仅使用高质量的深度图进行多模态信息探索。

深度质量评估模块由4个级联卷积层(3×3,步长为2)和一个全连接层组成,以产生一个在[0,1]范围内表示深度质量的标量。四个卷积层的通道大小分别为C,2∗C,4∗C,C。在所有卷积层之后使用批量归一化和 LeakyReLU。最后一个全连接层用于将通道大小为 C 的特征图映射到表示深度质量的二维特征向量({1,0}表示好,{0,1}表示坏)。

由于我们没有关于深度质量的先验知识,我们引入了一种性能引导的深度质量监督生成技术。RGB-D COD model生成的map比RGB COD model生成的map精度更高则表示更高质量的深度图。

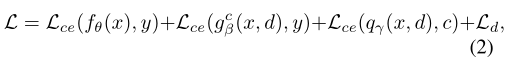

2.6 目标函数

整体损失:

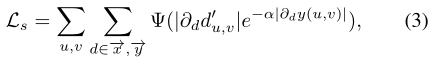

平滑度损失将深度限制为与我们的地面真实伪装图共享相似的结构,其定义为:

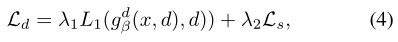

深度估计损失:

流程伪代码:

三、实验

3308

3308

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?