1. 决策树定义(决策树的构建算法主要有ID3、C4.5、CART三种,其中ID3和C4.5是分类树,CART是分类回归树)

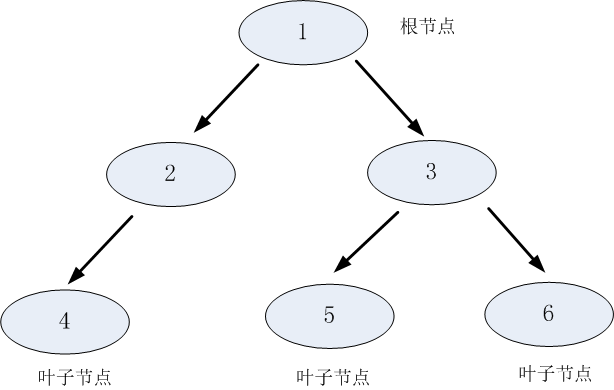

理解树,就需要理解几个关键词:根节点、父节点、子节点和叶子节点。

决策树利用如上图所示的树结构进行决策,每一个非叶子节点是一个判断条件,每一个叶子节点是结论。

实质上就是在用特征维度对样本空间进行划分。假设树为二叉树,通过不断将特征进行分裂。比如当前树结点是基于第j个特征值进行分裂的,设该特征值小于s的样本划分为左子树,大于s的样本划分为右子树。

2. 决策树的构建

两步:分裂与剪枝

分裂:

1)数据分割:

分裂属性的数据类型分为离散型和连续性两种情况。

离散型的数据——按照属性值进行分裂,每个属性值对应一个分裂节点;

连续性的数据——是对数据按照该属性进行排序,再将数据分成若干区间,如[0,10]、[10,20]、[20,30]…,一个区间对应一个节点,若数据的属性值落入某一区间则该数据就属于其对应的节点。

2)分裂属性的选择:贪婪思想(即选择可以得到最优分裂结果的属性进行分裂。)

每次尝试对自己已有叶

决策树与XGBOOST

最新推荐文章于 2024-03-25 21:54:29 发布

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

557

557

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?