B站up主“刘二大人”视频 笔记

本文章是该视频的一部分,该部分的案例代码使用RNN-cell做一个简单的实验,其余部分见作者的其他文章。

一、什么是循环神经网络

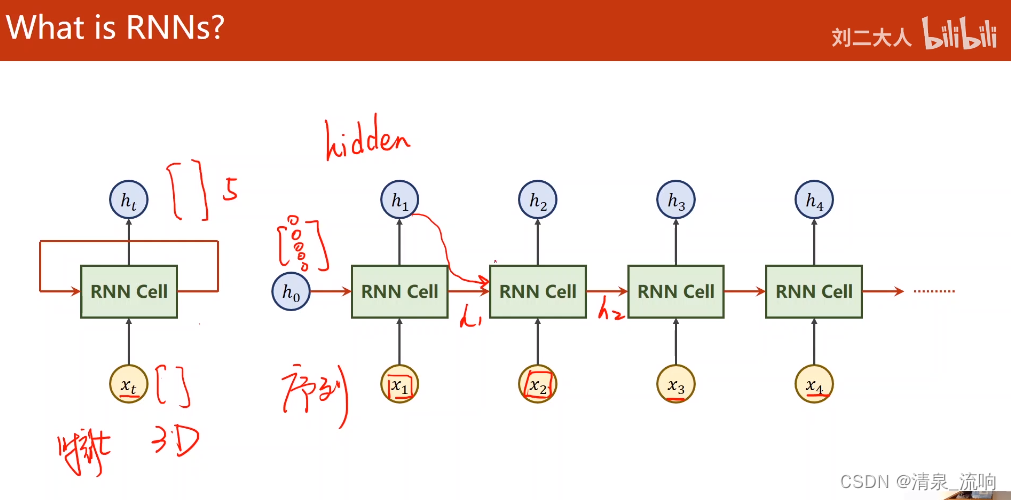

循环神经网络(Recurrent Neural Network, RNN)是一类以序列(sequence)数据为输入,在序列的演进方向进行递归(recursion)且所有节点(循环单元)按链式连接的递归神经网络 。

对循环神经网络的研究始于二十世纪80-90年代,并在二十一世纪初发展为深度学习(deep learning)算法之一 ,其中双向循环神经网络(Bidirectional RNN, Bi-RNN)和长短期记忆网络(Long Short-Term Memory networks,LSTM)是常见的循环神经网络 。

循环神经网络具有记忆性、参数共享并且图灵完备(Turing completeness),因此在对序列的非线性特征进行学习时具有一定优势 。循环神经网络在自然语言处理(Natural Language Processing, NLP),例如语音识别、语言建模、机器翻译等领域有应用,也被用于各类时间序列预报。引入了卷积神经网络(Convolutional Neural Network,CNN)构筑的循环神经网络可以处理包含序列输入的计算机视觉问题。

RNNs的目的使用来处理序列数据。在传统的神经网络模型中,是从输入层到隐含层再到输出层,层与层之间是全连接的,每层之间的节点是无连接的。但是这种普通的神经网络对于很多问题却无能无力。例如,你要预测句子的下一个单词是什么,一般需要用到前面的单词,因为一个句子中前后单词并不是独立的。RNNs之所以称为循环神经网路,即一个序列当前的输出与前面的输出也有关。具体的表现形式为网络会对前面的信息进行记忆并应用于当前输出的计算中,即隐藏层之间的节点不再无连接而是有连接的,并且隐藏层的输入不仅包括输入层的输出还包括上一时刻隐藏层的输出。理论上,RNNs能够对任何长度的序列数据进行处理。但是在实践中,为了降低复杂性往往假设当前的状态只与前面的几个状态相关。

二、循环神经网络能干什么

RNNs已经被在实践中证明对NLP是非常成功的。如词向量表达、语句合法性检查、词性标注等。在RNNs中,目前使用最广泛最成功的模型便是LSTMs(Long Short-Term Memory,长短时记忆模型)模型,该模型通常比vanilla RNNs能够更好地对长短时依赖进行表达,该模型相对于一般的RNNs,只是在隐藏层做了手脚。

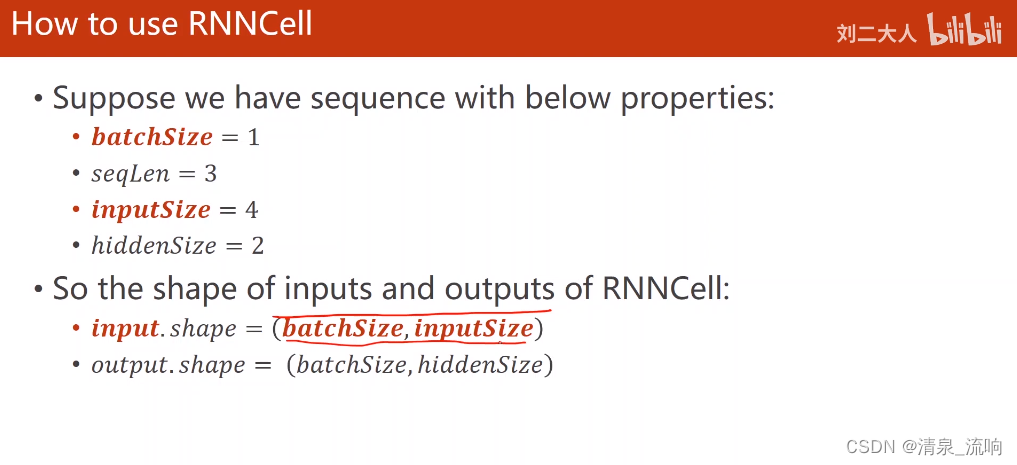

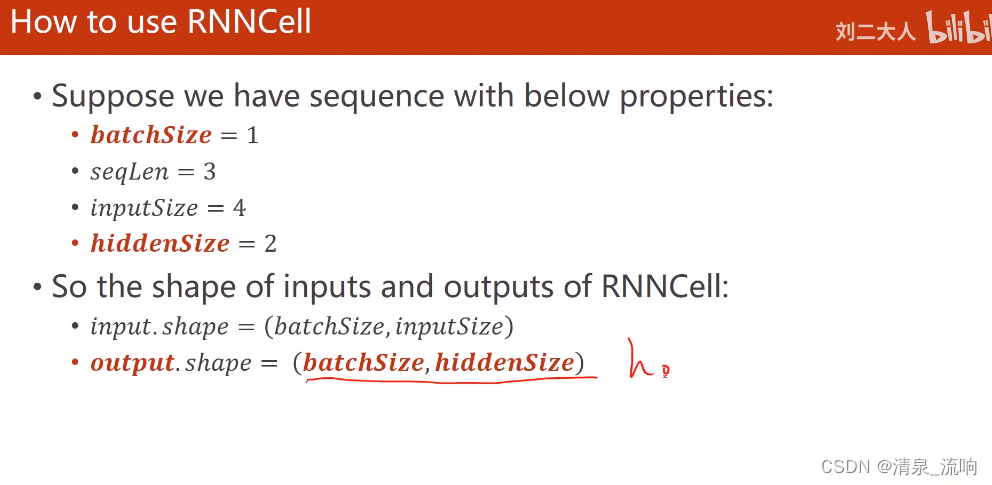

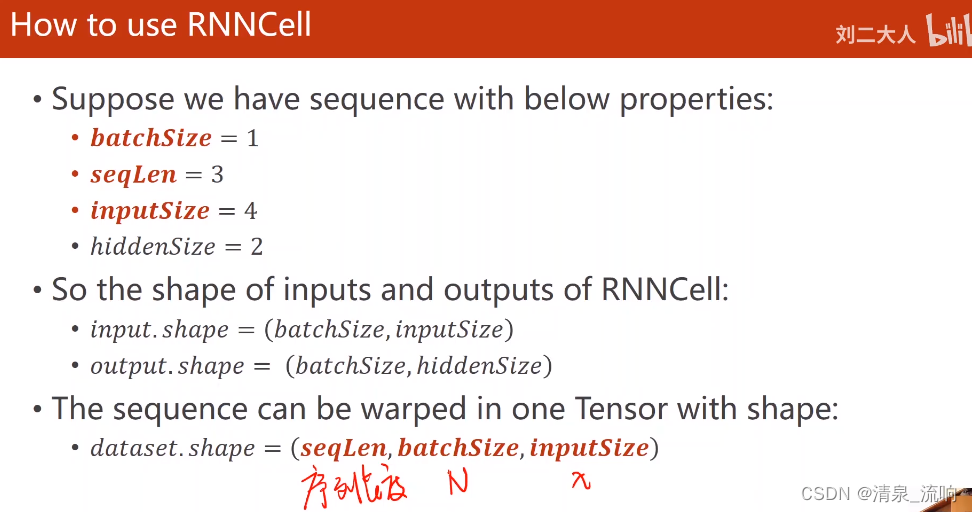

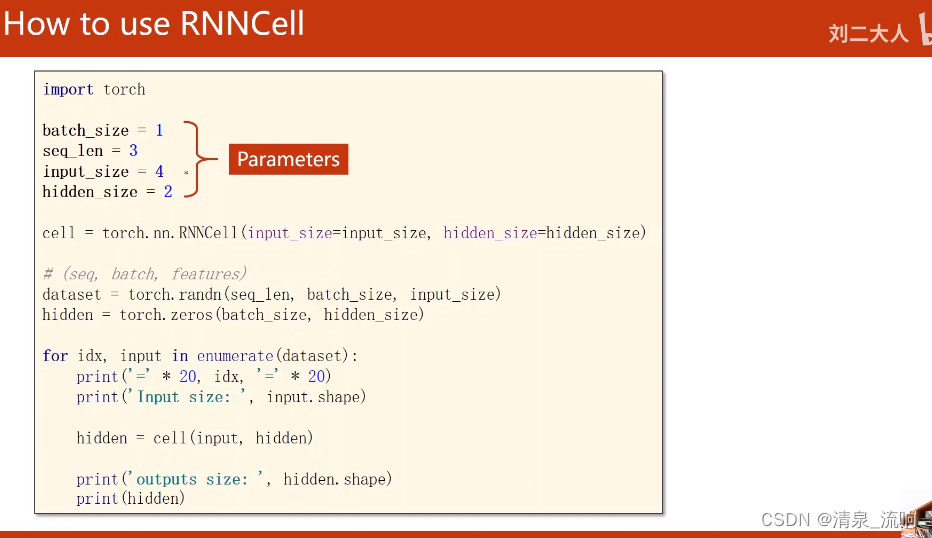

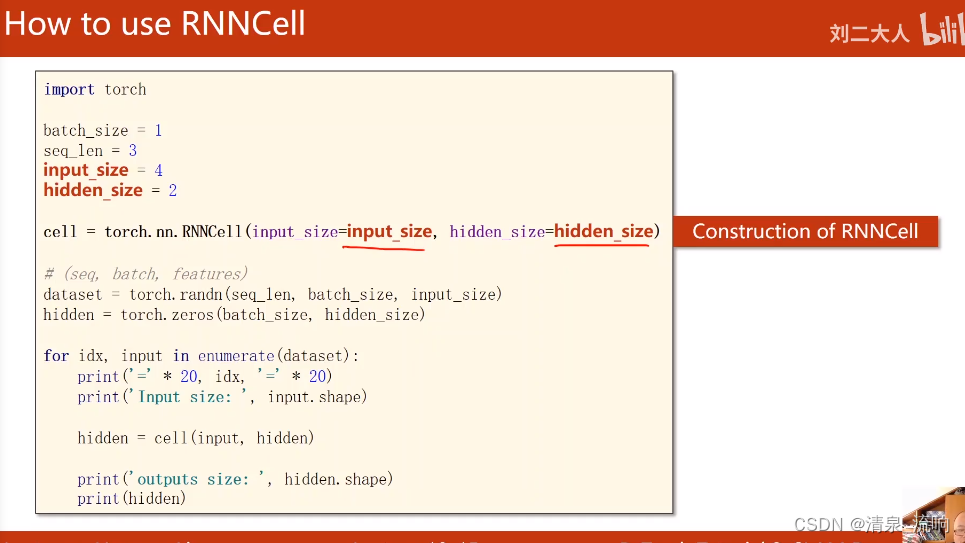

三、RNN-cell使用案例,代码如下:

import torch

batch_size = 1

seq_len = 3 # 每一个样本都有x1,x2,x3

input_size = 4 # x1,x2,x3都是4*1的向量

hidden_size = 2 # 隐层都是2*1的向量

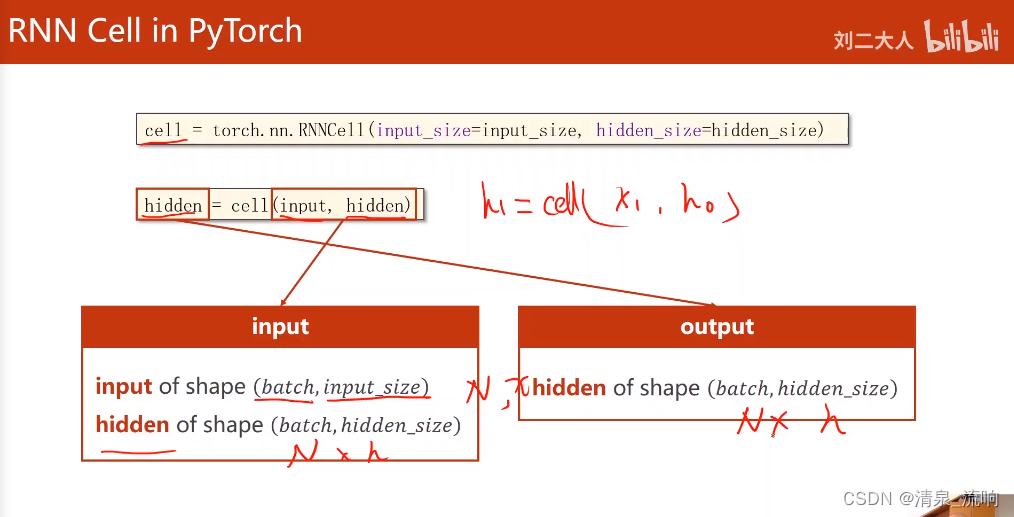

cell = torch.nn.RNNCell(input_size=input_size,hidden_size=hidden_size)

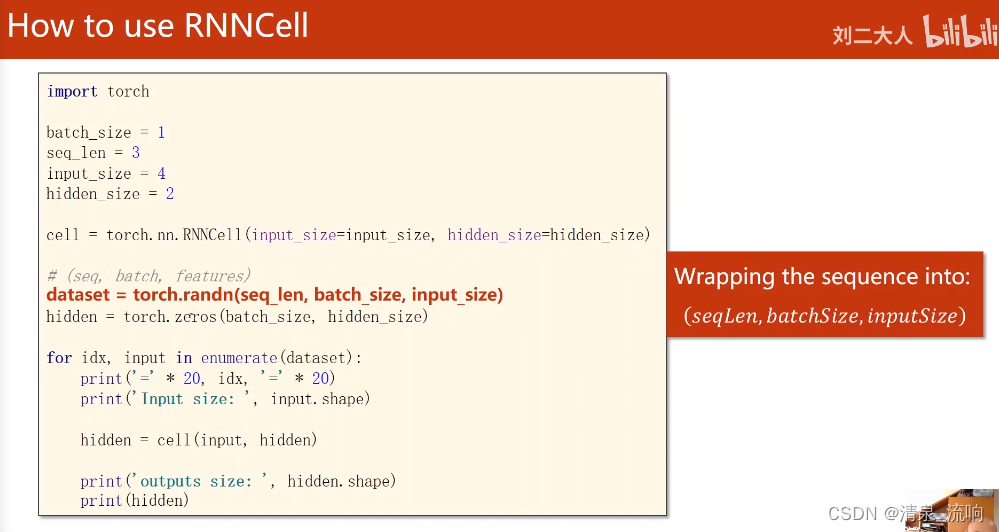

dataset = torch.randn(seq_len, batch_size, input_size)

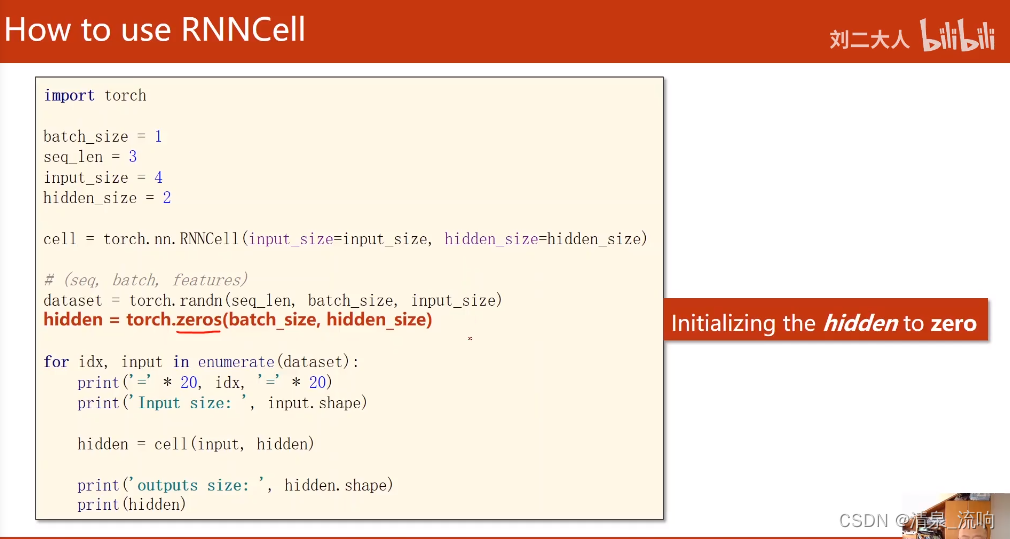

hidden = torch.zeros(batch_size, hidden_size) # h0为全0的向量

for idx, input in enumerate(dataset):

print('=' * 20, idx, '=' * 20)

print('Input size:', input.shape)

hidden=cell(input, hidden) # 当前隐层为这一次的输入+上一次的隐层

print('outputs size: ', hidden.shape)

print(hidden)

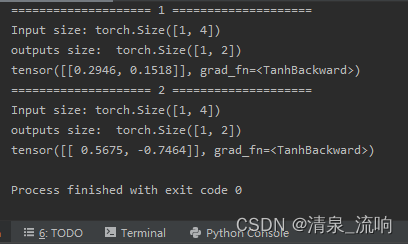

运行结果如下:

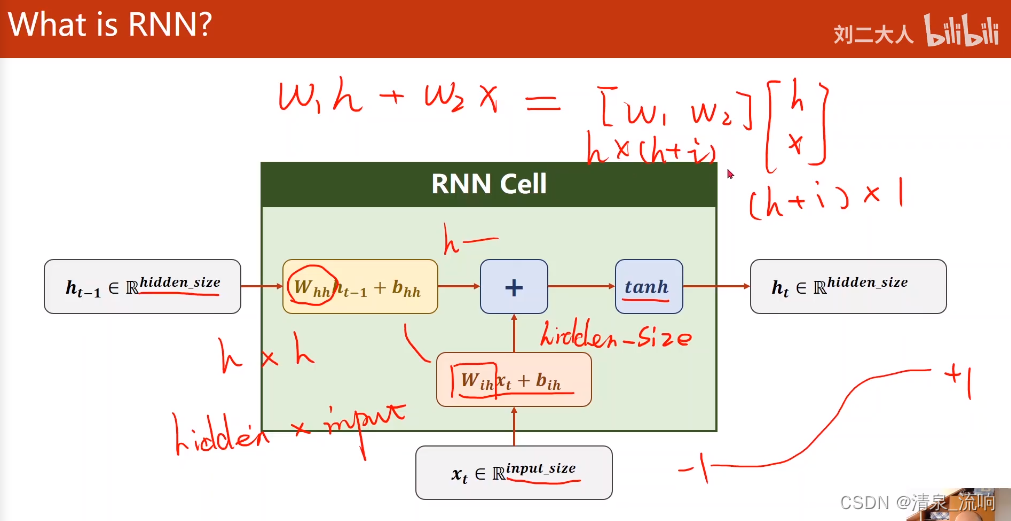

视频截图如下:

rnn cell本质是一个线性层linear ,所有rnn cell是同一个线性层,权值共享

4503

4503

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?