文章目录

一、UNet网络模型

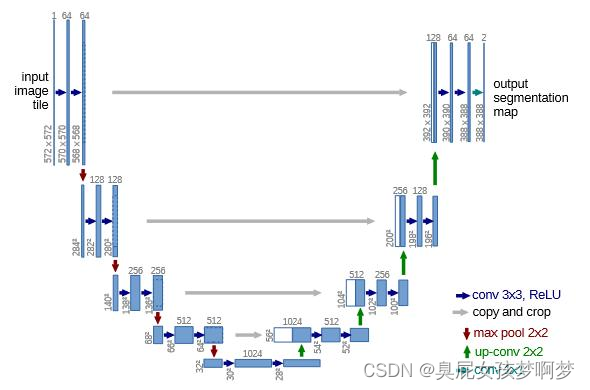

UNet有两部分组成:Encoder和Decoder组成。

1.Encoder

UNet模型的左侧是Encoder模块,负责特征提取。由四个下采样块组成,每个下采样块由两个3*3的卷积核进行卷积、以及2*2的池化核进行最大池化,两部分组成的。此部分类似于CNN的VGG~

2.Decoder

UNet模型的右侧是Decoder模块,进行恢复原始分辨率。由四个上采样块组成,每个上采样块由上采样产生的特征图与左侧特征图进行融合cat操作、两个3*3的卷积核进行的卷积操作,生成特征图。

其中,拼接cat需要图片尺寸大小一致。

深层特征和浅层特征融合,是为了让包含高级抽象特征低分辨率图片在保留高级抽象特征的同时变为高分辨率,然后再与左边低级表层特征高分辨率图像进行融合cat操作。

二、UNet和传统CNN的区别

1.传统CNN是对图像进行分类,输出的结果是整个图像的类标签;UNet是像素级分类,输出的结果是每个像素点的类被,且不同类别的像素会显示不同的颜色。

2.传统CNN是通过卷积层和池化层提取图像特征,经反向传播确定最终参数,并得到最终的特征;而UNet的特征提取步骤较为复杂,分为Encoder和Decoder。

其中Encoder模块包括四个下采样块(两个卷积层、一个最大池化层)

Decoder模块包括四个上采样块(深层特征和浅层特征的融合、两个卷积层、一个最大池化层)

2747

2747

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?