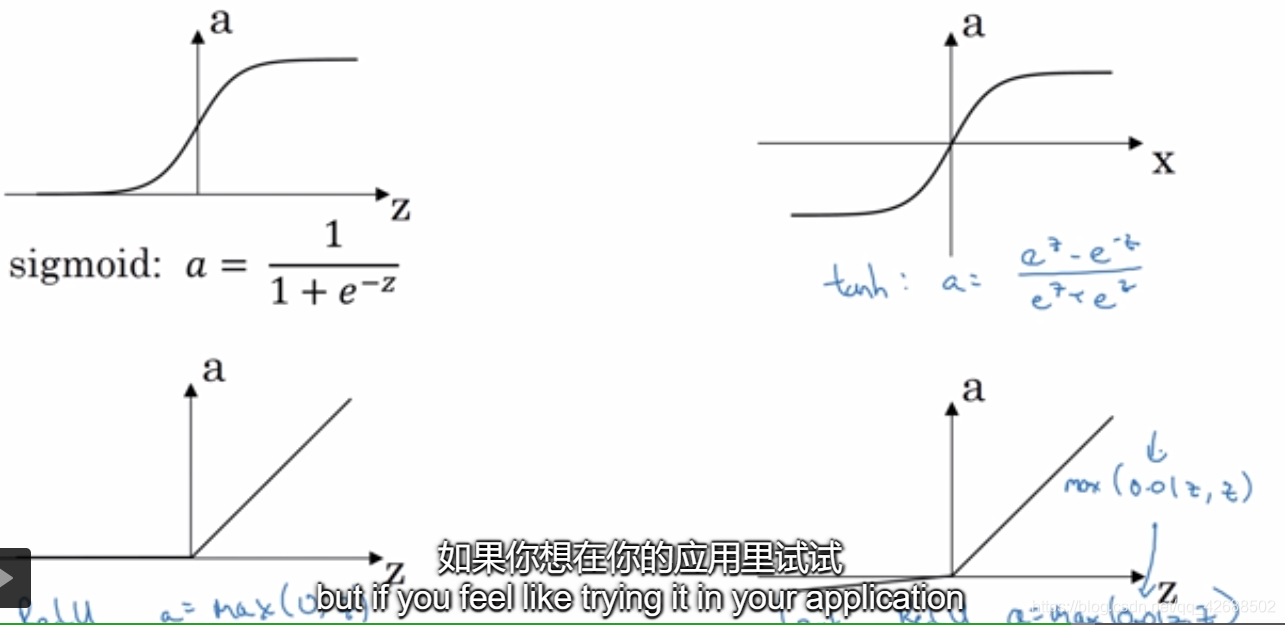

一、激活函数的选择

sigmoid函数很少用,除非你做的是二分分类,tanh函数很多时候都表现的比sigmoid优秀。但最常用的还是relu或者leaky relu 如果你不确定用什么就用relu,各函数的图形见下:

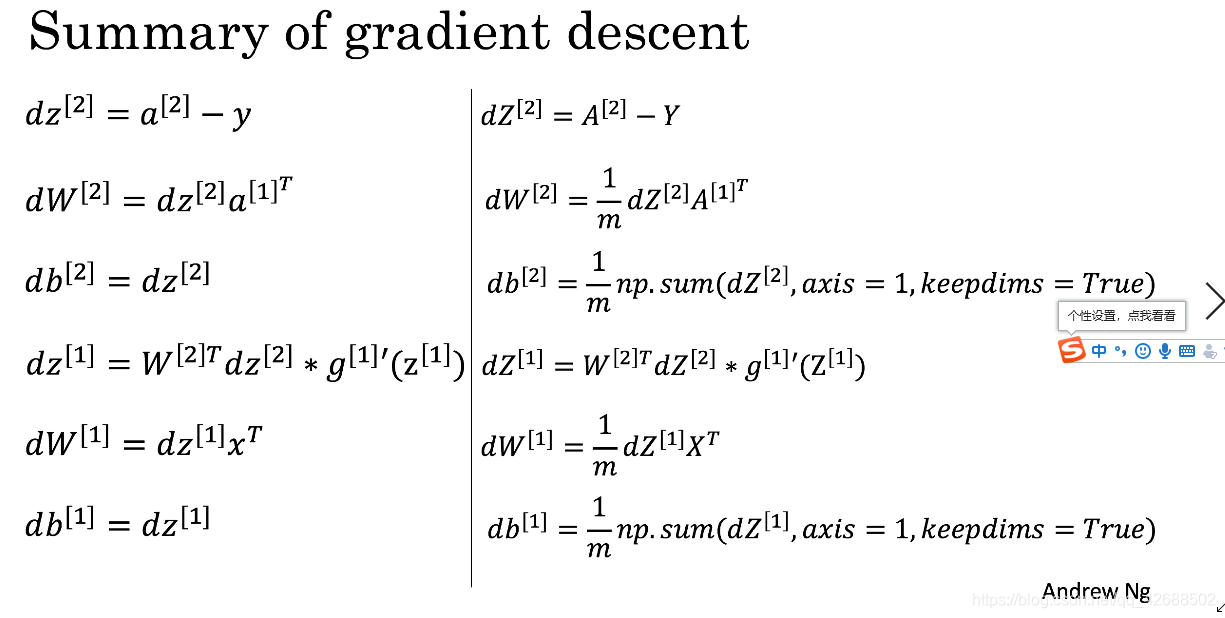

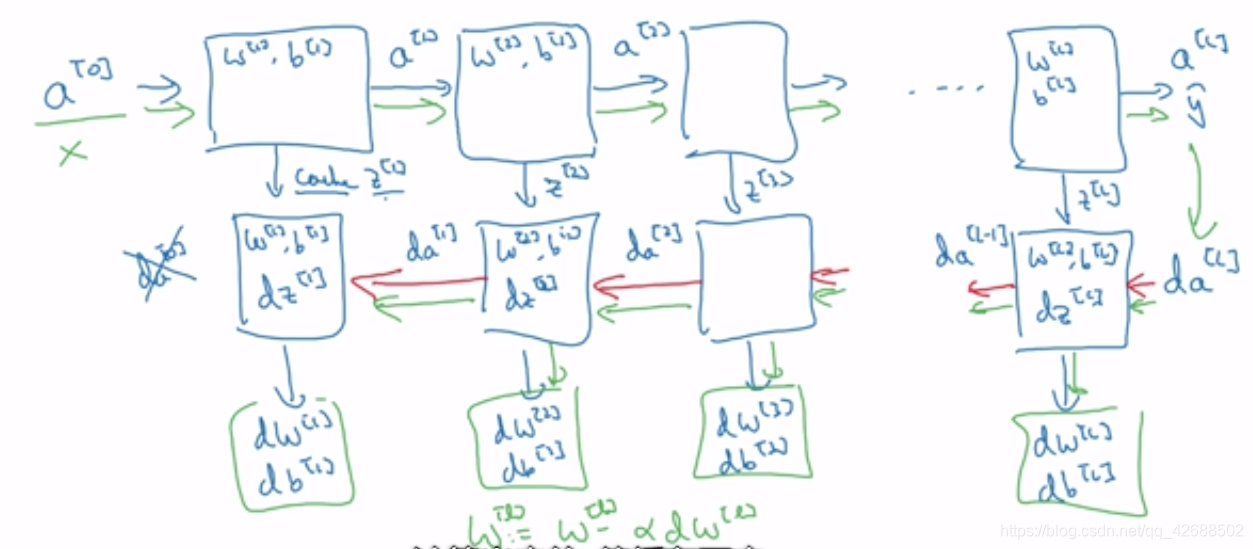

二、吴恩达第一课第三周的反向传播推导出的数学公式如下

注:在写代码的过程中要理解输入数据的维度,在计算中匹配好矩阵维度

Python中的broadcast 是需要有一个维度相同的,若两个维度都不同,不能broadcast!

预测过程其实就是一个前向传播过程

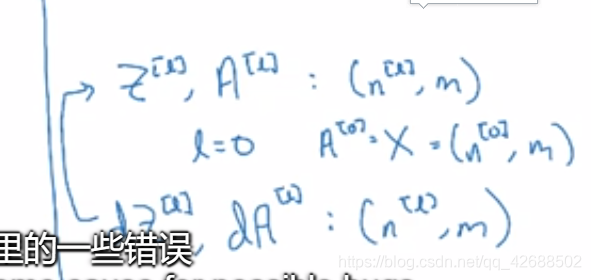

三、一些有关矩阵维度的简单记忆

Zl=(nl,m) =dz Al=(nl,m)=dA

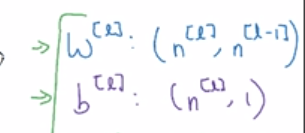

wl=(nl,n^(l-1)) bl=(nl,1)

dWl=Wl dbl=bl

总之,深度网络的维度思考清楚即可

网络实现过程:

记得缓存Z及其他有用值

深度学习和机器学习中我们一般会对我们的数据进行归一化,若是8位的图片归一化一般除以255即可。其余的数据可以用.??.??????.????来进行归一化。

234

234

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?