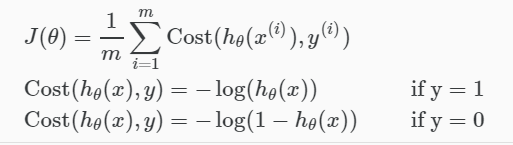

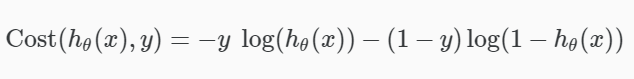

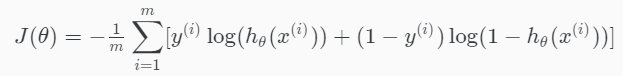

1.逻辑回归分类模型的代价函数:

2.简化后的写法为:

3.几个优化算法:

下面三个算法的优点是不用手动选择学习率,算法会在不同的迭代中自动选择学习率

4.解决过拟合的两个方法:

5.正则化的代价函数:

6.正则化的目标就是要减小各个

θ

\theta

θ的值

7.正则化后的梯度下降:

8.用octave计算正则化逻辑回归的

θ

\theta

θ

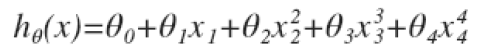

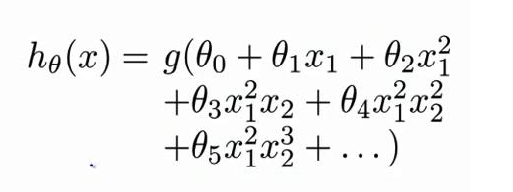

9.正则化的逻辑回归和线性回归的梯度下降公式是一样的,都是下面这个:

不同之处是h

θ

\theta

θ(x)函数。线性回归的h

θ

\theta

θ(x)为:

逻辑回归的h

θ

\theta

θ(x)是:

10.作业答案链接:github

参考链接:https://blog.csdn.net/LilyNothing/article/details/52275176

有一个注意点就是正则化时,theta(0)是不参与正则化的

评分截图:

2792

2792

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?